Kubernetesドキュメントのこのセクションには、個々のタスクの実行方法を示すページが含まれています。タスクページは、通常、短い手順を実行することにより、1つのことを行う方法を示します。

タスクページを作成したい場合は、ドキュメントのPull Requestの作成を参照してください。

これは、このセクションの複数ページの印刷可能なビューです。 印刷するには、ここをクリックしてください.

Kubernetesドキュメントのこのセクションには、個々のタスクの実行方法を示すページが含まれています。タスクページは、通常、短い手順を実行することにより、1つのことを行う方法を示します。

タスクページを作成したい場合は、ドキュメントのPull Requestの作成を参照してください。

Kubernetesのコマンドラインツールkubectlを使用すると、Kubernetesクラスターに対してコマンドを実行できるようになります。

kubectlは、アプリケーションのデプロイ、クラスターリソースの調査と管理、ログの表示などに使用できます。

kubectlの操作の完全なリストを含む詳細については、kubectlのリファレンスドキュメントを参照してください。

kubectlはさまざまなLinuxプラットフォーム、macOS、Windows上にインストールできます。 下記の中から好きなオペレーティングシステムを選んでください。

kindを使うと、ローカルのコンピューター上でKubernetesを実行することができます。

このツールはDockerとPodmanのどちらかのインストールが必要です。

Quick Startに、kindの起動と実行に必要なことが書かれています。

kindと同じように、minikubeは、Kubernetesをローカルで実行するツールです。

minikubeはオールインワンまたはマルチノードのローカルKubernetesクラスターをパーソナルコンピューター上(Windows、macOS、Linux PCを含む)で実行することで、Kubernetesを試したり、日常的な開発作業のために利用できます。

ツールのインストールについて知りたい場合は、公式のGet Started!のガイドに従ってください。

minikubeが起動したら、サンプルアプリケーションの実行を試すことができます。

Kubernetesクラスターの作成、管理をするためにkubeadmツールを使用することができます。

最低限実行可能でセキュアなクラスタを、ユーザーフレンドリーな方法で稼働させるために必要なアクションを実行します。

kubeadmのインストールでは、kubeadmをインストールする方法を示しています。 一度インストールすれば、クラスターを作成するために使用できます。

kubectlのバージョンは、クラスターのマイナーバージョンとの差分が1つ以内でなければなりません。 たとえば、クライアントがv1.36であれば、v1.35、v1.36、v1.37のコントロールプレーンと通信できます。 最新の互換性のあるバージョンのkubectlを使うことで、不測の事態を避けることができるでしょう。

Linuxへkubectlをインストールするには、次の方法があります:

次のコマンドにより、最新リリースをダウンロードしてください:

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/linux/amd64/kubectl"

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/linux/arm64/kubectl"

特定のバージョンをダウンロードする場合、コマンドの$(curl -L -s https://dl.k8s.io/release/stable.txt)の部分を特定のバージョンに書き換えてください。

たとえば、Linux x86-64へ1.36.0のバージョンをダウンロードするには、次のコマンドを入力します:

curl -LO https://dl.k8s.io/release/v1.36.0/bin/linux/amd64/kubectl

そして、Linux ARM64に対しては、次のコマンドを入力します:

curl -LO https://dl.k8s.io/release/v1.36.0/bin/linux/arm64/kubectl

バイナリを検証してください(オプション)

kubectlのチェックサムファイルをダウンロードします:

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/linux/amd64/kubectl.sha256"

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/linux/arm64/kubectl.sha256"

チェックサムファイルに対してkubectlバイナリを検証します:

echo "$(cat kubectl.sha256) kubectl" | sha256sum --check

正しければ、出力は次のようになります:

kubectl: OK

チェックに失敗すると、sha256は0以外のステータスで終了し、次のような出力を表示します:

kubectl: FAILED

sha256sum: WARNING: 1 computed checksum did NOT match

kubectlをインストールしてください

sudo install -o root -g root -m 0755 kubectl /usr/local/bin/kubectl

ターゲットシステムにルートアクセスを持っていない場合でも、~/.local/binディレクトリにkubectlをインストールできます:

chmod +x kubectl

mkdir -p ~/.local/bin

mv ./kubectl ~/.local/bin/kubectl

# そして ~/.local/bin を $PATH の末尾 (または先頭) に追加します

インストールしたバージョンが最新であることを確認してください:

kubectl version --client

または、バージョンの詳細を表示するために次を使用します:

kubectl version --client --output=yaml

aptのパッケージ一覧を更新し、Kubernetesのaptリポジトリを利用するのに必要なパッケージをインストールしてください:

sudo apt-get update

# apt-transport-httpsはダミーパッケージの可能性があります。その場合、そのパッケージはスキップできます

sudo apt-get install -y apt-transport-https ca-certificates curl gnupg

Kubernetesパッケージリポジトリの公開署名キーをダウンロードしてください。 すべてのリポジトリに同じ署名キーが使用されるため、URL内のバージョンは無視できます:

# `/etc/apt/keyrings`フォルダーが存在しない場合は、curlコマンドの前に作成する必要があります。下記の備考を参照してください。

# sudo mkdir -p -m 755 /etc/apt/keyrings

curl -fsSL https://pkgs.k8s.io/core:/stable:/v1.36/deb/Release.key | sudo gpg --dearmor -o /etc/apt/keyrings/kubernetes-apt-keyring.gpg

sudo chmod 644 /etc/apt/keyrings/kubernetes-apt-keyring.gpg # 特権のないAPTプログラムがこのkeyringを読めるようにします

/etc/apt/keyringsフォルダーは既定では存在しないため、curlコマンドの前に作成する必要があります。適切なKubernetesのaptリポジトリを追加してください。

v1.36とは異なるKubernetesバージョンを利用したい場合は、以下のコマンドのv1.36を目的のマイナーバージョンに置き換えてください:

# これにより、/etc/apt/sources.list.d/kubernetes.listにある既存の設定が上書きされます

echo 'deb [signed-by=/etc/apt/keyrings/kubernetes-apt-keyring.gpg] https://pkgs.k8s.io/core:/stable:/v1.36/deb/ /' | sudo tee /etc/apt/sources.list.d/kubernetes.list

sudo chmod 644 /etc/apt/sources.list.d/kubernetes.list # command-not-foundのようなツールが正しく動作するようにします

apt-get updateとapt-get upgradeを実行する前に、/etc/apt/sources.list.d/kubernetes.listの中のバージョンを上げる必要があります。

この手順についてはChanging The Kubernetes Package Repositoryに詳細が記載されています。aptのパッケージインデックスを更新し、kubectlをインストールしてください:

sudo apt-get update

sudo apt-get install -y kubectl

Kubernetesのyumリポジトリを追加してください。

v1.36とは異なるKubernetesバージョンを利用したい場合は、以下のコマンドのv1.36を目的のマイナーバージョンに置き換えてください:

# これにより、/etc/yum.repos.d/kubernetes.repoにある既存の設定が上書きされます

cat <<EOF | sudo tee /etc/yum.repos.d/kubernetes.repo

[kubernetes]

name=Kubernetes

baseurl=https://pkgs.k8s.io/core:/stable:/v1.36/rpm/

enabled=1

gpgcheck=1

gpgkey=https://pkgs.k8s.io/core:/stable:/v1.36/rpm/repodata/repomd.xml.key

EOF

yum updateを実行する前に、/etc/yum.repos.d/kubernetes.repoの中のバージョンを上げる必要があります。

この手順についてはChanging The Kubernetes Package Repositoryに詳細が記載されています。yumを使用してkubectlをインストールしてください:

sudo yum install -y kubectl

Kubernetesのzypperリポジトリを追加してください。

v1.36とは異なるKubernetesバージョンを利用したい場合は、以下のコマンドのv1.36を目的のマイナーバージョンに置き換えてください。

# これにより、/etc/zypp/repos.d/kubernetes.repoにある既存の設定が上書きされます

cat <<EOF | sudo tee /etc/zypp/repos.d/kubernetes.repo

[kubernetes]

name=Kubernetes

baseurl=https://pkgs.k8s.io/core:/stable:/v1.36/rpm/

enabled=1

gpgcheck=1

gpgkey=https://pkgs.k8s.io/core:/stable:/v1.36/rpm/repodata/repomd.xml.key

EOF

zypper updateを実行する前に、/etc/zypp/repos.d/kubernetes.repoの中のバージョンを上げる必要があります。

この手順についてはChanging The Kubernetes Package Repositoryに詳細が記載されています。zypperを更新し、新しいリポジトリの追加を確認してください:

sudo zypper update

このメッセージが表示されたら、't' または 'a' を押してください:

New repository or package signing key received:

Repository: Kubernetes

Key Fingerprint: 1111 2222 3333 4444 5555 6666 7777 8888 9999 AAAA

Key Name: isv:kubernetes OBS Project <isv:kubernetes@build.opensuse.org>

Key Algorithm: RSA 2048

Key Created: Thu 25 Aug 2022 01:21:11 PM -03

Key Expires: Sat 02 Nov 2024 01:21:11 PM -03 (expires in 85 days)

Rpm Name: gpg-pubkey-9a296436-6307a177

Note: Signing data enables the recipient to verify that no modifications occurred after the data

were signed. Accepting data with no, wrong or unknown signature can lead to a corrupted system

and in extreme cases even to a system compromise.

Note: A GPG pubkey is clearly identified by its fingerprint. Do not rely on the key's name. If

you are not sure whether the presented key is authentic, ask the repository provider or check

their web site. Many providers maintain a web page showing the fingerprints of the GPG keys they

are using.

Do you want to reject the key, trust temporarily, or trust always? [r/t/a/?] (r): a

zypperを使用してkubectlをインストールしてください:

sudo zypper install -y kubectl

kubectlがKubernetesクラスターを探索し接続するために、kubeconfigファイルが必要です。

これは、kube-up.shによりクラスターを作成した際や、Minikubeクラスターを正常にデプロイした際に自動生成されます。

デフォルトでは、kubectlの設定は~/.kube/configに格納されています。

クラスターの状態を取得し、kubectlが適切に設定されていることを確認してください:

kubectl cluster-info

URLのレスポンスが表示されている場合は、kubectlはクラスターに接続するよう正しく設定されています。

以下のようなメッセージが表示されている場合は、kubectlは正しく設定されていないか、Kubernetesクラスターに接続できていません。

The connection to the server <server-name:port> was refused - did you specify the right host or port?

たとえば、ラップトップ上(ローカル環境)でKubernetesクラスターを起動するような場合、Minikubeなどのツールを最初にインストールしてから、上記のコマンドを再実行する必要があります。

kubectl cluster-infoがURLレスポンスを返したにもかかわらずクラスターにアクセスできない場合は、次のコマンドで設定が正しいことを確認してください:

kubectl cluster-info dump

Kubernetes 1.26にて、kubectlは以下のクラウドプロバイダーが提供するマネージドKubernetesのビルトイン認証を削除しました。 これらのプロバイダーは、クラウド固有の認証を提供するkubectlプラグインをリリースしています。 手順については以下のプロバイダーのドキュメントを参照してください:

(この変更とは関係なく、他の理由で同じエラーメッセージが表示される可能性もあります。)

kubectlはBash、Zsh、Fish、PowerShellの自動補完を提供しています。 これにより、入力を大幅に削減することができます。

以下にBash、Fish、Zshの自動補完の設定手順を示します。

Bashにおけるkubectlの補完スクリプトはkubectl completion bashコマンドで生成できます。

補完スクリプトをシェル内に読み込ませることでkubectlの自動補完が有効になります。

ただし、補完スクリプトはbash-completionに依存しているため、事前にインストールしておく必要があります(type _init_completionを実行することで、bash-completionがすでにインストールされていることを確認できます)。

bash-completionは多くのパッケージマネージャーから提供されています(こちらを参照してください)。

apt-get install bash-completionまたはyum install bash-completionなどでインストールできます。

上記のコマンドでbash-completionの主要スクリプトである/usr/share/bash-completion/bash_completionが作成されます。

パッケージマネージャーによっては、このファイルを~/.bashrcにて手動で読み込ませる必要があります。

これを調べるには、シェルをリロードしてからtype _init_completionを実行してください。

コマンドが成功していればすでに設定済みです。そうでなければ、~/.bashrcファイルに以下を追記してください:

source /usr/share/bash-completion/bash_completion

シェルをリロードし、type _init_completionを実行してbash-completionが正しくインストールされていることを検証してください。

次に、kubectl補完スクリプトがすべてのシェルセッションで読み込まれるように設定する必要があります。 これを行うには2つの方法があります:

echo 'source <(kubectl completion bash)' >>~/.bashrc

kubectl completion bash | sudo tee /etc/bash_completion.d/kubectl > /dev/null

sudo chmod a+r /etc/bash_completion.d/kubectl

kubectlにエイリアスを張っている場合は、エイリアスでも動作するようにシェルの補完を拡張することができます:

echo 'alias k=kubectl' >>~/.bashrc

echo 'complete -o default -F __start_kubectl k' >>~/.bashrc

/etc/bash_completion.d内のすべての補完スクリプトを読み込みます。どちらも同様の手法です。 シェルをリロードしたあとに、kubectlの自動補完が機能するはずです。 シェルの現在のセッションでbashの自動補完を有効にするには、~/.bashrcを読み込みます:

source ~/.bashrc

Fishにおけるkubectlの補完スクリプトはkubectl completion fishコマンドで生成できます。

補完スクリプトをシェル内に読み込ませることでkubectlの自動補完が有効になります。

すべてのシェルセッションで使用するには、~/.config/fish/config.fishに以下を追記してください:

kubectl completion fish | source

シェルをリロードしたあとに、kubectlの自動補完が機能するはずです。

Zshにおけるkubectlの補完スクリプトはkubectl completion zshコマンドで生成できます。

補完スクリプトをシェル内に読み込ませることでkubectlの自動補完が有効になります。

すべてのシェルセッションで使用するには、~/.zshrcに以下を追記してください:

source <(kubectl completion zsh)

kubectlにエイリアスを張っている場合でも、kubectlの自動補完は自動的に機能します。

シェルをリロードしたあとに、kubectlの自動補完が機能するはずです。

2: command not found: compdefのようなエラーが出力された場合は、以下を~/.zshrcの先頭に追記してください:

autoload -Uz compinit

compinit

詳細については、kubercを参照してください。

kubectl convertプラグインをインストールする異なるAPIバージョン間でマニフェストを変換できる、Kubernetesコマンドラインツールkubectlのプラグインです。

これは特に、新しいKubernetesのリリースで、非推奨ではないAPIバージョンにマニフェストを移行する場合に役に立ちます。

詳細については非推奨ではないAPIへの移行を参照してください。

次のコマンドを使用して最新リリースをダウンロードしてください:

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/linux/amd64/kubectl-convert"

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/linux/arm64/kubectl-convert"

バイナリを検証してください(オプション)

kubectl-convertのチェックサムファイルをダウンロードします:

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/linux/amd64/kubectl-convert.sha256"

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/linux/arm64/kubectl-convert.sha256"

チェックサムファイルに対してkubectl-convertバイナリを検証します:

echo "$(cat kubectl-convert.sha256) kubectl-convert" | sha256sum --check

正しければ、出力は次のようになります:

kubectl-convert: OK

チェックに失敗すると、sha256は0以外のステータスで終了し、次のような出力を表示します:

kubectl-convert: FAILED

sha256sum: WARNING: 1 computed checksum did NOT match

kubectl-convertをインストールしてください

sudo install -o root -g root -m 0755 kubectl-convert /usr/local/bin/kubectl-convert

プラグインが正常にインストールできたことを確認してください

kubectl convert --help

何もエラーが表示されない場合は、プラグインが正常にインストールされたことを示しています。

プラグインのインストール後、インストールファイルを削除してください:

rm kubectl-convert kubectl-convert.sha256

kubectlのバージョンは、クラスターのマイナーバージョンとの差分が1つ以内でなければなりません。 たとえば、クライアントがv1.36であれば、v1.35、v1.36、v1.37のコントロールプレーンと通信できます。 最新の互換性のあるバージョンのkubectlを使うことで、不測の事態を避けることができるでしょう。

macOSへkubectlをインストールするには、次の方法があります:

最新リリースをダウンロードしてください:

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/darwin/amd64/kubectl"

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/darwin/arm64/kubectl"

特定のバージョンをダウンロードする場合、コマンドの$(curl -L -s https://dl.k8s.io/release/stable.txt)の部分を特定のバージョンに置き換えてください。

例えば、Intel macOSへ1.36.0のバージョンをダウンロードするには、次のコマンドを入力します:

curl -LO "https://dl.k8s.io/release/v1.36.0/bin/darwin/amd64/kubectl"

Appleシリコン上のmacOSに対しては、次を入力します:

curl -LO "https://dl.k8s.io/release/v1.36.0/bin/darwin/arm64/kubectl"

バイナリを検証してください(オプション)

kubectlのチェックサムファイルをダウンロードします:

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/darwin/amd64/kubectl.sha256"

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/darwin/arm64/kubectl.sha256"

チェックサムファイルに対してkubectlバイナリを検証します:

echo "$(cat kubectl.sha256) kubectl" | shasum -a 256 --check

正しければ、出力は次のようになります:

kubectl: OK

チェックに失敗すると、shasumは0以外のステータスで終了し、次のような出力を表示します:

kubectl: FAILED

shasum: WARNING: 1 computed checksum did NOT match

kubectlバイナリを実行可能にしてください。

chmod +x ./kubectl

kubectlバイナリをPATHの中に移動させてください。

sudo mv ./kubectl /usr/local/bin/kubectl

sudo chown root: /usr/local/bin/kubectl

/usr/local/binがPATH環境変数の中に含まれるようにしてください。インストールしたバージョンが最新であることを確認してください:

kubectl version --client

または、バージョンの詳細を表示するために次を使用します:

kubectl version --client --output=yaml

kubectlをインストールし、検証した後は、チェックサムファイルを削除してください:

rm kubectl.sha256

macOSでHomebrewパッケージマネージャーを使用していれば、Homebrewでkubectlをインストールできます。

インストールコマンドを実行してください:

brew install kubectl

または

brew install kubernetes-cli

インストールしたバージョンが最新であることを確認してください:

kubectl version --client

macOSでMacPortsパッケージマネージャーを使用していれば、MacPortsでkubectlをインストールできます。

インストールコマンドを実行してください:

sudo port selfupdate

sudo port install kubectl

インストールしたバージョンが最新であることを確認してください:

kubectl version --client

kubectlがKubernetesクラスターを探索し接続するために、kubeconfigファイルが必要です。

これは、kube-up.shによりクラスターを作成した際や、Minikubeクラスターを正常にデプロイした際に自動生成されます。

デフォルトでは、kubectlの設定は~/.kube/configに格納されています。

クラスターの状態を取得し、kubectlが適切に設定されていることを確認してください:

kubectl cluster-info

URLのレスポンスが表示されている場合は、kubectlはクラスターに接続するよう正しく設定されています。

以下のようなメッセージが表示されている場合は、kubectlは正しく設定されていないか、Kubernetesクラスターに接続できていません。

The connection to the server <server-name:port> was refused - did you specify the right host or port?

たとえば、ラップトップ上(ローカル環境)でKubernetesクラスターを起動するような場合、Minikubeなどのツールを最初にインストールしてから、上記のコマンドを再実行する必要があります。

kubectl cluster-infoがURLレスポンスを返したにもかかわらずクラスターにアクセスできない場合は、次のコマンドで設定が正しいことを確認してください:

kubectl cluster-info dump

Kubernetes 1.26にて、kubectlは以下のクラウドプロバイダーが提供するマネージドKubernetesのビルトイン認証を削除しました。 これらのプロバイダーは、クラウド固有の認証を提供するkubectlプラグインをリリースしています。 手順については以下のプロバイダーのドキュメントを参照してください:

(この変更とは関係なく、他の理由で同じエラーメッセージが表示される可能性もあります。)

kubectlはBash、Zsh、Fish、PowerShellの自動補完を提供しています。 これにより、入力を大幅に削減することができます。

以下にBash、Fish、Zshの自動補完の設定手順を示します。

Bashにおけるkubectlの補完スクリプトはkubectl completion bashコマンドで生成できます。

補完スクリプトをシェル内に読み込ませることでkubectlの自動補完が有効になります。

ただし、補完スクリプトはbash-completionに依存しているため、事前にインストールしておく必要があります。

ここではBash 4.1以降の使用を前提としています。 Bashのバージョンは下記のコマンドで調べることができます:

echo $BASH_VERSION

バージョンが古い場合、Homebrewを使用してインストールもしくはアップグレードできます:

brew install bash

シェルをリロードし、希望するバージョンを使用していることを確認してください:

echo $BASH_VERSION $SHELL

Homebrewは通常、/usr/local/bin/bashにインストールします。

type _init_completionを実行することで、bash-completionがすでにインストールされていることを確認できます。

ない場合は、Homebrewを使用してインストールすることができます:

brew install bash-completion@2

このコマンドの出力で示されたように、~/.bash_profileに以下を追記してください:

brew_etc="$(brew --prefix)/etc" && [[ -r "${brew_etc}/profile.d/bash_completion.sh" ]] && . "${brew_etc}/profile.d/bash_completion.sh"

シェルをリロードし、type _init_completionを実行してbash-completion v2が正しくインストールされていることを検証してください。

次に、kubectl補完スクリプトがすべてのシェルセッションで読み込まれるように設定する必要があります。 これを行うには複数の方法があります:

補完スクリプトを~/.bash_profile内で読み込ませる:

echo 'source <(kubectl completion bash)' >>~/.bash_profile

補完スクリプトを/usr/local/etc/bash_completion.dディレクトリに追加する:

kubectl completion bash >/usr/local/etc/bash_completion.d/kubectl

kubectlにエイリアスを張っている場合は、エイリアスでも動作するようにシェルの補完を拡張することができます:

echo 'alias k=kubectl' >>~/.bash_profile

echo 'complete -o default -F __start_kubectl k' >>~/.bash_profile

kubectlをHomebrewでインストールした場合(前述の通り)、kubectlの補完スクリプトはすでに/usr/local/etc/bash_completion.d/kubectlに格納されているでしょうか。

この場合、なにも操作する必要はありません。

BASH_COMPLETION_COMPAT_DIRディレクトリ内のすべてのファイルを読み込むため、後者の2つの方法が機能します。どの場合でも、シェルをリロードしたあとに、kubectlの自動補完が機能するはずです。

Fishにおけるkubectlの補完スクリプトはkubectl completion fishコマンドで生成できます。

補完スクリプトをシェル内に読み込ませることでkubectlの自動補完が有効になります。

すべてのシェルセッションで使用するには、~/.config/fish/config.fishに以下を追記してください:

kubectl completion fish | source

シェルをリロードしたあとに、kubectlの自動補完が機能するはずです。

Zshにおけるkubectlの補完スクリプトはkubectl completion zshコマンドで生成できます。

補完スクリプトをシェル内に読み込ませることでkubectlの自動補完が有効になります。

すべてのシェルセッションで使用するには、~/.zshrcに以下を追記してください:

source <(kubectl completion zsh)

kubectlにエイリアスを張っている場合でも、kubectlの自動補完は自動的に機能します。

シェルをリロードしたあとに、kubectlの自動補完が機能するはずです。

2: command not found: compdefのようなエラーが出力された場合は、以下を~/.zshrcの先頭に追記してください:

autoload -Uz compinit

compinit

kubectl convertプラグインをインストールする異なるAPIバージョン間でマニフェストを変換できる、Kubernetesコマンドラインツールkubectlのプラグインです。

これは特に、新しいKubernetesのリリースで、非推奨ではないAPIバージョンにマニフェストを移行する場合に役に立ちます。

詳細については非推奨ではないAPIへの移行を参照してください。

次のコマンドを使用して最新リリースをダウンロードしてください:

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/darwin/amd64/kubectl-convert"

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/darwin/arm64/kubectl-convert"

バイナリを検証してください(オプション)

kubectl-convertのチェックサムファイルをダウンロードします:

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/darwin/amd64/kubectl-convert.sha256"

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/darwin/arm64/kubectl-convert.sha256"

チェックサムファイルに対してkubectl-convertバイナリを検証します:

echo "$(cat kubectl-convert.sha256) kubectl-convert" | shasum -a 256 --check

正しければ、出力は次のようになります:

kubectl-convert: OK

チェックに失敗すると、shasumは0以外のステータスで終了し、次のような出力を表示します:

kubectl-convert: FAILED

shasum: WARNING: 1 computed checksum did NOT match

kubectl-convertバイナリを実行可能にしてください。

chmod +x ./kubectl-convert

kubectl-convertバイナリをPATHの中に移動してください。

sudo mv ./kubectl-convert /usr/local/bin/kubectl-convert

sudo chown root: /usr/local/bin/kubectl-convert

/usr/local/binがPATH環境変数の中に含まれるようにしてください。インストールしたバージョンが最新であることを確認してください

kubectl convert --help

何もエラーが表示されない場合は、プラグインが正常にインストールされたことを示しています。

プラグインのインストール後、インストールファイルを削除してください:

rm kubectl-convert kubectl-convert.sha256

kubectlのインストール方法に応じて、次の方法を使用してください。

システム上のkubectlバイナリの場所を特定してください:

which kubectl

kubectlバイナリを削除してください:

sudo rm <path>

<path>を前のステップのkubectlバイナリのパスに置き換えてください。

例えばsudo rm /usr/local/bin/kubectl。

Homebrewを使用してkubectlをインストールした場合は、次のコマンドを実行してください:

brew remove kubectl

kubectlのバージョンは、クラスターのマイナーバージョンとの差分が1つ以内でなければなりません。 たとえば、クライアントがv1.36であれば、v1.35、v1.36、v1.37のコントロールプレーンと通信できます。 最新の互換性のあるバージョンのkubectlを使うことで、不測の事態を避けることができるでしょう。

Windowsへkubectlをインストールするには、次の方法があります:

最新の1.36のパッチリリースをダウンロードしてください: kubectl 1.36.0。

または、curlがインストールされていれば、次のコマンドも使用できます:

curl.exe -LO "https://dl.k8s.io/release/v1.36.0/bin/windows/amd64/kubectl.exe"

バイナリを検証してください(オプション)

kubectlのチェックサムファイルをダウンロードします:

curl.exe -LO "https://dl.k8s.io/v1.36.0/bin/windows/amd64/kubectl.exe.sha256"

チェックサムファイルに対してkubectlバイナリを検証します:

コマンドプロンプトを使用して、CertUtilの出力とダウンロードしたチェックサムファイルを手動で比較します:

CertUtil -hashfile kubectl.exe SHA256

type kubectl.exe.sha256

PowerShellにて-eqオペレーターを使用して自動で検証を行い、TrueまたはFalseで結果を取得します:

$(Get-FileHash -Algorithm SHA256 .\kubectl.exe).Hash -eq $(Get-Content .\kubectl.exe.sha256)

kubectlバイナリのフォルダーをPATH環境変数に追加します。

kubectlのバージョンがダウンロードしたものと同じであることを確認してください:

kubectl version --client

または、バージョンの詳細を表示するために次を使用します:

kubectl version --client --output=yaml

kubectlをPATHに追加します。

Docker Desktopをすでにインストールしている場合、Docker Desktopインストーラーによって追加されたPATHの前に追加するか、Docker Desktopのkubectlを削除してください。Windowsへkubectlをインストールするために、ChocolateyパッケージマネージャーやScoopコマンドラインインストーラー、wingetパッケージマネージャーを使用することもできます。

choco install kubernetes-cli

scoop install kubectl

winget install -e --id Kubernetes.kubectl

インストールしたバージョンが最新であることを確認してください:

kubectl version --client

ホームディレクトリへ移動してください:

# cmd.exeを使用している場合はcd %USERPROFILE%を実行してください。

cd ~

.kubeディレクトリを作成してください:

mkdir .kube

作成した.kubeディレクトリへ移動してください:

cd .kube

リモートのKubernetesクラスターを使うために、kubectlを設定してください:

New-Item config -type file

kubectlがKubernetesクラスターを探索し接続するために、kubeconfigファイルが必要です。

これは、kube-up.shによりクラスターを作成した際や、Minikubeクラスターを正常にデプロイした際に自動生成されます。

デフォルトでは、kubectlの設定は~/.kube/configに格納されています。

クラスターの状態を取得し、kubectlが適切に設定されていることを確認してください:

kubectl cluster-info

URLのレスポンスが表示されている場合は、kubectlはクラスターに接続するよう正しく設定されています。

以下のようなメッセージが表示されている場合は、kubectlは正しく設定されていないか、Kubernetesクラスターに接続できていません。

The connection to the server <server-name:port> was refused - did you specify the right host or port?

たとえば、ラップトップ上(ローカル環境)でKubernetesクラスターを起動するような場合、Minikubeなどのツールを最初にインストールしてから、上記のコマンドを再実行する必要があります。

kubectl cluster-infoがURLレスポンスを返したにもかかわらずクラスターにアクセスできない場合は、次のコマンドで設定が正しいことを確認してください:

kubectl cluster-info dump

Kubernetes 1.26にて、kubectlは以下のクラウドプロバイダーが提供するマネージドKubernetesのビルトイン認証を削除しました。 これらのプロバイダーは、クラウド固有の認証を提供するkubectlプラグインをリリースしています。 手順については以下のプロバイダーのドキュメントを参照してください:

(この変更とは関係なく、他の理由で同じエラーメッセージが表示される可能性もあります。)

kubectlはBash、Zsh、Fish、PowerShellの自動補完を提供しています。 これにより、入力を大幅に削減することができます。

以下にPowerShellの自動補完の設定手順を示します。

PowerShellにおけるkubectlの補完スクリプトはkubectl completion powershellコマンドで生成できます。

すべてのシェルセッションでこれを行うには、次の行を$PROFILEファイルに追加します。

kubectl completion powershell | Out-String | Invoke-Expression

このコマンドは、PowerShellを起動する度に自動補完のスクリプトを再生成します。

生成されたスクリプトを直接$PROFILEファイルに追加することもできます。

生成されたスクリプトを$PROFILEファイルに追加するためには、PowerShellのプロンプトで次の行を実行します:

kubectl completion powershell >> $PROFILE

シェルをリロードした後、kubectlの自動補完が機能します。

kubectl convertプラグインをインストールする異なるAPIバージョン間でマニフェストを変換できる、Kubernetesコマンドラインツールkubectlのプラグインです。

これは特に、新しいKubernetesのリリースで、非推奨ではないAPIバージョンにマニフェストを移行する場合に役に立ちます。

詳細については非推奨ではないAPIへの移行を参照してください。

次のコマンドを使用して最新リリースをダウンロードしてください:

curl.exe -LO "https://dl.k8s.io/release/v1.36.0/bin/windows/amd64/kubectl-convert.exe"

バイナリを検証してください(オプション)。

kubectl-convertのチェックサムファイルをダウンロードします:

curl.exe -LO "https://dl.k8s.io/v1.36.0/bin/windows/amd64/kubectl-convert.exe.sha256"

チェックサムファイルに対してkubectl-convertバイナリを検証します:

コマンドプロンプトを使用して、CertUtilの出力とダウンロードしたチェックサムファイルを手動で比較します:

CertUtil -hashfile kubectl-convert.exe SHA256

type kubectl-convert.exe.sha256

PowerShellにて-eqオペレーターを使用して自動で検証を行い、TrueまたはFalseで結果を取得します:

$($(CertUtil -hashfile .\kubectl-convert.exe SHA256)[1] -replace " ", "") -eq $(type .\kubectl-convert.exe.sha256)

kubectl-convertバイナリのフォルダーをPATH環境変数に追加します。

プラグインが正常にインストールされたことを確認してください。

kubectl convert --help

何もエラーが表示されない場合は、プラグインが正常にインストールされたことを示しています。

プラグインのインストール後、インストールファイルを削除してください:

del kubectl-convert.exe

del kubectl-convert.exe.sha256

このページでは、kubeadmクラスターにLinuxワーカーノードを追加する方法を示します。

kubeadm initで構築され、kubeadmを使用したクラスターの作成ドキュメントの手順に従った稼働中のkubeadmクラスターが存在すること。新たなLinuxワーカーノードをクラスターに追加するために、以下を各マシンに対して実行してください。

kubeadm init実行時に出力されたコマンドを実行します。例:sudo kubeadm join --token <token> <control-plane-host>:<control-plane-port> --discovery-token-ca-cert-hash sha256:<hash>

<control-plane-host>:<control-plane-port>にIPv6タプルを指定するには、IPv6アドレスを角括弧で囲みます。

例: [2001:db8::101]:2073トークンが不明な場合は、コントロールプレーンノードで次のコマンドを実行すると取得できます。

# コントロールプレーンノード上で実行してください。

sudo kubeadm token list

出力は次のようになります。

TOKEN TTL EXPIRES USAGES DESCRIPTION EXTRA GROUPS

8ewj1p.9r9hcjoqgajrj4gi 23h 2018-06-12T02:51:28Z authentication, The default bootstrap system:

signing token generated by bootstrappers:

'kubeadm init'. kubeadm:

default-node-token

デフォルトでは、トークンは24時間後に有効期限が切れます。 現在のトークンの有効期限が切れた後にクラスターにノードを参加させたい場合は、コントロールプレーンノード上で次のコマンドを実行することで、新しいトークンを生成できます。

# コントロールプレーンノード上で実行してください。

sudo kubeadm token create

このコマンドの出力は次のようになります。

5didvk.d09sbcov8ph2amjw

新たなトークンを生成しながらkubeadm joinコマンドを出力するには、次のコマンドを使用します。

sudo kubeadm token create --print-join-command

--discovery-token-ca-cert-hashの値が不明な場合は、コントロールプレーンノード上で次のコマンドを実行することで取得できます。

# コントロールプレーンノード上で実行してください。

sudo cat /etc/kubernetes/pki/ca.crt | openssl x509 -pubkey | openssl rsa -pubin -outform der 2>/dev/null | \

openssl dgst -sha256 -hex | sed 's/^.* //'

出力は次のようになります。

8cb2de97839780a412b93877f8507ad6c94f73add17d5d7058e91741c9d5ec78

kubeadm joinコマンドによって以下のように出力されるはずです。

[preflight] Running pre-flight checks

... (log output of join workflow) ...

Node join complete:

* Certificate signing request sent to control-plane and response

received.

* Kubelet informed of new secure connection details.

Run 'kubectl get nodes' on control-plane to see this machine join.

数秒後、kubectl get nodesを実行すると、出力内にこのノードが表示されるはずです(kubectlコマンドは、コントロールプレーンノード等で実行してください)。

kubectl -n kube-system rollout restart deployment corednsコマンドを実行してCoreDNSのPodを再配置してください。このページでは、kubeadmクラスターのコンテナランタイムcgroupドライバーに合わせて、kubelet cgroupドライバーを設定する方法について説明します。

Kubernetesのコンテナランタイムの要件を熟知している必要があります。

コンテナランタイムページでは、kubeadmベースのセットアップではcgroupfsドライバーではなく、systemdドライバーが推奨されると説明されています。

このページでは、デフォルトのsystemdドライバーを使用して多くの異なるコンテナランタイムをセットアップする方法についての詳細も説明されています。

kubeadmでは、kubeadm initの際にKubeletConfiguration構造体を渡すことができます。

このKubeletConfigurationには、kubeletのcgroupドライバーを制御するcgroupDriverフィールドを含めることができます。

KubeletConfigurationのcgroupDriverフィールドを設定していない場合、kubeadmはデフォルトでsystemdを設定するようになりました。フィールドを明示的に設定する最小限の例です:

# kubeadm-config.yaml

kind: ClusterConfiguration

apiVersion: kubeadm.k8s.io/v1beta3

kubernetesVersion: v1.21.0

---

kind: KubeletConfiguration

apiVersion: kubelet.config.k8s.io/v1beta1

cgroupDriver: systemd

このような設定ファイルは、kubeadmコマンドに渡すことができます:

kubeadm init --config kubeadm-config.yaml

Kubeadmはクラスター内の全ノードで同じKubeletConfigurationを使用します。

KubeletConfigurationはkube-system名前空間下のConfigMapオブジェクトに格納されます。

サブコマンドinit、join、upgradeを実行すると、kubeadmがKubeletConfigurationを/var/lib/kubelet/config.yaml以下にファイルとして書き込み、ローカルノードのkubeletに渡します。

このガイドで説明するように、cgroupfsドライバーをkubeadmと一緒に使用することは推奨されません。

cgroupfsを使い続け、kubeadm upgradeが既存のセットアップでKubeletConfiguration cgroupドライバーを変更しないようにするには、その値を明示的に指定する必要があります。

これは、将来のバージョンのkubeadmにsystemdドライバーをデフォルトで適用させたくない場合に適用されます。

値を明示する方法については、後述の「kubelet ConfigMapの修正」の項を参照してください。

cgroupfsドライバーを使用するようにコンテナランタイムを設定したい場合は、選択したコンテナランタイムのドキュメントを参照する必要があります。

systemdドライバーへの移行既存のkubeadmクラスターのcgroupドライバーをsystemdにインプレースで変更する場合は、kubeletのアップグレードと同様の手順が必要です。

これには、以下に示す両方の手順を含める必要があります。

systemdドライバーを使用する新しいノードに置き換えることも可能です。

この場合、新しいノードに参加する前に以下の最初のステップのみを実行し、古いノードを削除する前にワークロードが新しいノードに安全に移動できることを確認する必要があります。kubectl get cm -n kube-system | grep kubelet-configで、kubelet ConfigMapの名前を探します。kubectl edit cm kubelet-config-x.yy -n kube-systemを呼び出します(x.yyはKubernetesのバージョンに置き換えてください)。cgroupDriverの値を修正するか、以下のような新しいフィールドを追加します。 cgroupDriver: systemd

このフィールドは、ConfigMapのkubelet:セクションの下に存在する必要があります。

クラスター内の各ノードについて:

kubectl drain <node-name> --ignore-daemonsetsを使ってドレーンします。systemctl stop kubeletを使用して、kubeletを停止します。systemdに変更します。var/lib/kubelet/config.yamlにcgroupDriver: systemdを設定します。systemctl start kubeletでkubeletを起動します。kubectl uncordon <node-name>を使って行います。ワークロードが異なるノードでスケジュールするための十分な時間を確保するために、これらのステップを1つずつノード上で実行します。 プロセスが完了したら、すべてのノードとワークロードが健全であることを確認します。

Kubernetes v1.18 [beta]Kubernetesを使用してLinuxノードとWindowsノードを混在させて実行できるため、Linuxで実行するPodとWindowsで実行するPodを混在させることができます。このページでは、Windowsノードをクラスターに登録する方法を示します。

バージョンを確認するには次のコマンドを実行してください: kubectl version.

WindowsコンテナをホストするWindowsノードを構成するには、Windows Server 2019ライセンス(またはそれ以上)を取得します。 VXLAN/オーバーレイネットワークを使用している場合は、KB4489899もインストールされている必要があります。

コントロールプレーンにアクセスできるLinuxベースのKubernetes kubeadmクラスター(kubeadmを使用したシングルコントロールプレーンクラスターの作成を参照)

LinuxベースのKubernetesコントロールプレーンノードを取得したら、ネットワーキングソリューションを選択できます。このガイドでは、簡単にするためにVXLANモードでのFlannelの使用について説明します。

FlannelのためにKubernetesコントロールプレーンを準備する

クラスター内のKubernetesコントロールプレーンでは、多少の準備が推奨されます。Flannelを使用する場合は、iptablesチェーンへのブリッジIPv4トラフィックを有効にすることをお勧めします。すべてのLinuxノードで次のコマンドを実行する必要があります:

sudo sysctl net.bridge.bridge-nf-call-iptables=1

Linux用のFlannelをダウンロードして構成する

最新のFlannelマニフェストをダウンロード:

wget https://raw.githubusercontent.com/coreos/flannel/master/Documentation/kube-flannel.yml

VNIを4096、ポートを4789に設定するために、flannelマニフェストのnet-conf.jsonセクションを変更します。次のようになります:

net-conf.json: |

{

"Network": "10.244.0.0/16",

"Backend": {

"Type": "vxlan",

"VNI" : 4096,

"Port": 4789

}

}

Typeの値を"host-gw"に変更し、VNIとPortを省略します。Flannelマニフェストを適用して検証する

Flannelの構成を適用しましょう:

kubectl apply -f kube-flannel.yml

数分後、Flannel Podネットワークがデプロイされていれば、すべてのPodが実行されていることがわかります。

kubectl get pods -n kube-system

出力結果には、実行中のLinux flannel DaemonSetが含まれているはずです:

NAMESPACE NAME READY STATUS RESTARTS AGE

...

kube-system kube-flannel-ds-54954 1/1 Running 0 1m

Windows Flannelとkube-proxy DaemonSetを追加する

これで、Windows互換バージョンのFlannelおよびkube-proxyを追加できます。 互換性のあるバージョンのkube-proxyを確実に入手するには、イメージのタグを置換する必要があります。 次の例は、Kubernetes 1.36.0の使用方法を示していますが、 独自のデプロイに合わせてバージョンを調整する必要があります。

curl -L https://github.com/kubernetes-sigs/sig-windows-tools/releases/latest/download/kube-proxy.yml | sed 's/VERSION/v1.36.0/g' | kubectl apply -f -

kubectl apply -f https://github.com/kubernetes-sigs/sig-windows-tools/releases/latest/download/flannel-overlay.yml

ホストゲートウェイを使用している場合は、代わりに https://github.com/kubernetes-sigs/sig-windows-tools/releases/latest/download/flannel-host-gw.yml を使用してください。

Windowsノードでイーサネット(「Ethernet0 2」など)ではなく別のインターフェースを使用している場合は、次の行を変更する必要があります:

wins cli process run --path /k/flannel/setup.exe --args "--mode=overlay --interface=Ethernet"

flannel-host-gw.ymlまたはflannel-overlay.ymlファイルで、それに応じてインターフェースを指定します。

# 例

curl -L https://github.com/kubernetes-sigs/sig-windows-tools/releases/latest/download/flannel-overlay.yml | sed 's/Ethernet/Ethernet0 2/g' | kubectl apply -f -

Containers機能をインストールし、Dockerをインストールする必要があります。

行うための指示としては、Dockerエンジンのインストール - Windowsサーバー上のエンタープライズを利用できます。wins、kubelet、kubeadmをインストールします。

curl.exe -LO https://raw.githubusercontent.com/kubernetes-sigs/sig-windows-tools/master/kubeadm/scripts/PrepareNode.ps1

.\PrepareNode.ps1 -KubernetesVersion v1.36.0

kubeadmを実行してノードに参加します

コントロールプレーンホストでkubeadm initを実行したときに提供されたコマンドを使用します。

このコマンドがなくなった場合、またはトークンの有効期限が切れている場合は、kubeadm token create --print-join-command

(コントロールプレーンホスト上で)を実行して新しいトークンを生成します。

次のコマンドを実行して、クラスター内のWindowsノードを表示できるようになります:

kubectl get nodes -o wide

新しいノードがNotReady状態の場合は、flannelイメージがまだダウンロード中の可能性があります。

kube-system名前空間のflannel Podを確認することで、以前と同様に進行状況を確認できます:

kubectl -n kube-system get pods -l app=flannel

flannel Podが実行されると、ノードはReady状態になり、ワークロードを処理できるようになります。

このページでは、kubeadmで構築したLinuxワーカーノードのアップグレード方法を示します。

全てのノードへのシェルアクセスが可能であり、kubectlコマンドラインツールがクラスターと通信できるように設定されている必要があります。 このチュートリアルでは、コントロールプレーンのホストではないノードが少なくとも2つ存在するクラスターで実行することを推奨します。

バージョンを確認するには次のコマンドを実行してください: kubectl version.

コミュニティ所有のパッケージリポジトリ(pkgs.k8s.io)を使用している場合、必要なKubernetesのマイナーリリースのパッケージリポジトリを有効化する必要があります。

これは、Kubernetesパッケージリポジトリの変更ドキュメントにて説明されています。

apt.kubernetes.ioおよびyum.kubernetes.io)は2023年9月13日以降、非推奨となり凍結されています。

pkgs.k8s.ioにてホストされている新しいリポジトリの使用が強く推奨されており、2023年9月13日以降にリリースされたKubernetesのバージョンをインストールするには必須となっています。

非推奨の古いリポジトリとその内容は、将来事前予告なく削除される可能性があります。

新しいパッケージリポジトリでは、v1.24.0以降のKubernetesバージョンのダウンロードを提供しています。kubeadmをアップグレードします。

#「1.36.x-*」の「x」は最新のパッチバージョンに置き換えてください。

sudo apt-mark unhold kubeadm && \

sudo apt-get update && sudo apt-get install -y kubeadm='1.36.x-*' && \

sudo apt-mark hold kubeadm

DNFを搭載したシステムの場合:

#「1.36.x-*」の「x」は最新のパッチバージョンに置き換えてください。

sudo yum install -y kubeadm-'1.36.x-*' --disableexcludes=kubernetes

DNF5を搭載したシステムの場合:

#「1.36.x-*」の「x」は最新のパッチバージョンに置き換えてください。

sudo yum install -y kubeadm-'1.36.x-*' --setopt=disable_excludes=kubernetes

ワーカーノードは、以下のコマンドによってローカルのkubeletの設定がアップグレードされます。

sudo kubeadm upgrade node

ノードをスケジュール不可としてマークし、ワークロードを退去させることで、ノードのメンテナンスの準備をします。

# このコマンドはコントロールプレーンノードで実行してください。

# <node-to-drain>は、ドレインするノード名に置き換えてください。

kubectl drain <node-to-drain> --ignore-daemonsets

kubeletとkubectlをアップグレードします。

#「1.36.x-*」の「x」は最新のパッチバージョンに置き換えてください。

sudo apt-mark unhold kubelet kubectl && \

sudo apt-get update && sudo apt-get install -y kubelet='1.36.x-*' kubectl='1.36.x-*' && \

sudo apt-mark hold kubelet kubectl

DNFを搭載したシステムの場合:

#「1.36.x-*」の「x」は最新のパッチバージョンに置き換えてください。

sudo yum install -y kubelet-'1.36.x-*' kubectl-'1.36.x-*' --disableexcludes=kubernetes

DNF5を搭載したシステムの場合:

#「1.36.x-*」の「x」は最新のパッチバージョンに置き換えてください。

sudo yum install -y kubelet-'1.36.x-*' kubectl-'1.36.x-*' --setopt=disable_excludes=kubernetes

kubeletを再起動します。

sudo systemctl daemon-reload

sudo systemctl restart kubelet

ノードをスケジュール可能としてマークすることで、ノードをオンラインに戻します。

# このコマンドはコントロールプレーンノードで実行してください。

# <node-to-uncordon>は対象のノード名に置き換えてください。

kubectl uncordon <node-to-uncordon>

Kubernetes v1.18 [beta]このページでは、kubeadmで作られたWindowsノードをアップグレードする方法について説明します。

Kubernetesクラスターが必要、かつそのクラスターと通信するためにkubectlコマンドラインツールが設定されている必要があります。 このチュートリアルは、コントロールプレーンのホストとして動作していない少なくとも2つのノードを持つクラスターで実行することをおすすめします。 まだクラスターがない場合、minikubeを使って作成するか、 以下のいずれかのKubernetesプレイグラウンドも使用できます:

作業するKubernetesサーバーは次のバージョン以降のものである必要があります: 1.17.バージョンを確認するには次のコマンドを実行してください: kubectl version.

Windowsノードから、kubeadmをアップグレードします。:

# 1.36.0を目的のバージョンに置き換えます

curl.exe -Lo C:\k\kubeadm.exe https://dl.k8s.io/v1.36.0/bin/windows/amd64/kubeadm.exe

Kubernetes APIにアクセスできるマシンから、 ノードをスケジュール不可としてマークして、ワークロードを削除することでノードのメンテナンスを準備します:

# <node-to-drain>をドレインするノードの名前に置き換えます

kubectl drain <node-to-drain> --ignore-daemonsets

このような出力結果が表示されるはずです:

node/ip-172-31-85-18 cordoned

node/ip-172-31-85-18 drained

Windowsノードから、次のコマンドを呼び出して新しいkubelet構成を同期します:

kubeadm upgrade node

Windowsノードから、kubeletをアップグレードして再起動します:

stop-service kubelet

curl.exe -Lo C:\k\kubelet.exe https://dl.k8s.io/v1.36.0/bin/windows/amd64/kubelet.exe

restart-service kubelet

Kubernetes APIにアクセスできるマシンから、 スケジュール可能としてマークして、ノードをオンラインに戻します:

# <node-to-drain>をノードの名前に置き換えます

kubectl uncordon <node-to-drain>

Kubernetes APIにアクセスできるマシンから、次を実行します、 もう一度1.36.0を目的のバージョンに置き換えます:

curl -L https://github.com/kubernetes-sigs/sig-windows-tools/releases/latest/download/kube-proxy.yml | sed 's/VERSION/v1.36.0/g' | kubectl apply -f -

Kubernetes v1.15 [stable]kubeadmで生成されたクライアント証明書は1年で失効します。 このページでは、kubeadmで証明書の更新を管理する方法について説明します。 また、kubeadmによる証明書管理に関連するタスクも説明します。

Kubernetesプロジェクトでは、最新のパッチリリースに速やかにアップグレードし、サポートされているKubernetesのマイナーリリースを実行していることを推奨しています。 この推奨事項に従うことで、セキュリティを維持できます。

KubernetesにおけるPKI証明書と要件を熟知している必要があります。

kubeadmコマンドに対して、kubeadmの設定ファイルを渡す方法について熟知している必要があります。

本ページではopensslコマンド(手動で証明書に署名する場合に使用)の使用方法について説明しますが、他のツールで代用することもできます。

ここで紹介する手順の一部では、管理者アクセスにsudoを使用していますが、同等のツールを使用しても構いません。

デフォルトでは、kubeadmはクラスターの実行に必要なすべての証明書を生成します。 独自の証明書を提供することで、この動作をオーバーライドできます。

そのためには、--cert-dirフラグまたはkubeadmのClusterConfigurationのcertificatesDirフィールドで指定された任意のディレクトリに配置する必要があります。

デフォルトは/etc/kubernetes/pkiです。

kubeadm initを実行する前に既存の証明書と秘密鍵のペアが存在する場合、kubeadmはそれらを上書きしません。

つまり、例えば既存のCAを/etc/kubernetes/pki/ca.crtと/etc/kubernetes/pki/ca.keyにコピーすれば、kubeadmは残りの証明書に署名する際、このCAを使用できます。

kubeadmでは、公開鍵や秘密鍵を作成する際に暗号化アルゴリズムを選択できます。

設定するには、kubeadmの設定ファイルにてencryptionAlgorithmフィールドを使用します。

apiVersion: kubeadm.k8s.io/v1beta4

kind: ClusterConfiguration

encryptionAlgorithm: <ALGORITHM>

<ALGORITHM>は、RSA-2048(デフォルト)、RSA-3072、RSA-4096、ECDSA-P256が選択できます。

kubeadmでは、CAおよびリーフ証明書の有効期間を選択可能です。

設定するには、kubeadmの設定ファイルにて、certificateValidityPeriod、caCertificateValidityPeriodフィールドを使用します。

apiVersion: kubeadm.k8s.io/v1beta4

kind: ClusterConfiguration

certificateValidityPeriod: 8760h # デフォルト: 365日 × 24時間 = 1年

caCertificateValidityPeriod: 87600h # デフォルト: 365日 × 24時間 * 10 = 10年

フィールドの値は、Go言語のtime.Durationの値で許容される形式に準拠しており、サポートされている最長単位はh(時間)です。

また、ca.crtファイルのみを提供し、ca.keyファイルを提供しないことも可能です(これはルートCAファイルのみに有効で、他の証明書ペアには有効ではありません)。

他の証明書とkubeconfigファイルがすべて揃っている場合、kubeadmはこの状態を認識し、「外部CA」モードを有効にします。

kubeadmはディスク上のCAキーがなくても処理を進めます。

代わりに、--controllers=csrsignerを使用してController-managerをスタンドアロンで実行し、CA証明書と鍵を指定します。

外部CAモードを使用する場合、コンポーネントの資格情報を作成する方法がいくつかあります。

PKI証明書とその要件には、kubeadmコンポーネントに必要な全ての資格情報を手動で作成する方法が記載されています。

本ページではopensslコマンド(手動で証明書を署名する場合に使用)の使用方法について説明しますが、他のツールを代用することもできます。

kubeadmは、opensslのようなツールと外部CAを使用して手動で署名可能なCSRファイルの生成ができます。

これらのCSRファイルには、kubeadmによってデプロイされるコンポーネントに必要な資格情報の全ての仕様が含まれます。

もしくは、kubeadm phaseコマンドを使用して、これらのプロセスを自動化することが可能です。

ca.crtとca.keyファイルを、ノードの/etc/kubernetes/pkiへコピーします。kubeadm initで使用する、config.yamlという一時的なkubeadmの設定ファイルを準備します。

このファイルには、ClusterConfiguration.controlPlaneEndpoint、ClusterConfiguration.certSANs、InitConfiguration.APIEndpointなど、証明書に含まれる可能性のある、クラスター全体またはホスト固有の関連情報が全て記載されていることを確認します。kubeadm init phase kubeconfig all --config config.yamlおよびkubeadm init phase certs all --config config.yamlコマンドを実行します。

これにより、必要な全てのkubeconfigファイルと証明書が/etc/kubernetes/配下およびpkiサブディレクトリ配下に作成されます。/etc/kubernetes/pki/ca.keyを削除し、/etc/kubernetes/super-admin.confを削除するか、安全な場所に退避します。kubeadm joinを実行するノードでは、/etc/kubernetes/kubelet.confも削除します。

このファイルはkubeadm initが実行される最初のノードでのみ必要とされます。pki/sa.*、pki/front-proxy-ca.*、pki/etc/ca.*等のファイルは、コントロールプレーンノード間で共有されます。

kubeadm joinを実行するノードに手動で証明書を配布するか、kubeadm initの--upload-certsオプションおよびkubeadm joinの--certificate-keyオプションを使用することでこれらを自動配布します。全てのノードにて資格情報を準備した後、これらのノードをクラスターに参加させるためにkubeadm initおよびkubeadm joinを実行します。

kubeadmは/etc/kubernetes/およびpkiサブディレクトリ配下に存在するkubeconfigと証明書を使用します。

kubeadmは、外部CAによって署名された証明書を管理することができません。check-expirationサブコマンドを使うと、証明書の有効期限を確認することができます。

kubeadm certs check-expiration

このような出力になります:

CERTIFICATE EXPIRES RESIDUAL TIME CERTIFICATE AUTHORITY EXTERNALLY MANAGED

admin.conf Dec 30, 2020 23:36 UTC 364d no

apiserver Dec 30, 2020 23:36 UTC 364d ca no

apiserver-etcd-client Dec 30, 2020 23:36 UTC 364d etcd-ca no

apiserver-kubelet-client Dec 30, 2020 23:36 UTC 364d ca no

controller-manager.conf Dec 30, 2020 23:36 UTC 364d no

etcd-healthcheck-client Dec 30, 2020 23:36 UTC 364d etcd-ca no

etcd-peer Dec 30, 2020 23:36 UTC 364d etcd-ca no

etcd-server Dec 30, 2020 23:36 UTC 364d etcd-ca no

front-proxy-client Dec 30, 2020 23:36 UTC 364d front-proxy-ca no

scheduler.conf Dec 30, 2020 23:36 UTC 364d no

CERTIFICATE AUTHORITY EXPIRES RESIDUAL TIME EXTERNALLY MANAGED

ca Dec 28, 2029 23:36 UTC 9y no

etcd-ca Dec 28, 2029 23:36 UTC 9y no

front-proxy-ca Dec 28, 2029 23:36 UTC 9y no

このコマンドは、/etc/kubernetes/pkiフォルダー内のクライアント証明書と、kubeadmが使用するkubeconfigファイル(admin.conf、controller-manager.conf、scheduler.conf)に埋め込まれたクライアント証明書の有効期限/残余時間を表示します。

また、証明書が外部管理されている場合、kubeadmはユーザーに通知します。この場合、ユーザーは証明書の更新を手動または他のツールを使用して管理する必要があります。

kubeadmは/var/lib/kubelet/pki配下にあるローテーション可能な証明書でkubeletの証明書の自動更新を構成するため、kubelet.confは上記のリストに含まれません。

期限切れのkubeletクライアント証明書を修復するには、kubeletクライアント証明書のローテーションに失敗するを参照ください。

kubeadm version 1.17より前のkubeadm initで作成したノードでは、kubelet.confの内容を手動で変更しなければならないというバグが存在します。

kubeadm initが終了したら、client-certificate-dataとclient-key-dataを置き換えて、ローテーションされたkubeletクライアント証明書を指すようにkubelet.confを更新してください。

client-certificate: /var/lib/kubelet/pki/kubelet-client-current.pem

client-key: /var/lib/kubelet/pki/kubelet-client-current.pem

kubeadmはコントロールプレーンのアップグレード時にすべての証明書を更新します。

この機能は、最もシンプルなユースケースに対応するために設計されています。 証明書の更新に特別な要件がなく、Kubernetesのバージョンアップを定期的に行う場合(各アップグレードの間隔が1年未満)、kubeadmは、クラスターを最新に保ち、適切なセキュリティを確保します。

証明書の更新に関してより複雑な要求がある場合は、--certificate-renewal=falseをkubeadm upgrade applyやkubeadm upgrade nodeに渡して、デフォルトの動作から外れるようにすることができます。

適切なコマンドラインオプションを指定してkubeadm certs renewコマンドを実行すれば、いつでも証明書を手動で更新できます。

複数のコントロールプレーンによってクラスターが稼働している場合、全てのコントロールプレーンノード上でこのコマンドを実行する必要があります。

このコマンドは/etc/kubernetes/pkiに格納されているCA(またはfront-proxy-CA)の証明書と鍵を使用して更新を行います。

kubeadm certs renewは、属性(Common Name、Organization、SANなど)の信頼できるソースとして、kubeadm-config ConfigMapではなく、既存の証明書を使用します。

それでも、Kubernetesプロジェクトでは、混乱のリスクを避けるために証明書とConfigMap内の関連した値を同期したままにしておくことを推奨しています。

コマンド実行後、コントロールプレーンのPodを再起動する必要があります。

これは、現在は動的な証明書のリロードが、すべてのコンポーネントと証明書でサポートされているわけではないため、必要な作業です。

static Podはローカルkubeletによって管理され、APIサーバーによって管理されないため、kubectlで削除および再起動することはできません。

static Podを再起動するには、一時的に/etc/kubernetes/manifests/からマニフェストファイルを削除して20秒間待ちます(KubeletConfiguration構造体のfileCheckFrequency値を参照してください)。

マニフェストディレクトリにてマニフェストファイルが存在しなくなると、kubeletはPodを終了します。

その後ファイルを戻し、さらにfileCheckFrequency期間後に、kubeletはPodを再作成し、コンポーネントの証明書更新を完了することができます。

kubeadm certs renewは、特定の証明書を更新できます。

また、allサブコマンドを用いることで全ての証明書を更新できます。

# 複数のコントロールプレーンによってクラスターが稼働している場合、このコマンドは全てのコントロールプレーン上で実行する必要があります。

kubeadm certs renew all

kubeadmで構築されたクラスターでは、多くの場合、kubeadmを使用したクラスターの作成の指示に従い、admin.conf証明書が$HOME/.kube/configへコピーされます。

このようなシステムでは、admin.confを更新した後に$HOME/.kube/configの内容を更新するため、次のコマンドを実行します。

sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

sudo chown $(id -u):$(id -g) $HOME/.kube/config

ここでは、Kubernetes certificates APIを使用して手動で証明書更新を実行する方法について詳しく説明します。

Kubernetesの認証局は、そのままでは機能しません。 cert-managerなどの外部署名者を設定するか、組み込みの署名者を使用することができます。

ビルトインサイナーはkube-controller-managerに含まれるものです。

ビルトインサイナーを有効にするには、--cluster-signing-cert-fileと--cluster-signing-key-fileフラグを渡す必要があります。

新しいクラスターを作成する場合は、kubeadm設定ファイルを使用します。

apiVersion: kubeadm.k8s.io/v1beta4

kind: ClusterConfiguration

controllerManager:

extraArgs:

- name: "cluster-signing-cert-file"

value: "/etc/kubernetes/pki/ca.crt"

- name: "cluster-signing-key-file"

value: "/etc/kubernetes/pki/ca.key"

Kubernetes APIでのCSR作成については、CertificateSigningRequestの作成を参照ください。

ここでは、外部認証局を利用して手動で証明書更新を行う方法について詳しく説明します。

外部CAとの連携を強化するために、kubeadmは証明書署名要求(CSR)を生成することもできます。 CSRとは、クライアント用の署名付き証明書をCAに要求することを表します。 kubeadmでは、通常ディスク上のCAによって署名される証明書をCSRとして生成することができます。しかし、CAはCSRとして生成することはできません。

証明書の更新は、新たなCSRを作成し外部CAで署名することで実施できます。 kubeadmによって生成されたCSRの署名についての詳細は、kubeadmによって生成された証明書署名要求(CSR)の署名セクションを参照してください。

kubeadmは、CA証明書のローテーションや置換を標準ではサポートしていません。

CAの手動ローテーションや置換についての詳細は、CA証明書の手動ローテーションを参照してください。

デフォルトでは、kubeadmによって展開されるkubeletサーバー証明書は自己署名されています。 これは、metrics-serverのような外部サービスからkubeletへの接続がTLSで保護されないことを意味します。

新しいkubeadmクラスター内のkubeletが適切に署名されたサーバー証明書を取得するように設定するには、kubeadm initに以下の最小限の設定を渡す必要があります。

apiVersion: kubeadm.k8s.io/v1beta4

kind: ClusterConfiguration

---

apiVersion: kubelet.config.k8s.io/v1beta1

kind: KubeletConfiguration

serverTLSBootstrap: true

すでにクラスターを作成している場合は、以下の手順で適応させる必要があります。

kube-system namespace中のkubelet-config ConfigMapを探して編集します。

このConfigMap内には、kubeletキーの値として、KubeletConfigurationに関する記述が存在します。

KubeletConfigurationの内容を編集し、serverTLSBootstrap: trueを設定します。/var/lib/kubelet/config.yamlにserverTLSBootstrap: trueフィールドを追加し、systemctl restart kubeletでkubeletを再起動します。serverTLSBootstrap: trueフィールドは、certificates.k8s.io APIからkubeletのサーバー証明書をリクエストすることで、kubeletサーバー証明書のブートストラップを有効にします。

既知の制限事項の1つとして、これらのCSR(証明書署名要求)はkube-controller-managerのデフォルトの署名者によって自動的に承認されないことが挙げられます。

kubernetes.io/kubelet-servingを参照してください。

これには、ユーザーまたはサードパーティのコントローラーからのアクションが必要です。

これらのCSRは、以下を使用して表示できます:

kubectl get csr

NAME AGE SIGNERNAME REQUESTOR CONDITION

csr-9wvgt 112s kubernetes.io/kubelet-serving system:node:worker-1 Pending

csr-lz97v 1m58s kubernetes.io/kubelet-serving system:node:control-plane-1 Pending

承認するためには、次のようにします:

kubectl certificate approve <CSR-name>

デフォルトでは、これらのサーバー証明書は1年後に失効します。

kubeadmはKubeletConfigurationフィールドのrotateCertificatesをtrueに設定します。

これは有効期限が切れる間際に、サーバー証明書のための新しいCSRセットを作成し、ローテーションを完了するために承認する必要があることを意味します。

詳しくは証明書のローテーションを参照してください。

これらのCSRを自動的に承認するためのソリューションをお探しの場合は、クラウドプロバイダーに連絡し、ノードの識別をアウトオブバンドのメカニズムで行うCSRの署名者がいるかどうか確認することをお勧めします。

サードパーティのカスタムコントローラーを使用することができます。

このようなコントローラーは、CSRのCommonNameを検証するだけでなく、要求されたIPやドメイン名も検証しなければ、安全なメカニズムとは言えません。 これにより、kubeletクライアント証明書にアクセスできる悪意のあるアクターが、任意のIPやドメイン名に対してサーバー証明書を要求するCSRを作成することを防止できます。

クラスターの構築中、kubeadm initはsuper-admin.conf内の証明書に署名し、Subject: O = system:masters, CN = kubernetes-super-adminを設定します。

system:mastersは認可のレイヤーをバイパスする(例: RBAC)、緊急用のスーパーユーザーグループです。

admin.confファイルもkubeadmによってコントロールプレーン上に作成され、Subject: O = kubeadm:cluster-admins, CN = kubernetes-adminと設定された証明書が含まれています。

kubeadm:cluster-adminsはkubeadmが属している論理的なグループです。

RBAC(kubeadmのデフォルト)をクラスターに使用している場合、kubeadm:cluster-adminsグループはcluster-admin ClusterRoleにバインドされます。

super-admin.confおよびadmin.confファイルを共有しないでください。

代わりに、管理者として従事するユーザーに対しても最小限のアクセス権限を作成し、緊急アクセス以外の場合にはその最小限の権限の代替手段を使用します。kubeadm kubeconfig userコマンドを使用することで、追加ユーザー用のkubeconfigファイルを生成できます。

このコマンドは、コマンドラインフラグとkubeadm configurationオプションの組み合わせが可能です。

生成されたkubeconfigファイルはstdoutに書き込まれ、kubeadm kubeconfig user ... > somefile.confを使用してファイルにパイプすることができます。

--configで使用できる設定ファイルの例:

# example.yaml

apiVersion: kubeadm.k8s.io/v1beta4

kind: ClusterConfiguration

# kubeconfig内にて、対象の"cluster"として使用します。

clusterName: "kubernetes"

# kubeconfig内にて、このクラスターの"server"(IPもしくはDNS名)として使用します。

controlPlaneEndpoint: "some-dns-address:6443"

# クラスターCAの秘密鍵と証明書が、このローカルディレクトリからロードされます。

certificatesDir: "/etc/kubernetes/pki"

これらの設定が、目的の対象クラスターの設定と一致していることを確認します。 既存のクラスターの設定を表示するには、次のコマンドを使用します。

kubectl get cm kubeadm-config -n kube-system -o=jsonpath="{.data.ClusterConfiguration}"

次の例では、appdevsグループに属する新しいユーザーjohndoeに対して24時間有効な資格情報を含むkubeconfigファイルが生成されます。

kubeadm kubeconfig user --config example.yaml --org appdevs --client-name johndoe --validity-period 24h

次の例では、1週間有効な管理者の資格情報を持つkubeconfigファイルが生成されます。

kubeadm kubeconfig user --config example.yaml --client-name admin --validity-period 168h

kubeadm certs generate-csrコマンドで、証明書署名要求を作成できます。

通常の証明書については、このコマンドの実行によって.csr/.keyファイルのペアが生成されます。

kubeconfigに埋め込まれた証明書については、このコマンドで.csr/.confのペアが生成されます。このペアでは、鍵は.confファイルに埋め込まれています。

CSRファイルには、CAが証明書に署名するために必要な情報が全て含まれています。 kubeadmは全ての証明書とCSRに対し、明確に定義された仕様を適用します。

証明書のデフォルトのディレクトリは/etc/kubernetes/pkiであり、kubeconfigファイルのデフォルトのディレクトリは/etc/kubernetesです。

これらのデフォルトのディレクトリは、それぞれ--cert-dirと--kubeconfig-dirフラグで上書きできます。

kubeadm certs generate-csrにカスタムオプションを渡すには、--configフラグを使用します。

このフラグは、kubeadm initと同様に、kubeadmの設定ファイルを受け入れます。

追加のSANやカスタムIPアドレスなどの指定については、関連の全てのkubeadmコマンドに使用するために、全て同じ設定ファイルに保存し、--configとして渡す必要があります。

このガイドでは、Kubernetesのデフォルトのディレクトリである/etc/kubernetesを使用しています。このディレクトリにはスーパーユーザー権限が必要です。

このガイドに従って、書き込み可能なディレクトリを使用している場合(通常は--cert-dirと--kubeconfig-dirを指定してkubeadmを実行します)は、sudoコマンドを省略できます。

次に、作成したファイルを/etc/kubernetesディレクトリ内にコピーして、kubeadm initもしくはkubeadm joinがこれらのファイルを検出できるようにする必要があります。

kubeadm initを実行する最初のコントロールプレーンノードでは、以下のコマンドを実行してください。

sudo kubeadm init phase certs ca

sudo kubeadm init phase certs etcd-ca

sudo kubeadm init phase certs front-proxy-ca

sudo kubeadm init phase certs sa

これにより、コントロールプレーンノードでkubeadmが必要とする、全ての自己署名CAファイル(証明書と鍵)とサービスアカウント(公開鍵と秘密鍵)が/etc/kubernetes/pkiおよび/etc/kubernetes/pki/etcdフォルダーに作成されます。

外部CAを使用する場合、同じファイルをアウトオブバンドで作成し、最初のコントロールプレーンノードの/etc/kubernetesへ手動でコピーする必要があります。

全ての証明書に署名した後、外部CAモードセクションの記載のように、ルートCAの鍵(ca.key)は削除しても構いません。

2番目以降のコントロールプレーンノード(kubeadm join --control-planeを実行します)では、上記のコマンドを実行する必要はありません。

高可用性クラスターの構築方法に応じて、最初のコントロールプレーンノードから同じファイルを手動でコピーするか、kubeadm initの自動化された--upload-certs機能を使用する必要があります。

kubeadm certs generate-csrコマンドは、kubeadmによって管理される全ての既知の証明書のCSRファイルを作成します。

コマンドの実行後、不要な.csr、.conf、または.keyファイルを手動で削除する必要があります。

このセクションはコントロールプレーンノードとワーカーノードの両方に適用されます。

ca.keyファイルをコントロールプレーンから削除している場合(外部CAモード)、クラスターで実行中のkube-controller-managerはkubeletクライアント証明書への署名ができなくなります。

構成内にこれらの証明書へ署名するための外部の方法(外部署名者など)が存在しない場合は、このガイドで説明されているように、kubelet.conf.csrに手動で署名できます。

なお、これにより、自動によるkubeletクライアント証明書のローテーションが無効になることに注意してください。

その場合は、証明書の有効期限が近づいたら、新しいkubelet.conf.csrを生成し、証明書に署名してkubelet.confに埋め込み、kubeletを再起動する必要があります。

ca.keyファイルがコントロールプレーンノード上に存在する場合、2番目以降のコントロールプレーンノードおよびワーカーノード(kubeadm join ...を実行する全てのノード)では、kubelet.conf.csrの処理をスキップできます。

これは、実行中のkube-controller-managerが新しいkubeletクライアント証明書の署名を担当するためです。

kubelet.conf.csrファイルは、最初のコントロールプレーンノード(最初にkubeadm initを実行したホスト)で処理する必要があります。

これは、kubeadmがそのノードをクラスターのブートストラップ用のノードと見なすため、事前に設定されたkubelet.confが必要になるためです。1番目(kubeadm init)および2番目以降(kubeadm join --control-plane)のコントロールプレーンノードで以下のコマンドを実行し、全てのCSRファイルを生成します。

sudo kubeadm certs generate-csr

外部etcdを使用する場合は、kubeadmとetcdノードに必要なCSRファイルについて理解するために、kubeadmを使用した外部etcdのガイドを参照してください。

/etc/kubernetes/pki/etcd配下にある他の.csrおよび.keyファイルは削除して構いません。

kubelet.confに対する考慮事項の説明に基づいて、kubelet.confおよびkubelet.conf.csrファイルを保持するか削除します。

kubelet.confに対する考慮事項の説明に基づいて、オプションで以下のコマンドを実行し、kubelet.confおよびkubelet.conf.csrファイルを保持します。

sudo kubeadm certs generate-csr

あるいは、ワーカーノードの手順を完全にスキップします。

外部CAを使用し、openssl用のCAのシリアル番号ファイル(.srl)が既に存在する場合は、これらのファイルをCSRを署名するkubeadmノードにコピーできます。

コピーする.srlファイルは、/etc/kubernetes/pki/ca.srl、/etc/kubernetes/pki/front-proxy-ca.srlおよび/etc/kubernetes/pki/etcd/ca.srlです。

その後、これらのファイルをCSRファイルに署名する新たなノードに移動できます。

ノード上のCAに対して.srlファイルが存在しない場合、以下のスクリプトはランダムな開始シリアル番号を持つ新規のSRLファイルを生成します。

.srlファイルの詳細については、opensslドキュメントの--CAserialフラグを参照してください。

CSRファイルが存在する全てのノードで、この手順を繰り返してください。

/etc/kubernetesディレクトリに次のスクリプトを作成し、そのディレクトリに移動してスクリプトを実行します。

このスクリプトは、/etc/kubernetesツリー以下に存在する全てのCSRファイルに対する証明書ファイルを生成します。

#!/bin/bash

# 日単位で証明書の有効期間を設定

DAYS=365

# front-proxyとetcdを除いた全てのCSRファイルへ署名

find ./ -name "*.csr" | grep -v "pki/etcd" | grep -v "front-proxy" | while read -r FILE;

do

echo "* Processing ${FILE} ..."

FILE=${FILE%.*} # 拡張子を取り除く

if [ -f "./pki/ca.srl" ]; then

SERIAL_FLAG="-CAserial ./pki/ca.srl"

else

SERIAL_FLAG="-CAcreateserial"

fi

openssl x509 -req -days "${DAYS}" -CA ./pki/ca.crt -CAkey ./pki/ca.key ${SERIAL_FLAG} \

-in "${FILE}.csr" -out "${FILE}.crt"

sleep 2

done

# 全てのetcdのCSRへ署名

find ./pki/etcd -name "*.csr" | while read -r FILE;

do

echo "* Processing ${FILE} ..."

FILE=${FILE%.*} # 拡張子を取り除く

if [ -f "./pki/etcd/ca.srl" ]; then

SERIAL_FLAG=-CAserial ./pki/etcd/ca.srl

else

SERIAL_FLAG=-CAcreateserial

fi

openssl x509 -req -days "${DAYS}" -CA ./pki/etcd/ca.crt -CAkey ./pki/etcd/ca.key ${SERIAL_FLAG} \

-in "${FILE}.csr" -out "${FILE}.crt"

done

# front-proxyのCSRへ署名

echo "* Processing ./pki/front-proxy-client.csr ..."

openssl x509 -req -days "${DAYS}" -CA ./pki/front-proxy-ca.crt -CAkey ./pki/front-proxy-ca.key -CAcreateserial \

-in ./pki/front-proxy-client.csr -out ./pki/front-proxy-client.crt

CSRファイルが存在する全てのノードで、この手順を繰り返してください。

/etc/kubernetesディレクトリに次のスクリプトを作成し、そのディレクトリに移動してスクリプトを実行します。

このスクリプトは、前の手順でCSRファイルからkubeconfigファイル用に署名された.crtファイルを取得し、これらをkubeconfigファイルに組み込みます。

#!/bin/bash

CLUSTER=kubernetes

find ./ -name "*.conf" | while read -r FILE;

do

echo "* Processing ${FILE} ..."

KUBECONFIG="${FILE}" kubectl config set-cluster "${CLUSTER}" --certificate-authority ./pki/ca.crt --embed-certs

USER=$(KUBECONFIG="${FILE}" kubectl config view -o jsonpath='{.users[0].name}')

KUBECONFIG="${FILE}" kubectl config set-credentials "${USER}" --client-certificate "${FILE}.crt" --embed-certs

done

CSRファイルがあるすべてのノードでこの手順を実行します。

/etc/kubernetesディレクトリに次のスクリプトを作成し、そのディレクトリに移動してスクリプトを実行します。

#!/bin/bash

# CSRファイルのクリーンアップ

rm -f ./*.csr ./pki/*.csr ./pki/etcd/*.csr # 全てのCSRファイルを削除します。

# kubeconfigファイル内に既に埋め込まれているCRTファイルのクリーンアップ

rm -f ./*.crt

必要に応じて、.srlファイルを次に使用するノードへ移動させます。

必要に応じて、外部CAを使用する場合は、外部CAモードのセクションで説明されているように、/etc/kubernetes/pki/ca.keyファイルを削除します。

CSRファイルに署名し、ノードとして使用する各ホストへ証明書を配置すると、kubeadm initコマンドとkubeadm joinを使用してKubernetesクラスターを構築できます。

initとjoinの実行時、kubeadmは各ホストのローカルファイルシステムの/etc/kubernetesツリーで検出した既存の証明書、暗号化キー、およびkubeconfigファイルを使用します。

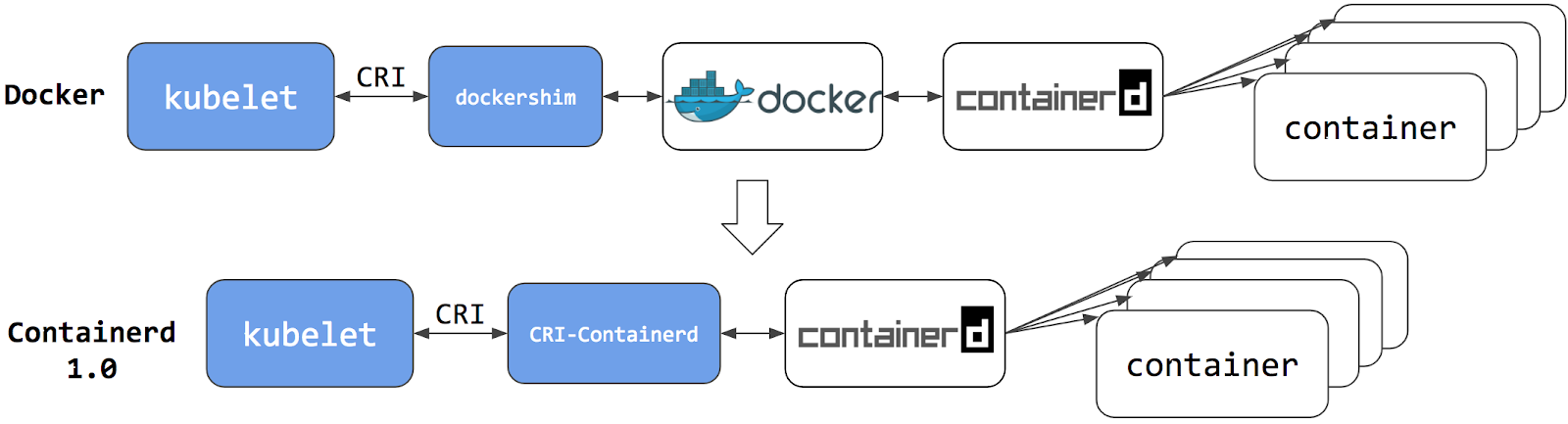

dockershimから他のコンテナランタイムに移行する際に知っておくべき情報を紹介します。

Kubernetes 1.20でdockershim deprecationが発表されてから、様々なワークロードやKubernetesインストールにどう影響するのかという質問が寄せられています。

この問題をよりよく理解するために、dockershimの削除に関するFAQブログが役に立つでしょう。

dockershimから代替のコンテナランタイムに移行することが推奨されます。 コンテナランタイムのセクションをチェックして、どのような選択肢があるかを確認してください。 問題が発生した場合は、必ず問題の報告をしてください。 そうすれば、問題が適時に修正され、クラスターがdockershimの削除に対応できるようになります。

このタスクでは、コンテナランタイムをDockerからcontainerdに更新するために必要な手順について説明します。 これは、Kubernetes 1.23以前を使用しているクラスターオペレーターに適用されます。 また、dockershimからcontainerdへの移行を行う際の具体的なシナリオ例も含まれています。 代替のコンテナランタイムについては、このページを参照してください。

containerdをインストールします。 詳細についてはcontainerdのインストールドキュメントを参照してください。 特定の前提条件については、containerdガイドを参照してください。

kubectl drain <node-to-drain> --ignore-daemonsets

<node-to-drain>は、ドレイン対象のノード名に置き換えてください。

systemctl stop kubelet

systemctl disable docker.service --now

containerdをインストールする手順の詳細については、ガイドを参照してください。

公式のDockerリポジトリからcontainerd.ioパッケージをインストールします。

各Linuxディストリビューション向けにDockerリポジトリを設定し、containerd.ioパッケージをインストールする手順については、Getting started with containerdを参照してください。

containerdを設定する:

sudo mkdir -p /etc/containerd

containerd config default | sudo tee /etc/containerd/config.toml

containerdを再起動する:

sudo systemctl restart containerd

PowerShellセッションを開始し、$Versionに目的のバージョンを設定します(例: $Version="1.4.3")。

その後、次のコマンドを実行します:

containerdをダウンロードする:

curl.exe -L https://github.com/containerd/containerd/releases/download/v$Version/containerd-$Version-windows-amd64.tar.gz -o containerd-windows-amd64.tar.gz

tar.exe xvf .\containerd-windows-amd64.tar.gz

展開および設定:

Copy-Item -Path ".\bin\" -Destination "$Env:ProgramFiles\containerd" -Recurse -Force

cd $Env:ProgramFiles\containerd\

.\containerd.exe config default | Out-File config.toml -Encoding ascii

# 設定内容を確認します。セットアップによっては、以下を調整する必要があります:

# - sandbox_image(Kubernetesのpauseイメージ)

# - cniのbin_dirおよびconf_dirの場所

Get-Content config.toml

# (オプションだが、強く推奨される)containerdをWindows Defenderのスキャン対象から除外する

Add-MpPreference -ExclusionProcess "$Env:ProgramFiles\containerd\containerd.exe"

containerdを起動する:

.\containerd.exe --register-service

Start-Service containerd

/var/lib/kubelet/kubeadm-flags.envファイルを編集し、フラグに--container-runtime-endpoint=unix:///run/containerd/containerd.sockを追加して、containerdランタイムを指定します。

kubeadmを使用しているユーザーは、kubeadmツールが各ホストのCRIソケットを、そのホストのノードオブジェクトにアノテーションとして保存していることに注意してください。

これを変更するには、/etc/kubernetes/admin.confファイルが存在するマシン上で次のコマンドを実行します。

kubectl edit no <node-name>

これによりテキストエディタが起動し、ノードオブジェクトを編集できます。

使用するテキストエディタを指定するには、KUBE_EDITOR環境変数を設定してください。

kubeadm.alpha.kubernetes.io/cri-socketの値を/var/run/dockershim.sockから、使用したいCRIソケットのパス(例: unix:///run/containerd/containerd.sock)に変更します。

新しいCRIソケットのパスは、原則としてunix://で始める必要がある点に注意してください。

テキストエディタで変更を保存すると、ノードオブジェクトが更新されます。

systemctl start kubelet

kubectl get nodes -o wideを実行し、先ほど変更したノードのランタイムとしてcontainerdが表示されていることを確認します。

ノードが正常に見える場合は、Dockerを削除します。

sudo yum remove docker-ce docker-ce-cli

sudo apt-get purge docker-ce docker-ce-cli

sudo dnf remove docker-ce docker-ce-cli

sudo apt-get purge docker-ce docker-ce-cli

前述のコマンドは、ホスト上のイメージ、コンテナ、ボリューム、またはカスタマイズされた設定ファイルを削除しません。 これらを削除するには、DockerのDocker Engineのアンインストール手順に従ってください。

kubectl uncordon <node-to-uncordon>

<node-to-uncordon>は、以前にドレインしたノードの名前に置き換えてください。

このページでは、クラスター内のノードが使用しているコンテナランタイムを確認する手順を概説しています。

クラスターの実行方法によっては、ノード用のコンテナランタイムが事前に設定されている場合と、設定する必要がある場合があります。

マネージドKubernetesサービスを使用している場合、ノードに設定されているコンテナランタイムを確認するためのベンダー固有の方法があるかもしれません。

このページで説明する方法は、kubectlの実行が許可されていればいつでも動作するはずです。

kubectlをインストールし、設定します。詳細はツールのインストールの項を参照してください。

ノードの情報を取得して表示するにはkubectlを使用します:

kubectl get nodes -o wide

出力は以下のようなものです。列CONTAINER-RUNTIMEには、ランタイムとそのバージョンが出力されます。

# For dockershim

NAME STATUS VERSION CONTAINER-RUNTIME

node-1 Ready v1.16.15 docker://19.3.1

node-2 Ready v1.16.15 docker://19.3.1

node-3 Ready v1.16.15 docker://19.3.1

# For containerd

NAME STATUS VERSION CONTAINER-RUNTIME

node-1 Ready v1.19.6 containerd://1.4.1

node-2 Ready v1.19.6 containerd://1.4.1

node-3 Ready v1.19.6 containerd://1.4.1

コンテナランタイムについては、コンテナランタイムのページで詳細を確認することができます。

Kubernetesのdockershimコンポーネントは、DockerをKubernetesのコンテナランタイムとして使用することを可能にします。

Kubernetesの組み込みコンポーネントであるdockershimはリリースv1.24で削除されました。

このページでは、あなたのクラスターがどのようにDockerをコンテナランタイムとして使用しているか、使用中のdockershimが果たす役割について詳しく説明し、dockershimの削除によって影響を受けるワークロードがあるかどうかをチェックするためのステップを示します。

アプリケーションコンテナの構築にDockerを使用している場合でも、これらのコンテナを任意のコンテナランタイム上で実行することができます。このようなDockerの使用は、コンテナランタイムとしてのDockerへの依存とはみなされません。

代替のコンテナランタイムが使用されている場合、Dockerコマンドを実行しても動作しないか、予期せぬ出力が得られる可能性があります。

このように、Dockerへの依存があるかどうかを調べることができます:

docker psなど)を実行したり、Dockerサービスを再起動したり(systemctl restart docker.serviceなどのコマンド)、Docker固有のファイル(/etc/docker/daemon.jsonなど)を変更しないことを確認すること。/etc/docker/daemon.json など)にプライベートレジストリやイメージミラーの設定がないか確認します。これらは通常、別のコンテナランタイムのために再設定する必要があります。コンテナランタイムとは、Kubernetes Podを構成するコンテナを実行できるソフトウェアです。

KubernetesはPodのオーケストレーションとスケジューリングを担当し、各ノードではkubeletがコンテナランタイムインターフェースを抽象化して使用するので、互換性があればどのコンテナランタイムでも使用することができます。 初期のリリースでは、Kubernetesは1つのコンテナランタイムと互換性を提供していました: Dockerです。 その後、Kubernetesプロジェクトの歴史の中で、クラスター運用者は追加のコンテナランタイムを採用することを希望しました。 CRIはこのような柔軟性を可能にするために設計され、kubeletはCRIのサポートを開始しました。 しかし、DockerはCRI仕様が考案される前から存在していたため、Kubernetesプロジェクトはアダプタコンポーネント「dockershim」を作成しました。

dockershimアダプターは、DockerがCRI互換ランタイムであるかのように、kubeletがDockerと対話することを可能にします。 Kubernetes Containerd integration goes GAブログ記事で紹介されています。

コンテナランタイムとしてContainerdに切り替えることで、中間マージンを排除することができます。

これまでと同じように、Containerdのようなコンテナランタイムですべてのコンテナを実行できます。

しかし今は、コンテナはコンテナランタイムで直接スケジュールするので、Dockerからは見えません。

そのため、これらのコンテナをチェックするために以前使っていたかもしれないDockerツールや派手なUIは、もはや利用できません。

docker psやdocker inspectを使用してコンテナ情報を取得することはできません。

コンテナを一覧表示できないので、ログを取得したり、コンテナを停止したり、docker execを使用してコンテナ内で何かを実行したりすることもできません。

この場合でも、イメージを取得したり、docker buildコマンドを使用してビルドすることは可能です。

しかし、Dockerによってビルドまたはプルされたイメージは、コンテナランタイムとKubernetesからは見えません。

Kubernetesで使用できるようにするには、何らかのレジストリにプッシュする必要がありました。

Kubernetes 1.20でdockershimは非推奨になりました。

dockershimの削除に関するFAQから、ほとんどのアプリがコンテナをホストするランタイムに直接依存しないことは既にご存知かもしれません。 しかし、コンテナのメタデータやログ、メトリクスを収集するためにDockerに依存しているテレメトリーやセキュリティエージェントはまだ多く存在します。 この文書では、これらの依存関係を検出する方法と、これらのエージェントを汎用ツールまたは代替ランタイムに移行する方法に関するリンクを集約しています。

Kubernetesクラスター上でエージェントを実行するには、いくつかの方法があります。エージェントはノード上で直接、またはDaemonSetとして実行することができます。

歴史的には、KubernetesはDockerの上に構築されていました。 Kubernetesはネットワークとスケジューリングを管理し、Dockerはコンテナをノードに配置して操作していました。 そのため、KubernetesからはPod名などのスケジューリング関連のメタデータを、Dockerからはコンテナの状態情報を取得することができます。 時が経つにつれ、コンテナを管理するためのランタイムも増えてきました。 また、多くのランタイムにまたがるコンテナ状態情報の抽出を一般化するプロジェクトやKubernetesの機能もあります。

いくつかのエージェントはDockerツールに関連しています。

エージェントはdocker psやdocker topといったコマンドを実行し、コンテナやプロセスの一覧を表示します。

またはdocker logsを使えば、dockerログを購読することができます。

Dockerがコンテナランタイムとして非推奨になったため、これらのコマンドはもう使えません。

Podがノード上で動作しているdockerdを呼び出したい場合、Podは以下のいずれかを行う必要があります。

Dockerデーモンの特権ソケットがあるファイルシステムをvolumeのようにマウントする。

Dockerデーモンの特権ソケットの特定のパスを直接ボリュームとしてマウントします。

例: COSイメージでは、DockerはそのUnixドメインソケットを/var/run/docker.sockに公開します。

つまり、Pod仕様には/var/run/docker.sockのhostPathボリュームマウントが含まれることになります。

以下は、Dockerソケットを直接マッピングしたマウントを持つPodを探すためのシェルスクリプトのサンプルです。

このスクリプトは、Podの名前空間と名前を出力します。

grep '/var/run/docker.sock'を削除して、他のマウントを確認することもできます。

kubectl get pods --all-namespaces \

-o=jsonpath='{range .items[*]}{"\n"}{.metadata.namespace}{":\t"}{.metadata.name}{":\t"}{range .spec.volumes[*]}{.hostPath.path}{", "}{end}{end}' \

| sort \

| grep '/var/run/docker.sock'

/var/runをマウントすることができます(この例 のように)。

上記のスクリプトは、最も一般的な使用方法のみを検出します。クラスターノードをカスタマイズし、セキュリティやテレメトリーのエージェントをノードに追加インストールする場合、エージェントのベンダーにDockerへの依存性があるかどうかを必ず確認してください。

様々なテレメトリーおよびセキュリティエージェントベンダーのための移行指示の作業中バージョンをGoogle docに保管しています。 dockershimからの移行に関する最新の手順については、各ベンダーにお問い合わせください。

クライアント証明書認証を使用する場合、easyrsa、opensslまたはcfsslを使って手動で証明書を生成することができます。

easyrsaはクラスターの証明書を手動で生成することができます。

パッチが適用されたバージョンのeasyrsa3をダウンロードして解凍し、初期化します。

curl -LO https://dl.k8s.io/easy-rsa/easy-rsa.tar.gz

tar xzf easy-rsa.tar.gz

cd easy-rsa-master/easyrsa3

./easyrsa init-pki

新しい認証局(CA)を生成します。

--batchで自動モードに設定します。--req-cnはCAの新しいルート証明書のコモンネーム(CN)を指定します。

./easyrsa --batch "--req-cn=${MASTER_IP}@`date +%s`" build-ca nopass

サーバー証明書と鍵を生成します。

引数--subject-alt-nameは、APIサーバーがアクセス可能なIPとDNS名を設定します。

MASTER_CLUSTER_IPは通常、APIサーバーとコントローラーマネージャーコンポーネントの両方で--service-cluster-ip-range引数に指定したサービスCIDRの最初のIPとなります。

引数--daysは、証明書の有効期限が切れるまでの日数を設定するために使用します。

また、以下のサンプルでは、デフォルトのDNSドメイン名としてcluster.localを使用することを想定しています。

./easyrsa --subject-alt-name="IP:${MASTER_IP},"\

"IP:${MASTER_CLUSTER_IP},"\

"DNS:kubernetes,"\

"DNS:kubernetes.default,"\

"DNS:kubernetes.default.svc,"\

"DNS:kubernetes.default.svc.cluster,"\

"DNS:kubernetes.default.svc.cluster.local" \

--days=10000 \

build-server-full server nopass

pki/ca.crt、pki/issued/server.crt、pki/private/server.keyを自分のディレクトリにコピーします。

APIサーバーのスタートパラメーターに以下のパラメーターを記入し、追加します。

--client-ca-file=/yourdirectory/ca.crt

--tls-cert-file=/yourdirectory/server.crt

--tls-private-key-file=/yourdirectory/server.key

opensslは、クラスター用の証明書を手動で生成することができます。

2048bitのca.keyを生成します:

openssl genrsa -out ca.key 2048

ca.keyに従ってca.crtを生成します(-daysで証明書の有効期限を設定します):

openssl req -x509 -new -nodes -key ca.key -subj "/CN=${MASTER_IP}" -days 10000 -out ca.crt

2048bitでserver.keyを生成します:

openssl genrsa -out server.key 2048

証明書署名要求(CSR)を生成するための設定ファイルを作成します。

山括弧で囲まれた値(例:<MASTER_IP>)は必ず実際の値に置き換えてから、ファイル(例:csr.conf)に保存してください。MASTER_CLUSTER_IPの値は、前のサブセクションで説明したように、APIサーバーのサービスクラスターのIPであることに注意してください。また、以下のサンプルでは、デフォルトのDNSドメイン名としてcluster.localを使用することを想定しています。

[ req ]

default_bits = 2048

prompt = no

default_md = sha256

req_extensions = req_ext

distinguished_name = dn

[ dn ]

C = <country>

ST = <state>

L = <city>

O = <organization>

OU = <organization unit>

CN = <MASTER_IP>

[ req_ext ]

subjectAltName = @alt_names

[ alt_names ]

DNS.1 = kubernetes

DNS.2 = kubernetes.default

DNS.3 = kubernetes.default.svc

DNS.4 = kubernetes.default.svc.cluster

DNS.5 = kubernetes.default.svc.cluster.local

IP.1 = <MASTER_IP>

IP.2 = <MASTER_CLUSTER_IP>

[ v3_ext ]

authorityKeyIdentifier=keyid,issuer:always

basicConstraints=CA:FALSE

keyUsage=keyEncipherment,dataEncipherment

extendedKeyUsage=serverAuth,clientAuth

subjectAltName=@alt_names

設定ファイルに基づき、証明書署名要求を生成します:

openssl req -new -key server.key -out server.csr -config csr.conf

ca.key、ca.crt、server.csrを使用して、サーバー証明書を生成します:

openssl x509 -req -in server.csr -CA ca.crt -CAkey ca.key \

-CAcreateserial -out server.crt -days 10000 \

-extensions v3_ext -extfile csr.conf -sha256

証明書署名要求を表示します:

openssl req -noout -text -in ./server.csr

証明書を表示します:

openssl x509 -noout -text -in ./server.crt

最後に、同じパラメーターをAPIサーバーのスタートパラメーターに追加します。

cfsslも証明書を生成するためのツールです。

以下のように、コマンドラインツールをダウンロードし、解凍して準備してください。

なお、サンプルのコマンドは、お使いのハードウェア・アーキテクチャやCFSSLのバージョンに合わせる必要があるかもしれません。

curl -L https://github.com/cloudflare/cfssl/releases/download/v1.5.0/cfssl_1.5.0_linux_amd64 -o cfssl

chmod +x cfssl

curl -L https://github.com/cloudflare/cfssl/releases/download/v1.5.0/cfssljson_1.5.0_linux_amd64 -o cfssljson

chmod +x cfssljson

curl -L https://github.com/cloudflare/cfssl/releases/download/v1.5.0/cfssl-certinfo_1.5.0_linux_amd64 -o cfssl-certinfo

chmod +x cfssl-certinfo

成果物を格納するディレクトリを作成し、cfsslを初期化します:

mkdir cert

cd cert

../cfssl print-defaults config > config.json

../cfssl print-defaults csr > csr.json

CAファイルを生成するためのJSON設定ファイル、例えばca-config.jsonを作成します:

{

"signing": {

"default": {

"expiry": "8760h"

},

"profiles": {

"kubernetes": {

"usages": [

"signing",

"key encipherment",

"server auth",

"client auth"

],

"expiry": "8760h"

}

}

}

}

CA証明書署名要求(CSR)用のJSON設定ファイル(例:ca-csr.json)を作成します。

山括弧で囲まれた値は、必ず使用したい実際の値に置き換えてください。

{

"CN": "kubernetes",

"key": {

"algo": "rsa",

"size": 2048

},

"names":[{

"C": "<country>",

"ST": "<state>",

"L": "<city>",

"O": "<organization>",

"OU": "<organization unit>"

}]

}

CAキー(ca-key.pem)と証明書(ca.pem)を生成します:

../cfssl gencert -initca ca-csr.json | ../cfssljson -bare ca

APIサーバーの鍵と証明書を生成するためのJSON設定ファイル、例えばserver-csr.jsonを作成します。

山括弧内の値は、必ず使用したい実際の値に置き換えてください。

MASTER_CLUSTER_IPは、前のサブセクションで説明したように、APIサーバーのサービスクラスターのIPです。

また、以下のサンプルでは、デフォルトのDNSドメイン名としてcluster.localを使用することを想定しています。

{

"CN": "kubernetes",

"hosts": [

"127.0.0.1",

"<MASTER_IP>",

"<MASTER_CLUSTER_IP>",

"kubernetes",

"kubernetes.default",

"kubernetes.default.svc",

"kubernetes.default.svc.cluster",

"kubernetes.default.svc.cluster.local"

],

"key": {

"algo": "rsa",

"size": 2048

},

"names": [{

"C": "<country>",

"ST": "<state>",

"L": "<city>",

"O": "<organization>",

"OU": "<organization unit>"

}]

}

APIサーバーの鍵と証明書を生成します。

デフォルトでは、それぞれserver-key.pemとserver.pemというファイルに保存されます:

../cfssl gencert -ca=ca.pem -ca-key=ca-key.pem \

--config=ca-config.json -profile=kubernetes \

server-csr.json | ../cfssljson -bare server

クライアントノードが自己署名入りCA証明書を有効なものとして認識できない場合があります。

非プロダクション環境、または会社のファイアウォールの内側での開発環境であれば、自己署名入りCA証明書をすべてのクライアントに配布し、有効な証明書のローカルリストを更新することができます。

各クライアントで、次の操作を実行します:

sudo cp ca.crt /usr/local/share/ca-certificates/kubernetes.crt

sudo update-ca-certificates

Updating certificates in /etc/ssl/certs...

1 added, 0 removed; done.

Running hooks in /etc/ca-certificates/update.d....

done.

認証に使用するx509証明書のプロビジョニングにはcertificates.k8s.ioAPIを使用することができます。クラスターでのTLSの管理に記述されています。

このページでは、Namespaceのデフォルトのメモリ要求と制限を設定する方法を説明します。

KubernetesクラスターはNamespaceに分割することができます。 デフォルトのメモリ制限を持つNamespaceがあり、独自のメモリ制限を指定しないコンテナでPodを作成しようとすると、コントロールプレーンはそのコンテナにデフォルトのメモリ制限を割り当てます。

Kubernetesは特定の条件下でデフォルトのメモリ要求を割り当てます。 その条件については、このトピックの後半で説明します。

Kubernetesクラスターが必要、かつそのクラスターと通信するためにkubectlコマンドラインツールが設定されている必要があります。 このチュートリアルは、コントロールプレーンのホストとして動作していない少なくとも2つのノードを持つクラスターで実行することをおすすめします。 まだクラスターがない場合、minikubeを使って作成するか、 以下のいずれかのKubernetesプレイグラウンドも使用できます:

クラスターにNamespaceを作成するには、アクセス権が必要です。

クラスターの各ノードには、最低でも2GiBのメモリが必要です。

この演習で作成したリソースがクラスターの他の部分から分離されるように、Namespaceを作成します。

kubectl create namespace default-mem-example

以下は、LimitRangeのマニフェストの例です。 このマニフェストでは、デフォルトのメモリ要求とデフォルトのメモリ制限を指定しています。

apiVersion: v1

kind: LimitRange

metadata:

name: mem-limit-range

spec:

limits:

- default:

memory: 512Mi

defaultRequest:

memory: 256Mi

type: Container

default-mem-example NamespaceにLimitRangeを作成します:

kubectl apply -f https://k8s.io/examples/admin/resource/memory-defaults.yaml --namespace=default-mem-example

default-mem-example NamespaceでPodを作成し、そのPod内のコンテナがメモリ要求とメモリ制限の値を独自に指定しない場合、コントロールプレーンはデフォルト値のメモリ要求256MiBとメモリ制限512MiBを適用します。

以下は、コンテナを1つ持つPodのマニフェストの例です。 コンテナは、メモリ要求とメモリ制限を指定していません。

apiVersion: v1

kind: Pod

metadata:

name: default-mem-demo

spec:

containers:

- name: default-mem-demo-ctr

image: nginx

Podを作成します:

kubectl apply -f https://k8s.io/examples/admin/resource/memory-defaults-pod.yaml --namespace=default-mem-example

Podの詳細情報を表示します:

kubectl get pod default-mem-demo --output=yaml --namespace=default-mem-example

この出力は、Podのコンテナのメモリ要求が256MiBで、メモリ制限が512MiBであることを示しています。 これらはLimitRangeで指定されたデフォルト値です。

containers:

- image: nginx

imagePullPolicy: Always

name: default-mem-demo-ctr

resources:

limits:

memory: 512Mi

requests:

memory: 256Mi

Podを削除します:

kubectl delete pod default-mem-demo --namespace=default-mem-example

以下は1つのコンテナを持つPodのマニフェストです。 コンテナはメモリ制限を指定しますが、メモリ要求は指定しません。

apiVersion: v1

kind: Pod

metadata:

name: default-mem-demo-2

spec:

containers:

- name: default-mem-demo-2-ctr

image: nginx

resources:

limits:

memory: "1Gi"

Podを作成します:

kubectl apply -f https://k8s.io/examples/admin/resource/memory-defaults-pod-2.yaml --namespace=default-mem-example

Podの詳細情報を表示します:

kubectl get pod default-mem-demo-2 --output=yaml --namespace=default-mem-example

この出力は、コンテナのメモリ要求がそのメモリ制限に一致するように設定されていることを示しています。 コンテナにはデフォルトのメモリ要求値である256Miが割り当てられていないことに注意してください。

resources:

limits:

memory: 1Gi

requests:

memory: 1Gi

1つのコンテナを持つPodのマニフェストです。 コンテナはメモリ要求を指定しますが、メモリ制限は指定しません。

apiVersion: v1

kind: Pod

metadata:

name: default-mem-demo-3

spec:

containers:

- name: default-mem-demo-3-ctr

image: nginx

resources:

requests:

memory: "128Mi"

Podを作成します:

kubectl apply -f https://k8s.io/examples/admin/resource/memory-defaults-pod-3.yaml --namespace=default-mem-example

Podの詳細情報を表示します:

kubectl get pod default-mem-demo-3 --output=yaml --namespace=default-mem-example

この出力は、コンテナのメモリ要求が、コンテナのマニフェストで指定された値に設定されていることを示しています。 コンテナは512MiB以下のメモリを使用するように制限されていて、これはNamespaceのデフォルトのメモリ制限と一致します。

resources:

limits:

memory: 512Mi

requests:

memory: 128Mi

LimitRangeは、適用するデフォルト値の一貫性をチェックしません。

これは、LimitRangeによって設定された 制限 のデフォルト値が、クライアントがAPIサーバーに送信するspecでコンテナに指定された 要求 値よりも小さい可能性があることを意味します。

その場合、最終的なPodはスケジュール可能になりません。

詳細については、リソース制限と要求の制約を参照してください。Namespaceにメモリリソースクォータが設定されている場合、メモリ制限のデフォルト値を設定しておくと便利です。 以下はリソースクォータがNamespaceに課す制限のうちの3つです。

LimitRangeの追加時:

コンテナを含む、そのNamespace内のいずれかのPodが独自のメモリ制限を指定していない場合、コントロールプレーンはそのコンテナにデフォルトのメモリ制限を適用し、メモリのResourceQuotaによって制限されているNamespace内でPodを実行できるようにします。

Namespaceを削除します:

kubectl delete namespace default-mem-example

このページでは、Namespaceで実行されるコンテナが使用するメモリーの最小値と最大値を設定する方法を説明します。 LimitRange で最小値と最大値のメモリー値を指定します。 PodがLimitRangeによって課される制約を満たさない場合、そのNamespaceではPodを作成できません。

Kubernetesクラスターが必要、かつそのクラスターと通信するためにkubectlコマンドラインツールが設定されている必要があります。 このチュートリアルは、コントロールプレーンのホストとして動作していない少なくとも2つのノードを持つクラスターで実行することをおすすめします。 まだクラスターがない場合、minikubeを使って作成するか、 以下のいずれかのKubernetesプレイグラウンドも使用できます:

バージョンを確認するには次のコマンドを実行してください: kubectl version.

クラスター内の各ノードには、少なくとも1GiBのメモリーが必要です。

この演習で作成したリソースがクラスターの他の部分から分離されるように、Namespaceを作成します。

kubectl create namespace constraints-mem-example

LimitRangeの設定ファイルです。

apiVersion: v1

kind: LimitRange

metadata:

name: mem-min-max-demo-lr

spec:

limits:

- max:

memory: 1Gi

min:

memory: 500Mi

type: Container

LimitRangeを作成します。

kubectl apply -f https://k8s.io/examples/admin/resource/memory-constraints.yaml --namespace=constraints-mem-example

LimitRangeの詳細情報を表示します。

kubectl get limitrange mem-min-max-demo-lr --namespace=constraints-mem-example --output=yaml

出力されるのは、予想通りメモリー制約の最小値と最大値を示しています。 しかし、LimitRangeの設定ファイルでデフォルト値を指定していないにもかかわらず、 自動的に作成されていることに気づきます。

limits:

- default:

memory: 1Gi

defaultRequest:

memory: 1Gi

max:

memory: 1Gi

min:

memory: 500Mi

type: Container

constraints-mem-exampleNamespaceにコンテナが作成されるたびに、 Kubernetesは以下の手順を実行するようになっています。

コンテナが独自のメモリー要求と制限を指定しない場合は、デフォルトのメモリー要求と制限をコンテナに割り当てます。

コンテナに500MiB以上のメモリー要求があることを確認します。

コンテナのメモリー制限が1GiB以下であることを確認します。

以下は、1つのコンテナを持つPodの設定ファイルです。設定ファイルのコンテナ(containers)では、600MiBのメモリー要求と800MiBのメモリー制限が指定されています。これらはLimitRangeによって課される最小と最大のメモリー制約を満たしています。

apiVersion: v1

kind: Pod

metadata:

name: constraints-mem-demo

spec:

containers:

- name: constraints-mem-demo-ctr

image: nginx

resources:

limits:

memory: "800Mi"

requests:

memory: "600Mi"

Podの作成

kubectl apply -f https://k8s.io/examples/admin/resource/memory-constraints-pod.yaml --namespace=constraints-mem-example

Podのコンテナが実行されていることを確認します。

kubectl get pod constraints-mem-demo --namespace=constraints-mem-example

Podの詳細情報を見ます

kubectl get pod constraints-mem-demo --output=yaml --namespace=constraints-mem-example

出力は、コンテナが600MiBのメモリ要求と800MiBのメモリー制限になっていることを示しています。これらはLimitRangeによって課される制約を満たしています。

resources:

limits:

memory: 800Mi

requests:

memory: 600Mi

Podを消します。

kubectl delete pod constraints-mem-demo --namespace=constraints-mem-example

これは、1つのコンテナを持つPodの設定ファイルです。コンテナは800MiBのメモリー要求と1.5GiBのメモリー制限を指定しています。

apiVersion: v1

kind: Pod

metadata:

name: constraints-mem-demo-2

spec:

containers:

- name: constraints-mem-demo-2-ctr

image: nginx

resources:

limits:

memory: "1.5Gi"

requests:

memory: "800Mi"

Podを作成してみます。

kubectl apply -f https://k8s.io/examples/admin/resource/memory-constraints-pod-2.yaml --namespace=constraints-mem-example

出力は、コンテナが大きすぎるメモリー制限を指定しているため、Podが作成されないことを示しています。

Error from server (Forbidden): error when creating "examples/admin/resource/memory-constraints-pod-2.yaml":

pods "constraints-mem-demo-2" is forbidden: maximum memory usage per Container is 1Gi, but limit is 1536Mi.

これは、1つのコンテナを持つPodの設定ファイルです。コンテナは100MiBのメモリー要求と800MiBのメモリー制限を指定しています。

apiVersion: v1

kind: Pod

metadata:

name: constraints-mem-demo-3

spec:

containers:

- name: constraints-mem-demo-3-ctr

image: nginx

resources:

limits:

memory: "800Mi"

requests:

memory: "100Mi"

Podを作成してみます。

kubectl apply -f https://k8s.io/examples/admin/resource/memory-constraints-pod-3.yaml --namespace=constraints-mem-example

出力は、コンテナが小さすぎるメモリー要求を指定しているため、Podが作成されないことを示しています。

Error from server (Forbidden): error when creating "examples/admin/resource/memory-constraints-pod-3.yaml":

pods "constraints-mem-demo-3" is forbidden: minimum memory usage per Container is 500Mi, but request is 100Mi.

これは、1つのコンテナを持つPodの設定ファイルです。コンテナはメモリー要求を指定しておらず、メモリー制限も指定していません。

apiVersion: v1

kind: Pod

metadata:

name: constraints-mem-demo-4

spec:

containers:

- name: constraints-mem-demo-4-ctr

image: nginx

Podを作成します。

kubectl apply -f https://k8s.io/examples/admin/resource/memory-constraints-pod-4.yaml --namespace=constraints-mem-example

Podの詳細情報を見ます

kubectl get pod constraints-mem-demo-4 --namespace=constraints-mem-example --output=yaml

出力を見ると、Podのコンテナのメモリ要求は1GiB、メモリー制限は1GiBであることがわかります。 コンテナはどのようにしてこれらの値を取得したのでしょうか?

resources:

limits:

memory: 1Gi

requests:

memory: 1Gi

コンテナが独自のメモリー要求と制限を指定していなかったため、LimitRangeから与えられのです。 コンテナが独自のメモリー要求と制限を指定していなかったため、LimitRangeからデフォルトのメモリー要求と制限が与えられたのです。

この時点で、コンテナは起動しているかもしれませんし、起動していないかもしれません。このタスクの前提条件は、ノードが少なくとも1GiBのメモリーを持っていることであることを思い出してください。それぞれのノードが1GiBのメモリーしか持っていない場合、どのノードにも1GiBのメモリー要求に対応するのに十分な割り当て可能なメモリーがありません。たまたま2GiBのメモリーを持つノードを使用しているのであれば、おそらく1GiBのメモリーリクエストに対応するのに十分なスペースを持っていることになります。

Podを削除します。

kubectl delete pod constraints-mem-demo-4 --namespace=constraints-mem-example

LimitRangeによってNamespaceに課される最大および最小のメモリー制約は、Podが作成または更新されたときにのみ適用されます。LimitRangeを変更しても、以前に作成されたPodには影響しません。

クラスター管理者としては、Podが使用できるメモリー量に制限を課したいと思うかもしれません。

例:

クラスター内の各ノードは2GBのメモリーを持っています。クラスター内のどのノードもその要求をサポートできないため、2GB以上のメモリーを要求するPodは受け入れたくありません。

クラスターは運用部門と開発部門で共有されています。 本番用のワークロードでは最大8GBのメモリーを消費しますが、開発用のワークロードでは512MBに制限したいとします。本番用と開発用に別々のNamespaceを作成し、それぞれのNamespaceにメモリー制限を適用します。

Namespaceを削除します。

kubectl delete namespace constraints-mem-example

このページでは、コンテナとPodがNamespace内で使用するCPUリソースの最小値と最大値を設定する方法を説明します。 最小および最大のCPU値はLimitRangeオブジェクトで指定します。 PodがそのLimitRangeによって課される制約を満たさない場合、そのNamespace内ではPodを作成できません。

Kubernetesクラスターが必要、かつそのクラスターと通信するためにkubectlコマンドラインツールが設定されている必要があります。 このチュートリアルは、コントロールプレーンのホストとして動作していない少なくとも2つのノードを持つクラスターで実行することをおすすめします。 まだクラスターがない場合、minikubeを使って作成するか、 以下のいずれかのKubernetesプレイグラウンドも使用できます:

クラスター内でNamespaceを作成できる権限が必要です。

クラスター内の各Nodeには、Pod用に少なくとも1.0 CPUが利用可能である必要があります。 Kubernetesにおける「1 CPU」の意味については、CPUの意味を参照してください。

この演習で作成するリソースをクラスター内の他のリソースから分離するために、Namespaceを作成します。

kubectl create namespace constraints-cpu-example

次に、例としてLimitRangeのマニフェストを示します。

apiVersion: v1

kind: LimitRange

metadata:

name: cpu-min-max-demo-lr

spec:

limits:

- max:

cpu: "800m"

min:

cpu: "200m"

type: Container

LimitRangeを作成します:

kubectl apply -f https://k8s.io/examples/admin/resource/cpu-constraints.yaml --namespace=constraints-cpu-example

LimitRangeの詳細情報を表示します:

kubectl get limitrange cpu-min-max-demo-lr --output=yaml --namespace=constraints-cpu-example