Kubernetes 博客

- 从 Kubernetes Dashboard 到 Headlamp:理解过渡

- Kubernetes v1.36:云控制器管理器中的路由同步新指标

- Kubernetes v1.36:混合版本代理升级到 Beta

- Kubernetes v1.36:Service ExternalIPs 的弃用和移除

- Kubernetes v1.36:工作负载感知调度再进一步

- Kubernetes v1.36:Kubernetes PSI 指标升级到 GA

- Kubernetes v1.36:卷组快照进入正式发布阶段

- Kubernetes v1.36:更多驱动程序、新特性以及下一代 DRA

- Kubernetes v1.36:声明式验证正式发布

- Kubernetes v1.36:无法删除的准入策略

- Kubernetes v1.36:Pod 级资源管理器(Alpha)

- Kubernetes v1.36:Pod 级别资源的原地垂直扩缩容升级至 Beta 版本

- Kubernetes v1.36:借助 Memory QoS 实现分层内存保护

- Kubernetes v1.36:控制器的陈旧性缓解和可观测性

- Kubernetes v1.36:细粒度 kubelet API 鉴权正式发布(GA)

- Kubernetes v1.36:用户命名空间终于正式可用

- SELinux 卷标签变更进入 GA 阶段(以及 v1.37 中可能的影响)

- Kubernetes v1.36:ハル (Haru)

- Kubernetes v1.36 抢先一览

- Ingress2Gateway 1.0 正式发布:通往 Gateway API 的途径

- 在 Kubernetes 上使用 Agent Sandbox 运行智能体

- 无形的重写:现代化 Kubernetes 镜像推广工具

- 宣布成立 AI 网关工作组

- SIG Architecture 聚焦:API 治理

- 节点就绪控制器简介

- Ingress NGINX:Kubernetes 指导委员会和安全响应委员会的声明

- 使用 kind 体验 Gateway API

- Headlamp 2025 年度项目亮点

- 宣布成立 Checkpoint/Restore 工作组

- 使用 clientcmd 实现统一的 API 服务器访问

- Kubernetes v1.35:通过 exec 插件 allowList 限制 kubeconfig 调用的可执行文件,该插件已添加到 kuberc

- Kubernetes v1.35:向 CSI 驱动程序传递服务账号令牌的最佳方式

- Kubernetes v1.35: 通过就地重启 Pod 实现更高的效率

- Kubernetes v1.35:扩展容忍度运算符以支持数值比较(Alpha)

- Kubernetes 1.35:版本化 z-pages API 带来更强大的调试能力

- Kubernetes v1.35:云控制器管理器中的基于监视的路由协调

- Kubernetes v1.35:引入工作负载感知调度

- 避免升级到 etcd v3.6 时出现僵尸集群成员

- Kubernetes v1.35:Job Managed By 特性正式发布(GA)

- Kubernetes v1.35:Timbernetes(世界树版本)

- Kubernetes v1.35 抢先一览

- Kubernetes 配置最佳实践

- Ingress NGINX 退役:你需要了解的内容

- 公布 2025 年指导委员会选举结果

- 7 个常见的 Kubernetes 坑(以及我是如何避开的)

- Kubernetes v1.34:从存储卷扩展失效中恢复(GA)

- Kubernetes v1.34: 将卷组快照推进至 v1beta2 阶段

- Kubernetes v1.34:可变 CSI 节点可分配数进阶至 Beta

- Kubernetes v1.34: 使用 Init 容器定义应用环境变量

- Kubernetes v1.34: Kubernetes 中的 PSI 指标进入 Beta 阶段

- Headlamp AI 助手简介

- Kubernetes v1.34 抢先一览

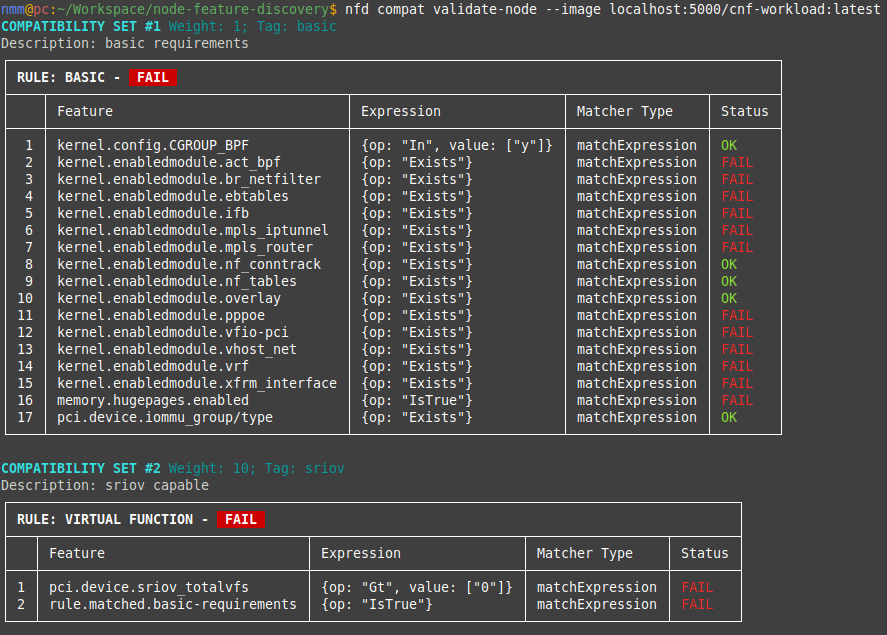

- 云原生环境中的镜像兼容性

- Kubernetes Slack 变更公告

- 通过自定义聚合增强 Kubernetes Event 管理

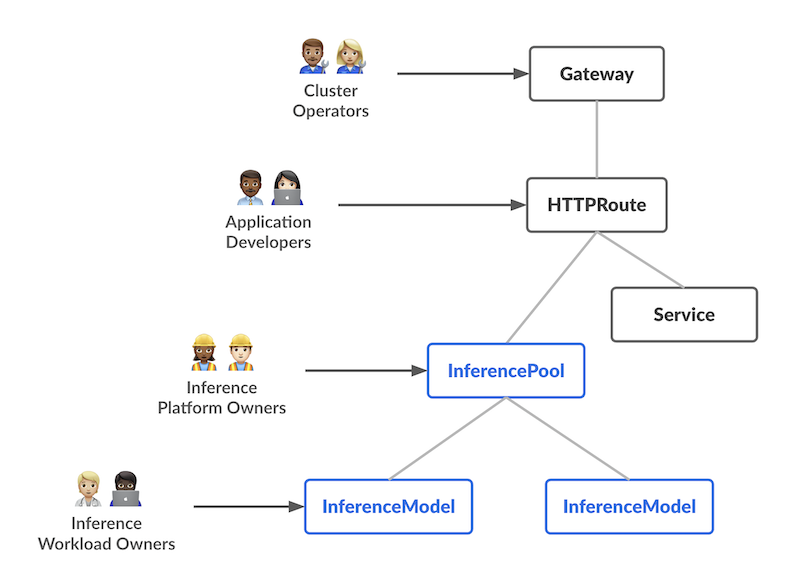

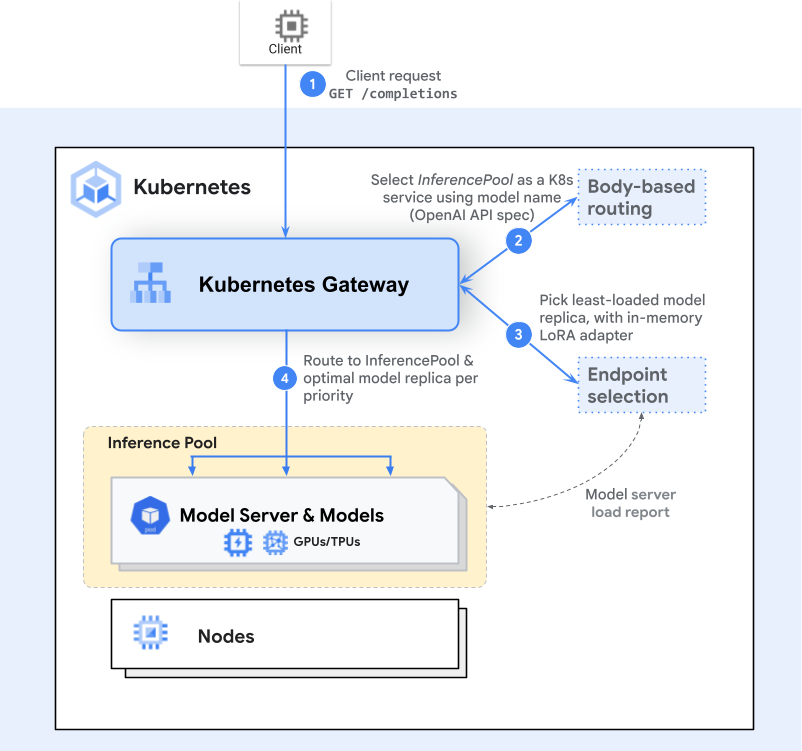

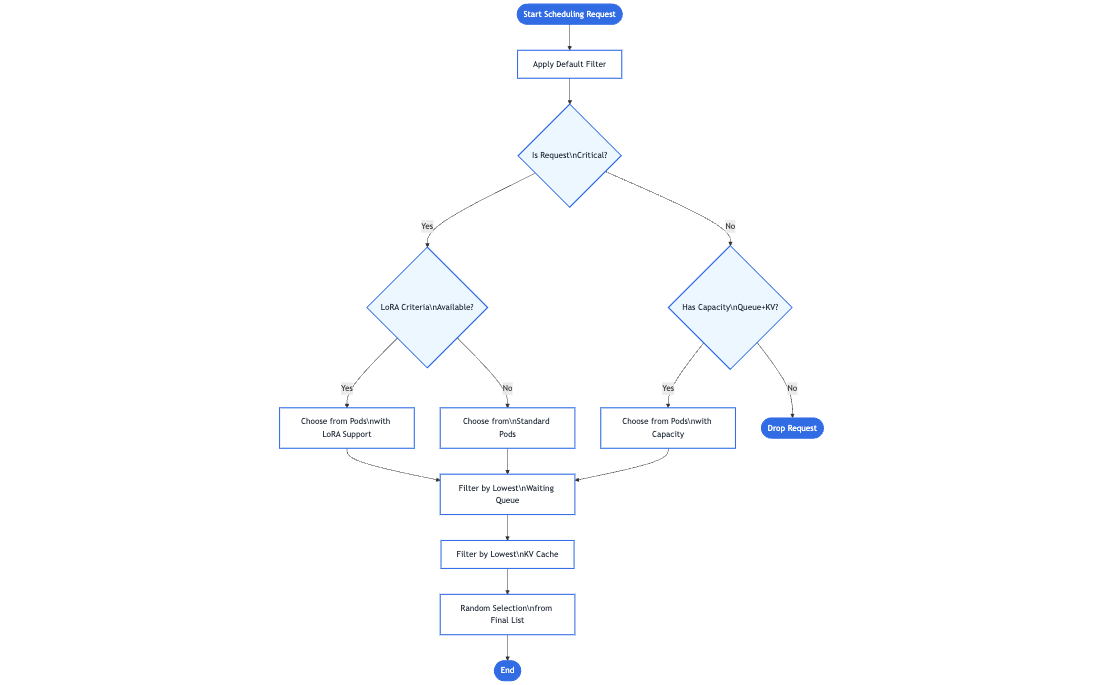

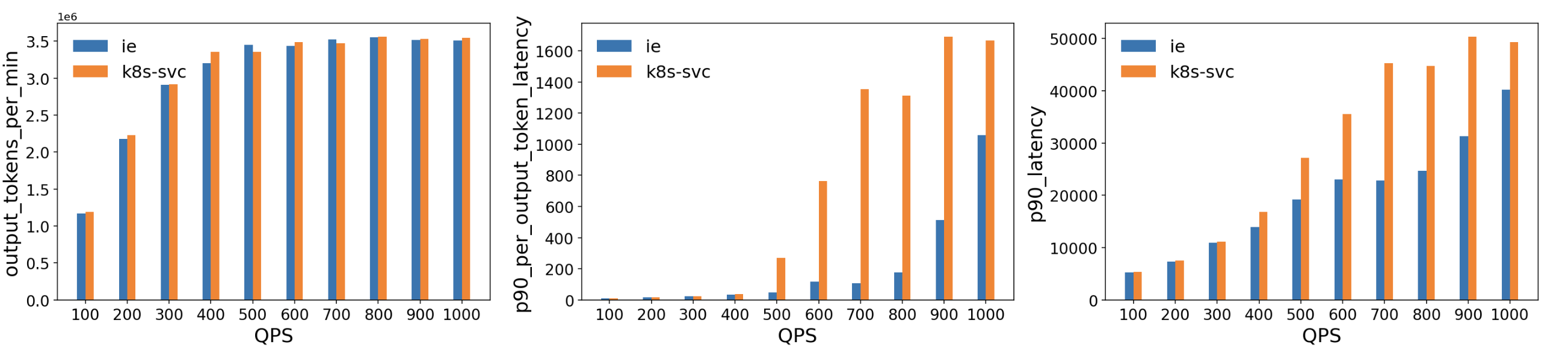

- 介绍 Gateway API 推理扩展

- 先启动边车:如何避免障碍

- Gateway API v1.3.0:流量复制、CORS、Gateway 合并和重试预算的改进

- Kubernetes v1.33:原地调整 Pod 资源特性升级为 Beta

- Kubernetes 1.33:Job 的 SuccessPolicy 进阶至 GA

- Kubernetes v1.33:容器生命周期更新

- Kubernetes v1.33:Job 逐索引的回退限制进阶至 GA

- Kubernetes v1.33:镜像拉取策略终于按你的预期工作了!

- Kubernetes v1.33:流式 List 响应

- Kubernetes 1.33:卷填充器进阶至 GA

- Kubernetes v1.33:防止无序删除时 PersistentVolume 泄漏特性进阶到 GA

- Kubernetes v1.33:可变的 CSI 节点可分配数

- Kubernetes v1.33:存储动态制备模式下的节点存储容量评分(Alpha 版)

- Kubernetes v1.33:镜像卷进阶至 Beta!

- Kubernetes v1.33:HorizontalPodAutoscaler 可配置容差

- Kubernetes 多容器 Pod:概述

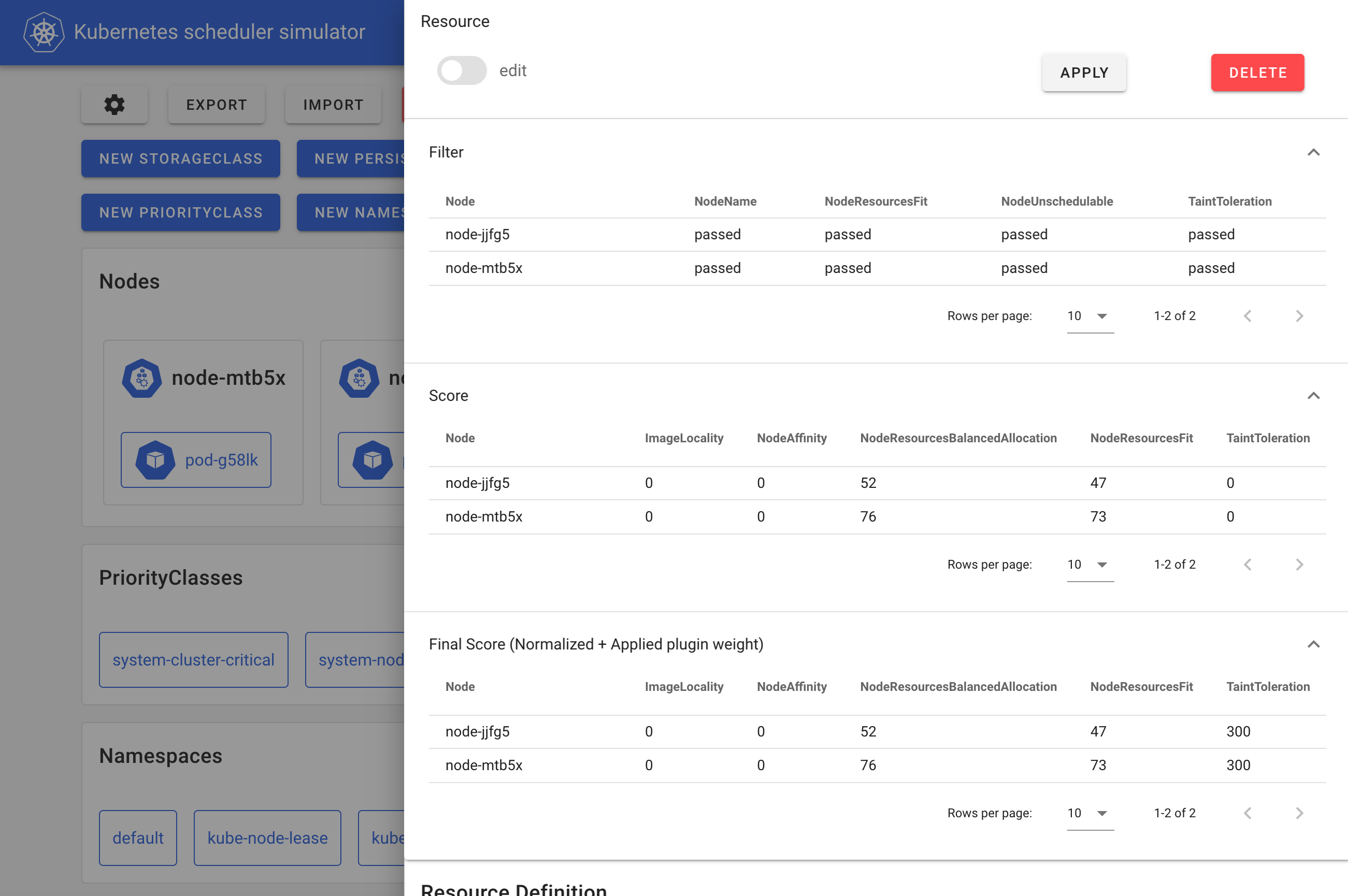

- kube-scheduler-simulator 介绍

- Kubernetes v1.33 预览

- ingress-nginx CVE-2025-1974 须知

- JobSet 介绍

- 聚焦 SIG Apps

- 聚焦 SIG etcd

- kube-proxy 的 NFTables 模式

- 云控制器管理器(Cloud Controller Manager)'鸡与蛋'的问题

- 聚焦 SIG Architecture: Enhancements

- 使用 API 流式传输来增强 Kubernetes API 服务器效率

- Kubernetes v1.32 增加了新的 CPU Manager 静态策略选项用于严格 CPU 预留

- Kubernetes v1.32:内存管理器进阶至 GA

- Kubernetes v1.32:QueueingHint 为优化 Pod 调度带来了新的可能

- Kubernetes v1.32 预览

- 关于日本的 Kubernetes 上游培训的特别报道

- 公布 2024 年指导委员会选举结果

- SIG Scheduling 访谈

- Kubernetes v1.31:kubeadm v1beta4

- Kubernetes 1.31:kubectl debug 中的自定义模板化配置特性已进入 Beta 阶段

- Kubernetes 1.31:细粒度的 SupplementalGroups 控制

- Kubernetes v1.31:全新的 Kubernetes CPUManager 静态策略:跨核分发 CPU

- Kubernetes 1.31: 节点 Cgroup 驱动程序的自动配置 (beta)

- Kubernetes 1.31:流式传输从 SPDY 转换为 WebSocket

- Kubernetes 1.31:针对 Job 的 Pod 失效策略进阶至 GA

- Kubernetes 1.31:podAffinity 中的 matchLabelKeys 进阶至 Beta

- Kubernetes 1.31:防止无序删除时 PersistentVolume 泄漏

- Kubernetes 1.31:基于 OCI 工件的只读卷 (Alpha)

- Kubernetes 1.31:通过 VolumeAttributesClass 修改卷进阶至 Beta

- Kubernetes v1.31:通过基于缓存的一致性读加速集群性能

- Kubernetes 1.31:对 cgroup v1 的支持转为维护模式

- Kubernetes v1.31: PersistentVolume 的最后阶段转换时间进阶到 GA

- Kubernetes v1.31: Elli

- 向 Client-Go 引入特性门控:增强灵活性和控制力

- 聚焦 SIG API Machinery

- Kubernetes v1.31 中的移除和主要变更

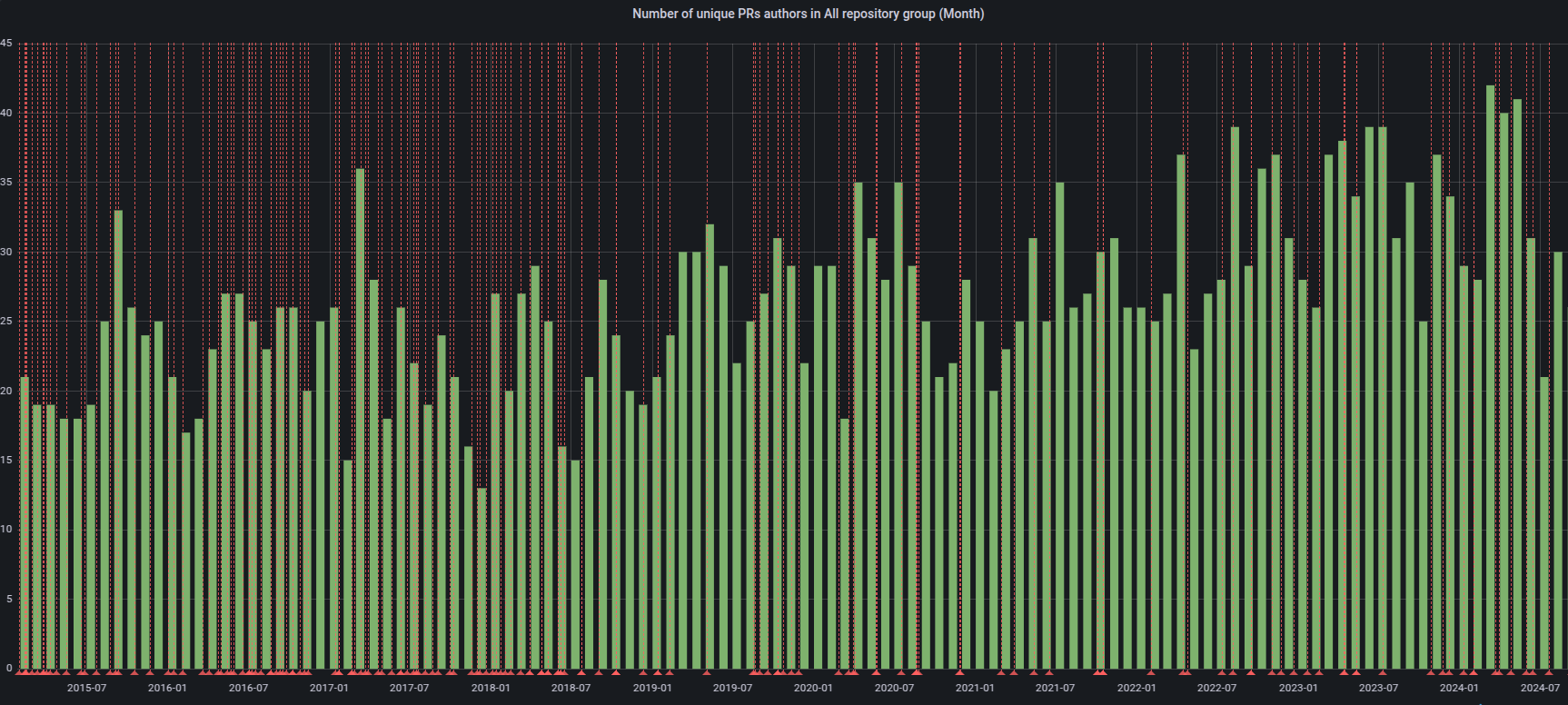

- Kubernetes 的十年

- 完成 Kubernetes 史上最大规模迁移

- Gateway API v1.1:服务网格、GRPCRoute 和更多变化

- Kubernetes 1.30:防止未经授权的卷模式转换进阶到 GA

- Kubernetes 1.30:结构化身份认证配置进阶至 Beta

- Kubernetes 1.30:验证准入策略 ValidatingAdmissionPolicy 正式发布

- Kubernetes 1.30:只读卷挂载终于可以真正实现只读了

- Kubernetes 1.30:对 Pod 使用用户命名空间的支持进阶至 Beta

- SIG Architecture 特别报道:代码组织

- Windows 操作就绪规范简介

- Kubernetes v1.30 初探

- 走进 Kubernetes 读书会(Book Club)

- 镜像文件系统:配置 Kubernetes 将容器存储在独立的文件系统上

- Kubernetes 1.29 中的上下文日志生成:更好的故障排除和增强的日志记录

- Kubernetes 1.29: 解耦污点管理器与节点生命周期控制器

- Kubernetes 1.29:PodReadyToStartContainers 状况进阶至 Beta

- Kubernetes 1.29 新的 Alpha 特性:Service 的负载均衡器 IP 模式

- Kubernetes 1.29:修改卷之 VolumeAttributesClass

- 聚焦 SIG Testing

- Kubernetes 1.29 中的移除、弃用和主要变更

- 介绍 SIG etcd

- Gateway API v1.0:正式发布(GA)

- Kubernetes 中 PersistentVolume 的最后阶段转换时间

- 2023 中国 Kubernetes 贡献者峰会简要回顾

- CRI-O 正迁移至 pkgs.k8s.io

- 聚焦 SIG Architecture: Conformance

- 公布 2023 年指导委员会选举结果

- kubeadm 七周年生日快乐!

- kubeadm:使用 etcd Learner 安全地接入控制平面节点

- 用户命名空间:对运行有状态 Pod 的支持进入 Alpha 阶段!

- 比较本地 Kubernetes 开发工具:Telepresence、Gefyra 和 mirrord

- Kubernetes 旧版软件包仓库将于 2023 年 9 月 13 日被冻结

- Gateway API v0.8.0:引入服务网格支持

- Kubernetes 1.28:用于改进集群安全升级的新(Alpha)机制

- Kubernetes v1.28:介绍原生边车容器

- Kubernetes 1.28:在 Linux 上使用交换内存的 Beta 支持

- Kubernetes 1.28:节点 podresources API 正式发布

- Kubernetes 1.28:Job 失效处理的改进

- Kubernetes v1.28:可追溯的默认 StorageClass 进阶至 GA

- Kubernetes 1.28: 节点非体面关闭进入 GA 阶段(正式发布)

- pkgs.k8s.io:介绍 Kubernetes 社区自有的包仓库

- 聚焦 SIG CLI

- Kubernetes 机密:使用机密虚拟机和安全区来增强你的集群安全性

- 在 CRI 运行时内验证容器镜像签名

- dl.k8s.io 采用内容分发网络(CDN)

- 使用 OCI 工件为 seccomp、SELinux 和 AppArmor 分发安全配置文件

- 在边缘上玩转 seccomp 配置文件

- Kubernetes 1.27: KMS V2 进入 Beta 阶段

- Kubernetes 1.27:关于加快 Pod 启动的进展

- Kubernetes 1.27: 原地调整 Pod 资源 (alpha)

- Kubernetes 1.27:为 NodePort Service 分配端口时避免冲突

- Kubernetes 1.27:kubectl apply 裁剪更安全、更高效

- Kubernetes 1.27:介绍用于磁盘卷组快照的新 API

- Kubernetes 1.27:内存资源的服务质量(QoS)Alpha

- Kubernetes 1.27: StatefulSet PVC 自动删除(beta)

- Kubernetes 1.27:HorizontalPodAutoscaler ContainerResource 类型指标进阶至 Beta

- Kubernetes 1.27: StatefulSet 启动序号简化了迁移

- 官方自动刷新 CVE 订阅源的更新

- Kubernetes 1.27:服务器端字段校验和 OpenAPI V3 进阶至 GA

- Kubernetes 1.27: 使用 Kubelet API 查询节点日志

- Kubernetes 1.27:持久卷的单个 Pod 访问模式升级到 Beta

- Kubernetes 1.27:高效的 SELinux 卷重新标记(Beta 版)

- Kubernetes 1.27:更多精细粒度的 Pod 拓扑分布策略进阶至 Beta

- “使用更新后的 Go 版本保持 Kubernetes 安全”

- Kubernetes 验证准入策略:一个真实示例

- Kubernetes 在 v1.27 中移除的特性和主要变更

- k8s.gcr.io 重定向到 registry.k8s.io - 用户须知

- Kubernetes 的容器检查点分析

- 介绍 KWOK(Kubernetes WithOut Kubelet,没有 Kubelet 的 Kubernetes)

- 免费的 Katacoda Kubernetes 教程即将关闭

- k8s.gcr.io 镜像仓库将从 2023 年 4 月 3 日起被冻结

- 聚光灯下的 SIG Instrumentation

- 考虑所有微服务的脆弱性并对其行为进行监控

- 使用 PriorityClass 确保你的关键任务 Pod 免遭驱逐

- Kubernetes 1.26:PodDisruptionBudget 守护的不健康 Pod 所用的驱逐策略

- Kubernetes v1.26:可追溯的默认 StorageClass

- Kubernetes v1.26:对跨名字空间存储数据源的 Alpha 支持

- Kubernetes v1.26:Kubernetes 中流量工程的进步

- Kubernetes v1.26:CPUManager 正式发布

- Kubernetes 1.26:Pod 调度就绪态

- Kubernetes 1.26: 支持在挂载时将 Pod fsGroup 传递给 CSI 驱动程序

- Kubernetes 1.26:设备管理器正式发布

- Kubernetes 1.26: 节点非体面关闭进入 Beta 阶段

- Kubernetes 1.26: 动态资源分配 Alpha API

- Kubernetes 1.26: 我们现在正在对二进制发布工件进行签名!

- Kubernetes 的取证容器检查点

- Kubernetes 1.26 中的移除、弃用和主要变更

- Kueue 介绍

- “Kubernetes 1.25:对使用用户名字空间运行 Pod 提供 Alpha 支持”

- Kubernetes 1.25:应用滚动上线所用的两个特性进入稳定阶段

- Kubernetes 1.25:Pod 新增 PodHasNetwork 状况

- 宣布自动刷新官方 Kubernetes CVE 订阅源

- Kubernetes 的 iptables 链不是 API

- COSI 简介:使用 Kubernetes API 管理对象存储

- Kubernetes 1.25: cgroup v2 升级到 GA

- Kubernetes 1.25:CSI 内联存储卷正式发布

- PodSecurityPolicy:历史背景

- Kubernetes v1.25: Combiner

- 聚焦 SIG Storage

- 认识我们的贡献者 - 亚太地区(中国地区)

- 逐个 KEP 地增强 Kubernetes

- Kubernetes 1.25 的移除说明和主要变更

- 聚光灯下的 SIG Docs

- Kubernetes Gateway API 进入 Beta 阶段

- 2021 年度总结报告

- Kubernetes 1.24: StatefulSet 的最大不可用副本数

- Kubernetes 1.24 中的上下文日志记录

- Kubernetes 1.24: 避免为 Services 分配 IP 地址时发生冲突

- Kubernetes 1.24: 节点非体面关闭特性进入 Alpha 阶段

- Kubernetes 1.24: 防止未经授权的卷模式转换

- Kubernetes 1.24: 卷填充器功能进入 Beta 阶段

- Kubernetes 1.24:gRPC 容器探针功能进入 Beta 阶段

- Kubernetes 1.24 版本中存储容量跟踪特性进入 GA 阶段

- Kubernetes 1.24:卷扩充现在成为稳定功能

- Dockershim:历史背景

- Kubernetes 1.24: 观星者

- Frontiers, fsGroups and frogs: Kubernetes 1.23 发布采访

- 在 Ingress-NGINX v1.2.0 中提高安全标准

- Kubernetes 1.24 中的移除和弃用

- 你的集群准备好使用 v1.24 版本了吗?

- 认识我们的贡献者 - 亚太地区(澳大利亚-新西兰地区)

- 更新:移除 Dockershim 的常见问题

- SIG Node CI 子项目庆祝测试改进两周年

- 关注 SIG Multicluster

- 确保准入控制器的安全

- 认识我们的贡献者 - 亚太地区(印度地区)

- Kubernetes 即将移除 Dockershim:承诺和下一步

- Security Profiles Operator v0.4.0 中的新功能

- Kubernetes 1.23: StatefulSet PVC 自动删除 (alpha)

- Kubernetes 1.23:树内存储向 CSI 卷迁移工作的进展更新

- Kubernetes 1.23:IPv4/IPv6 双协议栈网络达到 GA

- 公布 2021 年指导委员会选举结果

- 关注 SIG Node

- 更新 NGINX-Ingress 以使用稳定的 Ingress API

- 聚焦 SIG Usability

- 卷健康监控的 Alpha 更新

- 弃用 PodSecurityPolicy:过去、现在、未来

- 一个编排高可用应用的 Kubernetes 自定义调度器

- Kubernetes 1.20:CSI 驱动程序中的 Pod 身份假扮和短时卷

- Kubernetes 1.20: 最新版本

- 别慌: Kubernetes 和 Docker

- 弃用 Dockershim 的常见问题

- 为开发指南做贡献

- 结构化日志介绍

- 警告: 有用的预警

- Docsy 带来更好的 Docs UX

- Kubernetes 1.18: Fit & Finish

- 基于 MIPS 架构的 Kubernetes 方案

- Kubernetes 1.17:稳定

- 使用 Java 开发一个 Kubernetes controller

- 使用 Microk8s 在 Linux 上本地运行 Kubernetes

- Kubernetes 文档最终用户调研

- 圣迭戈贡献者峰会日程公布!

- 2019 指导委员会选举结果

- San Diego 贡献者峰会开放注册!

- 机器可以完成这项工作,一个关于 kubernetes 测试、CI 和自动化贡献者体验的故事

- OPA Gatekeeper:Kubernetes 的策略和管理

- 欢迎参加在上海举行的贡献者峰会

- 壮大我们的贡献者研讨会

- 如何参与 Kubernetes 文档的本地化工作

- 使用 Kubernetes 设备插件和 RuntimeClass 在 Ingress 控制器中实现硬件加速 SSL/TLS 终止

- Kubernetes 1.14 稳定性改进中的进程ID限制

- Raw Block Volume 支持进入 Beta

- 新贡献者工作坊上海站

- Kubernetes 文档更新,国际版

- Kubernetes 2018 年北美贡献者峰会

- 2018 年督导委员会选举结果

- Kubernetes 中的拓扑感知数据卷供应

- Kubernetes v1.12: RuntimeClass 简介

- KubeDirector:在 Kubernetes 上运行复杂状态应用程序的简单方法

- 在 Kubernetes 上对 gRPC 服务器进行健康检查

- 使用 CSI 和 Kubernetes 实现卷的动态扩容

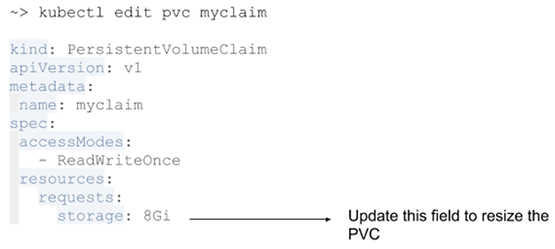

- 使用 Kubernetes 调整 PersistentVolume 的大小

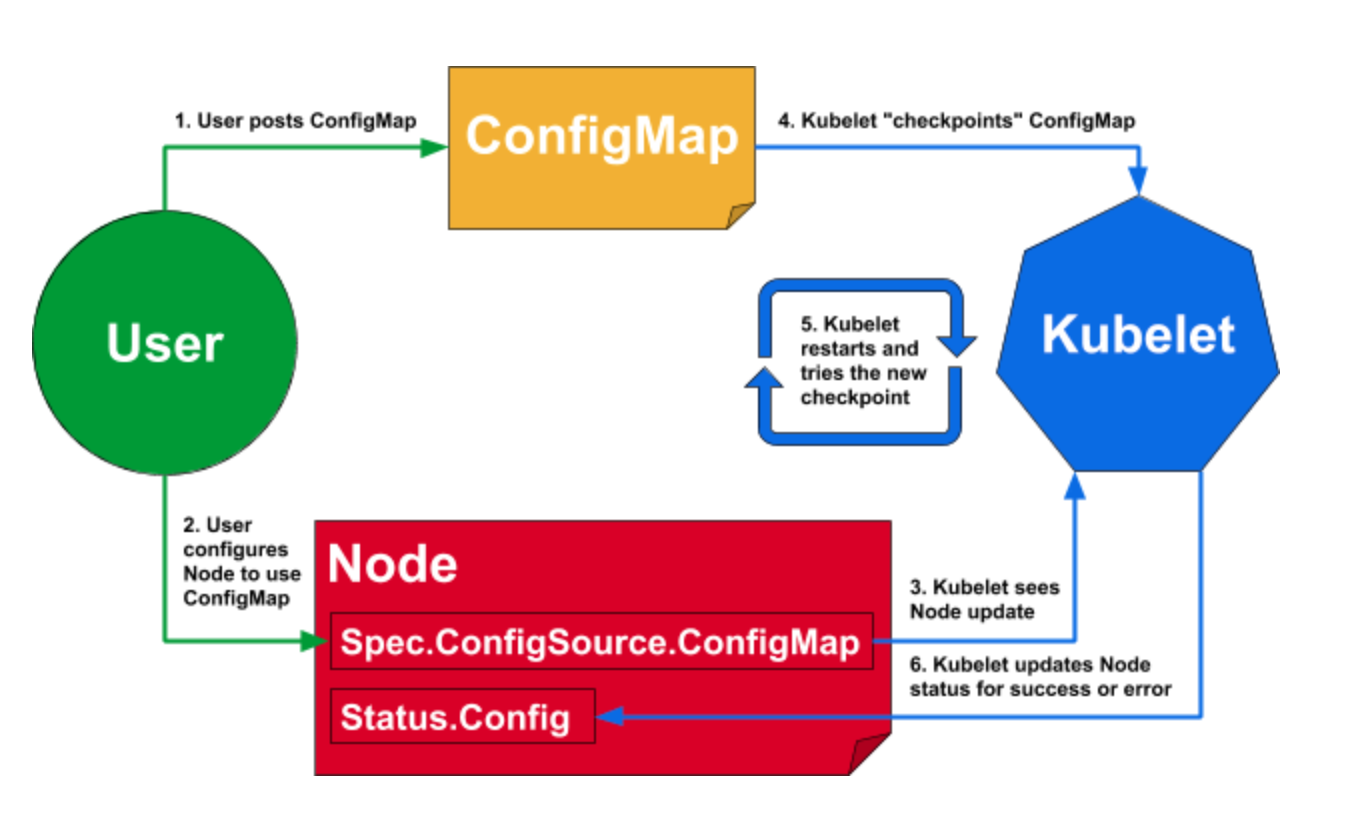

- 动态 Kubelet 配置

- 用于 Kubernetes 集群 DNS 的 CoreDNS GA 正式发布

- 基于 IPVS 的集群内部负载均衡

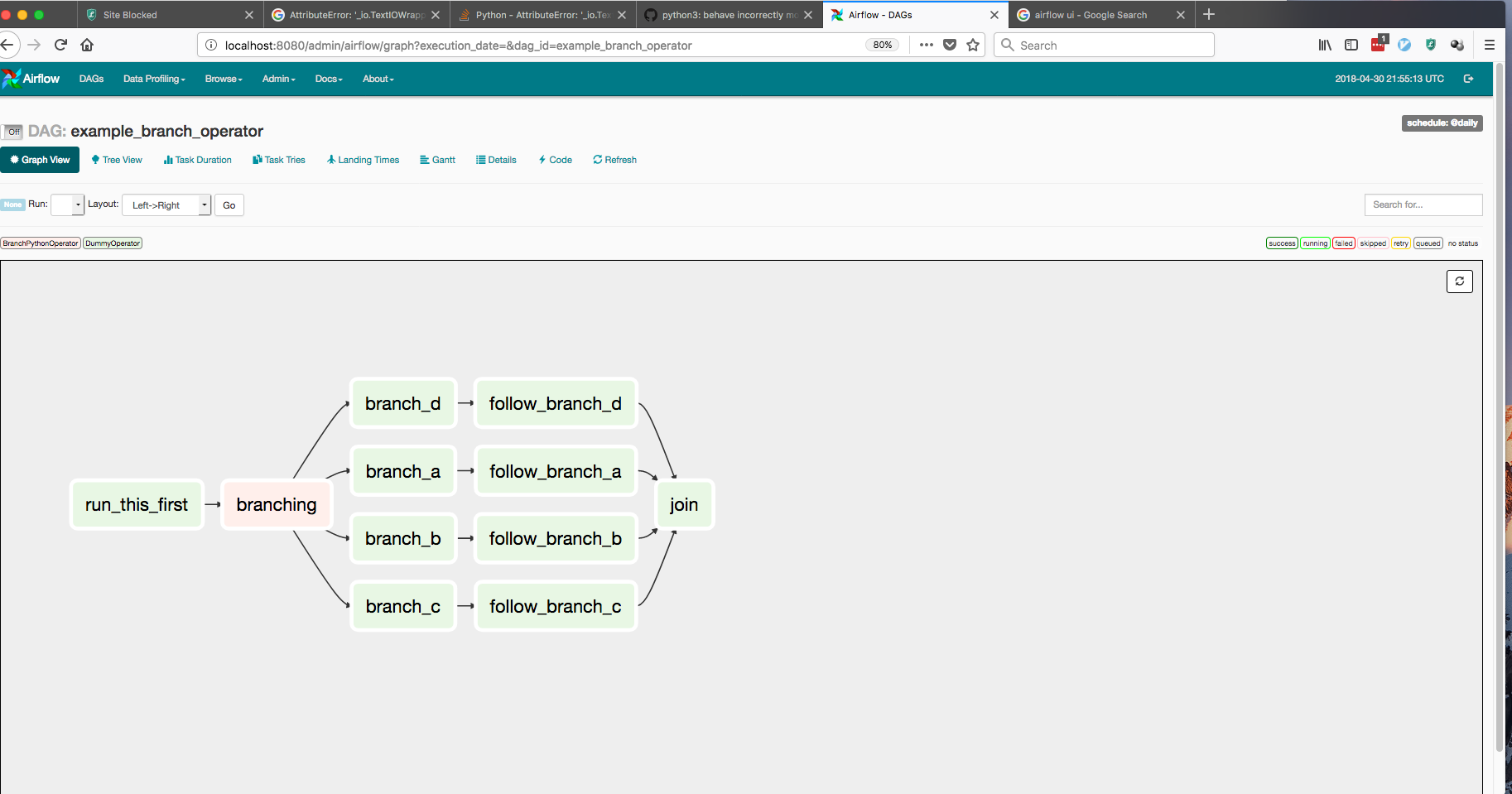

- Airflow 在 Kubernetes 中的使用(第一部分):一种不同的操作器

- Kubernetes 的动态 Ingress

- Kubernetes 这四年

- 向 Discuss Kubernetes 问好

- 在 Kubernetes 上开发

- Kubernetes 社区 - 2017 年开源排行榜榜首

- 基于容器的应用程序设计原理

- Kubernetes 1.9 对 Windows Server 容器提供 Beta 版本支持

- Kubernetes 中自动缩放

- Kubernetes 1.8 的五天

- Kubernetes 社区指导委员会选举结果

- 使用 Kubernetes Pet Sets 和 Datera Elastic Data Fabric 的 FlexVolume 扩展有状态的应用程序

- SIG Apps: 为 Kubernetes 构建应用并在 Kubernetes 中进行运维

- Kubernetes 生日快乐。哦,这是你要去的地方!

- 将端到端的 Kubernetes 测试引入 Azure (第二部分)

- Dashboard - Kubernetes 的全功能 Web 界面

- Citrix + Kubernetes = 全垒打

- 容器中运行有状态的应用!? Kubernetes 1.3 说 “是!”

- CoreOS Fest 2016: CoreOS 和 Kubernetes 在柏林(和旧金山)社区见面会

- SIG-ClusterOps: 提升 Kubernetes 集群的可操作性和互操作性

- “SIG-Networking:1.3 版本引入 Kubernetes 网络策略 API”

- 在 Rancher 中添加对 Kuernetes 的支持

- KubeCon EU 2016:伦敦 Kubernetes 社区

- Kubernetes 社区会议记录 - 20160218

- Kubernetes 社区会议记录 - 20160204

- 容器世界现状,2016 年 1 月

- Kubernetes 社区会议记录 - 20160114

- 为什么 Kubernetes 不用 libnetwork

- Kubernetes 和 Docker 简单的 leader election

- 使用 Puppet 管理 Kubernetes Pod、Service 和 Replication Controller

- Kubernetes 1.1 性能升级,工具改进和社区不断壮大

- Kubernetes 社区每周环聊笔记——2015 年 7 月 31 日

- 宣布首个Kubernetes企业培训课程

- 幻灯片:Kubernetes 集群管理,爱丁堡大学演讲

- OpenStack 上的 Kubernetes

- Kubernetes 社区每周聚会笔记- 2015年5月1日

- 通过 RKT 对 Kubernetes 的 AppC 支持

- Kubernetes 社区每周聚会笔记- 2015年4月24日

- Borg: Kubernetes 的前身

- Kubernetes 社区每周聚会笔记- 2015年4月17日

- Kubernetes Release: 0.15.0

- 每周 Kubernetes 社区例会笔记 - 2015 年 4 月 3 日

- Kubernetes 社区每周聚会笔记 - 2015 年 3 月 27 日

- Kubernetes 采集视频

- 欢迎来到 Kubernetes 博客!

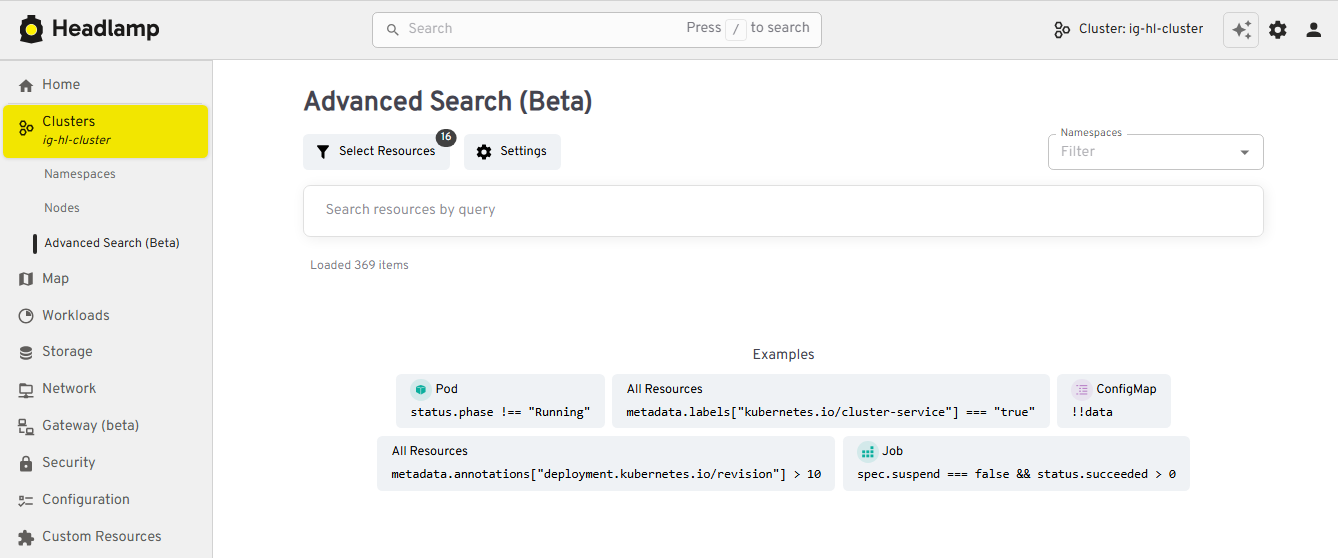

从 Kubernetes Dashboard 到 Headlamp:理解过渡

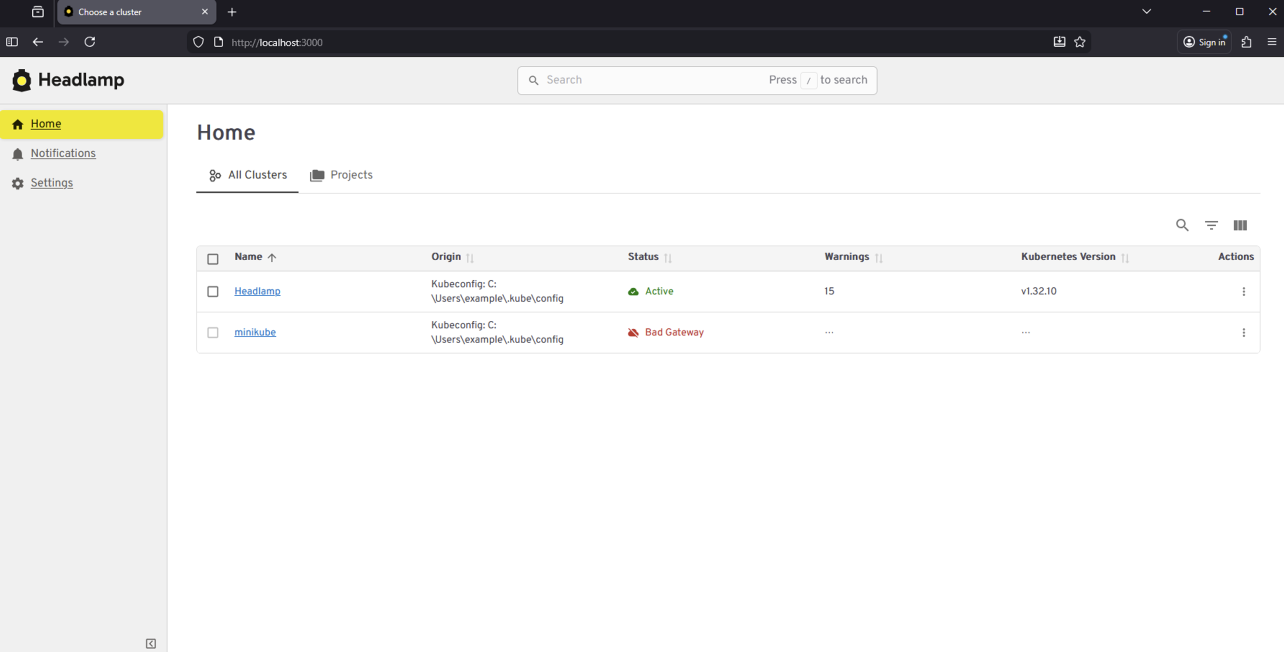

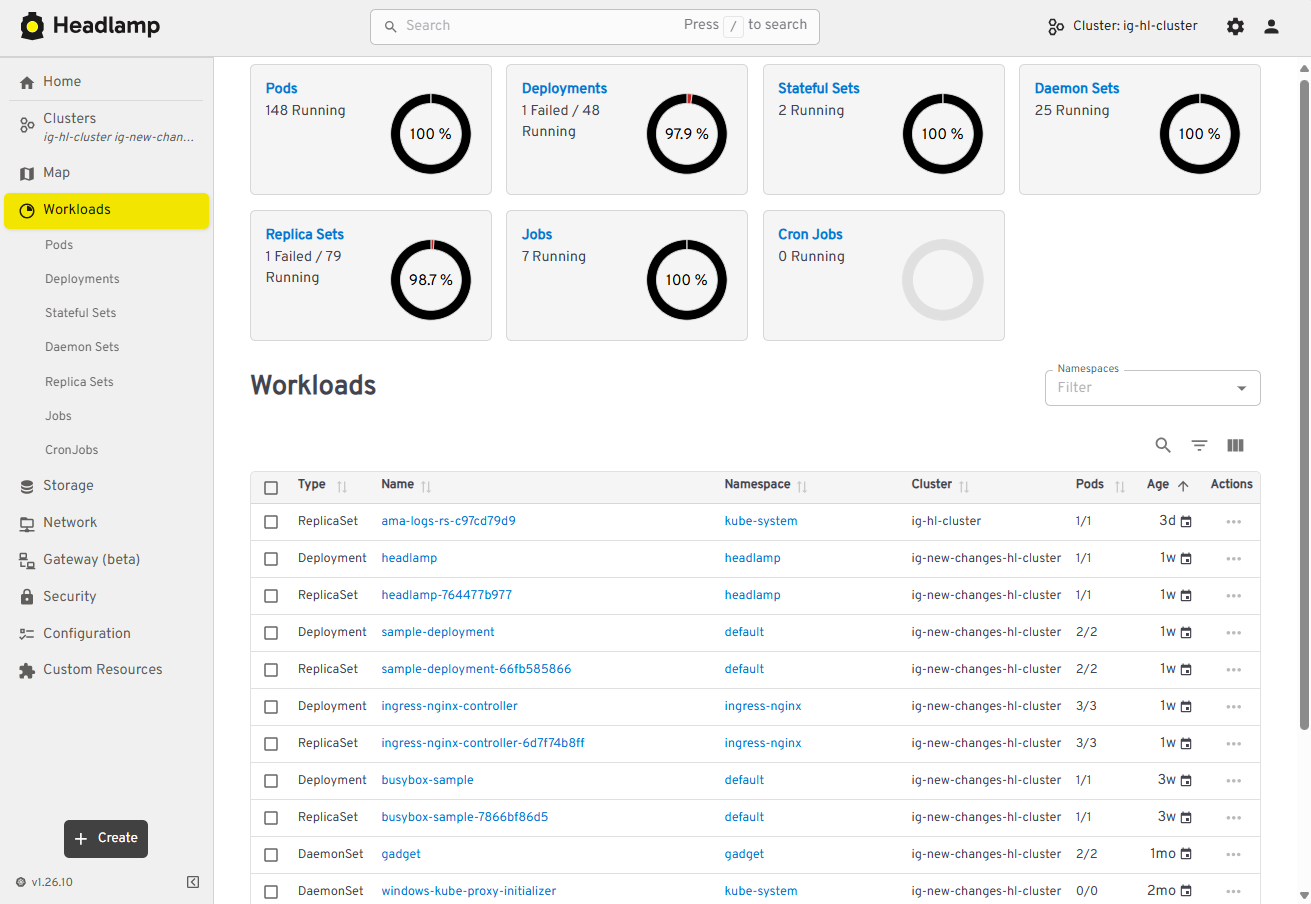

对许多人来说,Kubernetes Dashboard 是他们了解 Kubernetes 的第一个窗口。 它提供了一种简单的可视化方式来查看集群中运行的内容、检查资源,并在不依赖命令行的情况下建立信心。 多年来,它帮助开发者、学生和运维人员理解 Kubernetes,并作为进入生态系统的重要入口。

Kubernetes Dashboard 项目现已归档。 我们深深尊重该团队所做的工作,以及 Dashboard 在让如此多用户更容易接触 Kubernetes 方面所发挥的作用。

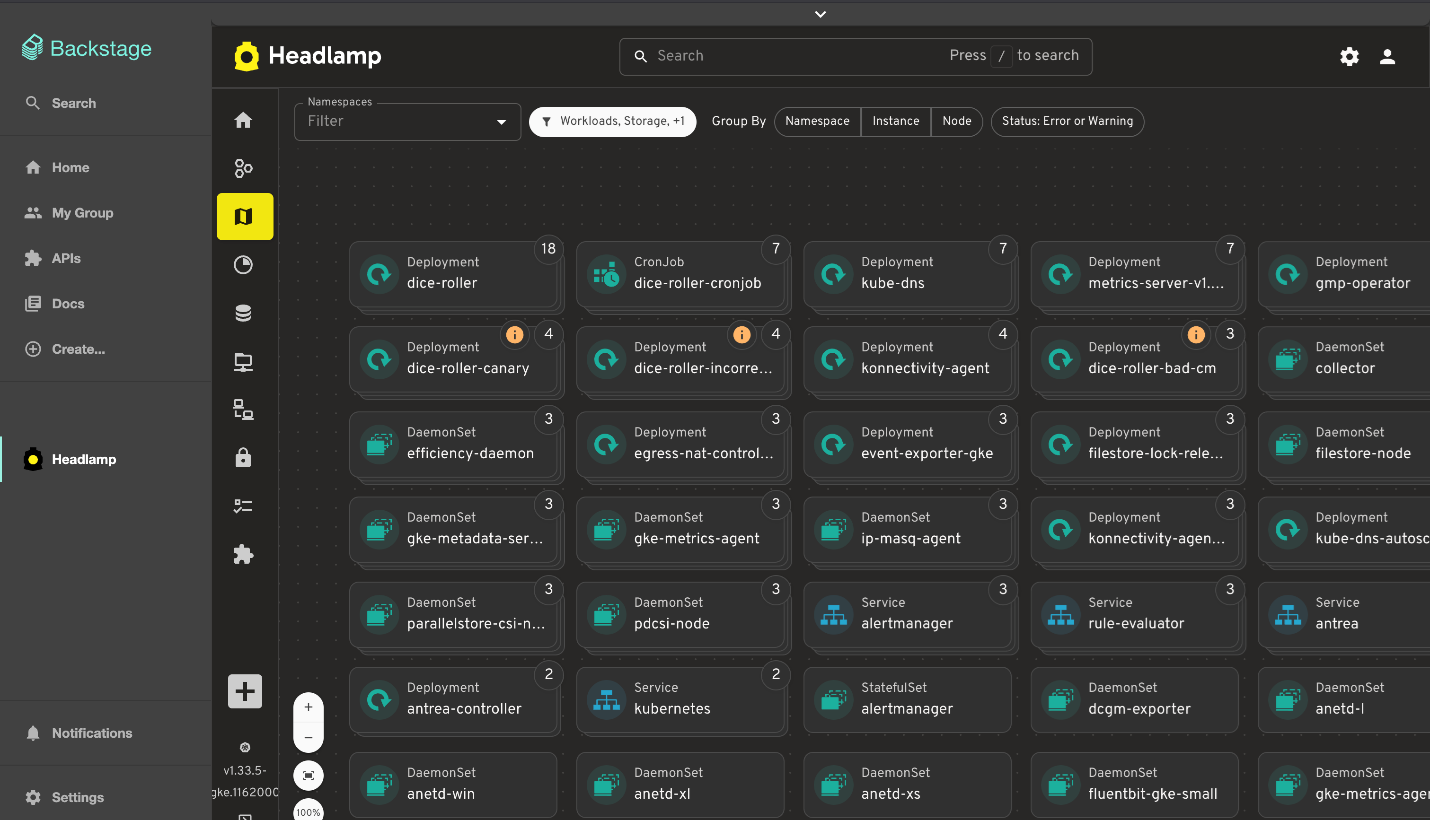

Headlamp 在此基础上构建并向前发展。 它保持了可视化界面的清晰性,同时添加了与当今 Kubernetes 使用方式相匹配的功能。 这包括多集群可见性、以应用为中心的视图、通过插件实现的可扩展性,以及在集群内和桌面上都能工作的灵活部署选项。

本指南旨在帮助你自信地完成这一过渡。 在深入探讨迁移机制之前,我们从熟悉的内容开始, 看看常见的 Kubernetes Dashboard 工作流程如何映射到 Headlamp。 我们还将介绍切换后保持不变的内容和改进的内容。 我们的目标不仅是替换工具,更是为了尊重以用户为中心的传统, 并帮助你找到一个能够随着 Kubernetes 使用方式演变而成长的 UI。

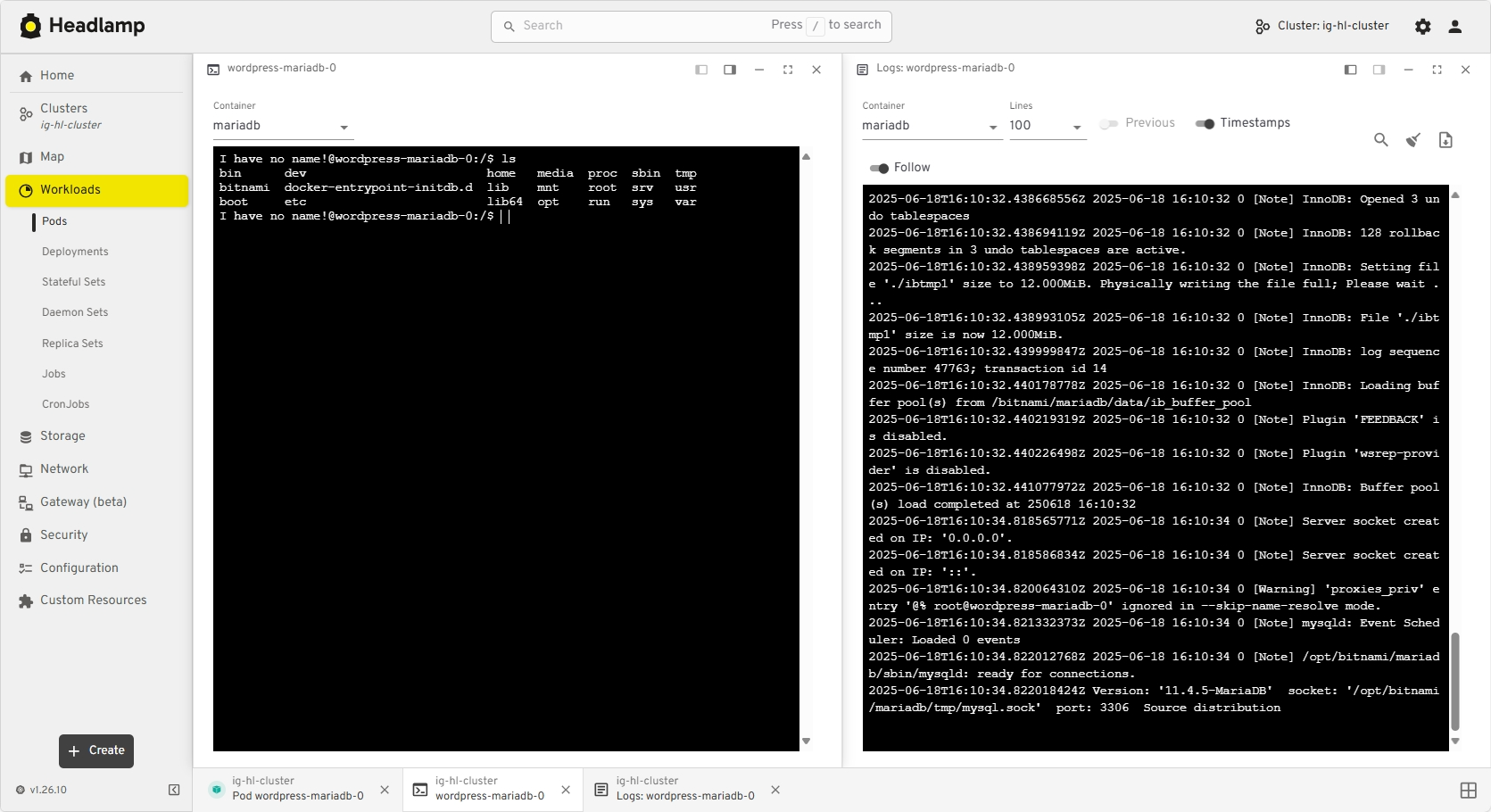

Kubernetes Dashboard 工作负载映射到 Headlamp

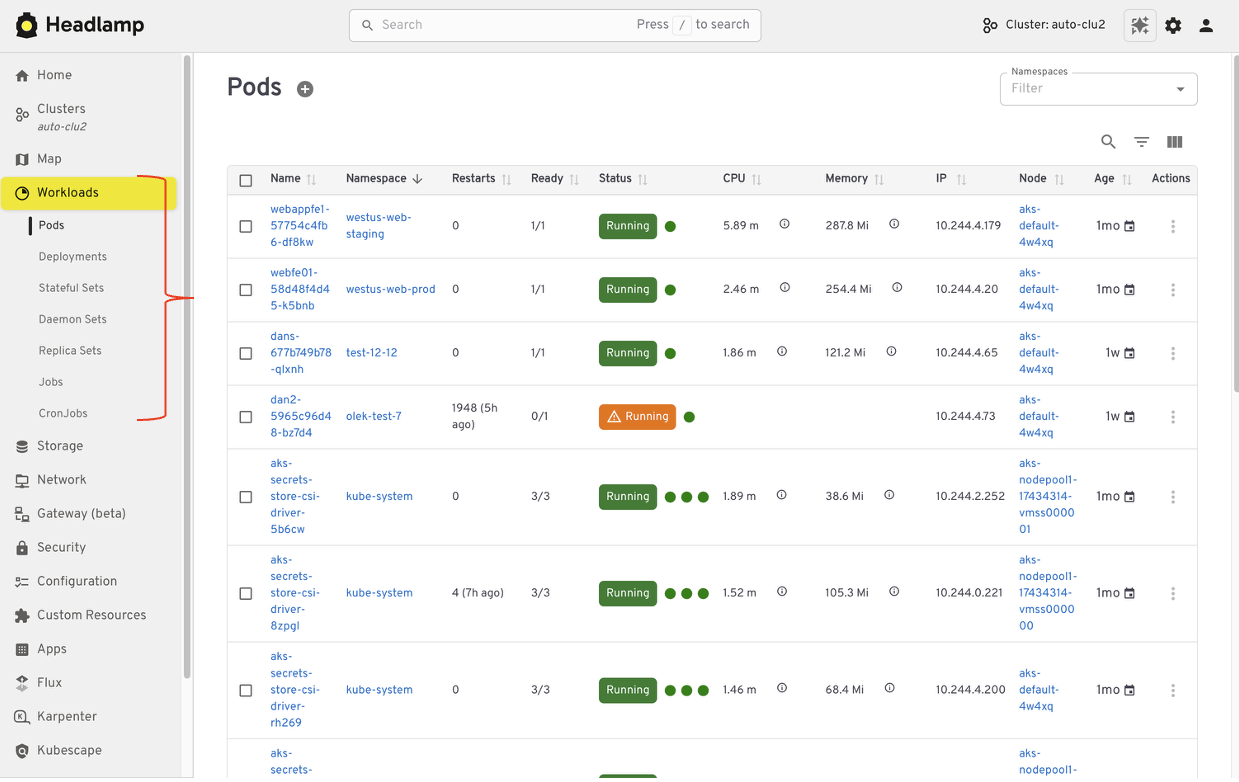

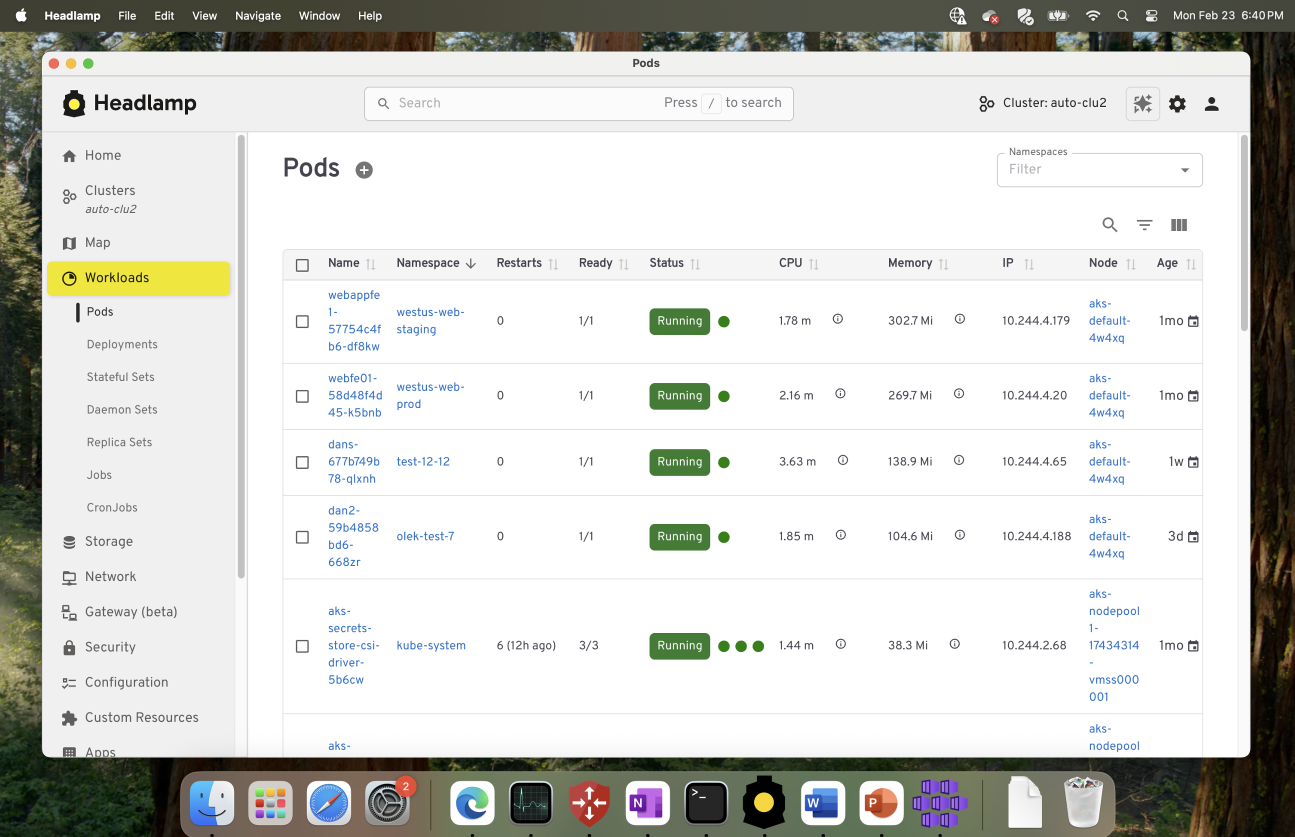

如果你以前使用过 Kubernetes Dashboard,Headlamp 中的许多工作流程会让你感到熟悉。 Headlamp 并没有引入新的思维方式。 相反,它建立在用户已经熟悉的工作负载之上,并以实用的方式扩展它们。 重点是连续性。以前有效的方法仍然有效,同时有更多的发展空间。

查看工作负载和资源

在 Kubernetes Dashboard 中,大多数用户从浏览工作负载(如 Pod、Deployment、Service 和 Namespace)开始。 Headlamp 保持这个相同的起点。工作负载易于查找和检查,在命名空间和集群之间切换更加简单。 资源仍然以熟悉的方式组织,导航感觉更流畅,尤其是在跨多个环境工作时。

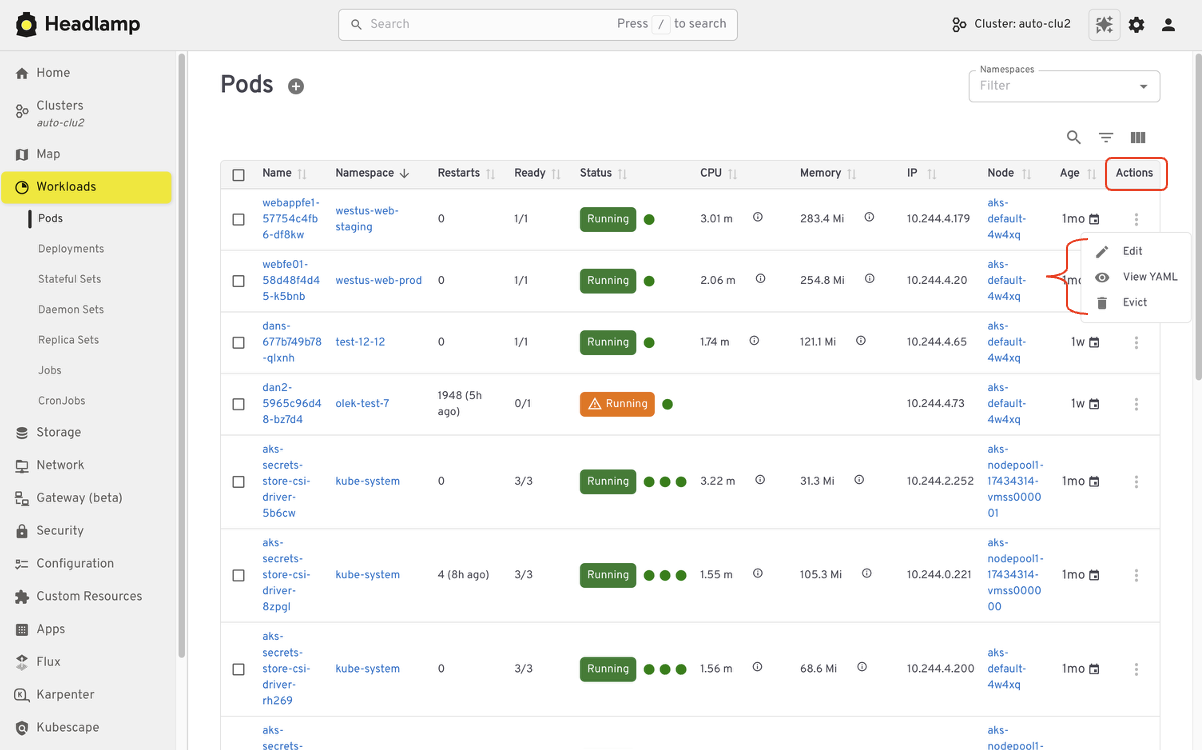

编辑和与资源交互

与 Kubernetes Dashboard 一样,Headlamp 允许你根据权限直接在 UI 中查看和编辑清单。 你可以从界面删除资源、缩放工作负载或更新配置。所有操作都遵循标准的 Kubernetes RBAC。 如果你能在 Dashboard 中执行某个操作,你将在 Headlamp 中找到相同的功能,并且同样尊重访问控制。

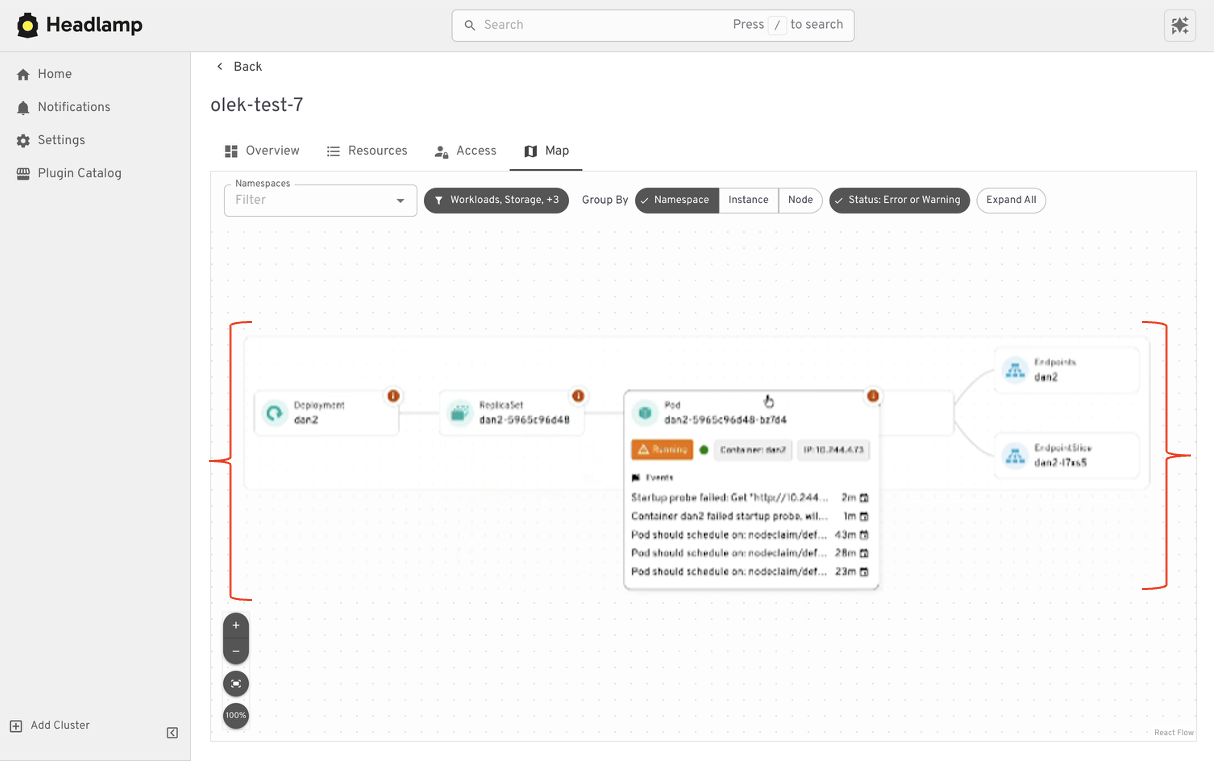

理解关系

Headlamp 开始扩展体验的地方在于它呈现资源之间关系的方式。 除了列表视图,Headlamp 还提供了可视化方式来查看工作负载、服务和配置之间的连接。 这有助于在不改变用户已经依赖的底层工作负载的情况下提供上下文。

从高层次来看,你在 Kubernetes Dashboard 中执行的任务仍然存在。 Headlamp 保留了熟悉的工作流程,同时随着集群、团队和应用的增长,使其更容易扩展。

Headlamp 超越 Kubernetes Dashboard 的地方

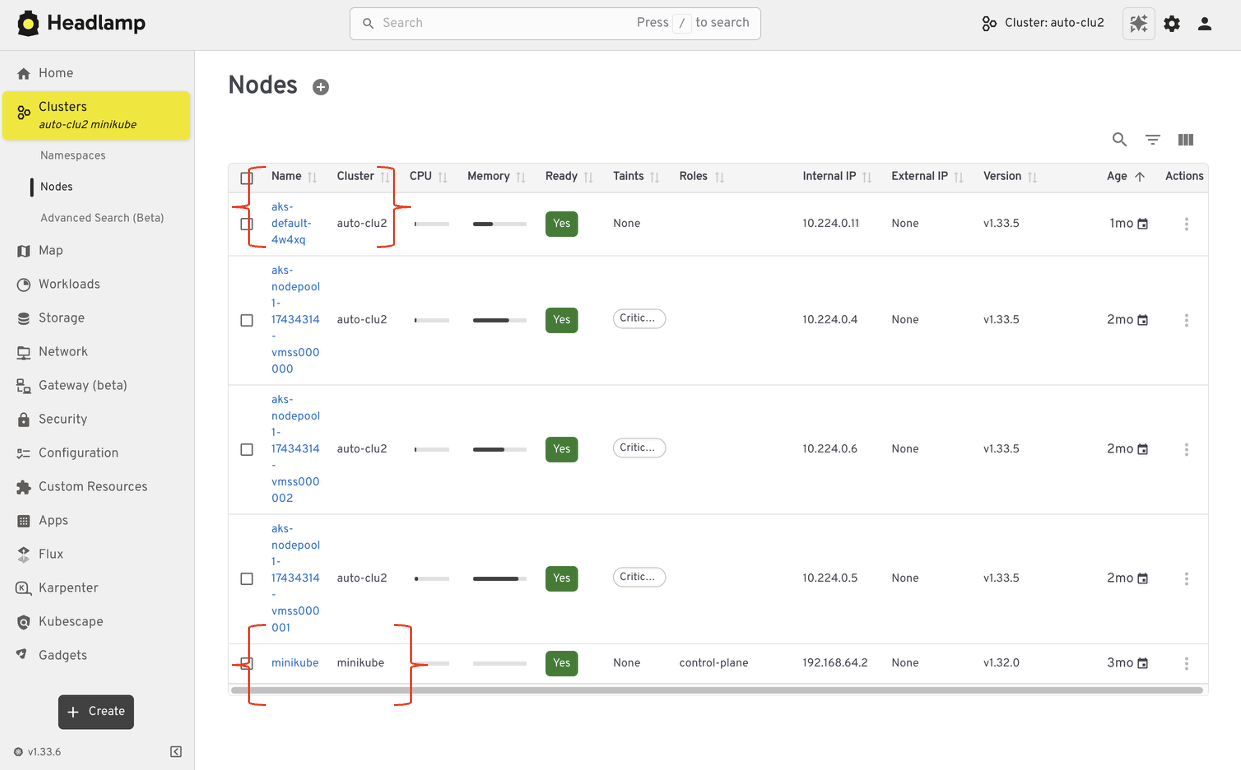

从单集群扩展到多集群工作流程

Kubernetes Dashboard 设计为一次只处理一个集群。 这种模式在简单设置中效果很好,但随着团队采用多个环境,它变得有限制。 Headlamp 通过允许你从单个界面处理多个集群而无需切换工具或丢失上下文,扩展了这个视图。 这使得并排管理开发、暂存和生产环境变得更容易。

对于在多个地方运行 Kubernetes 的团队来说,这种转变减少了摩擦。 你可以保持方向感,并自信地在集群之间移动。

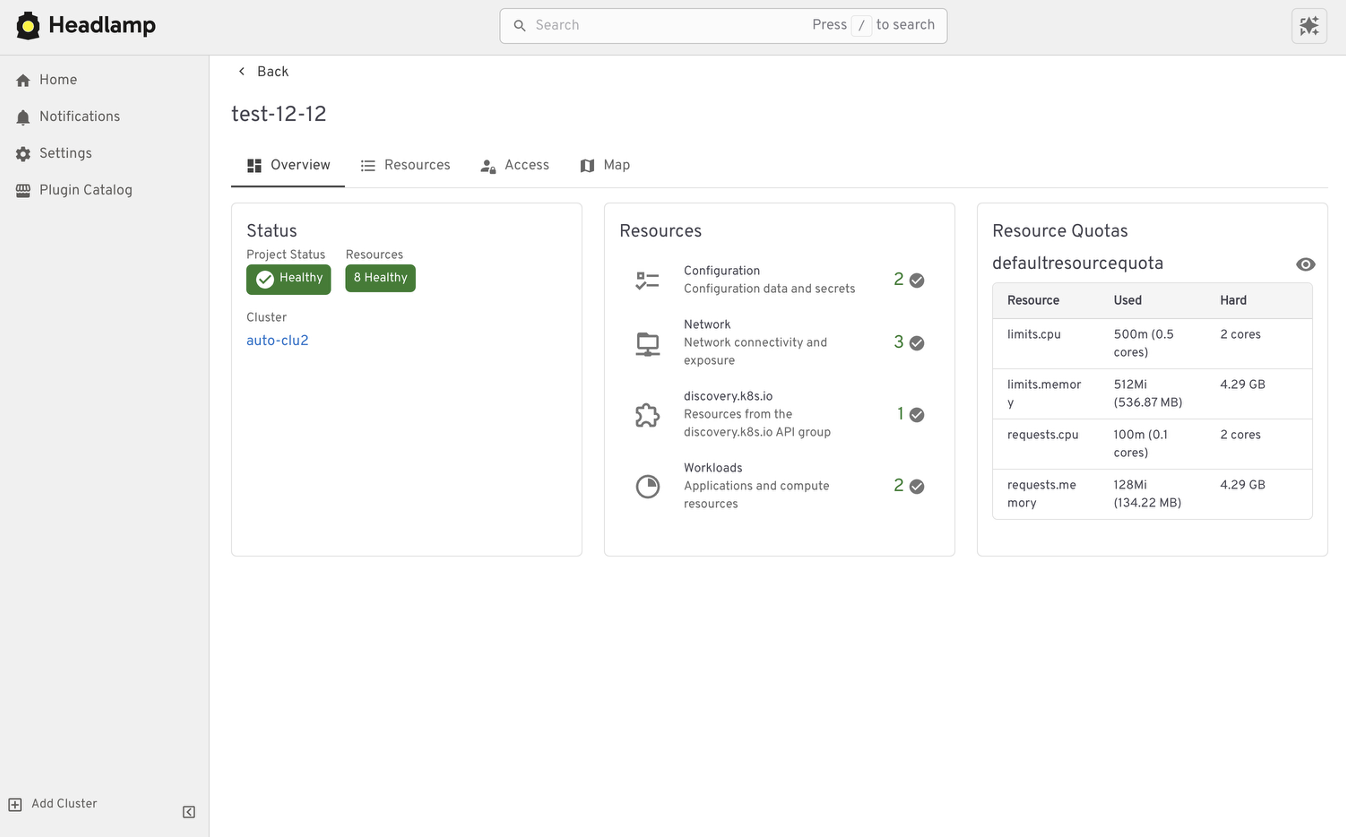

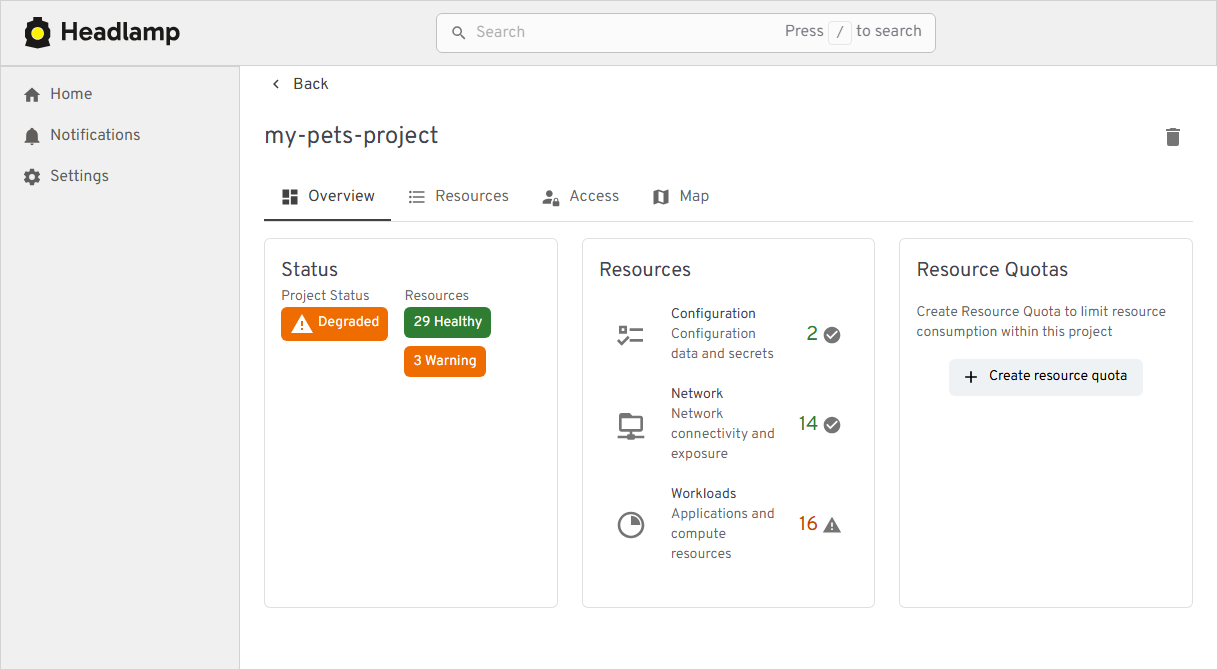

通过 Projects 从资源列表到应用上下文

Projects 为你提供了一种以应用为中心的方式来查看 Kubernetes。 你可以将相关的工作负载、服务和支持资源分组到一个地方,而不是在列表之间跳转。这使应用更容易理解。 你可以看到哪些资源属于一起,在上下文中跟踪更改,并在不逐个扫描集群的情况下进行故障排除。

Projects 建立在原生 Kubernetes 概念之上。 Namespaces、labels 和 RBAC 继续以它们一贯的方式工作。 Headlamp 添加了一个视觉层,将相关资源聚集在一起。

Projects 是可选的。当适合你的任务时,你仍然可以在单个资源级别工作。 当你需要更多上下文时,Projects 帮助你退一步看到更大的图景。

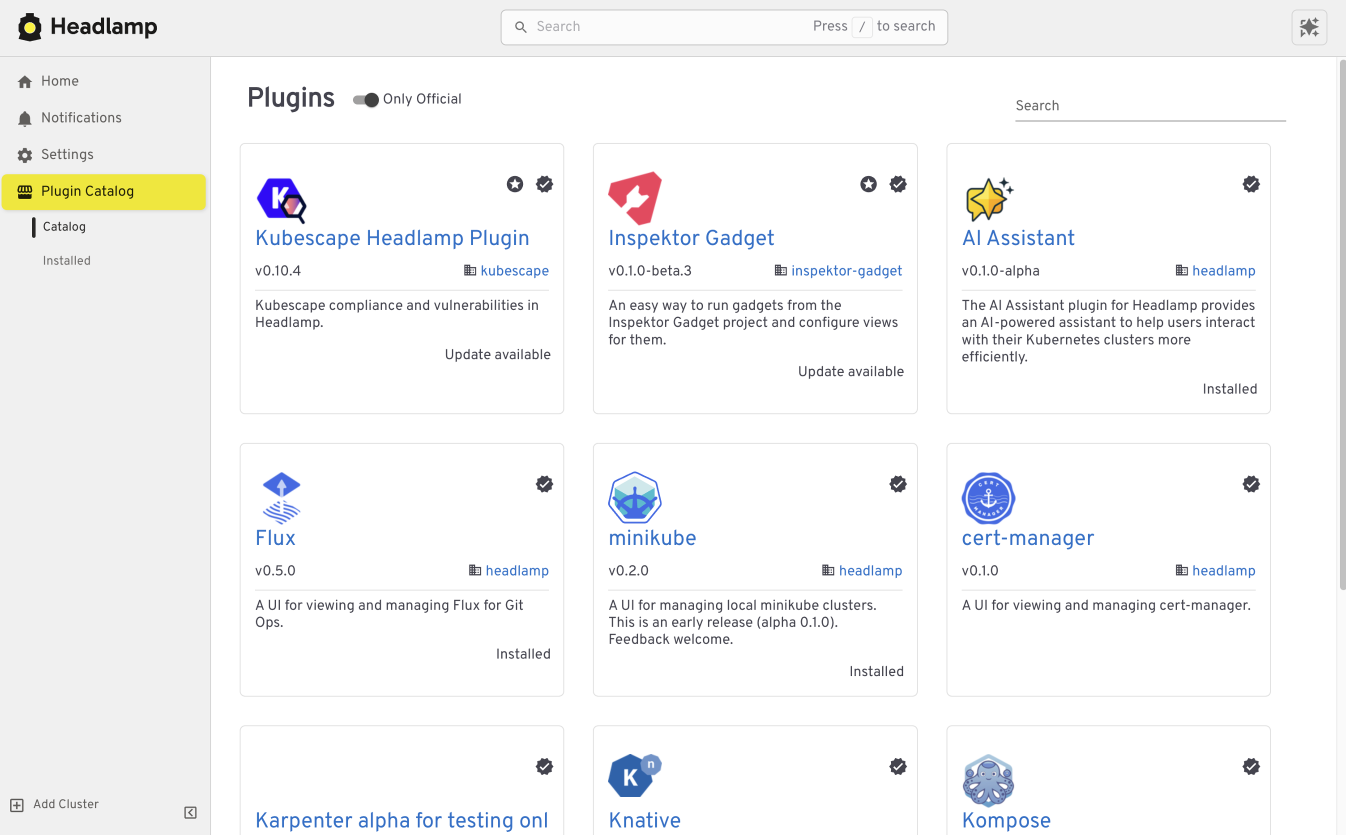

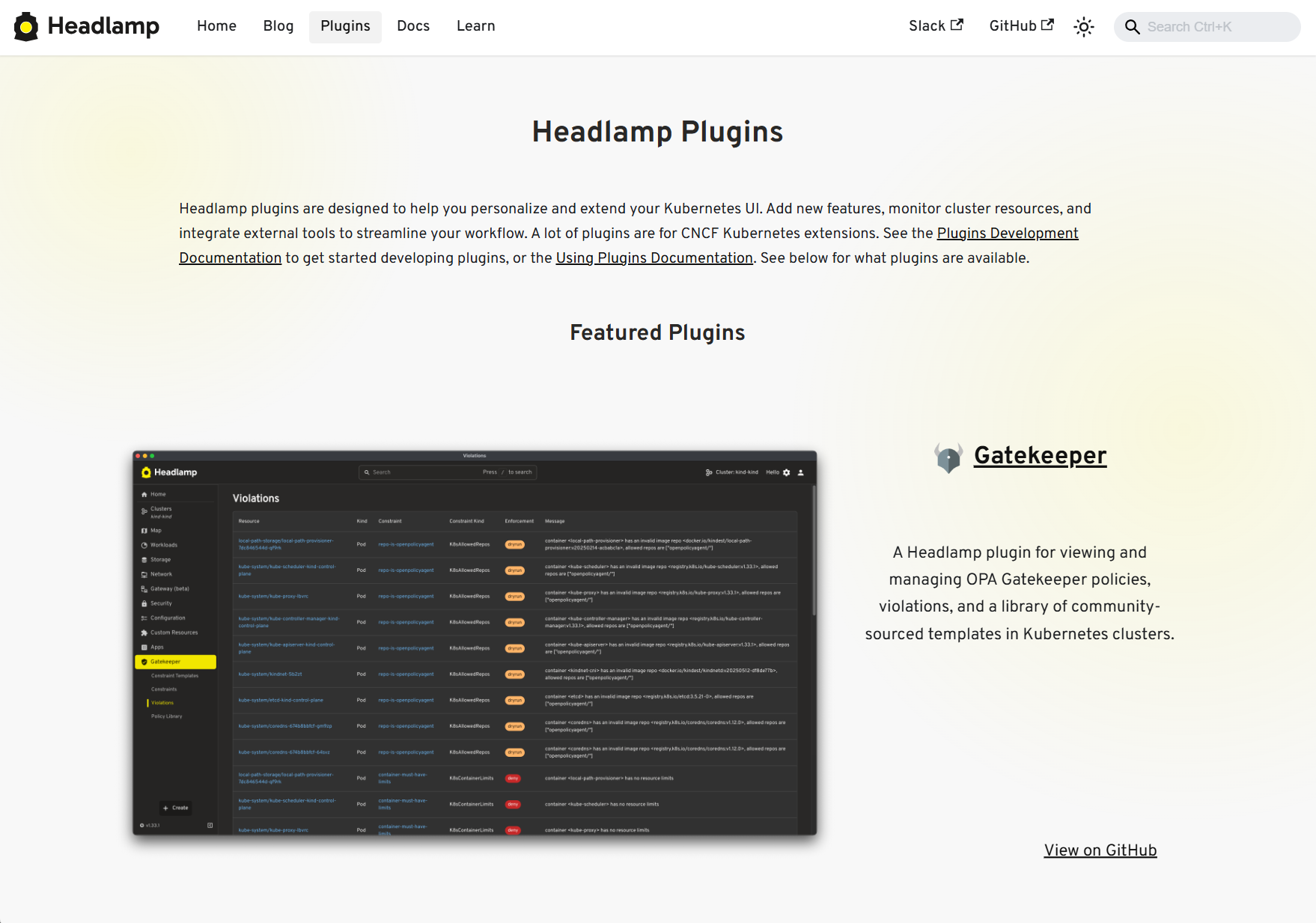

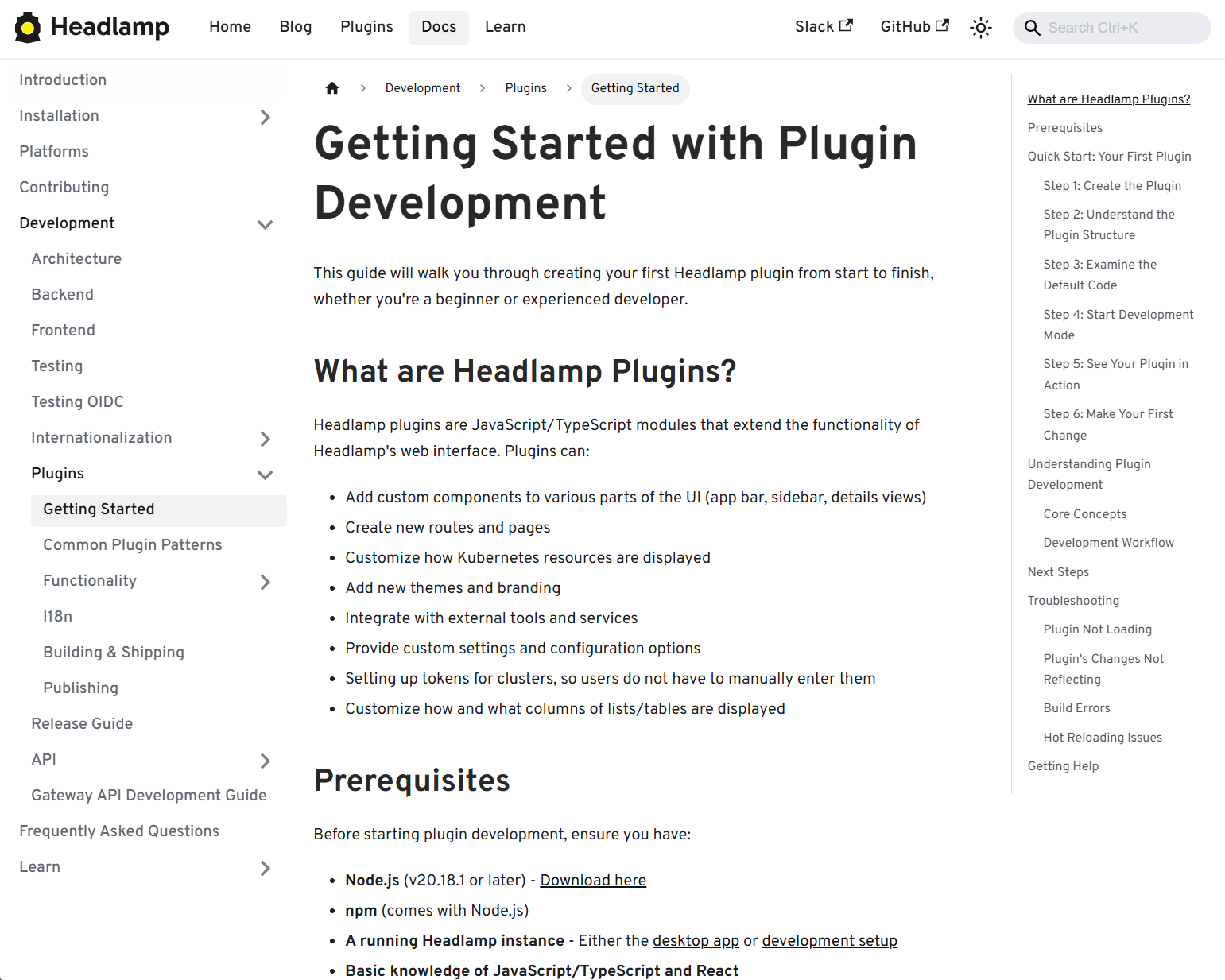

使用插件扩展 Headlamp UI

Headlamp 可以通过插件扩展,这些插件将常见工作流程直接带入 UI。 你可以在一个地方使用相同的上下文工作,而无需切换工具。

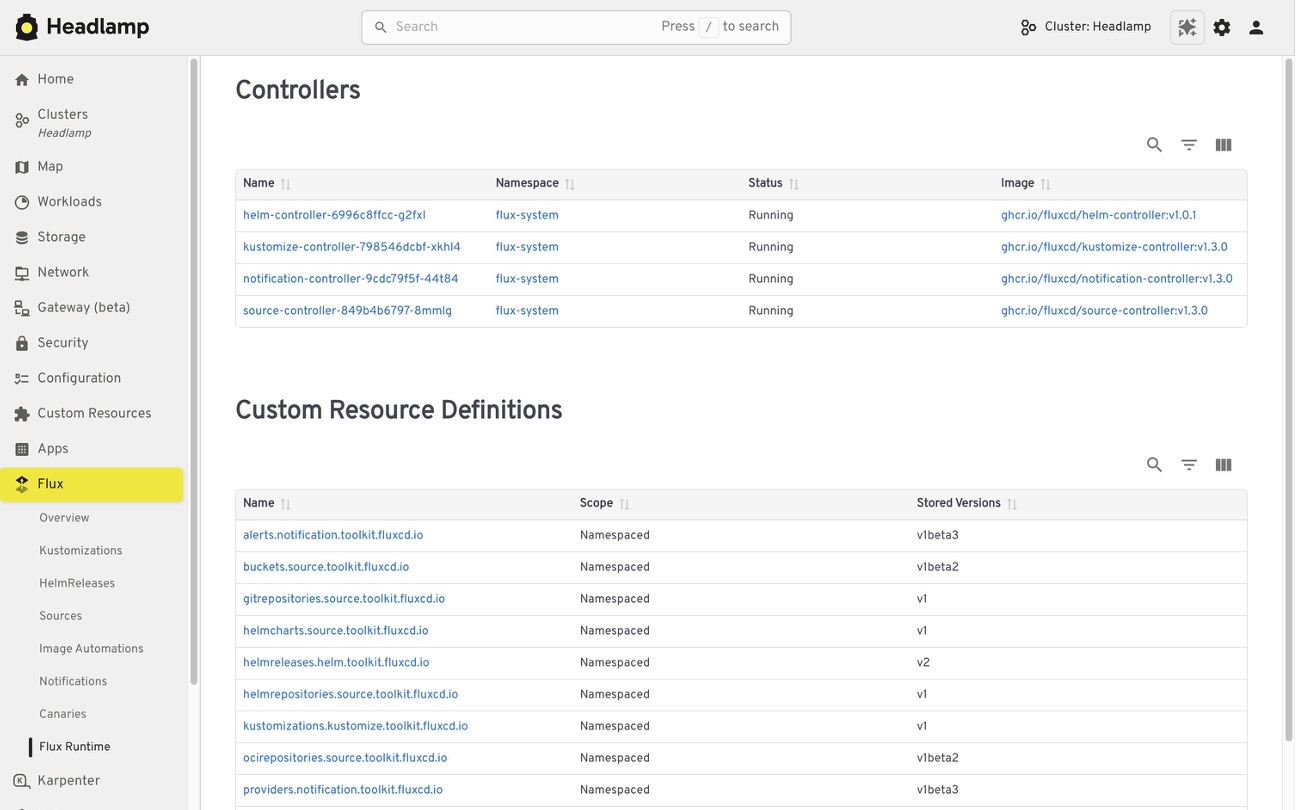

例如,Flux 插件将 GitOps 工作流程带入 Headlamp。 它允许团队在 Flux 管理的 Kubernetes 资源旁边查看应用状态, 使理解 Git 中的更改如何与集群中运行的内容相关变得更容易。

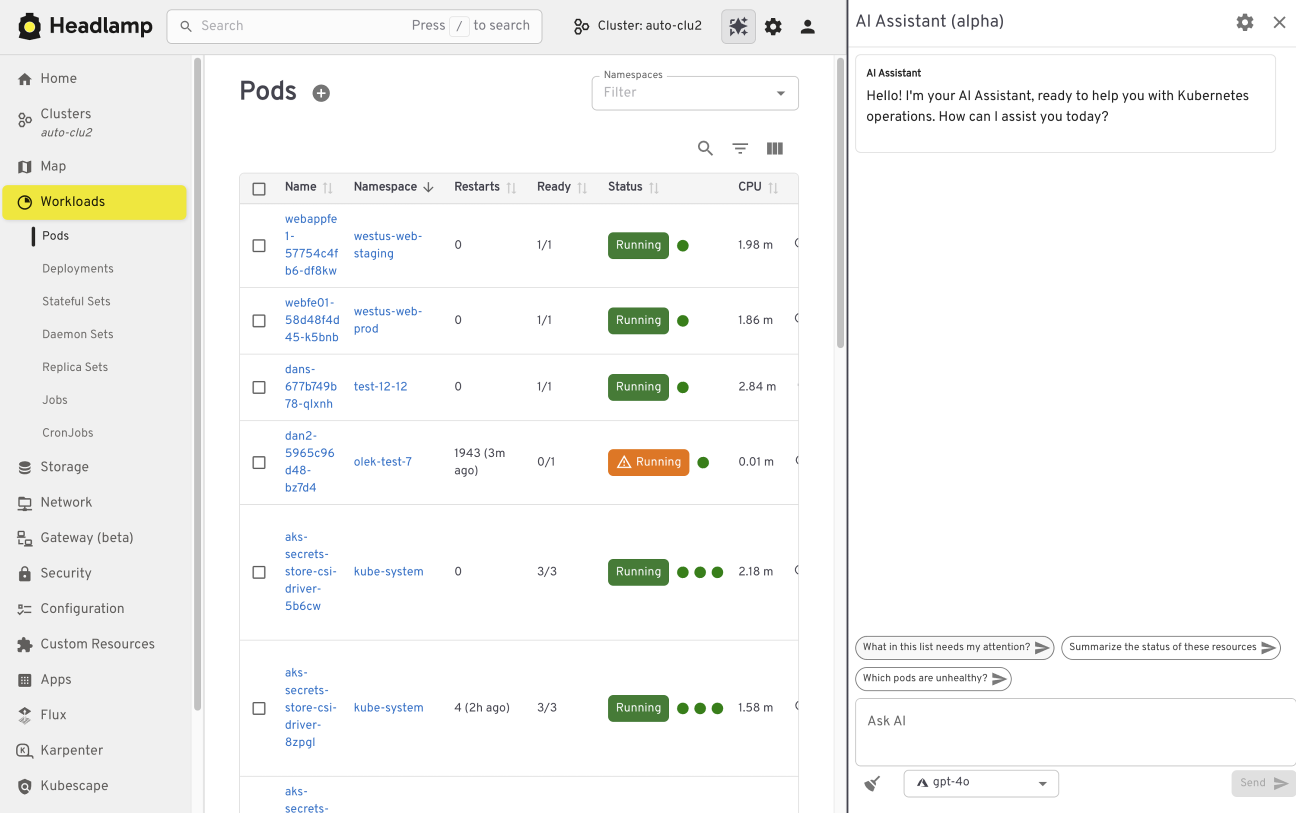

AI Assistant 遵循类似的模式。它在 UI 中添加了一个对话层, 帮助用户理解他们所看到的内容、排除问题或采取行动。 所有这些都发生在问题出现的同一个屏幕上。

构建自己的插件

插件是可选的,不限于社区构建的扩展。平台和项目团队也可以创建自己的插件。 这允许组织添加符合其特定工作流程和内部工具的自定义集成,同时保持用户体验的一致性。

选择 Headlamp 的运行方式和位置

Headlamp 为团队提供了使用 Kubernetes UI 的灵活性。 你可以直接在集群中运行它,将其用作桌面应用,或根据需要结合两种方法。

在集群内运行 Headlamp 适用于共享环境。 它提供了一个集中管理的 UI,具有受控访问权限,并自然地融入 Kubernetes 设置, 遵循与其他集群内组件相同的认证和 RBAC 规则。

桌面应用通常更适合本地开发和入职培训。 当你需要从一个地方管理多个集群时,它也很有效。 用户可以使用现有的 kubeconfig 连接,而无需在集群中部署任何东西。

这些选项不是相互排斥的。许多团队使用桌面应用进行日常工作,同时依赖集群内部署用于共享或生产环境。

准备迁移

在从 Kubernetes Dashboard 迁移到 Headlamp 之前, 停下来评估一下你今天如何使用 Dashboard 可能会有所帮助。 提前进行一些思考可以大大有助于使过渡感觉顺畅和熟悉。

首先记录你访问的集群和命名空间以及认证如何工作。 Headlamp 依赖标准的 Kubernetes 认证和 RBAC。 在大多数情况下,现有的访问模型无需更改即可延续。 如果用户已经使用 kubeconfig 文件或服务账户连接,他们将能够在 Headlamp 中访问相同的资源。

思考对你的团队最重要的工作流程也很有用。 一些用户依赖 Dashboard 进行快速检查或故障排除,而另一些用户则用它进行轻量级编辑或验证。 Headlamp 支持这些相同的工作流程,并在此基础上添加可选功能。 了解你今天依赖什么有助于使过渡感觉可预测并建立信心。

如果你想在迁移前探索 Headlamp 或试用它,可以在 headlamp.dev 了解更多信息。

这篇博客重点介绍了理解过渡和预期内容。分步迁移指南即将推出,将详细介绍安装和迁移过程。

Kubernetes v1.36:云控制器管理器中的路由同步新指标

本文最初发布时日期有误。后来重新发布,日期为 2026 年 5 月 15 日。

Kubernetes v1.36 在位于

k8s.io/cloud-provider

的云控制器管理器(CCM)路由控制器实现中引入了一个新的 Alpha 计数器指标

route_controller_route_sync_total。此指标在每次与云提供商同步路由时递增。

基于监视的路由调谐的 A/B 测试

添加此指标是为了帮助运维人员验证在

Kubernetes v1.35

中引入的 CloudControllerManagerWatchBasedRoutesReconciliation 特性门控。

此特性门控将路由控制器从固定间隔循环切换为基于监视的方法,仅在节点实际发生变化时进行调谐。

这减少了对基础设施提供商的不必要 API 调用,降低了速率限制 API 的压力,

并允许运维人员更高效地使用其可用配额。

要对此进行 A/B 测试,请比较特性门控禁用(默认)与启用时的 route_controller_route_sync_total。

在节点变化不频繁的集群中,开启特性门控后,你应该会看到同步速率显著下降。

示例:预期行为

特性门控禁用时(默认的固定间隔循环),无论是否发生任何节点变化,计数器都会稳定递增:

# After 10 minutes with no node changes

route_controller_route_sync_total 60

# After 20 minutes, still no node changes

route_controller_route_sync_total 120

特性门控启用时(基于监视的调和),仅在节点实际被添加、移除或更新时,计数器才会递增:

# After 10 minutes with no node changes

route_controller_route_sync_total 1

# After 20 minutes, still no node changes — counter unchanged

route_controller_route_sync_total 1

# A new node joins the cluster — counter increments

route_controller_route_sync_total 2

这种差异在节点很少变化的稳定集群中尤其明显。

我在哪里可以提供反馈?

如果你有反馈,欢迎通过以下任一渠道联系我们:

- Kubernetes Slack 上的 #sig-cloud-provider 频道

- GitHub 上的 KEP-5237 Issue

- SIG Cloud Provider 社区页面了解其他沟通渠道

我如何了解更多?

有关更多详细信息,请参阅 KEP-5237。

Kubernetes v1.36:混合版本代理升级到 Beta

早在 Kubernetes 1.28 中,

我们在之前的博客文章中引入了

Mixed Version Proxy (MVP) 作为 Alpha 特性(在特性门控 UnknownVersionInteroperabilityProxy 下)。

目标简单但关键:通过确保对旧版 API 服务器尚不了解的资源请求被正确路由到较新的对等 API 服务器,

而不是返回不正确的 404 Not Found,从而使集群升级更安全。

我们很高兴地宣布,Mixed Version Proxy 将在 Kubernetes 1.36 中升级到 Beta 版本, 并将默认启用!该特性自首次发布以来有了显著发展,解决了关键差距并实现了架构现代化。

以下介绍该特性的发展历程以及在集群中使用它需要了解的内容。

我们正在解决什么问题?

在正在升级的高可用控制平面中,你通常会有运行不同版本的 API 服务器。

这些服务器可能提供不同的 API 集(Groups、Versions、Resources)。

没有 MVP,如果客户端请求落在不提供所请求资源的 API 服务器上(例如,升级中引入的新 API 版本),

该服务器会返回 404 Not Found。这在技术上是不正确的,因为资源在集群中是可用的,

只是不在该特定服务器上。这可能导致严重的副作用,例如错误的垃圾收集或命名空间删除被阻止。

MVP 通过将请求代理到能够提供该资源的对等 API 服务器来解决这个问题。

sequenceDiagram

participant Client

participant API_Server_A as API Server A (Older/Different)

participant API_Server_B as API Server B (Newer/Capable)

Client->>API_Server_A: 1. Request for Resource (e.g., v2)

Note over API_Server_A: Determines it cannot serve locally

API_Server_A->>API_Server_A: 2. Looks up capable peer in Discovery Cache

API_Server_A->>API_Server_B: 3. Proxies request (adds x-kubernetes-peer-proxied header)

API_Server_B->>API_Server_B: 4. Processes request locally

API_Server_B-->>API_Server_A: 5. Returns Response

API_Server_A-->>Client: 6. Forwards Response

自 1.28 以来的发展

最初的 Alpha 实现是一个很好的概念证明,但它有一些局限性并且依赖于旧机制。 以下是我们为 Beta 版本进行现代化改进的方式:

- 从 StorageVersion API 到聚合发现

在 Alpha 版本中,API 服务器依赖

StorageVersion API来确定哪些对等服务器提供哪些资源。 虽然功能正常,但这种方法有一个显著的局限性:StorageVersion API尚不支持 CRD 和聚合 API。 对于 Beta 版本,我们用Aggregated Discovery取代了对StorageVersion API调用的依赖。 API 服务器现在使用聚合发现数据来动态了解其对等服务器的能力。

- 缺失的部分:对等聚合发现

1.28 博客文章指出了一个显著的差距:

虽然我们可以代理资源请求,但发现请求仍然只显示本地 API 服务器知道的内容。

在 1.36 中,我们添加了

Peer-Aggregated Discovery支持! 现在,当客户端执行发现(例如,列出可用的 API)时,API 服务器会将其本地视图与所有活动对等服务器的发现数据合并。 这为客户端提供了整个集群中所有可用 API 的完整、统一视图,无论它们连接到哪个 API 服务器。

sequenceDiagram

participant Client

participant API_Server_A as API Server A

participant API_Server_B as API Server B

Client->>API_Server_A: 1. Request Discovery Document

API_Server_A->>API_Server_A: 2. Gets Local APIs

API_Server_A->>API_Server_B: 3. Gets Peer APIs (Cached or Direct)

API_Server_A->>API_Server_A: 4. Merges and sorts lists deterministically

API_Server_A-->>Client: 5. Returns Unified Discovery Document

虽然对等聚合发现将是默认行为(请注意,如果设置了 --peer-ca-file 标志,

则启用对等聚合发现,否则服务器将回退到仅显示其本地 API),但在某些情况下,

你可能需要只检查你连接的特定 API 服务器提供的资源。

你可以通过在请求的 Accept 头中包含 profile=nopeer

参数来请求此非聚合视图(例如,Accept: application/json;g=apidiscovery.k8s.io;v=v2;as=APIGroupDiscoveryList;profile=nopeer)。

必需的配置

虽然特性门控将默认启用,但它需要设置某些标志以允许对等 API 服务器之间的安全通信。 要正常工作,请确保你的 API 服务器配置了以下标志:

--feature-gates=UnknownVersionInteroperabilityProxy=true:这在 1.36 中将是默认值,但最好进行验证--peer-ca-file=<path-to-ca>:[CRITICAL] 这是必需的标志。 你必须提供源 API 服务器将用于验证目标对等 API 服务器服务证书的 CA 包。没有这个,代理将因 TLS 验证错误而失败。--peer-advertise-ip和--peer-advertise-port:这些标志用于设置对等服务器应使用的网络地址来访问此 API 服务器。 如果未设置,则使用--advertise-address或--bind-address的值。 如果你的网络拓扑复杂,API 服务器通过特定内部接口通信,强烈建议显式设置这些标志。

使用 kubeadm 配置

如果你使用 kubeadm 管理集群,可以在 ClusterConfiguration 文件中配置这些标志:

apiVersion: kubeadm.k8s.io/v1beta4

kind: ClusterConfiguration

apiServer:

extraArgs:

peer-ca-file: "/etc/kubernetes/pki/ca.crt"

# `eer-advertise-ip 和端口(如果需要)

行动号召

如果你运行多主集群并定期升级它们,Mixed Version Proxy 是一项重大的安全改进。 随着它在 1.36 中成为默认功能,我们鼓励你:

- 检查你的 API 服务器标志,确保

--peer-ca-file已正确设置。 - 在准备 1.36 升级时,在你的暂存环境中测试此功能。

- 向 SIG API Machinery 提供反馈(Slack、 邮件列表, 或通过参加 SIG API Machinery 会议) 分享你的体验。

Kubernetes v1.36:Service ExternalIPs 的弃用和移除

Service 的

.spec.externalIPs 字段是为非云集群提供类似云负载均衡器功能的早期尝试。

不幸的是,该 API 假设集群中的每个用户都是完全可信的,

而在任何不满足此条件的情况下,它会导致各种安全漏洞,

如 CVE-2020-8554 中所述。

自 Kubernetes 1.21 起,Kubernetes 项目建议所有用户禁用 .spec.externalIPs。

为了简化这一过程,Kubernetes 还添加了一个准入控制器(DenyServiceExternalIPs),

可以启用它来实现此目的。当时,SIG Network 认为默认阻止该特性是一个太大的破坏性变更,不予考虑。

然而,安全问题仍然存在,作为一个项目,我们对该特性"默认不安全"的状态越来越不满意。 此外,对于想要类似负载均衡器功能的非云集群,现在有几种更好的替代方案。

因此,Service 的 .spec.externalIPs 字段现在在 Kubernetes 1.36 中正式弃用。

我们预计 Kubernetes 的未来次要版本将从 kube-proxy 中删除该行为的实现,

并更新 Kubernetes 一致性标准,

要求一致性实现不提供支持。

关于术语的说明,以及未被弃用的内容

短语 external IP 在 Kubernetes 中有些过度使用:

- Service API 有一个字段

.spec.externalIPs,可用于添加 Service 将响应的额外 IP 地址。

- Node API 的

.status.addresses字段可以列出几种不同类型的地址,其中一种称为ExternalIP。

kubectl工具在以默认输出格式显示 LoadBalancer 类型的 Service 信息时, 会在列标题EXTERNAL-IP下显示负载均衡器 IP 地址。

此弃用是关于第一项的。如果你没有在任何 Service 中设置 externalIPs 字段,则这不适用于你。

话虽如此,作为预防措施,你可能仍希望启用

DenyServiceExternalIPs

准入控制器来阻止将来对 externalIPs 字段的任何使用。

externalIPs 的替代方案

如果你正在使用 .spec.externalIPs,那么有几种替代方案。

考虑如下的 Service:

apiVersion: v1

kind: Service

metadata:

name: my-example-service

spec:

type: ClusterIP

selector:

app.kubernetes.io/name: my-example-app

ports:

- protocol: TCP

port: 80

targetPort: 8080

externalIPs:

- "192.0.2.4"

使用手动管理的 LoadBalancer Service 代替 externalIPs

最简单(但也最糟糕)的选择是从使用 externalIPs 切换到使用 type: LoadBalancer 服务,

并手动分配负载均衡器 IP。这本质上与 externalIPs 完全相同,

但有一个重要区别:负载均衡器 IP 是 Service 的 .status 的一部分,

而不是 .spec,在启用 RBAC 的集群中,默认情况下普通用户无法编辑它。

因此,这种 externalIPs 的替代方案仅对管理员授予权限的用户可用

(尽管这些用户随后将完全有能力复制 CVE-2020-8554;

仍然不会有任何进一步的检查来确保一个用户没有窃取另一个用户的 IP 等)。

由于 .status 在 Kubernetes 中的工作方式,你必须创建不带负载均衡器 IP 的 Service,

然后在第二步添加 IP:

$ cat loadbalancer-service.yaml

apiVersion: v1

kind: Service

metadata:

name: my-example-service

spec:

# prevent any real load balancer controllers from managing this service

# by using a non-existent loadBalancerClass

loadBalancerClass: non-existent-class

type: LoadBalancer

selector:

app.kubernetes.io/name: my-example-app

ports:

- protocol: TCP

port: 80

targetPort: 8080

$ kubectl apply -f loadbalancer-service.yaml

service/my-example-service created

$ kubectl patch service my-example-service --subresource=status --type=merge -p '{"status":{"loadBalancer":{"ingress":[{"ip":"192.0.2.4"}]}}}'

使用非云负载均衡器控制器

虽然 LoadBalancer 服务最初设计为由云负载均衡器支持,

但 Kubernetes 也可以通过使用第三方负载均衡器控制器(如 MetalLB)

在非云平台上支持它们。

这解决了与 externalIPs 相关的安全问题,因为管理员可以配置控制器将分配给服务的 IP 地址范围,

并且控制器将确保两个服务不能同时使用同一个 IP。

因此,例如,在安装和 配置 MetalLB 后, 集群管理员可以配置集群中使用的 IP 地址池:

apiVersion: metallb.io/v1beta1

kind: IPAddressPool

metadata:

name: production

namespace: metallb-system

spec:

addresses:

- 192.0.2.0/24

autoAssign: true

avoidBuggyIPs: false

之后,用户可以创建 type: LoadBalancer Service,MetalLB 将处理 IP 地址的分配。

MetalLB 甚至支持 Service 中已弃用的 loadBalancerIP 字段,

因此最终用户可以请求特定的 IP(假设可用)以实现与 externalIPs 方法的向后兼容性,

而不是随机分配一个:

apiVersion: v1

kind: Service

metadata:

name: my-example-service

spec:

type: LoadBalancer

selector:

app.kubernetes.io/name: my-example-app

ports:

- protocol: TCP

port: 80

targetPort: 8080

loadBalancerIP: "192.0.2.4"

类似的方法也适用于其他负载均衡器控制器。 这种方法允许集群管理员控制分配哪些 IP 地址,而不是由用户控制。

使用 Gateway API

另一个可能的解决方案是使用 Gateway API 的实现。

Gateway API 允许集群管理员定义 Gateway 资源,

该资源可以通过 .spec.addresses 字段附加 IP 地址。

由于 Gateway 资源设计为由集群管理员管理,

因此可以设置 RBAC 规则,仅允许特权用户管理它们。

示例如下:

apiVersion: gateway.networking.k8s.io/v1

kind: Gateway

metadata:

name: example-gateway

spec:

gatewayClassName: example-gateway-class

addresses:

- type: IPAddress

value: "192.0.2.4"

---

apiVersion: gateway.networking.k8s.io/v1

kind: HTTPRoute

metadata:

name: example-route

spec:

parentRefs:

- name: example-gateway

rules:

- backendRefs:

- name: example-svc

port: 80

---

apiVersion: v1

kind: Service

metadata:

name: example-svc

spec:

type: ClusterIP

selector:

app.kubernetes.io/name: example-app

ports:

- protocol: TCP

port: 80

targetPort: 8080

Gateway API 项目是 Kubernetes 中 Kubernetes Ingress、负载均衡和服务网格 API 的下一代。 Gateway API 旨在修复 Service 和 Ingress 资源的缺点, 使其成为正在积极开发的非常可靠的稳健解决方案。

externalIPs 弃用时间表

此弃用的粗略时间表如下:

- 随着 Kubernetes 1.36 的发布,该字段被弃用; 当用户使用此字段时,Kubernetes 现在会发出警告

- 大约一年后(最早为 v1.40),对

.spec.externalIPs的支持将在 kube-proxy 中被禁用, 但用户将有一种方法可以选择重新启用,以便他们需要更多时间进行迁移 - 大约再过一年后(最早为 v1.43),支持将被完全禁用;用户将无法选择重新启用

Kubernetes v1.36:工作负载感知调度再进一步

AI/ML 和批处理工作负载带来了独特的调度挑战,已经超出了简单逐个 Pod 调度的范畴。 在 Kubernetes v1.35 中,我们引入了首批工作负载感知调度改进, 其中包括基础性的 Workload API、基于 Pod 框架构建的基本编组调度支持, 以及用于高效处理相同 Pod 的机会性批处理特性。

Kubernetes v1.36 通过清晰分离 API 关注点,引入了一项重要的架构演进:

Workload API 充当静态模板,而新的 PodGroup API 负责处理运行时状态。

为了支持这一点,kube-scheduler 提供了新的 PodGroup 调度周期,

支持以原子方式处理工作负载,并为未来增强铺平道路。

此版本还首次推出了拓扑感知调度和工作负载感知抢占的初始迭代,以推进调度能力。

此外,工作负载的 ResourceClaim 支持为 PodGroup 解锁了动态资源分配

(DRA)。

最后,为了展示其面向真实场景的就绪程度,v1.36 交付了 Job 控制器与新 API 集成的第一阶段。

Workload 和 PodGroup API 更新

Workload API 现在用作静态模板,而新的 PodGroup API 描述运行时对象。

Kubernetes v1.36 将 Workload 和 PodGroup API 作为

scheduling.k8s.io/v1alpha2 API 组的一部分引入,

完全替代此前的 v1alpha1 API 版本。

在 v1.35 中,Pod 组及其运行时状态嵌入在 Workload 资源中。 新模型解耦了这些概念:Workload 现在充当静态模板对象, 而 PodGroup 负责管理运行时状态。 这种分离也提升了性能和可扩缩性,因为 PodGroup API 允许按副本对状态更新进行分片。

由于 Workload API 仅作为模板存在,kube-scheduler 的逻辑得以简化。

调度器可以直接读取 PodGroup;PodGroup 包含调度器所需的全部信息,

因此调度器无需监视或解析 Workload 对象本身。

更新后的配置如下所示。工作负载控制器(例如 Job 控制器) 定义 Workload 对象,而这个对象现在充当 Pod 组的静态模板:

apiVersion: scheduling.k8s.io/v1alpha2

kind: Workload

metadata:

name: training-job-workload

namespace: some-ns

spec:

# Pod 组现在定义为模板,

# 其中包含 PodGroup 对象的 spec 字段。

podGroupTemplates:

- name: workers

schedulingPolicy:

gang:

# 仅当 4 个 Pod 可以同时运行时,此 gang 才可调度

minCount: 4

随后,控制器基于这些模板生成运行时 PodGroup 实例。 PodGroup 运行时对象保存实际的调度策略,并引用创建它所用的模板。 它还包含一个状态字段,其中的状况会映射各个 Pod 的状态, 反映这个组的整体调度状态:

apiVersion: scheduling.k8s.io/v1alpha2

kind: PodGroup

metadata:

name: training-job-workers-pg

namespace: some-ns

spec:

# PodGroup 引用其来源 Workload 模板。

# 相比之下,.metadata.ownerReferences 指向“真正的”工作负载对象,

# 例如 Job。

podGroupTemplateRef:

workload:

workloadName: training-job-workload

podGroupTemplateName: workers

# 实际的调度策略放在运行时 PodGroup 中

schedulingPolicy:

gang:

minCount: 4

status:

# status 包含映射各个 Pod 状况的状况信息。

conditions:

- type: PodGroupScheduled

status: "True"

lastTransitionTime: 2026-04-03T00:00:00Z

最后,为了将这一新架构与各个 Pod 衔接起来,Pod API 中的 workloadRef 字段已被

schedulingGroup 字段替代。创建 Pod 时,你可以将它们直接关联到运行时 PodGroup:

apiVersion: v1

kind: Pod

metadata:

name: worker-0

namespace: some-ns

spec:

# workloadRef 字段已被 schedulingGroup 替代

schedulingGroup:

podGroupName: training-job-workers-pg

...

通过将 Workload 保持为静态模板,并将 PodGroup 提升为一等、独立的 API, 我们为在未来 Kubernetes 版本中构建高级工作负载调度能力奠定了坚实基础。

PodGroup 调度周期和编组调度

为了高效管理这些工作负载,kube-scheduler 现在提供了专用的 PodGroup 调度周期。 调度器不再逐个 Pod 顺序评估和预留资源,因为这种方式存在调度死锁风险; 它会把整个组作为一个统一操作来评估。

当调度器从调度队列中弹出某个 PodGroup 成员时,无论该组使用哪种具体策略, 它都会获取该组中其余已排队的 Pod,以确定性方式对它们排序, 并按如下方式执行一个原子的调度周期:

调度器对集群状态获取一次快照,以避免竞态条件,并确保在评估整个组时保持一致性。

随后,调度器尝试使用 PodGroup 调度算法为组内所有 Pod 找到有效的 Node 放置方案; 该算法会利用标准的基于 Pod 的过滤和评分阶段。

根据算法结果,调度决策会以原子方式应用到整个 PodGroup。

成功:如果找到了放置方案且满足组约束,可调度的成员 Pod 会一起直接进入绑定阶段。 其余仍不可调度的 Pod 会返回调度队列,等待可用资源,以便之后加入已调度的 Pod。

(注意:如果在某些 Pod 已经调度后,又有新的 Pod 添加到 PodGroup, 这个周期会在考虑已有 Pod 的同时评估新 Pod。 关键在于,已经分配到 Node 的 Pod 会继续运行。 即使该组在后续周期中未能满足其要求,调度器也不会取消分配或驱逐这些 Pod。)

失败:如果该组未能满足其要求,整个组会被视为不可调度。 不会绑定任何 Pod,这些 Pod 会返回调度队列,并在退避期之后稍后重试。

这个周期是编组调度的基础。

当你的工作负载需要严格的全有或全无放置时,

gang 策略会利用这个周期,防止部分部署造成资源浪费和潜在死锁。

虽然调度器仍会在满足 minCount 要求之前将 Pod 保留在 PreEnqueue 中,

但实际调度阶段现在完全依赖新的 PodGroup 周期。

具体而言,在算法执行期间,调度器会验证可调度 Pod 的数量是否满足 minCount。

如果集群无法容纳所需的最小数量,则不会绑定任何 Pod。

该组调度失败,并等待释放出足够资源。

局限性

PodGroup 调度周期的首个版本存在一些局限性:

对于基本的同构 Pod 组(即所有 Pod 具有相同调度要求, 且不存在亲和性、反亲和性或拓扑分布约束等 Pod 间依赖的 Pod 组), 如果存在可行的放置方案,算法预计能够找到它。

对于异构 Pod 组,即使存在有效的放置方案,也不保证一定能找到, 哪怕这个方案看起来很简单。

对于存在 Pod 间依赖的 Pod 组,即使存在有效的放置方案,也不保证一定能找到。

除上述情况外,对于涉及组内依赖的场景 (例如某个 Pod 的可调度性通过 Pod 间亲和性依赖于另一个组成员), 由于该算法采用确定性的处理顺序,无论集群状态如何,都可能无法找到放置方案。

拓扑感知调度

对于 AI/ML 训练或批处理这类复杂分布式工作负载,将 Pod 随机放置到整个集群中 可能引入显著的网络延迟,并成为整体性能瓶颈。

拓扑感知调度通过允许你直接在 PodGroup 上定义拓扑约束来解决这个问题, 确保其 Pod 被共同放置在特定的物理或逻辑域内:

apiVersion: scheduling.k8s.io/v1alpha2

kind: PodGroup

metadata:

name: topology-aware-workers-pg

spec:

schedulingPolicy:

gang:

minCount: 4

# 强制 Pod 根据机架拓扑共同放置

schedulingConstraints:

topology:

- key: topology.kubernetes.io/rack

在这个示例中,kube-scheduler 会尝试将 Pod 调度到符合 rack 拓扑约束的多种 Node 组合上。

随后,它会根据 PodGroup 利用资源的效率,以及在该域内可以成功调度多少 Pod,

选择最优放置方案。

为实现这一点,调度器用一个专用的、基于放置方案的算法扩展了 PodGroup 调度周期; 该算法包含三个阶段:

根据组的调度约束生成候选放置方案 (理论上适合分配给 PodGroup 的 Node 子集)。 拓扑感知调度插件使用新的

PlacementGenerate扩展点创建这些放置方案。评估每个候选放置方案,确认整个 PodGroup 是否实际能够放入其中。

对所有可行的放置方案打分,为 PodGroup 选择最合适的方案。 拓扑感知调度插件使用新的

PlacementScore扩展点对这些放置方案进行打分。

目前,拓扑感知调度不会触发 Pod 抢占来满足约束。 不过,我们计划在即将到来的版本中,将工作负载感知抢占与拓扑约束集成起来。

虽然 Kubernetes v1.36 交付了这一基础性的拓扑感知调度能力,

Kubernetes 项目计划很快扩展其能力。

未来更新将引入对多级拓扑、软约束(偏好)的支持,

与动态资源分配(DRA)的更深度集成,

以及在与 basic 调度策略配合使用时更稳健的行为。

工作负载感知抢占

为了支持新的 PodGroup 调度周期,Kubernetes v1.36 引入了一种新的抢占机制, 称为工作负载感知抢占。 当某个 PodGroup 无法调度时,调度器会利用这一机制尝试让该 PodGroup 的调度成为可能。

与标准逐个 Pod 调度周期中使用的默认抢占相比,这种新机制会将整个 PodGroup 视为单个抢占者单元。 它不会在每个 Node 上单独评估抢占牺牲者,而是在整个集群范围内搜索。 这允许调度器同时从多个 Node 抢占 Pod, 从而为随后调度整个 PodGroup 腾出足够空间。

工作负载感知抢占还直接向 PodGroup API 引入了两个额外概念:

PodGroup

priority:覆盖构成 PodGroup 的各个 Pod 的优先级。PodGroup

disruptionMode:指定 PodGroup 中的 Pod 是否可以独立被抢占, 或者是否必须以全有或全无的方式一起被抢占。

在 Kubernetes v1.36 中,只有工作负载感知抢占机制会遵从这些字段。 负责这组特性的人员希望在未来版本中, 将这些字段的支持扩展到其他中断来源, 包括逐个 Pod 调度周期中使用的默认抢占。

apiVersion: scheduling.k8s.io/v1alpha2

kind: PodGroup

metadata:

name: victim-pg

spec:

priorityClassName: high-priority

priority: 1000

disruptionMode: PodGroup

在这个示例中,当调度器在工作负载感知抢占周期中将 victim-pg

作为潜在抢占牺牲者进行评估时,

它会使用 1000 作为其优先级,并以严格的全有或全无方式抢占该 PodGroup。

工作负载的 DRA ResourceClaim 支持

自 Kubernetes v1.34 正式可用以来,DRA 已经让 Pod 能够对 GPU、TPU 和 NIC 等设备 提出详细请求。所请求的设备可以由多个按名称请求同一个 ResourceClaim 的 Pod 共享。 其他请求可以通过 ResourceClaimTemplate 进行复制; 在这种情况下,Kubernetes 会为每个引用该模板的 Pod 生成一个名称非确定性的 ResourceClaim。 然而,对于需要让某些 Pod 共享某些设备的大规模工作负载, 目前仍需要自行管理各个 ResourceClaim 的创建。

现在,除了 Pod 之外,PodGroup 也可以表示 ResourceClaimTemplate 的可复制单元。

对于 PodGroup 的某个 spec.resourceClaims 所引用的 ResourceClaimTemplate,

无论组内有多少 Pod,Kubernetes 都会为整个 PodGroup 生成一个 ResourceClaim。

当 Pod 中用于 ResourceClaimTemplate 的某个 spec.resourceClaims

与其 PodGroup 中的某个 spec.resourceClaims 匹配时,

该 Pod 的申领会解析为为 PodGroup 生成的 ResourceClaim,

并且不会为这个单独的 Pod 生成 ResourceClaim。

Workload 对象中的单个 PodGroupTemplate 可以表达一种资源请求:

这种请求既会为每个不同的 PodGroup 复制,

又可由每个组内的 Pod 共享。

下面的示例展示了两个 Pod 请求同一个 ResourceClaim; 这个 ResourceClaim 是从其 PodGroup 的 ResourceClaimTemplate 生成的:

apiVersion: scheduling.k8s.io/v1alpha2

kind: PodGroup

metadata:

name: training-job-workers-pg

spec:

...

resourceClaims:

- name: pg-claim

resourceClaimTemplateName: my-claim-template

---

apiVersion: v1

kind: Pod

metadata:

name: topology-aware-workers-pg-pod-1

spec:

...

schedulingGroup:

podGroupName: training-job-workers-pg

resourceClaims:

- name: pg-claim

resourceClaimTemplateName: my-claim-template

---

apiVersion: v1

kind: Pod

metadata:

name: topology-aware-workers-pg-pod-2

spec:

...

schedulingGroup:

podGroupName: training-job-workers-pg

resourceClaims:

- name: pg-claim

resourceClaimTemplateName: my-claim-template

此外,PodGroup 通过 resourceClaimName 引用的 ResourceClaim,

或通过 resourceClaimTemplateName 生成的申领,

都会为整个 PodGroup 预留。

此前,kube-scheduler 只能在 ResourceClaim 的 status.reservedFor 字段中

列出各个 Pod,而该字段限制为 256 个条目。

现在,status.reservedFor 中的单个 PodGroup 引用可以表示远多于 256 个 Pod,

从而允许设备的高基数共享。

这些变更结合起来,使具有复杂拓扑的大规模工作负载能够利用 DRA 实现可扩缩的设备管理。

与 Job 控制器集成

在 Kubernetes v1.36 中,Job 控制器可以代表你创建和管理 Workload 与 PodGroup 对象, 因此表示紧耦合并行应用(例如分布式 AI 训练)的 Job 无需任何额外工具即可进行编组调度。 如果没有这种集成,你需要自行创建 Workload 和 PodGroup, 并将它们的引用连接到 Pod 模板中。 现在,Job 控制器以原生方式自动化了这一过程。

启用 EnableWorkloadWithJob

特性门控后,Job 控制器会自动:

为每个符合条件的 Job 创建一个 Workload 和对应的运行时 PodGroup;

在 Job 创建的每个 Pod 上设置

.spec.schedulingGroup, 使调度器将它们视为一个 gang;将 Job 设置为所生成对象的属主, 因此这些对象会在 Job 被删除时被垃圾收集。

什么时候会触发集成?

为了让首个特性迭代保持可预测,只有当 Job 具有定义明确且固定的形态时, Job 控制器才会创建 Workload 和 PodGroup:

.spec.parallelism大于 1.spec.completionMode设置为Indexed.spec.completions等于.spec.parallelismPod 模板上尚未设置

schedulingGroup

这些条件描述了编组调度可以推理的一类 Job:

每个 Pod 都具有稳定身份(Indexed),gang 的规模在准入时已知且固定

(parallelism == completions),并且没有其他控制器已经声明调度责任

(schedulingGroup 字段未设置)。

不满足这些条件的 Job 会像以前一样逐个 Pod 调度。

如果你自行在 Pod 模板上设置 schedulingGroup

(例如因为有更高层的控制器正在管理该工作负载),

Job 控制器会保持 Pod 模板不变,

并且不会创建自己的 Workload 或 PodGroup。

这使得该特性可以安全地在已经使用外部批处理系统的集群中启用。

下面是一个符合编组调度条件的 Job 示例:

apiVersion: batch/v1

kind: Job

metadata:

name: training-job

namespace: job-ns

spec:

completionMode: Indexed

parallelism: 4

completions: 4

template:

spec:

restartPolicy: Never

containers:

- name: worker

image: registry.example/trainer:latest

Job 控制器会创建归此 Job 所有的 Workload 和 PodGroup,

并且它创建的每个 Pod 都会携带指向所生成 PodGroup 的 .spec.schedulingGroup。

随后,一旦可以使用本文前面描述的 PodGroup 调度周期同时放置全部四个 Pod,

这些 Pod 就会一起调度。

尚未覆盖的内容

当前约束将这一集成限制在静态、索引化、完全并行的 Job 上。 对其他工作负载形态的支持,包括弹性 Job 和其他内置控制器, 由 KEP-5547 跟踪。

在未来 Kubernetes 版本中,这一集成将扩展为支持更多工作负载控制器, 而当前针对 Job 的约束也可能放宽。

后续计划

工作负载感知调度的旅程并不会止步于此。 面向 v1.37,社区正在积极推进:

将 Workload 和 PodGroup API 晋升到 Beta: 我们的主要目标是让 Workload 和 PodGroup API 成熟到 Beta 阶段, 巩固它们在 Kubernetes 生态系统中的基础地位。 作为晋升过程的一部分,我们还计划引入

minCount可变性, 以解锁弹性 Job,并允许动态工作负载高效扩缩。多级 Workload 层次结构: 为了支持 JobSet 或通过 LeaderWorkerSet(LWS)实现的解聚推理等复杂现代 AI 工作负载, 我们正在扩展架构以支持多级层次结构。 我们计划引入一个新的 API, 允许将多个 PodGroup 组织成层次结构, 直接反映真实工作负载控制器的组织方式。

推进高级调度特性进阶: 我们专注于推动更广泛的工作负载感知调度生态系统走向成熟。 这包括将拓扑感知调度和工作负载感知抢占等现有特性推进到 Beta 阶段。

统一的控制器集成 API: 为简化采用过程,我们正在开发控制器集成 API。 这将为真实世界中的工作负载控制器提供一种统一、标准化的方法, 用于消费工作负载感知调度能力。

这些重点领域的优先级和实现顺序可能会发生变化。敬请关注后续更新。

入门

以下所有工作负载感知调度改进在 v1.36 中均作为 Alpha 特性提供。 要试用它们,你必须进行以下配置:

- 前提条件:Workload 和 PodGroup API 支持:

在

kube-apiserver和kube-scheduler上启用GenericWorkload特性门控,并确保启用scheduling.k8s.io/v1alpha2API 组。

满足前提条件后,你可以启用具体特性:

- 编组调度:在

kube-scheduler上启用GangScheduling特性门控。 - 拓扑感知调度:在

kube-scheduler上启用TopologyAwareWorkloadScheduling特性门控。 - 工作负载感知抢占:在

kube-scheduler上启用WorkloadAwarePreemption特性门控(还需要启用GangScheduling)。 - 工作负载的 DRA ResourceClaim 支持:在

kube-apiserver、kube-controller-manager、kube-scheduler和kubelet上启用DRAWorkloadResourceClaims特性门控。 - Job 控制器的 Workload API 集成:在

kube-apiserver和kube-controller-manager上启用WorkloadWithJob特性门控。

我们鼓励你在测试集群中试用工作负载感知调度, 并分享你的经验,以帮助塑造 Kubernetes 调度的未来。 你可以通过以下方式发送反馈:

- 通过 Slack(#workload-aware-scheduling)联系我们。

- 参加 SIG Scheduling 会议。

- 在 Kubernetes 仓库中提交新的 issue。

了解更多

要深入了解这些特性的架构和设计,请阅读以下 KEP:

Kubernetes v1.36:Kubernetes PSI 指标升级到 GA

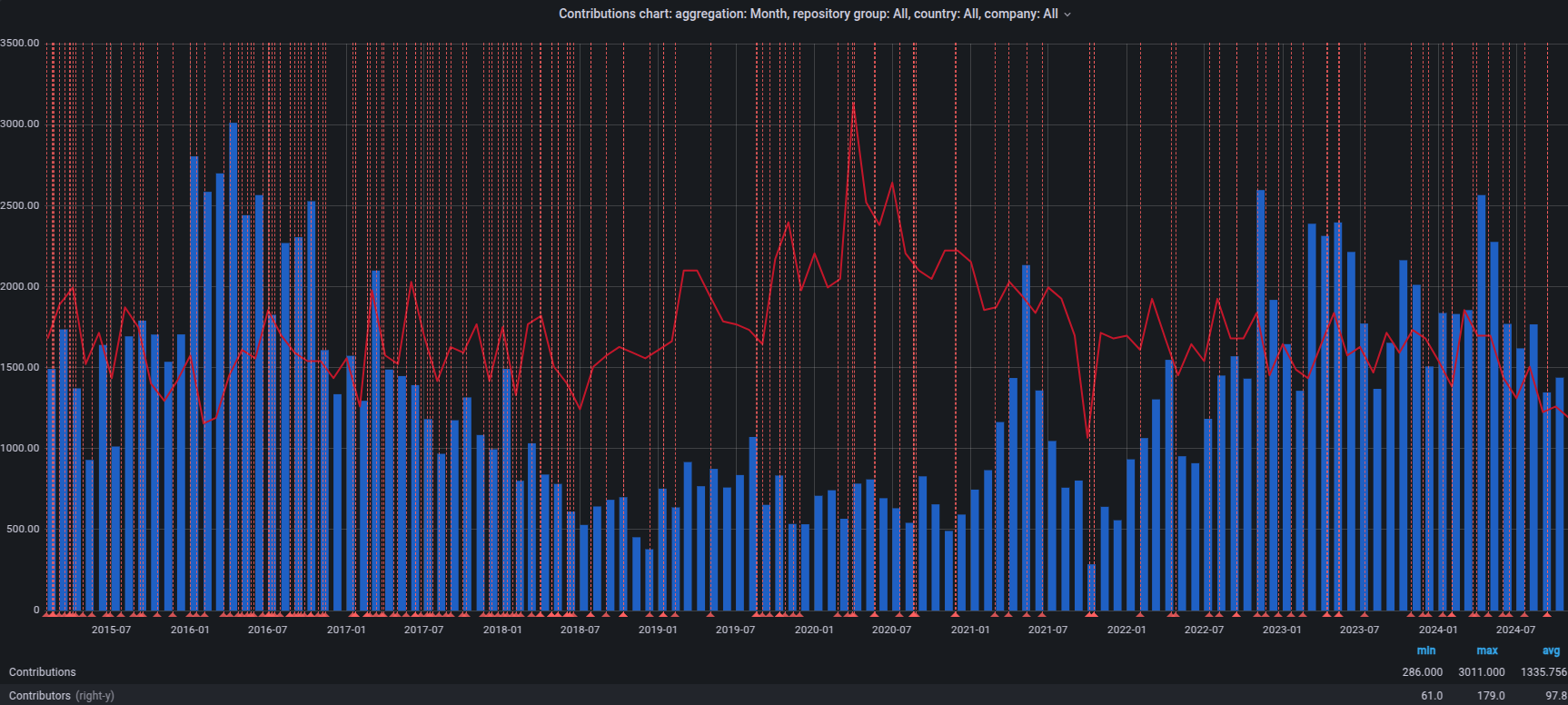

自 2018 年在 Linux 内核中首次实现以来, Pressure Stall Information(PSI)为用户提供了在资源饱和演变为停机之前识别它所需的高保真信号。 与传统的利用率指标不同,PSI 以 CPU、内存和 I/O 的时间百分比形式,清晰地展示了任务停滞和时间损失的情况。

随着 Kubernetes v1.36 的发布,生态系统中的用户现在拥有一个稳定、可靠的接口, 可在节点、Pod 和容器级别观察资源竞争情况。在本文中,我们将深入探讨证明其已准备好投入生产的改进和性能测试。

超越利用率:为什么选择 PSI?

仅监控 CPU 或内存使用情况可能会产生误导。一个节点可能报告 XX%(低于 100%)的 CPU 利用率, 而某些任务却因调度延迟而经历严重延迟。PSI 通过提供以下信息填补了这一空白:

- 累计总计:处于停滞状态的绝对时间。

- 移动平均值:10 秒、60 秒和 300 秒的窗口,允许运维人员区分瞬时峰值和持续的资源紧张。

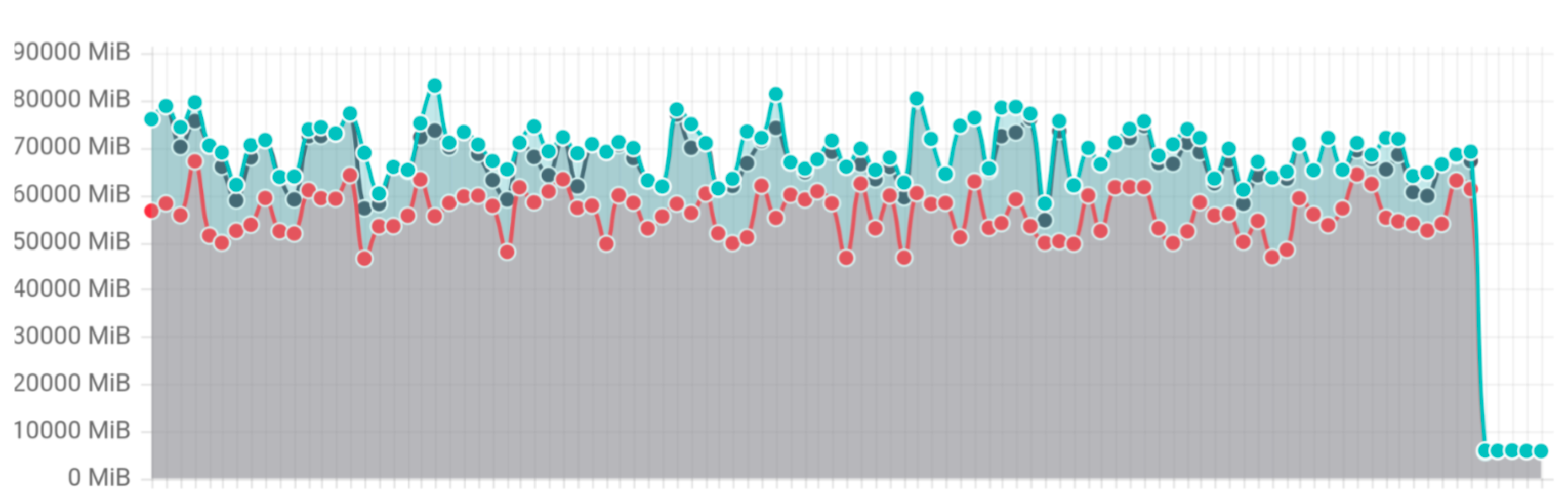

证明稳定性:大规模性能测试

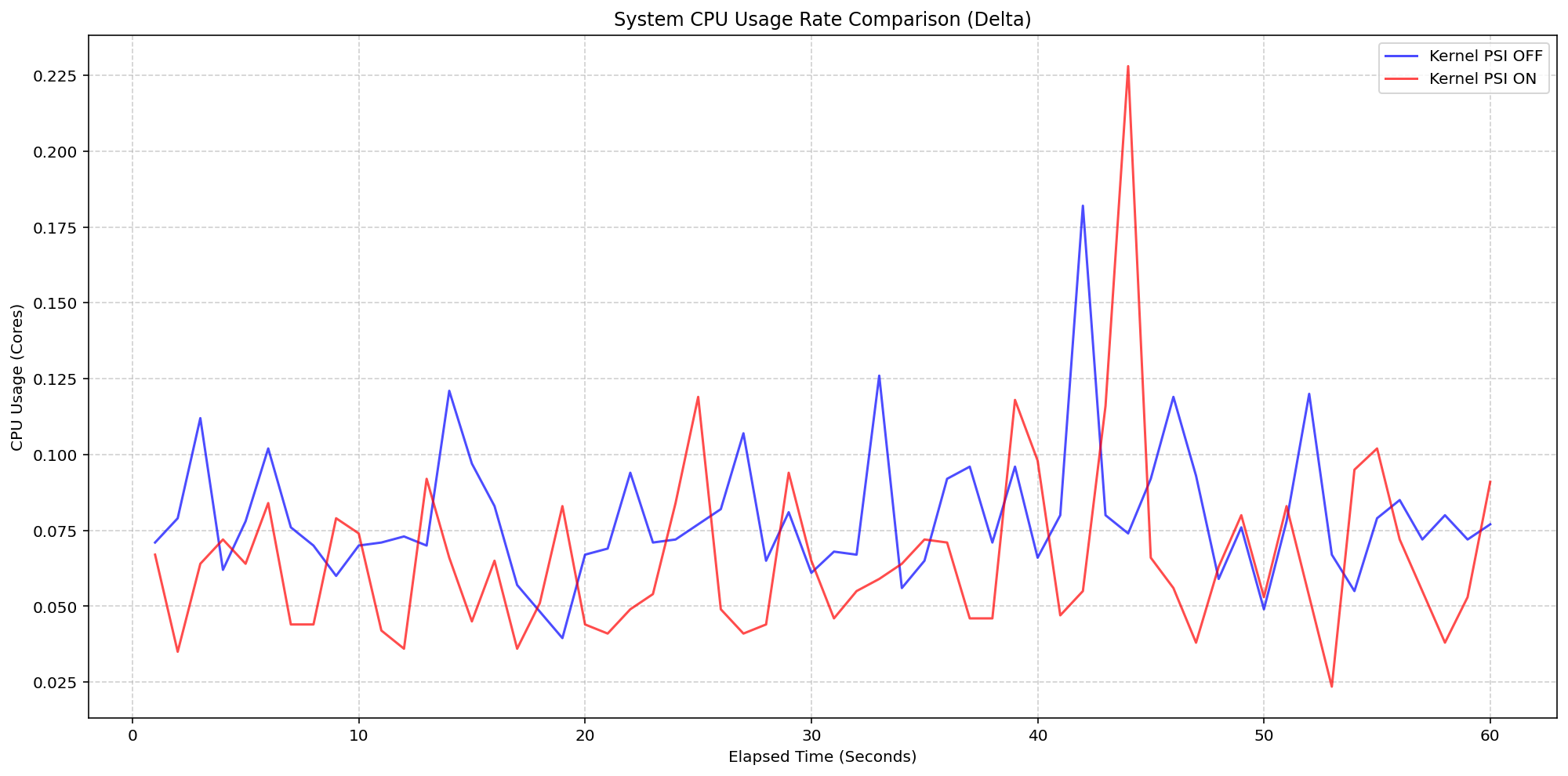

遥测功能升级时的一个常见担忧是收集和提供指标所需的资源开销。 为解决此问题,SIG Node 对各种机器类型上的高密度工作负载(80+ Pod)进行了广泛的性能验证。

我们的测试集中在两个主要场景,分别隔离 kubelet 和内核级别的收集影响:

- Kernel PSI ON / kubelet Feature OFF 对比 Kernel PSI ON / kubelet Feature ON(kubelet 开销)

- Kernel PSI OFF / kubelet Feature ON 对比 Kernel PSI ON / kubelet Feature ON(内核开销)

场景 1:kubelet 开销

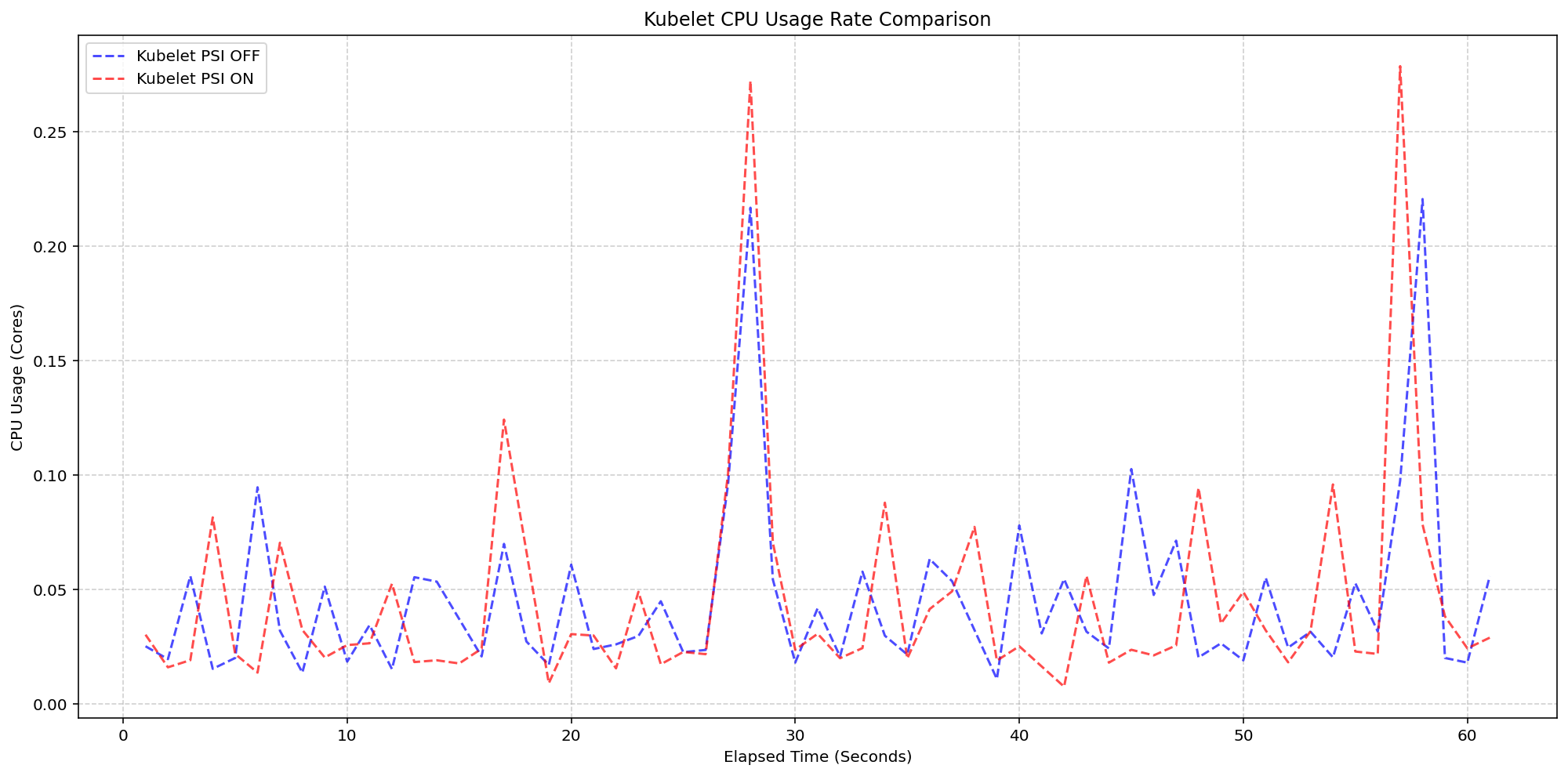

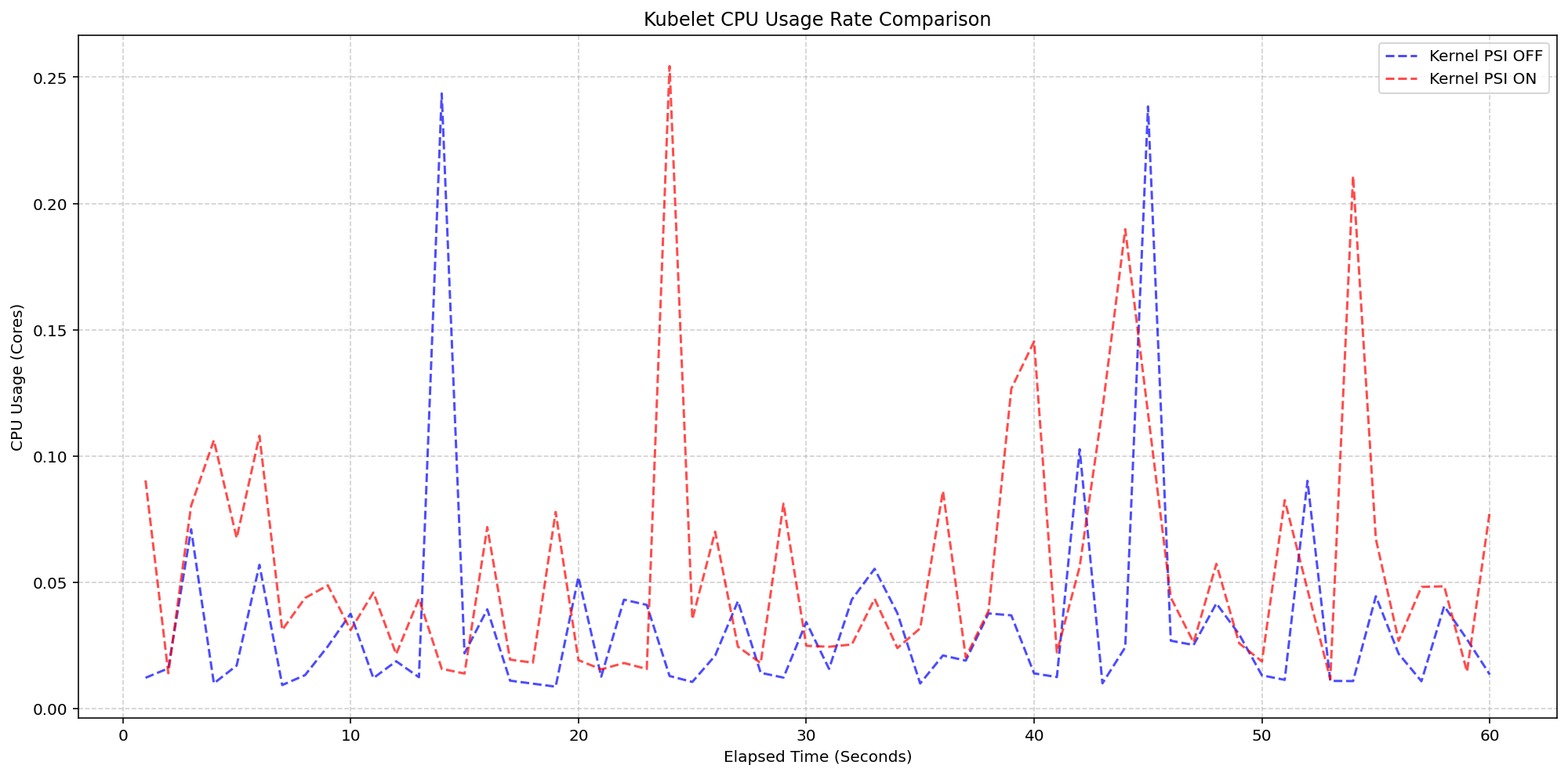

首先,我们查看了 4 核机器上的 kubelet 使用情况(案例 1)。

对于这些机器,Linux 内核默认已经在两个集群上跟踪压力(psi=1),

但我们切换了 KubeletPSI 特性门控,以查看 kubelet 主动查询和暴露这些指标是否会影响资源使用。

图表中看到的同步突发在幅度和频率上几乎完全相同,证实了 kubelet 的收集逻辑非常轻量级,

可以无缝融入标准的内务处理周期。

该特性不会影响现有的资源使用,保持在正常的 0.1 核或节点总容量的 2.5% 以内,

因此对于生产规模的部署是安全的。

(案例 1)kubelet CPU 使用率对比

图 2:kubelet CPU 使用率对比。

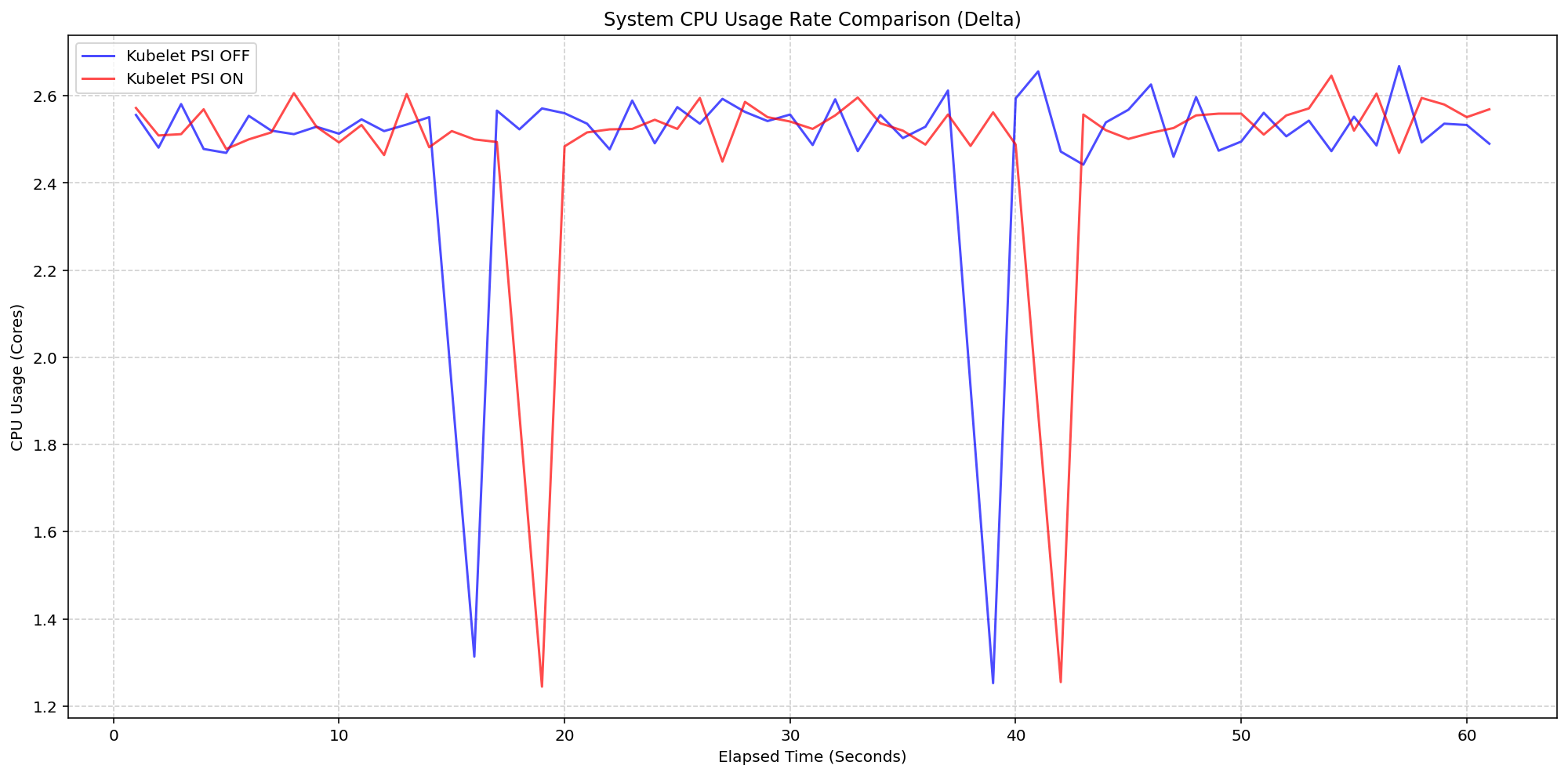

接下来,我们在同一运行中评估了系统开销。 如下列图表所示,启用 Kubelet PSI(红色)的 System CPU 使用率曲线与禁用 kubelet PSI(蓝色)的集群遵循相同模式,比基线略有预期的增加。 这表明一旦操作系统跟踪 PSI(约 2.5 核), Kubernetes 读取这些 CGroup 指标的行为对性能的影响可以忽略不计。

(案例 1)系统 CPU 使用率对比

图 1:节点系统 CPU 使用率对比。

场景 2:内核开销

换个角度,我们在 4 核机器上评估了在 Linux 内核上启用 PSI 的底层开销。

通过比较使用 psi=1(COS 默认值)启动的集群与使用 psi=0 的集群,

我们分离出了操作系统级簿记的确切成本。即使在 80 Pod 密度下的繁重 I/O 和 CPU 负载下,

启用内核和禁用内核的集群之间的 System CPU 差异始终保持在 0.037 核 到 0.125 核 之间,

即节点总容量的 0.925% - 3.125%。有一次峰值达到 0.225 核(即 5.6%),

但在几秒钟内就被控制下来。这证实了内核内部跟踪在负载下非常高效。

(案例 2)节点系统 CPU 使用率对比

图 3:节点系统 CPU 使用率对比。

图 4 放大了 kubelet 进程本身,它是这些指标的主要收集器。 结果表明,即使 kubelet 定期执行扫描以从 CGroup 层次结构聚合数据, 其 CPU 使用率仍然非常低,峰值可互换,且没有任何峰值超过 0.25 核 或总容量的 6.25% 超过一秒。

(案例 2)kubelet CPU 使用率对比

图 4:kubelet CPU 使用率对比。

Beta(1.34)到 Stable(1.36)之间的改进

- **GA 的智能指标发布:**我们改进了 kubelet 处理底层操作系统对 PSI 支持的方式。

以前,如果在 Kubernetes 中启用了该特性,但底层 Linux 内核不支持 PSI(

psi=0), kubelet 会发布误导性的零值指标。当这些指标被当作真实指标而不是缺失值读取时,可能会触发误报。 在 v1.36 中,kubelet 现在会在报告之前通过 CGroup 配置检测操作系统级别的 PSI 支持。 这确保了压力指标仅在节点实际支持时才被收集和发布,为监控和告警系统提供更清晰的数据。

入门指南

要在你的 Kubernetes 集群中使用 PSI 指标,你的节点必须满足以下要求:

- 确保你的节点运行 Linux 内核版本 4.20 或更高版本,并使用 CGroup v2。

- 确保在操作系统级别启用 PSI(你的内核必须使用

CONFIG_PSI=y编译,并且不得使用psi=0参数启动)。

从 v1.36 开始,Kubelet PSI 指标已普遍可用,你无需选择加入任何特性门控。

满足操作系统先决条件后,你可以开始使用兼容 Prometheus 的监控解决方案抓取 /metrics/cadvisor 端点,

或查询 Summary API 来收集和可视化新的 PSI 指标。

请注意,PSI 是 Linux 内核特性,因此这些指标在 Windows 节点上不可用。

你的集群可以包含 Linux 和 Windows 节点的混合,在 Windows 节点上,kubelet 将简单地省略 PSI 指标。

如果你的集群运行的是足够新的 Kubernetes 版本,并且你是特权节点管理员, 你还可以通过控制平面的 API 服务器代理到 kubelet 的 HTTP API, 以从 Summary API 查看实时压力数据。

**注意:**代理到 kubelet 是一项特权操作。授予访问权限存在安全风险, 因此在执行这些命令之前,请确保你拥有适当的管理权限。

CONTAINER_NAME="example-container"

kubectl get --raw "/api/v1/nodes/$(kubectl get nodes -o jsonpath='{.items[0].metadata.name}')/proxy/stats/summary" | jq '.pods[].containers[] | select(.name=="'"$CONTAINER_NAME"'") | {name, cpu: .cpu.psi, memory: .memory.psi, io: .io.psi}'

进一步阅读

如果你想深入了解这些指标是如何计算和暴露的,请查看以下资源:

- 官方内核文档

- Kubernetes 文档中的 Understanding PSI

- cAdvisor Metrics Implementation

致谢

PSI 指标的支持是通过 SIG Node 的协作努力开发的。特别感谢所有在该特性从 v1.33 的 Alpha、v1.34 的 Beta 到 v1.36 的 GA 整个过程中帮助设计、实现、测试、审查和文档化的贡献者。

要为此特性提供反馈,请加入 Kubernetes Node 特别兴趣小组, 参与公共 Slack 频道(#sig-node)上的讨论, 或在 GitHub 上提交 Issue。

反馈

如果你有反馈并想分享使用此特性的经验,请加入讨论:

- SIG Node 社区页面

- Kubernetes Slack 的 #sig-node 频道

- SIG Node 邮件列表

SIG Node 很想了解你在生产中使用此特性的经验!

Kubernetes v1.36:卷组快照进入正式发布阶段

卷组快照(Volume Group Snapshots)作为 Alpha 功能在 Kubernetes v1.27 版本中引入, 在 v1.32 版本中进入 Beta 阶段, 并在 v1.34 版本中进入二次 Beta 阶段。 我们很高兴地宣布,在 Kubernetes v1.36 版本中,卷组快照已 正式发布(GA)。

卷组快照的支持依赖于一组卷组快照的扩展 API。

这些 API 允许用户为一组卷创建崩溃一致性(crash-consistent)快照。

在后台,Kubernetes 使用标签选择器将多个 PersistentVolumeClaim 对象分组以进行快照。

其主要目标是允许用户将该组快照恢复到新卷,并基于崩溃一致性恢复点恢复工作负载。

此功能仅支持 CSI 卷驱动程序。

卷组快照概述

某些存储系统能够创建多个卷的崩溃一致性快照。组快照是指在同一时间点从多个卷创建的副本。 组快照可用于重建新卷(预填充快照数据),或将现有卷恢复到之前的状态(由快照表示)。

为什么要在 Kubernetes 中添加卷组快照?

Kubernetes 卷插件系统已经提供了一种强大的抽象机制,能够自动完成块存储和文件存储的配置、挂载、调整大小以及快照操作。 所有这些特性都植根于 Kubernetes 追求的工作负载可移植性这一目标。

现有的 VolumeSnapshot API 提供了对持久卷进行快照的功能,以防止数据丢失或损坏。 然而,一些存储系统支持一致性组快照,允许在同一时间点从多个卷创建快照,从而实现写入顺序的一致性。 这对于包含多个卷的应用程序非常有用。例如,应用程序的数据可能存储在一个卷中,而日志存储在另一个卷中。 如果这些卷的快照是在不同的时间创建的,则应用程序的数据将不一致,并且如果从这些快照恢复,则应用程序将无法正常运行。

虽然你可以先让应用程序进入静默状态,然后按顺序创建各个快照,但这个过程可能非常耗时,有时甚至根本无法实现。 一致的组支持可在无需让应用程序进入静默状态的情况下,确保组内所有卷的崩溃一致性。

Kubernetes 卷组快照 API

Kubernetes 对卷组快照的支持依赖于三种用于管理快照的 API:

VolumeGroupSnapshot :由 Kubernetes 用户(或自动化)创建,用于请求为多个持久卷声明创建卷组快照。

VolumeGroupSnapshotContent :由快照控制器为动态创建的 VolumeGroupSnapshot 创建。它包含有关已配置集群资源(组快照)的信息。 该对象与其创建的 VolumeGroupSnapshot 之间存在一对一映射关系。

VolumeGroupSnapshotClass :由集群管理员创建,用于描述应如何创建卷组快照,包括驱动程序信息、删除策略等。

这三种 API 类型被定义为自定义资源定义 (CRD)。在正式版发布中,API 版本已提升至 v1。

正式发布中的新内容

VolumeGroupSnapshot、VolumeGroupSnapshotContent和VolumeGroupSnapshotClass的 API 版本已升级为groupsnapshot.storage.k8s.io/v1。- 基于对 bete 测试版反馈的改进,增强了稳定性并修复了若干问题,其中包括 v1beta2 中引入的改进,以确保

restoreSize报告的准确性。

如何使用 Kubernetes 卷组快照

使用 Kubernetes 创建新的组快照

定义好 VolumeGroupSnapshotClass 对象并选定要一起创建快照的卷后,你可以通过创建

VolumeGroupSnapshot 对象来请求生成新的组快照。

为你想要分组的 PVC 打标签:

% kubectl label pvc pvc-0 group=myGroup

persistentvolumeclaim/pvc-0 labeled

% kubectl label pvc pvc-1 group=myGroup

persistentvolumeclaim/pvc-1 labeled

对于动态配置,必须设置选择器,以便快照控制器可以找到具有匹配标签的 PVC,以便一起进行快照。

apiVersion: groupsnapshot.storage.k8s.io/v1

kind: VolumeGroupSnapshot

metadata:

name: snapshot-daily-20260422

namespace: demo-namespace

spec:

volumeGroupSnapshotClassName: csi-groupSnapclass

source:

selector:

matchLabels:

group: myGroup

动态配置需要 VolumeGroupSnapshotClass:

apiVersion: groupsnapshot.storage.k8s.io/v1

kind: VolumeGroupSnapshotClass

metadata:

name: csi-groupSnapclass

driver: example.csi.k8s.io

deletionPolicy: Delete

如何使用组快照进行恢复

在恢复时,请求从属于 VolumeGroupSnapshot 的 VolumeSnapshot 对象创建新的 PersistentVolumeClaim。

对属于该组快照的所有卷重复此操作。

apiVersion: v1

kind: PersistentVolumeClaim

metadata:

name: examplepvc-restored-2026-04-22

namespace: demo-namespace

spec:

storageClassName: example-sc

dataSource:

name: snapshot-0962a745b2bf930bb385b7b50c9b08af471f1a16780726de19429dd9c94eaca0

kind: VolumeSnapshot

apiGroup: snapshot.storage.k8s.io

accessModes:

- ReadWriteOncePod

resources:

requests:

storage: 100Mi

作为存储供应商,如何添加组快照支持?

要实现卷组快照功能,CSI 驱动程序 必须:

- 实现新的组控制器服务。

- 实现组控制器远程过程调用 (RPC):

CreateVolumeGroupSnapshot、DeleteVolumeGroupSnapshot和GetVolumeGroupSnapshot。 - 添加组控制器能力

CREATE_DELETE_GET_VOLUME_GROUP_SNAPSHOT。

更多细节请参阅 CSI 规范 和 Kubernetes-CSI 驱动开发者指南。

如何了解更多信息?

如何参与?

与 Kubernetes 的所有项目一样,这个项目也是来自不同背景的众多贡献者共同努力的成果。 向多年来积极参与、助力本项目达到正式发布(GA)阶段的所有贡献者致以诚挚的谢意:

- Ben Swartzlander (bswartz)

- Cici Huang (cici37)

- Darshan Murthy (darshansreenivas)

- Hemant Kumar (gnufied)

- James Defelice (jdef)

- Jan Šafránek (jsafrane)

- Madhu Rajanna (Madhu-1)

- Manish M Yathnalli (manishym)

- Michelle Au (msau42)

- Niels de Vos (nixpanic)

- Leonardo Cecchi (leonardoce)

- Rakshith R (Rakshith-R)

- Raunak Shah (RaunakShah)

- Saad Ali (saad-ali)

- Wei Duan (duanwei33)

- Xing Yang (xing-yang)

- Yati Padia (yati1998)

如果你有兴趣参与 CSI 或 Kubernetes 存储系统任何部分的设计和开发,请加入 Kubernetes 存储特别兴趣小组(SIG)。 我们始终欢迎新的贡献者。

我们还定期召开数据保护工作组会议。 欢迎新成员加入我们的讨论。

Kubernetes v1.36:更多驱动程序、新特性以及下一代 DRA

动态资源分配(DRA)从根本上改变了平台管理员在 Kubernetes 中处理硬件加速器和专用资源的方式。 在 Kubernetes v1.36 中,DRA 继续走向成熟,带来了多项特性进阶、重要的可用性改进, 以及一些新的能力,包括将 DRA 的灵活性扩展到内存和 CPU 这类原生资源, 并支持在 PodGroup 中使用 ResourceClaim。

驱动程序的可用性也在持续扩展。除了专用计算加速器之外, 这一生态系统也已经支持网络设备及其他硬件类型, 这反映出它正迈向更稳健、不过度绑定特定硬件的基础设施。

无论你是在管理大规模 GPU 资源池,需要更好地处理故障, 还是只是希望找到更好的方式来定义资源候选/回退选项, DRA 在 v1.36 中的升级都会对你有所帮助。 下面我们来看看这些新特性和进阶内容。

特性进阶

社区一直在努力稳定 DRA 的核心概念。 在 Kubernetes 1.36 中,多项备受期待的特性已经进入 Beta 和稳定阶段。

按优先级排序的列表(Stable)

硬件异构是大多数集群中的现实情况。使用按优先级排序的列表 特性,你可以在请求设备时明确指定回退偏好。 你无需将对特定设备型号的请求硬编码,而是可以指定一个有序的偏好列表 (例如,“给我一块 H100,如果没有可用的,就回退到 A100”)。 调度器会按顺序评估这些请求,从而显著提升调度灵活性和集群利用率。

扩展资源支持(Beta)

随着 DRA 成为资源分配的标准,弥合与既有机制之间的差距就变得至关重要。 DRA 的扩展资源 特性允许用户通过 Pod 上传统的扩展资源方式来请求资源。 这使得向 DRA 的过渡可以循序渐进,也就是说,集群运维人员可以将集群迁移到 DRA, 而让应用开发者按照自己的节奏采用 ResourceClaim API。

可切分设备(Beta)

硬件加速器能力强大,而有时单个工作负载并不需要整个设备。 可切分设备 特性为 DRA 原生提供了支持,能够根据工作负载需求,将物理硬件动态切分为更小的逻辑实例 (例如多实例 GPU)。 这使管理员能够在多个 Pod 之间安全且高效地共享昂贵的加速器。

设备污点(Beta)

正如你可以为 Kubernetes Node 添加污点一样, 你也可以直接为特定 DRA 设备添加污点。 设备污点和容忍度 让集群管理员能够更高效地管理硬件。 你可以为故障设备打上污点,使其不会被普通 ResourceClaim 申领占用; 也可以把特定硬件预留给专属团队、专用工作负载或实验场景。 这样,只有具有匹配容忍度的 Pod 才允许申领这些带污点的设备。

设备绑定状况(Beta)

为了提升调度可靠性,Kubernetes 调度器可以使用绑定状况 特性,在 Pod 所需的外部资源(例如可挂接设备或 FPGA)完全就绪之前,推迟将 Pod 绑定到节点。 通过显式地对资源就绪状态建模,这一特性能够防止过早分配导致 Pod 失败, 从而确保部署过程更加稳健且可预测。

资源健康状态(Beta)

对于运行在专用硬件上的工作负载来说,知道设备何时故障或变得不健康至关重要。 借助资源健康状态, Kubernetes 直接在 Pod 状态中暴露设备健康信息, 为用户和控制器提供了关键的可见性,以便快速识别并响应硬件故障。 该特性还支持易于阅读的健康状态消息,使问题诊断变得容易得多, 而无需深入复杂的驱动日志。

新特性

除了稳定现有能力之外,v1.36 还引入了一些基础性的新特性,进一步扩展了 DRA 能支持的场景。 这些特性目前均处于 Alpha 阶段,并由默认关闭的特性门控控制。

面向工作负载的 ResourceClaim 支持

为了优化依赖严格拓扑调度的大规模 AI/ML 工作负载, 面向工作负载的 ResourceClaim 支持 特性使 Kubernetes 能够在大规模 Pod 集合之间统一管理共享资源。 通过将 ResourceClaim 或 ResourceClaimTemplate 与 PodGroup 关联起来, 该特性消除了此前的扩展性瓶颈,例如可共享某个申领的 Pod 数量限制, 同时也减轻了专用编排器手动管理申领的负担。

节点可分配资源

为什么 DRA 只能用于外部加速器呢?在 v1.36 中,我们引入了使用 DRA API 管理 节点可分配基础设施资源(如 CPU 和内存)的第一版实现。 通过 DRA 的节点可分配资源 特性,将 CPU 和内存分配纳入 DRA 体系之下, 用户就可以将 DRA 的高级放置能力、NUMA 感知和优先级语义应用到标准计算资源上, 从而为极细粒度的性能调优铺平道路。

DRA 资源可用性可见性

集群管理员最常提出的需求之一,就是希望更好地了解硬件容量。

全新的资源池状态

特性允许你查询 DRA 资源池中的设备可用性。

通过创建 ResourcePoolStatusRequest 对象,

你可以获得某个驱动所管理的每个资源池在某一时刻的设备数量快照,

包括总数、已分配、可用和不可用。

这有助于更好地集成仪表板和容量规划工具。

属性的列表类型

ResourceClaim 的约束求值机制已经调整,以便更好地处理标量值和列表值:

matchAttribute 现在检查是否存在非空交集,

而 distinctAttribute 则检查值是否两两不相交。

同时,CEL 中还引入了一个 includes() 函数,

这使设备选择器在某个属性于标量表示和列表表示之间变化时,

仍可更容易地保持可用。

(includes() 函数仅可用于 DRA 表达式求值上下文。)

确定性设备选择

Kubernetes 调度器已更新:在评估设备时,会按资源池与 ResourceSlice 名称的字典序进行比较。 这样一来,驱动可以更主动地影响调度过程,有助于提高吞吐量并做出更优的调度决策。 ResourceSlice 控制器工具包还会自动生成名称,使其与驱动作者在实现里声明的设备先后次序一致。

容器中可被发现的设备元数据

运行在带有 DRA 设备的节点上的工作负载,通常需要在不查询 Kubernetes API 的情况下, 发现其已分配设备的详细信息,例如 PCI 总线地址或网络接口配置。 借助设备元数据, Kubernetes 定义了一套标准协议,用于规定 DRA 驱动如何以带版本的 JSON 文件形式, 在约定路径下向容器暴露设备属性。 使用 DRA kubelet plugin library 构建的驱动可以无需额外处理即可获得这一能力;它们只需要提供元数据,其余如文件布局、 CDI bind-mount、版本控制和生命周期管理,都由该库负责处理。 这为应用提供了一种一致、与驱动无关的方式来发现和使用设备元数据, 从而无需再借助自定义控制器或查询 ResourceSlice 对象并从其属性中获取元数据。

后续计划

这一版本引入了大量新的动态资源分配(DRA)特性,而且相关工作仍在持续推进。 展望未来,我们的路线图将聚焦于推动现有特性走向 Beta 和稳定发布阶段, 同时进一步夯实 DRA 的性能、可扩展性和可靠性。 在接下来的几个迭代周期中,一个关键优先事项将是与 工作负载感知调度 和 拓扑感知调度 的深度集成。

我们的一个重要目标,是推动用户从设备插件迁移到 DRA,而我们也希望你参与其中。 无论你当前正在维护某个驱动,还是刚开始探索这些可能性, 你的意见都至关重要。与我们一起塑造下一代资源管理能力。 现在就联系我们,一起协作开发、分享反馈,或者开始构建你的第一个 DRA 驱动程序。

参与其中

一个不错的起点,是加入 WG Device Management 的 Slack 频道 和会议, 这些会议分别安排在适合 Americas/EMEA 和 EMEA/APAC 的时间段举行。

并非所有增强想法目前都已经作为 Issue 进行跟踪, 因此,如果你想提供帮助,或者你自己也有一些想法,欢迎来和我们交流。 我们在各个层面都有工作要做,从高难度核心变更,到 kubectl 的易用性增强, 其中一些工作也很适合新贡献者上手。

Kubernetes v1.36:声明式验证正式发布

在 Kubernetes v1.36 中,Kubernetes 原生类型的声明式验证特性已正式发布(GA)。

对于用户而言,这意味着更可靠、更可预测且文档更完善的 API。 通过迁移到声明式模型,该项目还为未来通过 OpenAPI 发布验证规则以及与 Kubebuilder 等生态系统工具集成奠定了基础。 对于贡献者和生态系统开发者而言,这意味着可以用一个统一且易于维护的框架取代数千行手写的验证代码。

本文将介绍此次迁移的必要性、声明式验证框架的工作原理以及此正式版带来的新特性。

动机:摆脱“手写”技术债务

多年来,Kubernetes 原生 API 的验证几乎完全依赖于手写的 Go 代码。 如果某个字段需要设置最小值限制,或者两个字段需要互斥,开发人员就必须编写显式的 Go 函数来强制执行这些约束。

随着 Kubernetes API 接口的扩展,这种方法导致了几个系统性问题:

- 技术债务:该项目积累了大约 18,000 行样板验证代码。这些代码难以维护、容易出错, 并且在代码审查期间需要进行严格审查。

- 不一致性:由于缺乏集中式框架,验证规则有时会在不同的资源中以不一致的方式应用。

- API 不透明:手写的验证逻辑难以通过编程方式发现或分析。 这意味着客户端和工具无法在不查阅源代码或在运行时遇到错误的情况下,预先了解验证规则。

SIG API Machinery 提出的解决方案是声明式验证:

直接在 types.go 文件中使用接口定义语言(IDL)标签(特别是 +k8s: 标记标签)来定义验证规则。

引入 validation-gen

声明式验证特性的核心是一个名为 validation-gen 的全新代码生成器。

正如 Kubernetes 使用生成器进行深度复制、转换和默认值设置一样,validation-gen

会解析 +k8s: 标签并自动生成相应的 Go 验证函数。

这些生成的函数随后会无缝注册到 API 方案中。该生成器被设计为一个可扩展的框架, 允许开发人员通过描述其要解析的标签以及应生成的 Go 逻辑来插入新的“验证器”。

一套全面的 +k8s: 标签

声明式验证框架引入了一套全面的标记标签,提供丰富的验证功能,并针对 Go 类型进行了高度优化。有关支持标签的完整列表, 请参阅官方文档。 以下列出了一些你现在将在 Kubernetes 代码库中看到的最常用标签:

- 存在性:

+k8s:optional、+k8s:required - 基本约束:

+k8s:minimum=0、+k8s:maximum=100、+k8s:maxLength=16和+k8s:format=k8s-short-name - 集合:

+k8s:listType=map、+k8s:listMapKey=type - 联合:

+k8s:unionMember、+k8s:unionDiscriminator - 不可变性:

+k8s:immutable、+k8s:update=[NoSet, NoModify, NoClear]

用法示例:

type ReplicationControllerSpec struct {

// +k8s:optional

// +k8s:minimum=0

Replicas *int32 `json:"replicas,omitempty"`

}

通过将这些标签直接放置在字段定义上方,约束条件就具有了自文档性, 任何阅读类型定义的人都可以立即看到这些约束条件。

高级功能:“Ambient 棘轮机制”

这项工作最重要的成果之一是,验证棘轮机制现在已成为 API 的标准组成部分。 过去,如果我们需要加强验证,必须先编写手动棘轮代码,等待版本发布,然后再加强验证,以避免破坏现有对象。

借助声明式验证,这种安全机制已内置。如果用户更新现有对象,验证框架会将传入的对象与 oldObject 进行比较。

如果特定字段的值在语义上与其先前状态相同(即用户未对其进行更改),则新的验证规则将被忽略。

这种“Ambient 棘轮机制”意味着我们可以立即以尽可能减少干扰的方式放松或加强验证。

使用 kube-api-linter 扩展 API 审查

达到正式发布(GA)要求我们对生成的代码绝对有信心,但我们的愿景远不止于代码验证。 声明式验证是全面改进 API 审查的关键组成部分,它能使审查更轻松、更一致、更具可扩展性。

通过将验证规则从不透明的 Go 函数中移至结构化标记,我们增强了 kube-api-linter

等工具的功能。该代码检查器现在可以静态分析 API 类型并自动强制执行 API 约定,

从而显著减轻 SIG API Machinery 审查人员的手动负担,并为贡献者提供即时反馈。

下一步是什么?

随着 Kubernetes v1.36 的发布,声明式验证正式上线(GA)。

作为一项稳定特性,相关的 DeclarativeValidation 特性门控现在默认启用。

它已成为向 Kubernetes 原生类型添加新验证规则的主要机制。

展望未来,该项目致力于更广泛地采用声明式验证。 这包括迁移现有 API 中剩余的旧式手写验证代码,并要求所有新 API 和新字段都使用声明式验证。 这一持续的过渡将不断降低代码库的复杂性,同时增强整个 Kubernetes API 接口的一致性和可靠性。

除了核心迁移之外,声明式验证也为更广泛的生态系统开启了令人兴奋的未来。

由于验证规则现在被定义为结构化标记,而不是不透明的 Go 代码,因此它们可以被解析并反映在

Kubernetes API 服务器发布的 OpenAPI schema 中。这为 kubectl 等工具、客户端库和

IDE 等在向集群发送请求之前执行丰富的客户端验证铺平了道路。

同样的声明式框架也可以被 Kubebuilder 等生态系统工具使用,从而为自定义资源定义(CRD)的作者带来更一致的开发体验。

参与其中

向声明式验证的迁移是一项持续进行的工作。虽然框架本身已经正式发布 (GA), 但仍需将旧版 API 迁移到新的声明式格式。

如果你有兴趣为 Kubernetes API Machinery 的核心做出贡献,这里是一个绝佳的起点。

请查看 validation-gen 文档,查找带有 sig/api-machinery 标签的问题,

并加入 Kubernetes Slack 上的 #sig-api-machinery

和 #sig-api-machinery-dev-tools

频道参与讨论(如需邀请,请访问 https://slack.k8s.io/)。

你还可以参加

SIG API Machinery 会议直接参与其中。

致谢

衷心感谢所有帮助将此特性上线 GA 的朋友们:

- Tim Hockin

- Joe Betz

- Aaron Prindle

- Lalit Chauhan

- David Eads

- Darshan Murthy

- Jordan Liggitt

- Patrick Ohly

- Maciej Szulik

- Wojciech Tyczynski

- Joel Speed

- Bryce Palmer

以及 Kubernetes 社区中其他众多为此做出贡献的人。

欢迎来到 Kubernetes 验证的声明式未来!

Kubernetes v1.36:无法删除的准入策略

如果你曾尝试在一组 Kubernetes 集群上强制执行安全策略,你可能遇到过一个令人沮丧的先有鸡还是先有蛋的问题。 你的准入策略是 API 对象,这意味着它们在有人创建之前不存在,并且任何具有适当权限的人都可以删除它们。 在集群引导期间,总是存在一个窗口,此时你的策略尚未生效,并且无法阻止特权用户删除它们。

Kubernetes v1.36 引入了一个 Alpha 特性来解决这个问题: 基于清单的准入控制。它允许你将准入 Webhook 和基于 CEL 的策略定义为磁盘上的文件, 由 API 服务器在启动时、处理任何请求之前加载。

我们正在填补的空白

如今,大多数 Kubernetes 策略强制执行都是通过 API 进行的。 你创建 ValidatingAdmissionPolicy 或 Webhook 配置作为 API 对象,准入控制器会接收它。 这在稳定状态下工作良好,但存在一些基本限制。

在集群引导期间,API 服务器开始处理请求与你的策略创建并生效之间存在一个间隙。 如果你从备份恢复或从 etcd 故障中恢复,这个间隙可能会很大。

还有一个自我保护问题。准入 Webhook 和策略无法拦截对其自身配置资源的操作。 Kubernetes 跳过对 ValidatingWebhookConfiguration 等类型调用 Webhook,以避免循环依赖。 这意味着具有足够权限的用户可以删除你的关键准入策略,而准入链中没有任何东西可以阻止他们。

我们 —— Kubernetes SIG API Machinery —— 希望有一种方式可以说"这些策略始终启用,到此为止。"

工作原理

你在已经通过 --admission-control-config-file 传递给 API 服务器的

AdmissionConfiguration 文件中添加一个 staticManifestsDir 字段。

将其指向一个目录,将你的策略 YAML 文件放在那里,API 服务器会在开始服务之前加载它们。

apiVersion: apiserver.config.k8s.io/v1

kind: AdmissionConfiguration

plugins:

- name: ValidatingAdmissionPolicy

configuration:

apiVersion: apiserver.config.k8s.io/v1

kind: ValidatingAdmissionPolicyConfiguration

staticManifestsDir: "/etc/kubernetes/admission/validating-policies/"

清单文件是标准的 Kubernetes 资源定义。唯一的要求是这些清单定义的所有对象必须以 .static.k8s.io 结尾。

这个保留的后缀可以防止与基于 API 的配置冲突,并在查看指标或审计日志时轻松判断准入决策的来源。

以下是一个完整的示例,拒绝 kube-system 之外的特权容器:

apiVersion: admissionregistration.k8s.io/v1

kind: ValidatingAdmissionPolicy

metadata:

name: "deny-privileged.static.k8s.io"

annotations:

kubernetes.io/description: "Deny launching privileged pods, anywhere this policy is applied"

spec:

failurePolicy: Fail

matchConstraints:

resourceRules:

- apiGroups: [""]

apiVersions: ["v1"]

operations: ["CREATE", "UPDATE"]

resources: ["pods"]

variables:

- name: allContainers

expression: >-

object.spec.containers +

(has(object.spec.initContainers) ? object.spec.initContainers : []) +

(has(object.spec.ephemeralContainers) ? object.spec.ephemeralContainers : [])

validations:

- expression: >-

!variables.allContainers.exists(c,

has(c.securityContext) && has(c.securityContext.privileged) &&

c.securityContext.privileged == true)

message: "Privileged containers are not allowed"

---

apiVersion: admissionregistration.k8s.io/v1

kind: ValidatingAdmissionPolicyBinding

metadata:

name: "deny-privileged-binding.static.k8s.io"

annotations:

kubernetes.io/description: "Bind deny-privileged policy to all namespaces except kube-system"

spec:

policyName: "deny-privileged.static.k8s.io"

validationActions:

- Deny

matchResources:

namespaceSelector:

matchExpressions:

- key: "kubernetes.io/metadata.name"

operator: NotIn

values: ["kube-system"]

保护以前无法保护的内容

我们最兴奋的部分是能够拦截对准入配置资源本身的操作。

使用基于 API 的准入,Webhook 和策略永远不会在 ValidatingAdmissionPolicy 或 ValidatingWebhookConfiguration 等类型上调用。 这个限制存在是有充分理由的:如果 Webhook 可以拒绝对其自身配置的更改,你可能会被锁定,无法通过 API 修复它。

基于清单的策略没有这个问题。如果一个错误的策略阻止了它不应该阻止的东西,你可以修复磁盘上的文件,API 服务器会接收到更改。 不存在循环依赖,因为恢复路径不通过 API。

这意味着你可以编写一个基于清单的策略来防止删除关键的基于 API 的准入策略。 对于管理共享集群的平台团队来说,这是一个重大改进。 你现在可以保证你的基线安全策略不会被集群管理员删除,无论是意外还是故意。

以下是实际应用中的示例。此策略防止修改或删除带有

platform.example.com/protected: "true" 标签的准入资源:

apiVersion: admissionregistration.k8s.io/v1

kind: ValidatingAdmissionPolicy

metadata:

name: "protect-policies.static.k8s.io"

annotations:

kubernetes.io/description: "Prevent modification or deletion of protected admission resources"

spec:

failurePolicy: Fail

matchConstraints:

resourceRules:

- apiGroups: ["admissionregistration.k8s.io"]

apiVersions: ["*"]

operations: ["DELETE", "UPDATE"]

resources:

- "validatingadmissionpolicies"

- "validatingadmissionpolicybindings"

- "validatingwebhookconfigurations"

- "mutatingwebhookconfigurations"

validations:

- expression: >-

!has(oldObject.metadata.labels) ||

!('platform.example.com/protected' in oldObject.metadata.labels) ||

oldObject.metadata.labels['platform.example.com/protected'] != 'true'

message: "Protected admission resources cannot be modified or deleted"

---

apiVersion: admissionregistration.k8s.io/v1

kind: ValidatingAdmissionPolicyBinding

metadata:

name: "protect-policies-binding.static.k8s.io"

annotations:

kubernetes.io/description: "Bind protect-policies policy to all admission resources"

spec:

policyName: "protect-policies.static.k8s.io"

validationActions:

- Deny

有了这个策略,任何带有 platform.example.com/protected: "true"

标签的基于 API 的准入策略或 webhook 配置都受到保护,不会被篡改。

保护本身存储在磁盘上,无法通过 API 删除。

需要知道的几件事

基于清单的配置故意设计为自包含的。它们不能引用 API 资源,这意味着策略没有 paramKind,

准入 Webhook 没有 Service 引用(而是仅使用 URL),

并且绑定只能引用同一清单集中的策略。这些限制存在是因为配置需要在没有任何集群状态的情况下工作,

包括在 etcd 可用之前的启动阶段。

如果你运行多个 API 服务器实例,每个实例独立加载自己的清单文件。没有内置的跨服务器同步。 这与其他基于文件的 API 服务器配置(如静态加密)的模型相同。 启用此特性后,Kubernetes 会在相关指标上公开配置哈希作为标签,因此你可以检测漂移。

文件在运行时会被监视更改,因此你无需重启 API 服务器即可更新策略。 如果你更新清单文件,API 服务器会验证新配置并原子性地切换到新配置。 如果验证失败,它会保留之前的良好配置并记录错误。 这意味着你可以使用标准配置管理工具(Ansible、Puppet,甚至挂载的 ConfigMap)在整个集群中推出策略更改, 而不会导致 API 服务器停机。

启动时的初始加载更加严格:如果任何清单无效,API 服务器将不会启动。这是有意为之的。 在启动时,快速失败比没有预期策略运行更安全。

尝试一下

要在 Kubernetes v1.36 中尝试此特性:

- 为每个 kube-apiserver 启用

ManifestBasedAdmissionControlConfig特性门控。 - 创建一个包含静态清单文件的目录。 如果需要将其挂载到 API 服务器运行的 Pod 中,请进行挂载。只读模式即可。

- 在你的

AdmissionConfiguration中配置staticManifestsDir,指定目录路径。 - 使用

--admission-control-config-file指向你的AdmissionConfiguration文件启动 API 服务器。

完整文档位于 Manifest-Based Admission Control, 你可以关注 KEP-5793 了解持续进展。

我们很想听听你的反馈。请在 Kubernetes Slack 上的 #sig-api-machinery 频道联系我们 (如需邀请,请访问 https://slack.k8s.io/)。

如何参与

如果你有兴趣为这个特性或其他 SIG API Machinery 项目做出贡献,请加入 Kubernetes Slack 上的 #sig-api-machinery。 也欢迎你参加 SIG API Machinery 会议, 每两周周三举行一次。

Kubernetes v1.36:Pod 级资源管理器(Alpha)

Kubernetes v1.36 将

Pod 级资源管理器

作为 Alpha 特性引入,为对性能敏感的工作负载带来了一种更灵活、更强大的资源管理模型。

这一增强将 kubelet 的拓扑管理器(Topology Manager)、CPU 管理器和内存管理器扩展为支持 Pod 级别资源规约

(.spec.resources),使它们从严格按容器分配的模型演进为以 Pod 为中心的模型。

为什么需要 Pod 级资源管理器?

当运行机器学习(ML)训练、高频交易应用或低延迟数据库这类对性能要求严苛的工作负载时, 你通常需要为主要应用容器分配独占且经过 NUMA 对齐的资源,以确保性能可预测。

不过,现代 Kubernetes Pod 很少只包含一个容器。 它们通常还会包含用于日志、监控、服务网格或数据摄取的边车容器。

在这一特性出现之前,这会带来一种取舍:为了让主应用获得 NUMA 对齐的独占资源, 你必须为 Pod 中的每一个容器都分配基于整数的独占 CPU 资源。 这对于轻量级边车来说可能是一种浪费。 如果不这样做,你就会完全失去该 Pod 的 Guaranteed 服务质量(QoS)类, 同时失去相应的性能收益。

引入 Pod 级资源管理器

为资源管理器启用 Pod 级别资源支持(通过 PodLevelResourceManagers 和

PodLevelResources 特性门控)后,kubelet 就能够创建混合资源分配模型。

这为高性能工作负载带来了灵活性和效率,同时又不牺牲 NUMA 对齐。

真实世界中的用例

下面通过几个实际场景说明,在不同的拓扑管理器作用域下,这一特性可以如何应用:

1. 紧密耦合的数据库(拓扑管理器的 pod 作用域)

假设有一个对延迟敏感的数据库 Pod,其中包含一个主数据库容器、一个本地指标导出器, 以及一个备份代理边车容器。

当配置为拓扑管理器的 pod 作用域时,kubelet 会基于整个 Pod 的资源预算执行一次统一的 NUMA 对齐。

数据库容器会从该 NUMA 节点获得自己的独占 CPU 和内存切片。

Pod 预算中的剩余资源会形成一个新的 Pod 共享池。

指标导出器和备份代理运行在这个 Pod 共享池中。

它们彼此共享资源,但会与数据库的独占切片以及节点其余部分严格隔离。

这样一来,你就可以安全地将辅助容器与主工作负载放置在同一个 NUMA 节点上, 同时又不必为这些辅助容器浪费专用核心。

apiVersion: v1

kind: Pod

metadata:

name: tightly-coupled-database

spec:

# Pod 级别资源定义整体预算和 NUMA 对齐规模。

resources:

requests:

cpu: "8"

memory: "16Gi"

limits:

cpu: "8"

memory: "16Gi"

initContainers:

- name: metrics-exporter

image: metrics-exporter:v1

restartPolicy: Always

- name: backup-agent

image: backup-agent:v1

restartPolicy: Always

containers:

- name: database

image: database:v1

# 这个 Guaranteed 容器从 Pod 预算中获得独占的 6 个 CPU 切片。

# 剩余的 2 个 CPU 和 4Gi 内存会构成供边车使用的 Pod 共享池。

resources:

requests:

cpu: "6"

memory: "12Gi"

limits:

cpu: "6"

memory: "12Gi"

2. 带基础设施边车的 ML 工作负载(拓扑管理器的 container 作用域)

设想一个 Pod 运行着 GPU 加速的 ML 训练工作负载,同时还带有一个通用的服务网格边车。

在拓扑管理器的 container 作用域下,kubelet 会逐个评估每个容器。

你可以为 ML 容器分配独占且经过 NUMA 对齐的 CPU 和内存,以获得最佳性能。

与此同时,服务网格边车并不需要进行 NUMA 对齐;它可以运行在节点范围内的通用共享池中。

总体资源消耗仍会安全地受整个 Pod 的限制值约束,但你只需要把 NUMA 对齐的独占资源分配给那些真正需要它们的特定容器。

apiVersion: v1

kind: Pod

metadata:

name: ml-workload

spec:

# Pod 级别资源定义整体预算约束。

resources:

requests:

cpu: "4"

memory: "8Gi"

limits:

cpu: "4"

memory: "8Gi"

initContainers:

- name: service-mesh-sidecar

image: service-mesh:v1

restartPolicy: Always

containers:

- name: ml-training

image: ml-training:v1

# 在 `container` 作用域下,这个 Guaranteed 容器会获得独占且经过 NUMA 对齐的资源,

# 而边车则运行在节点的共享池中。

resources:

requests:

cpu: "3"

memory: "6Gi"

limits:

cpu: "3"

memory: "6Gi"

CPU 配额(CFS)与隔离

当在一个 Pod 内运行这些混合工作负载时,隔离机制会根据分配方式的不同而有所区别:

- 独占容器: 获得独占 CPU 切片的容器会在容器级别禁用 CPU CFS 配额限制, 这样它们运行时就不会被 Linux 调度器限流。

- Pod 共享池容器: 落入 Pod 共享池的容器会在 Pod 级别应用 CPU CFS 配额限制, 以确保它们不会消耗超过 Pod 剩余预算的资源。

如何启用 Pod 级资源管理器

使用这一特性需要 Kubernetes v1.36 或更高版本。 要启用它,你必须为 kubelet 配置相应的特性门控和策略:

- 启用

PodLevelResources和PodLevelResourceManagers特性门控。 - 将

拓扑管理器

配置为

none之外的策略(即best-effort、restricted或single-numa-node)。 - 在

KubeletConfiguration中使用topologyManagerScope字段,将 拓扑管理器作用域 设置为pod或container。 - 将

CPU 管理器

配置为

static策略。 - 将

内存管理器

配置为

Static策略。

可观测性

为了帮助集群管理员监控并调试这些新的分配模型,我们在启用该特性门控时引入了几个新的 kubelet 指标:

resource_manager_allocations_total:统计某个管理器执行独占资源分配的总次数。source标签("pod" 或 "node")用于区分分配来源于节点级资源池, 还是来源于预先分配的 Pod 级资源池。resource_manager_allocation_errors_total:统计独占资源分配过程中出现的错误次数, 并通过目标分配source("pod" 或 "node")进行区分。resource_manager_container_assignments:跟踪以特定分配类型运行的容器累计数量。assignment_type标签("node_exclusive"、"pod_exclusive"、"pod_shared") 让你能够看到工作负载是如何分布的。

当前的限制与注意事项

虽然这一特性带来了新的可能性,但在其 Alpha 阶段仍有几点需要留意。 有关兼容性、要求以及降级说明的完整细节,请务必查阅官方文档中的 限制与注意事项。

开始使用并提供反馈

若要深入了解这一特性的技术细节和配置方式,请参阅官方概念文档:

若要进一步了解 Pod 级别资源特性的整体情况,以及如何为 Pod 分配资源,请参阅:

随着这一特性在 Alpha 阶段持续演进,你的反馈尤为宝贵。 欢迎通过 Kubernetes 的标准沟通渠道报告问题或分享你的使用经验:

Kubernetes v1.36:Pod 级别资源的原地垂直扩缩容升级至 Beta 版本

在 v1.34 中 Pod 级别资源升级到 Beta 版本,以及 v1.35 中原地 Pod 垂直扩缩容达到正式可用(GA)之后, Kubernetes 社区非常高兴地宣布:Pod 级别资源的原地垂直扩缩容已在 v1.36 中升级到 Beta 版本!

此特性现在通过 InPlacePodLevelResourcesVerticalScaling 特性门控默认启用。

它允许用户更新运行中 Pod 的聚合 Pod 资源预算(.spec.resources),通常不需要容器重启。

为什么需要 Pod 级别的原地调整大小?

Pod 级别的资源模型通过允许容器共享一个集体资源池,简化了复杂 Pod(例如带有边车容器的 Pod)的管理。 在 v1.36 中,你现在可以动态调整这个聚合边界。

这对于没有定义单个容器限制的 Pod 特别有用。这些容器会自动调整其有效边界以适应新调整大小的 Pod 级维度, 允许你在高峰需求期间扩展共享池,而无需手动重新计算每个容器。

资源继承和 resizePolicy

当启动 Pod 级别的调整大小时,kubelet 将此更改视为每个从 Pod 级预算继承其限制的容器的调整大小事件。

为了确定是否需要重启,kubelet 会参考各个容器中定义的 resizePolicy:

- 非破坏性更新:如果容器的

restartPolicy设置为NotRequired,kubelet 会尝试通过容器运行时接口(CRI)动态更新 CGroup 限制。 - 破坏性更新:如果设置为

RestartContainer,容器将被重启以安全应用新的聚合边界。

注意:目前,

resizePolicy不支持在 Pod 级别设置。kubelet 始终遵循各个容器的设置来决定更新是否可以原地应用或需要重启。

示例:调整共享资源池大小

在这个场景中,一个 Pod 定义了 2 CPU 的 Pod 级别限制。由于各个容器没有定义自己的限制,它们共享这个总池。

1. 初始 Pod 规范

apiVersion: v1

kind: Pod

metadata:

name: shared-pool-app

spec:

resources: # Pod-level limits

limits:

cpu: "2"

memory: "4Gi"

containers:

- name: main-app

image: my-app:v1

resizePolicy: [{resourceName: "cpu", restartPolicy: "NotRequired"}]

- name: sidecar

image: logger:v1

resizePolicy: [{resourceName: "cpu", restartPolicy: "NotRequired"}]

2. 调整大小操作

要将 CPU 容量增加一倍至 4 个 CPU,请使用 resize 子资源应用补丁:

kubectl patch pod shared-pool-app --subresource resize --patch \

'{"spec":{"resources":{"limits":{"cpu":"4"}}}}'

节点级现实:可行性和安全性

应用调整大小补丁只是第一步。kubelet 执行多项检查并遵循特定顺序以确保节点稳定性:

1. 可行性检查

在接受调整大小之前,kubelet 会验证新的聚合请求是否适合节点的可分配容量。

如果节点过度承诺,调整大小不会被忽略;相反,PodResizePending 条件会反映 Deferred 或 Infeasible 状态,

提示为什么“信封”没有增长的即时反馈。

2. 更新顺序

为防止资源“超调”,kubelet 按特定顺序协调 CGroup 更新:

- 增加时:首先扩展 Pod 级 CGroup,在扩大各个容器 CGroup 之前创建“空间”。

- 减少时:首先限制容器 CGroup,然后才缩小聚合 Pod 级 CGroup。

可观测性:跟踪调整大小状态

随着升级到 Beta 版本,Kubernetes 使用 Pod 状况来跟踪调整大小的生命周期:

PodResizePending:规范已更新,但节点尚未接受更改(例如,由于容量)。PodResizeInProgress:节点已接受调整大小(status.allocatedResources), 但更改尚未完全应用到 CGroup(status.resources)。

status:

allocatedResources:

cpu: "4"

resources:

limits:

cpu: "4"

conditions:

- type: PodResizeInProgress

status: "True"

约束和要求

- 仅支持 CGroup v2:准确的聚合执行所必需。

- CRI 支持:需要支持

UpdateContainerResourcesCRI 调用的容器运行时(例如 containerd v2.0+ 或 CRI-O)。 - 特性门控:需要

PodLevelResources、InPlacePodVerticalScaling、InPlacePodLevelResourcesVerticalScaling和NodeDeclaredFeatures。 - 仅支持 Linux:目前仅适用于基于 Linux 的节点。

下一步

在我们向正式可用(GA)迈进的过程中,社区正在专注于垂直 Pod 自动缩放器(VPA)集成, 使 VPA 能够发布 Pod 级资源建议并自动触发原地执行。

开始使用并提供反馈

我们鼓励你测试此特性并通过标准的 Kubernetes 沟通渠道提供反馈:

Kubernetes v1.36:借助 Memory QoS 实现分层内存保护

我谨代表 SIG Node 宣布 Kubernetes v1.36 中 Memory QoS 特性(Alpha)的更新。

Memory QoS 使用 cgroup v2 的内存控制器,为内核提供更好的指引来处理容器内存。

它最早在 v1.22 中引入,并在 v1.27 中更新。

在 Kubernetes v1.36 中,我们引入了以下内容:可选启用的内存预留、基于 QoS 类的分层保护、

可观测性指标,以及针对 memory.high 的内核版本告警。

v1.36 的新变化

使用 memoryReservationPolicy 选择性启用内存预留

v1.36 将节流与预留分离开来。启用该特性门控后,会开启 memory.high 节流

(kubelet 基于 memoryThrottlingFactor 设置 memory.high,默认值为 0.9),

但内存预留现在由一个独立的 kubelet 配置字段控制:

None(默认):不写入memory.min或memory.low。通过memory.high进行的节流仍然有效。TieredReservation:kubelet 基于 Pod 的 QoS 类 写入分层内存保护:

Guaranteed Pod 通过 memory.min 获得硬保护。例如,一个请求 512 MiB 内存的

Guaranteed Pod 会得到:

$ cat /sys/fs/cgroup/kubepods.slice/kubepods-pod6a4f2e3b_1c9d_4a5e_8f7b_2d3e4f5a6b7c.slice/memory.min

536870912

内核在任何情况下都不会回收这部分内存。如果无法兑现这一保证, 它会对其他进程触发 OOM killer 以释放内存页。

Burstable Pod 通过 memory.low 获得软保护。对于同样请求 512 MiB 内存的

Burstable Pod:

$ cat /sys/fs/cgroup/kubepods.slice/kubepods-burstable.slice/kubepods-burstable-pod8b3c7d2e_4f5a_6b7c_9d1e_3f4a5b6c7d8e.slice/memory.low

536870912

在正常压力下,内核会避免回收这部分内存;但如果另一种选择是系统范围的 OOM, 内核仍可能回收其中一部分。

BestEffort Pod 既不会获得 memory.min,也不会获得 memory.low。

它们的内存仍然是完全可回收的。

与 v1.27 行为的对比

在更早的版本中,启用 MemoryQoS 特性门控后,会立即为每个带有内存请求的容器设置 memory.min。

memory.min 是一种硬预留,无论内存压力如何,内核都不会回收它。

假设一个节点有 8 GiB RAM,而 Burstable Pod 的请求总量达到 7 GiB。

在更早版本中,这 7 GiB 会作为 memory.min 被锁定,

从而给内核、系统守护进程或 BestEffort 工作负载留下极少余量,

并增加 OOM kill 的风险。

在 v1.36 的分层预留机制下,这些 Burstable 请求会映射到 memory.low,而不是 memory.min。

在正常压力下,内核仍会保护这部分内存;但在极端压力下,

它可以回收其中一部分以避免系统范围的 OOM。

只有 Guaranteed Pod 才会使用 memory.min,这使得硬预留保持在更低水平。

借助 v1.36 中的 memoryReservationPolicy,

你可以先启用节流,观察工作负载行为,

然后在节点拥有足够余量时再选择启用预留。

可观测性指标

kubelet 的 /metrics 端点会暴露两个 Alpha 级稳定性指标:

| 指标 | 说明 |

|---|---|

kubelet_memory_qos_node_memory_min_bytes | Guaranteed Pod 的 memory.min 总量 |

kubelet_memory_qos_node_memory_low_bytes | Burstable Pod 的 memory.low 总量 |

这些指标对于容量规划非常有用。

如果 kubelet_memory_qos_node_memory_min_bytes

正在逐渐逼近节点的物理内存,

你就知道硬预留已经变得紧张了。

$ curl -sk https://localhost:10250/metrics | grep memory_qos

# HELP kubelet_memory_qos_node_memory_min_bytes [ALPHA] Total memory.min in bytes for Guaranteed pods

kubelet_memory_qos_node_memory_min_bytes 5.36870912e+08

# HELP kubelet_memory_qos_node_memory_low_bytes [ALPHA] Total memory.low in bytes for Burstable pods

kubelet_memory_qos_node_memory_low_bytes 2.147483648e+09

内核版本检查

在版本低于 5.9 的内核上,memory.high 节流可能触发

内核活锁

问题。这个缺陷已在内核 5.9 中修复。

在 v1.36 中,当启用该特性门控时,kubelet 会在启动时检查内核版本,

如果内核版本低于 5.9 就记录一条告警日志。

该特性仍然可以继续工作,这只是信息提示,并不是硬阻断。

Kubernetes 如何将 Memory QoS 映射到 cgroup v2

Memory QoS 使用四个 cgroup v2 内存控制器接口:

memory.max:硬内存限制,与之前版本一致memory.min:硬内存保护,在TieredReservation下仅对 Guaranteed Pod 设置memory.low:软内存保护,在TieredReservation下对 Burstable Pod 设置memory.high:内存节流阈值,与之前版本一致

下表展示了在配置 memoryReservationPolicy: TieredReservation 时,

Kubernetes 容器资源如何映射到 cgroup v2 接口。

对于默认值 memoryReservationPolicy: None,不会设置 memory.min 或 memory.low。

| QoS 类 | memory.min | memory.low | memory.high | memory.max |

|---|---|---|---|---|

| Guaranteed | 设置为 requests.memory(硬保护) | 不设置 | 不设置 (requests == limits,因此节流没有意义) | 设置为 limits.memory |

| Burstable | 不设置 | 设置为 requests.memory(软保护) | 基于节流因子公式计算 | 设置为 limits.memory(如果已指定) |

| BestEffort | 不设置 | 不设置 | 基于节点可分配内存计算 | 不设置 |

cgroup 层级

cgroup v2 要求父 cgroup 的内存保护值至少要与其所有子 cgroup 之和一样大。

kubelet 通过以下方式维持这一点:

将 kubepods 根 cgroup 上的 memory.min

设置为所有 Guaranteed 和 Burstable Pod 内存请求之和,

并将 Burstable QoS cgroup 上的 memory.low

设置为所有 Burstable Pod 内存请求之和。

这样,内核就能够正确执行容器级和 Pod 级的保护值。

kubelet 直接使用 runc 的 libcontainer 库管理 Pod 级别和 QoS 类级别的 cgroup, 而容器级别的 cgroup 则由容器运行时(containerd 或 CRI-O)管理。

如何使用?

前提条件

- Kubernetes v1.36 或更高版本

- 使用 cgroup v2 的 Linux。推荐使用 5.9 或更高版本的内核;

更早版本的内核也能工作,但可能会遇到活锁问题。

你可以运行

mount | grep cgroup2来验证 cgroup v2 是否已启用。 - 支持 cgroup v2 的容器运行时(containerd 1.6+、CRI-O 1.22+)

配置

要启用带分层保护的 Memory QoS:

apiVersion: kubelet.config.k8s.io/v1beta1

kind: KubeletConfiguration

featureGates:

MemoryQoS: true

memoryReservationPolicy: TieredReservation # 可选值:None(默认)、TieredReservation

memoryThrottlingFactor: 0.9 # 可选,默认值为 0.9

如果你只想启用 memory.high 节流,而不启用内存保护,

可以省略 memoryReservationPolicy,或者将其设置为 None:

apiVersion: kubelet.config.k8s.io/v1beta1

kind: KubeletConfiguration

featureGates:

MemoryQoS: true

memoryReservationPolicy: None # 默认值

如何进一步了解?

参与其中

此特性由 SIG Node 推动。

如果你有兴趣参与贡献或提供反馈,

可以通过 Slack(#sig-node)、

邮件列表

或定期举行的

SIG Node 会议

找到我们。

请将缺陷报告提交到 kubernetes/kubernetes,

并将增强提案提交到 kubernetes/enhancements。

Kubernetes v1.36:控制器的陈旧性缓解和可观测性

Kubernetes 控制器中的陈旧性是一个影响许多控制器的问题,它可能以微妙的方式影响控制器行为。 通常直到为时已晚,当生产环境中的控制器已经采取了错误操作时,由于控制器作者做出的某些潜在假设, 陈旧性才被发现是一个问题。 陈旧性导致的一些问题包括控制器采取不正确的操作、控制器在应该采取行动时没有采取行动, 以及控制器采取行动的时间过长。 我很高兴地宣布,Kubernetes v1.36 增加了有助于缓解控制器陈旧性并提供更好的控制器行为可观测性的新特性。

什么是陈旧性?

控制器中的陈旧性来自控制器缓存中过时的状态视图。 为了提供快速的用户体验,控制器通常维护集群状态的本地缓存。 这个缓存通过监视 Kubernetes API 服务器来获取控制器关心的对象的更改来填充。 当控制器需要采取行动时,它首先检查其缓存以查看是否有最新信息。 如果没有,它将通过监视 API 服务器来更新其缓存,以获取控制器关心的对象的更改。 这个过程被称为调谐。

然而,在某些情况下,控制器的缓存可能会过时。 例如,如果控制器重新启动,它需要通过监视 API 服务器来重建其缓存, 以获取控制器关心的对象的更改。在此期间,控制器的缓存将是过时的,它将无法采取行动。 此外,如果 API 服务器宕机,控制器的缓存将不会更新,它也将无法采取行动。 这些只是控制器缓存可能过时的几个例子。

1.36 中的改进

Kubernetes v1.36 改进了 client-go, 并利用 client-go 的改进实现了 kube-controller-manager 中高竞争控制器的改进。

client-go 改进

在 client-go 中,项目添加原子 FIFO 处理(特性门控名称 AtomicFIFO),

它建立在现有的 FIFO 队列实现之上。

新方法允许队列原子地处理批量接收的操作,例如 Informer 用于填充其缓存的

list 操作中的初始对象集。

这确保队列始终处于一致状态,即使事件乱序到达。

在此之前,事件按接收顺序添加到队列中,这可能导致缓存中的状态不一致,无法准确反映集群的状态。

通过此更改,即使事件乱序到达,你现在也可以确保队列始终处于一致状态。

为了利用这一点,使用 client-go 的客户端现在可以查询缓存状态,

以确定控制器缓存所看到的最新资源版本。

这是通过在 Store 接口上新添加的 LastStoreSyncResourceVersion()

函数实现的此处。

此函数是 kube-controller-manager 中陈旧性缓解特性的基础。

kube-controller-manager 改进

在 kube-controller-manager 中,v1.36 版本添加了 4 个不同控制器使用此新特性的能力。 这些控制器是:

- DaemonSet 控制器

- StatefulSet 控制器

- ReplicaSet 控制器

- Job 控制器

这些控制器都作用于 Pod,在大多数情况下,Pod 是集群中竞争最激烈的资源。

这些更改默认对这些控制器启用,

可以通过为要禁用的特定控制器设置特性门控 StaleControllerConsistency<API type> 为 false 来禁用。

例如,要为 DaemonSet 控制器禁用此特性,你需要设置特性门控 StaleControllerConsistencyDaemonSet 为 false。

当相关特性门控启用时, 控制器在采取行动之前将首先检查缓存的最新资源版本。 如果缓存的最新资源版本低于控制器为其尝试协调的对象写入 API 服务器的版本, 控制器将不会采取行动。这是因为控制器的缓存已过时,它没有关于集群状态的最新信息。

面向 Informer 作者的使用方式

使用 client-go 的 Informer 作者也可以立即利用这些改进。

请参阅 ReplicaSet Informer

中如何使用此功能的示例。此 PR 展示了如何使用新功能在采取行动之前检查 Informer 的缓存是否陈旧。

client-go 库提供了一个 ConsistencyStore 数据结构,

它查询存储并将缓存的最新资源版本与对象的写入资源版本进行比较。

ReplicaSet 控制器跟踪 ReplicaSet 的资源版本以及 ReplicaSet 管理的 Pod 的资源版本。 对于特定的 ReplicaSet,它跟踪 ReplicaSet 拥有的 Pod 的最新写入资源版本以及对 ReplicaSet 本身的任何写入。 如果缓存的最新资源版本低于控制器为其尝试协调的对象写入 API 服务器的版本,控制器将不会采取行动。 这是因为控制器的缓存已过时,它没有关于集群状态的最新信息。

Informer 作者可以使用 ConsistencyStore 来跟踪 Informer 关心的对象的最新资源版本。

它提供了 3 个主要函数:

type ConsistencyStore interface {

// WroteAt records that the given object was written at the given resource version.

WroteAt(owningObj runtime.Object, uid types.UID, groupResource schema.GroupResource, resourceVersion string)

// EnsureReady returns true if the cache is up to date for the given object.

// It is used prior to reconciliation to decide whether to reconcile or not.

EnsureReady(namespacedName types.NamespacedName) bool

// Clear removes the given object from the consistency store.

// It is used when an object is deleted.

Clear(namespacedName types.NamespacedName, uid types.UID)

}

WroteAt:当控制器向 API 服务器写入对象时调用此函数。 它用于记录控制器写入 API 服务器的对象的最新资源版本。owningObj是控制器正在协调的对象,uid是该对象的 UID。 资源版本和 GroupResource 是控制器写入 API 服务器的对象的资源版本和 GroupResource。 对象不会被显式跟踪,因为控制器只关心等待赶上写入对象的最新资源版本。EnsureReady:控制器调用此函数以确保对象的缓存是最新的。 它在协调之前用于决定是否进行协调。如果对象的缓存是最新的,它返回 true,否则返回 false。 它将使用WroteAt提供的信息来确定缓存是否是最新的。Clear:当对象被删除时,控制器调用此函数。 它用于从一致性存储中删除对象。 这主要用于在对象被删除时进行清理,以防止一致性存储无限增长。

UID 用于区分具有相同名称的不同对象,例如当对象被删除然后重新创建时。 EnsureReady 不需要它,因为一致性存储只关心赶上对象的最新资源版本,而不是特定对象。 它主要用于确保控制器不会在对象使用新 UID 重新创建时删除该对象的条目。

使用这 3 个函数,Informer 作者可以在其控制器中实现陈旧性缓解。

可观测性

除了陈旧性缓解功能外,Kubernetes 项目还在 1.36 中为 kube-controller-manager 添加了相关的插桩功能。这些指标也默认启用,并使用同一组特性门控进行控制。

指标

以下 Alpha 指标 已在 1.36 中添加到 kube-controller-manager:

stale_sync_skips_total:控制器因缓存陈旧而跳过同步的次数。此指标为使用陈旧性缓解功能的每个控制器公开,带有控制器的子系统标签。

此指标由 kube-controller-manager 指标端点公开,可用于监控控制器的健康状况。

除了此指标外,client-go 还发出公开每个共享 Informer 的最新资源版本的指标,带有 Informer 的子系统标签。 这允许你查看每个 Informer 的最新资源版本,并使用它来确定控制器的缓存是否陈旧, 特别适合与 API 服务器的资源版本进行比较。

此指标名为 store_resource_version,具有 Group、Version 和 Resource 作为标签。

下一步是什么?

Kubernetes SIG API Machinery 很高兴继续开发此功能, 并希望将来将其推广到更多控制器。我们也很想听听你对此特性的反馈。 请在下面的评论中或通过在 Kubernetes GitHub 仓库上打开 Issue 告诉我们你的想法。

我们还正在与 controller-runtime 合作, 为所有使用 controller-runtime 构建的控制器启用这组语义。 这将允许任何使用 controller-runtime 构建的控制器获得"读取自己写入"的好处,而无需自己实现逻辑。

Kubernetes v1.36:细粒度 kubelet API 鉴权正式发布(GA)

我谨代表 Kubernetes SIG Auth 和 SIG Node 宣布,

细粒度 kubelet API 鉴权已在 Kubernetes v1.36 中正式发布(GA)!

KubeletFineGrainedAuthz 特性门控在 Kubernetes v1.32 中作为可选启用的

Alpha 特性引入,并在 v1.33 中进入 Beta 阶段(默认启用)。

如今,该特性已正式发布,且特性门控被锁定为启用状态。

此特性可针对 kubelet 的 HTTPS API 提供更精确、遵循最小权限原则的访问控制,

替代在常见监控与可观测性场景下授予范围过宽的 nodes/proxy 权限的做法。

动机:nodes/proxy 问题

kubelet 暴露了一个 HTTPS 端点,其中包含多个 API,可访问敏感程度不同的数据,

包括 Pod 列表、节点指标、容器日志,以及至关重要的在运行中的容器内执行命令的能力。

在此特性出现之前,kubelet 鉴权采用的是一种粗粒度模型。

启用 webhook 鉴权时,几乎所有 kubelet API 路径都会映射到单一的

nodes/proxy 子资源。

这意味着,任何需要从 kubelet 读取指标或健康状态的工作负载,

都必须拥有 nodes/proxy 权限,而这一权限同时也赋予了在节点上运行的任意容器中执行任意命令的能力。

这有什么问题?

将 nodes/proxy 授予监控代理、日志采集器或健康检查工具,违背了最小权限原则。

一旦这些工作负载中的任何一个被攻破,攻击者就能够在该节点上的每一个容器中执行命令。

nodes/proxy 权限实质上相当于节点级的超级用户能力,

而将其广泛授予会显著扩大安全事件的影响范围。

这个问题多年来一直被社区充分认识到(参见 kubernetes/kubernetes#83465), 也是推动此增强项 KEP-2862 的核心动因。

nodes/proxy GET 的 WebSocket 远程代码执行风险

实际情况比乍看起来更严重。安全研究人员在

2026 年初的研究中演示,

仅凭 nodes/proxy GET 这一通常授予监控工具的最小只读权限,

就可以被滥用来在可访问节点上的任意 Pod 中执行命令。

根本原因在于 WebSocket 连接的工作方式与 kubelet 将 HTTP 方法映射到

RBAC 动词的方式之间存在不匹配。

WebSocket 协议(RFC 6455)

要求在初始连接握手时发起一个 HTTP GET 请求。

kubelet 会将这个 GET 映射为 RBAC get 动词,并在鉴权时不进行二次检查,

以确认后续写操作所需的 create 权限是否同时存在。

攻击者借助 websocat 之类的 WebSocket 客户端,

可以直接访问 10250 端口上的 kubelet /exec 端点,并执行任意命令:

websocat --insecure \

--header "Authorization: Bearer $TOKEN" \

--protocol v4.channel.k8s.io \

"wss://$NODE_IP:10250/exec/default/nginx/nginx?output=1&error=1&command=id"

uid=0(root) gid=0(root) groups=0(root)

细粒度 kubelet 鉴权如何工作

启用 KubeletFineGrainedAuthz 后,kubelet 现在会在回退到 nodes/proxy

子资源之前,先执行一次额外且更具体的鉴权检查。

多个常用的 kubelet API 路径被映射到了各自专属的子资源:

kubelet API | 资源 | 子资源 |

|---|---|---|

/stats/* | nodes | stats |

/metrics/* | nodes | metrics |

/logs/* | nodes | log |

/pods | nodes | pods, proxy |

/runningPods/ | nodes | pods, proxy |

/healthz | nodes | healthz, proxy |

/configz | nodes | configz, proxy |

/spec/* | nodes | spec |

/checkpoint/* | nodes | checkpoint |

| 其他所有路径 | nodes | proxy |

对于现在拥有细粒度子资源的端点(/pods、/runningPods/、/healthz 和

/configz),kubelet 会先针对具体子资源发送一次 SubjectAccessReview。

如果该检查成功,请求即获准通过;如果失败,kubelet 会再使用粗粒度的

nodes/proxy 子资源重试,以保持向后兼容。

这种双重检查方式确保了平滑的迁移路径。

已有的、依赖 nodes/proxy 权限的工作负载仍可继续运行,

而新的部署则可以从一开始就采用最小权限访问方式。

这在实践中意味着什么

以 Prometheus node exporter 或某个需要从 kubelet 抓取 /metrics 的监控

DaemonSet 为例。过去,你需要像下面这样配置一个 RBAC ClusterRole:

# 旧方式:权限范围过宽

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRole

metadata:

name: monitoring-agent

rules:

- apiGroups: [""]

resources: ["nodes/proxy"]

verbs: ["get"]

这赋予了监控代理远超实际所需的访问权限。 有了细粒度鉴权后,你现在可以精确限定权限范围:

# 新方式:遵循最小权限原则

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRole

metadata:

name: monitoring-agent

rules:

- apiGroups: [""]

resources: ["nodes/metrics", "nodes/stats"]

verbs: ["get"]

这样一来,监控代理就可以从 kubelet 读取 metrics 与 stats,

同时完全不具备在容器中执行命令的能力。