这是本节的多页打印视图。

点击此处打印 .

返回本页常规视图 .

调度、抢占和驱逐 在 Kubernetes 中,调度(scheduling)指的是确保 Pod

匹配到合适的节点 ,

以便 kubelet 能够运行它们。

抢占(Preemption)指的是终止低优先级 的

Pod 以便高优先级的 Pod 可以调度到 Node 上的过程。

驱逐(Eviction)是在资源匮乏的节点上,主动让一个或多个 Pod 失效的过程。

调度 Pod 干扰 Pod 干扰 是指节点上的

Pod 被自愿或非自愿终止的过程。

自愿干扰是由应用程序所有者或集群管理员有意启动的。非自愿干扰是无意的,可能由不可避免的问题触发,

如节点耗尽资源 或 Pod 被意外删除。

1 - Kubernetes 调度器 在 Kubernetes 中,调度 是指将 Pod

放置到合适的节点 上,以便对应节点上的

Kubelet 能够运行这些 Pod。

调度概览 调度器通过 Kubernetes 的监测(Watch)机制来发现集群中新创建且尚未被调度到节点上的 Pod。

调度器会将所发现的每一个未调度的 Pod 调度到一个合适的节点上来运行。

调度器会依据下文的调度原则来做出调度选择。

如果你想要理解 Pod 为什么会被调度到特定的节点上,

或者你想要尝试实现一个自定义的调度器,这篇文章将帮助你了解调度。

kube-scheduler kube-scheduler

是 Kubernetes 集群的默认调度器,并且是集群

控制面 的一部分。

如果你真的希望或者有这方面的需求,kube-scheduler

在设计上允许你自己编写一个调度组件并替换原有的 kube-scheduler。

Kube-scheduler 选择一个最佳节点来运行新创建的或尚未调度(unscheduled)的 Pod。

由于 Pod 中的容器和 Pod 本身可能有不同的要求,调度程序会过滤掉任何不满足 Pod 特定调度需求的节点。

或者,API 允许你在创建 Pod 时为它指定一个节点,但这并不常见,并且仅在特殊情况下才会这样做。

在一个集群中,满足一个 Pod 调度请求的所有节点称之为可调度节点 。

如果没有任何一个节点能满足 Pod 的资源请求,

那么这个 Pod 将一直停留在未调度状态直到调度器能够找到合适的 Node。

调度器先在集群中找到一个 Pod 的所有可调度节点,然后根据一系列函数对这些可调度节点打分,

选出其中得分最高的节点来运行 Pod。之后,调度器将这个调度决定通知给

kube-apiserver,这个过程叫做绑定 。

在做调度决定时需要考虑的因素包括:单独和整体的资源请求、硬件/软件/策略限制、

亲和以及反亲和要求、数据局部性、负载间的干扰等等。

kube-scheduler 中的节点选择 kube-scheduler 给一个 Pod 做调度选择时包含两个步骤:

过滤 打分 过滤阶段会将所有满足 Pod 调度需求的节点选出来。

例如,PodFitsResources 过滤函数会检查候选节点的可用资源能否满足 Pod 的资源请求。

在过滤之后,得出一个节点列表,里面包含了所有可调度节点;通常情况下,

这个节点列表包含不止一个节点。如果这个列表是空的,代表这个 Pod 不可调度。

在打分阶段,调度器会为 Pod 从所有可调度节点中选取一个最合适的节点。

根据当前启用的打分规则,调度器会给每一个可调度节点进行打分。

最后,kube-scheduler 会将 Pod 调度到得分最高的节点上。

如果存在多个得分最高的节点,kube-scheduler 会从中随机选取一个。

支持以下两种方式配置调度器的过滤和打分行为:

调度策略

允许你配置过滤所用的 断言(Predicates) 和打分所用的 优先级(Priorities) 。调度配置 允许你配置实现不同调度阶段的插件,

包括:QueueSort、Filter、Score、Bind、Reserve、Permit 等等。

你也可以配置 kube-scheduler 运行不同的配置文件。接下来 2 - 拓扑感知的工作负载调度 特性状态:

Kubernetes v1.36 [alpha](默认禁用)

拓扑感知调度 (Topology-Aware Scheduling,TAS)是一种调度算法 ,

用于为指定的 PodGroup 寻找最优的放置位置,并保证所有 Pod 都被调度到同一拓扑域中。

用户可以通过修改 TAS 插件配置来适配自身的特定需求。

调度框架:TAS 插件配置 调度器包含了新的以及扩展的内置插件,用于实现 TAS 的扩展点:

TopologyPlacement:实现了 PlacementGeneratePlugin 接口。

它通过根据 PodGroup 中定义的拓扑 key 的不同取值对节点进行分组,从而生成候选放置方案。NodeResourcesFit:扩展实现了 PlacementScorePlugin 接口。其逻辑类似于标准的 Pod 装箱,

基于放置中所有节点的资源分配比例对候选方案进行打分。它使用 MostAllocated 策略来最大化放置内的资源利用率,

并继承了逐 Pod 插件中的资源权重设置。PodGroupPodsCount:实现了 PlacementScorePlugin 接口。

它根据在该放置方案中可以成功调度的 PodGroup 中 Pod 的总数量来对候选方案进行评分。自定义插件权重和装箱资源权重 默认情况下,NodeResourcesFit 和 PodGroupPodsCount 插件具有相同的权重(默认均为 1),

以在装箱策略与尽可能多调度 Pod 之间保持良好的平衡。

你可以在 KubeSchedulerConfiguration 中调整这些权重,或修改装箱策略中的资源权重。

以下示例展示了如何更改这两个插件的权重,以及如何覆盖 NodeResourcesFit 的资源权重。

后者的修改将同时应用于逐 Pod 调度和放置评分算法:

apiVersion : kubescheduler.config.k8s.io/v1

kind : KubeSchedulerConfiguration

profiles :

- schedulerName : default-scheduler

plugins :

placementScore :

enabled :

# 1) 修改放置评分插件的默认权重

- name : NodeResourcesFit

weight : 2

- name : PodGroupPodsCount

weight : 5

pluginConfig :

- name : NodeResourcesFit

args :

# 2) 修改逐 Pod 和放置评分算法中的资源评分权重

scoringStrategy :

# 此类别仅在逐 Pod 调度中生效。放置评分始终使用 MostAllocated 策略

type : LeastAllocated

# 资源权重将同时应用于逐 Pod 和放置评分算法

resources :

- name : cpu

weight : 2

- name : memory

weight : 3

接下来 3 - 将 Pod 指派给节点 你可以约束一个 Pod

以便限制 其只能在特定的节点 上运行,

或优先在特定的节点上运行。有几种方法可以实现这点,

推荐的方法都是用标签选择算符 来进行选择。

通常这样的约束不是必须的,因为调度器将自动进行合理的放置(比如,将 Pod 分散到节点上,

而不是将 Pod 放置在可用资源不足的节点上等等)。但在某些情况下,你可能需要进一步控制

Pod 被部署到哪个节点。例如,确保 Pod 最终落在连接了 SSD 的机器上,

或者将来自两个不同的服务且有大量通信的 Pod 被放置在同一个可用区。

你可以使用下列方法中的任何一种来选择 Kubernetes 对特定 Pod 的调度:

节点标签 与很多其他 Kubernetes 对象类似,节点也有标签 。

你可以手动地添加标签 。

Kubernetes 也会为集群中所有节点添加一些标准的标签 。

说明: 这些标签的取值是取决于云提供商的,并且是无法在可靠性上给出承诺的。

例如,kubernetes.io/hostname 的取值在某些环境中可能与节点名称相同,

而在其他环境中会取不同的值。

节点隔离/限制 通过为节点添加标签,你可以准备让 Pod 调度到特定节点或节点组上。

你可以使用这个功能来确保特定的 Pod 只能运行在具有一定隔离性、安全性或监管属性的节点上。

如果使用标签来实现节点隔离,建议选择节点上的

kubelet

无法修改的标签键。

这可以防止受感染的节点在自身上设置这些标签,进而影响调度器将工作负载调度到受感染的节点。

NodeRestriction 准入插件node-restriction.kubernetes.io/ 前缀设置或修改标签。

要使用该标签前缀进行节点隔离:

确保你在使用节点鉴权 机制并且已经启用了

NodeRestriction 准入插件 。 将带有 node-restriction.kubernetes.io/ 前缀的标签添加到 Node 对象,

然后在节点选择算符 中使用这些标签。

例如,example.com.node-restriction.kubernetes.io/fips=true 或

example.com.node-restriction.kubernetes.io/pci-dss=true。 nodeSelector nodeSelector 是节点选择约束的最简单推荐形式。你可以将 nodeSelector 字段添加到

Pod 的规约中设置你希望目标节点所具有的节点标签 。

Kubernetes 只会将 Pod 调度到拥有你所指定的每个标签的节点上。

进一步的信息可参见将 Pod 指派给节点 。

亲和性与反亲和性 nodeSelector 提供了一种最简单的方法来将 Pod 约束到具有特定标签的节点上。

亲和性和反亲和性扩展了你可以定义的约束类型。使用亲和性与反亲和性的一些好处有:

亲和性、反亲和性语言的表达能力更强。nodeSelector 只能选择拥有所有指定标签的节点。

亲和性、反亲和性为你提供对选择逻辑的更强控制能力。 你可以标明某规则是“软需求”或者“偏好”,这样调度器在无法找到匹配节点时仍然调度该 Pod。 你可以使用节点上(或其他拓扑域中)运行的其他 Pod 的标签来实施调度约束,

而不是只能使用节点本身的标签。这个能力让你能够定义规则允许哪些 Pod 可以被放置在一起。 亲和性功能由两种类型的亲和性组成:

节点亲和性 功能类似于 nodeSelector 字段,但它的表达能力更强,并且允许你指定软规则。Pod 间亲和性/反亲和性允许你根据其他 Pod 的标签来约束 Pod。 节点亲和性 节点亲和性概念上类似于 nodeSelector,

它使你可以根据节点上的标签来约束 Pod 可以调度到哪些节点上。

节点亲和性有两种:

requiredDuringSchedulingIgnoredDuringExecution:

调度器只有在规则被满足的时候才能执行调度。此功能类似于 nodeSelector,

但其语法表达能力更强。preferredDuringSchedulingIgnoredDuringExecution:

调度器会尝试寻找满足对应规则的节点。如果找不到匹配的节点,调度器仍然会调度该 Pod。说明: 在上述类型中,IgnoredDuringExecution 意味着如果节点标签在 Kubernetes

调度 Pod 后发生了变更,Pod 仍将继续运行。

你可以使用 Pod 规约中的 .spec.affinity.nodeAffinity 字段来设置节点亲和性。

例如,考虑下面的 Pod 规约:

apiVersion : v1

kind : Pod

metadata :

name : with-node-affinity

spec :

affinity :

nodeAffinity :

requiredDuringSchedulingIgnoredDuringExecution :

nodeSelectorTerms :

- matchExpressions :

- key : topology.kubernetes.io/zone

operator : In

values :

- antarctica-east1

- antarctica-west1

preferredDuringSchedulingIgnoredDuringExecution :

- weight : 1

preference :

matchExpressions :

- key : another-node-label-key

operator : In

values :

- another-node-label-value

containers :

- name : with-node-affinity

image : registry.k8s.io/pause:2.0在这一示例中,所应用的规则如下:

节点必须 包含一个键名为 topology.kubernetes.io/zone 的标签,

并且该标签的取值必须 为 antarctica-east1 或 antarctica-west1。 节点最好 具有一个键名为 another-node-label-key 且取值为

another-node-label-value 的标签。 你可以使用 operator 字段来为 Kubernetes 设置在解释规则时要使用的逻辑操作符。

你可以使用 In、NotIn、Exists、DoesNotExist、Gt 和 Lt 之一作为操作符。

阅读操作符 了解有关这些操作的更多信息。

Pod 拓扑标签 特性状态:

Kubernetes v1.35 [beta](默认启用)

如果 Pod 所属的节点存在拓扑标签(topology.kubernetes.io/zone

和 topology.kubernetes.io/region),

则 Pod 会继承这些标签。然后,Pod 可以通过 Downward API 使用这些标签,

使工作负载能够感知节点拓扑结构。

以下是一个 Pod 使用 Downward API 获取其 zone 和 region 的示例:

apiVersion : v1

kind : Pod

metadata :

name : pod-with-topology-labels

spec :

containers :

- name : app

image : alpine

command : ["sh" , "-c" , "env" ]

env :

- name : MY_ZONE

valueFrom :

fieldRef :

fieldPath : metadata.labels['topology.kubernetes.io/zone']

- name : MY_REGION

valueFrom :

fieldRef :

fieldPath : metadata.labels['topology.kubernetes.io/region']

NotIn 和 DoesNotExist 可用来实现节点反亲和性行为。

你也可以使用节点污点

将 Pod 从特定节点上驱逐。

说明: 如果你同时指定了 nodeSelector 和 nodeAffinity,两者 必须都要满足,

才能将 Pod 调度到候选节点上。

如果你在与 nodeAffinity 类型关联的 nodeSelectorTerms 中指定多个条件,

只要其中一个 nodeSelectorTerms 满足(各个条件按逻辑或操作组合)的话,

Pod 就可以被调度到节点上。

如果你在与 nodeSelectorTerms 中的条件相关联的单个 matchExpressions 字段中指定多个表达式,

则只有当所有表达式都满足(各表达式按逻辑与操作组合)时,Pod 才能被调度到节点上。

参阅使用节点亲和性来为 Pod 指派节点 ,

以了解进一步的信息。

节点亲和性权重 你可以为 preferredDuringSchedulingIgnoredDuringExecution 亲和性类型的每个实例设置

weight 字段,其取值范围是 1 到 100。

当调度器找到能够满足 Pod 的其他调度请求的节点时,调度器会遍历节点满足的所有的偏好性规则,

并将对应表达式的 weight 值加和。

最终的加和值会添加到该节点的其他优先级函数的评分之上。

在调度器为 Pod 作出调度决定时,总分最高的节点的优先级也最高。

例如,考虑下面的 Pod 规约:

apiVersion : v1

kind : Pod

metadata :

name : with-affinity-preferred-weight

spec :

affinity :

nodeAffinity :

requiredDuringSchedulingIgnoredDuringExecution :

nodeSelectorTerms :

- matchExpressions :

- key : kubernetes.io/os

operator : In

values :

- linux

preferredDuringSchedulingIgnoredDuringExecution :

- weight : 1

preference :

matchExpressions :

- key : label-1

operator : In

values :

- key-1

- weight : 50

preference :

matchExpressions :

- key : label-2

operator : In

values :

- key-2

containers :

- name : with-node-affinity

image : registry.k8s.io/pause:2.0

如果存在两个候选节点,都满足 preferredDuringSchedulingIgnoredDuringExecution 规则,

其中一个节点具有标签 label-1:key-1,另一个节点具有标签 label-2:key-2,

调度器会考察各个节点的 weight 取值,并将该权重值添加到节点的其他得分值之上,

说明: 如果你希望 Kubernetes 能够成功地调度此例中的 Pod,你必须拥有打了

kubernetes.io/os=linux 标签的节点。

逐个调度方案中设置节点亲和性 特性状态:

Kubernetes v1.20 [beta]

在配置多个调度方案 时,

你可以将某个方案与节点亲和性关联起来,如果某个调度方案仅适用于某组特殊的节点时,

这样做是很有用的。

要实现这点,可以在调度器配置 中为

NodeAffinity 插件args 字段添加 addedAffinity。例如:

apiVersion : kubescheduler.config.k8s.io/v1

kind : KubeSchedulerConfiguration

profiles :

- schedulerName : default-scheduler

- schedulerName : foo-scheduler

pluginConfig :

- name : NodeAffinity

args :

addedAffinity :

requiredDuringSchedulingIgnoredDuringExecution :

nodeSelectorTerms :

- matchExpressions :

- key : scheduler-profile

operator : In

values :

- foo

这里的 addedAffinity 除遵从 Pod 规约中设置的节点亲和性之外,

还适用于将 .spec.schedulerName 设置为 foo-scheduler。

换言之,为了匹配 Pod,节点需要满足 addedAffinity 和 Pod 的 .spec.NodeAffinity。

由于 addedAffinity 对最终用户不可见,其行为可能对用户而言是出乎意料的。

应该使用与调度方案名称有明确关联的节点标签。

说明: DaemonSet 控制器为 DaemonSet 创建 Pod ,

但该控制器不理会调度方案。

DaemonSet 控制器创建 Pod 时,默认的 Kubernetes 调度器负责放置 Pod,

并遵从 DaemonSet 控制器中设置的 nodeAffinity 规则。

Pod 间亲和性与反亲和性 Pod 间亲和性与反亲和性使你可以基于已经在节点上运行的 Pod 的标签来约束

Pod 可以调度到的节点,而不是基于节点上的标签。

Pod 间亲和性与反亲和性的类型 Pod 间亲和性与反亲和性的格式为“如果 X 上已经运行了一个或多个满足规则 Y 的 Pod,

则这个 Pod 应该(或者在反亲和性的情况下不应该)运行在 X 上”。

这里的 X 可以是节点、机架、云提供商可用区或地理区域或类似的拓扑域,

Y 则是 Kubernetes 尝试满足的规则。

你通过标签选择算符

的形式来表达规则(Y),并可根据需要指定选关联的名字空间列表。

Pod 在 Kubernetes 中是名字空间作用域的对象,因此 Pod 的标签也隐式地具有名字空间属性。

针对 Pod 标签的所有标签选择算符都要指定名字空间,Kubernetes

会在指定的名字空间内寻找标签。

你会通过 topologyKey 来表达拓扑域(X)的概念,其取值是系统用来标示域的节点标签键。

相关示例可参见常用标签、注解和污点 。

说明: Pod 间亲和性和反亲和性都需要相当的计算量,因此会在大规模集群中显著降低调度速度。

我们不建议在包含数百个节点的集群中使用这类设置。

说明: Pod 反亲和性需要节点上存在一致性的标签。换言之,

集群中每个节点都必须拥有与 topologyKey 匹配的标签。

如果某些或者所有节点上不存在所指定的 topologyKey 标签,调度行为可能与预期的不同。

与节点亲和性 类似,Pod 的亲和性与反亲和性也有两种类型:

requiredDuringSchedulingIgnoredDuringExecutionpreferredDuringSchedulingIgnoredDuringExecution例如,你可以使用 requiredDuringSchedulingIgnoredDuringExecution 亲和性来告诉调度器,

将两个服务的 Pod 放到同一个云提供商可用区内,因为它们彼此之间通信非常频繁。

类似地,你可以使用 preferredDuringSchedulingIgnoredDuringExecution

反亲和性来将同一服务的多个 Pod 分布到多个云提供商可用区中。

要使用 Pod 间亲和性,可以使用 Pod 规约中的 .affinity.podAffinity 字段。

对于 Pod 间反亲和性,可以使用 Pod 规约中的 .affinity.podAntiAffinity 字段。

调度行为 在调度新 Pod 时,Kubernetes 调度器会根据当前集群状态评估 Pod 的亲和性/反亲和性规则:

硬约束(节点过滤):podAffinity.requiredDuringSchedulingIgnoredDuringExecution 和

podAntiAffinity.requiredDuringSchedulingIgnoredDuringExecution:调度器基于现有 Pod,确保新 Pod 被分配到满足这些必需的亲和性和反亲和性规则的节点上。 软约束(评分):podAffinity.preferredDuringSchedulingIgnoredDuringExecution 和

podAntiAffinity.preferredDuringSchedulingIgnoredDuringExecution:调度器根据节点满足这些优选的亲和性和反亲和性规则的程度来评分,以优化 Pod 的放置。 忽略的字段:现有 Pod 的 podAffinity.preferredDuringSchedulingIgnoredDuringExecution:在为新 Pod 做调度决策时,不会考虑这些优选的亲和性规则。 现有 Pod 的 podAntiAffinity.preferredDuringSchedulingIgnoredDuringExecution:同样,在调度时会忽略现有 Pod 的优选反亲和性规则。 调度一组具有 Pod 间亲和性的 Pod 如果当前正被调度的 Pod 在具有自我亲和性的 Pod 序列中排在第一个,

那么只要它满足其他所有的亲和性规则,它就可以被成功调度。

这是通过以下方式确定的:确保集群中没有其他 Pod 与此 Pod 的名字空间和标签选择算符匹配;

该 Pod 满足其自身定义的条件,并且选定的节点满足所指定的所有拓扑要求。

这确保即使所有的 Pod 都配置了 Pod 间亲和性,也不会出现调度死锁的情况。

Pod 亲和性示例 考虑下面的 Pod 规约:

apiVersion : v1

kind : Pod

metadata :

name : with-pod-affinity

spec :

affinity :

podAffinity :

requiredDuringSchedulingIgnoredDuringExecution :

- labelSelector :

matchExpressions :

- key : security

operator : In

values :

- S1

topologyKey : topology.kubernetes.io/zone

podAntiAffinity :

preferredDuringSchedulingIgnoredDuringExecution :

- weight : 100

podAffinityTerm :

labelSelector :

matchExpressions :

- key : security

operator : In

values :

- S2

topologyKey : topology.kubernetes.io/zone

containers :

- name : with-pod-affinity

image : registry.k8s.io/pause:2.0

本示例定义了一条 Pod 亲和性规则和一条 Pod 反亲和性规则。Pod 亲和性规则配置为

requiredDuringSchedulingIgnoredDuringExecution,而 Pod 反亲和性配置为

preferredDuringSchedulingIgnoredDuringExecution。

亲和性规则规定,只有节点属于特定的区域

且该区域中的其他 Pod 已打上 security=S1 标签时,调度器才可以将示例 Pod 调度到此节点上。

例如,如果我们有一个具有指定区域(称之为 "Zone V")的集群,此区域由带有 topology.kubernetes.io/zone=V

标签的节点组成,那么只要 Zone V 内已经至少有一个 Pod 打了 security=S1 标签,

调度器就可以将此 Pod 调度到 Zone V 内的任何节点。相反,如果 Zone V 中没有带有 security=S1 标签的 Pod,

则调度器不会将示例 Pod 调度给该区域中的任何节点。

反亲和性规则规定,如果节点属于特定的区域

且该区域中的其他 Pod 已打上 security=S2 标签,则调度器应尝试避免将 Pod 调度到此节点上。

例如,如果我们有一个具有指定区域(我们称之为 "Zone R")的集群,此区域由带有 topology.kubernetes.io/zone=R

标签的节点组成,只要 Zone R 内已经至少有一个 Pod 打了 security=S2 标签,

调度器应避免将 Pod 分配给 Zone R 内的任何节点。相反,如果 Zone R 中没有带有 security=S2 标签的 Pod,

则反亲和性规则不会影响将 Pod 调度到 Zone R。

查阅设计文档

以进一步熟悉 Pod 亲和性与反亲和性的示例。

你可以针对 Pod 间亲和性与反亲和性为其 operator 字段使用 In、NotIn、Exists、DoesNotExist 等值。

阅读操作符 了解有关这些操作的更多信息。

原则上,topologyKey 可以是任何合法的标签键。出于性能和安全原因,topologyKey

有一些限制:

对于 Pod 亲和性而言,在 requiredDuringSchedulingIgnoredDuringExecution

和 preferredDuringSchedulingIgnoredDuringExecution 中,topologyKey

不允许为空。 对于 requiredDuringSchedulingIgnoredDuringExecution 要求的 Pod 反亲和性,

准入控制器 LimitPodHardAntiAffinityTopology 要求 topologyKey 只能是

kubernetes.io/hostname。如果你希望使用其他定制拓扑逻辑,

你可以更改准入控制器或者禁用之。 除了 labelSelector 和 topologyKey,你也可以指定 labelSelector

要匹配的名字空间列表,方法是在 labelSelector 和 topologyKey

所在层同一层次上设置 namespaces。

如果 namespaces 被忽略或者为空,则默认为 Pod 亲和性/反亲和性的定义所在的名字空间。

名字空间选择算符 特性状态:

Kubernetes v1.24 [stable]

用户也可以使用 namespaceSelector 选择匹配的名字空间,namespaceSelector

是对名字空间集合进行标签查询的机制。

亲和性条件会应用到 namespaceSelector 所选择的名字空间和 namespaces 字段中所列举的名字空间之上。

注意,空的 namespaceSelector({})会匹配所有名字空间,而 null 或者空的

namespaces 列表以及 null 值 namespaceSelector 意味着“当前 Pod 的名字空间”。

matchLabelKeys 特性状态:

Kubernetes v1.33 [stable](默认启用)

说明: matchLabelKeys 字段是一个 Beta 级别的字段,在 Kubernetes 1.36 中默认被启用。

当你想要禁用此字段时,你必须通过 MatchLabelKeysInPodAffinity

特性门控 禁用它。

Kubernetes 在 Pod 亲和性或反亲和性中包含一个可选的 matchLabelKeys 字段。

此字段指定了应与传入 Pod 的标签匹配的标签键,以满足 Pod 的(反)亲和性。

这些键用于从 Pod 的标签中查找值;这些键值标签与使用 labelSelector

字段定义的匹配限制组合(使用 AND 操作)。

这种组合的过滤机制选择将用于 Pod(反)亲和性计算的现有 Pod 集合。

注意: 不建议在 matchLabelKeys 中使用可能会直接在 Pod 上更新的标签。

即使你编辑直接 在 matchLabelKeys 中指定的 Pod 的标签

(也就是说,不是通过 Deployment 进行更新),

kube-apiserver 也不会将这种标签的更新反映到合并后的 labelSelector 上。

一个常见的用例是在 matchLabelKeys 中使用 pod-template-hash

(设置在作为 Deployment 的一部分进行管理的 Pod 上,其中每个版本的值是唯一的)。

在 matchLabelKeys 中使用 pod-template-hash 允许你定位与传入 Pod 相同版本的 Pod,

确保滚动升级不会破坏亲和性。

apiVersion : apps/v1

kind : Deployment

metadata :

name : application-server

...

spec :

template :

spec :

affinity :

podAffinity :

requiredDuringSchedulingIgnoredDuringExecution :

- labelSelector :

matchExpressions :

- key : app

operator : In

values :

- database

topologyKey : topology.kubernetes.io/zone

# 只有在计算 Pod 亲和性时,才考虑指定上线的 Pod。

# 如果你更新 Deployment,替代的 Pod 将遵循它们自己的亲和性规则

# (如果在新的 Pod 模板中定义了任何规则)。

matchLabelKeys :

- pod-template-hash

mismatchLabelKeys 特性状态:

Kubernetes v1.33 [stable](默认启用)

说明: mismatchLabelKeys 字段是一个 Beta 级别的字段,在 Kubernetes 1.36 中默认被禁用。

当你想要禁用此字段时,你必须通过 MatchLabelKeysInPodAffinity

特性门控 禁用它。

Kubernetes 为 Pod 亲和性或反亲和性提供了一个可选的 mismatchLabelKeys 字段。

此字段指定了在满足 Pod(反)亲和性时,不应与传入 Pod 的标签匹配的键。

注意: 不建议在 matchLabelKeys 中使用可能会直接在 Pod 上更新的标签。

即使你编辑直接 在 matchLabelKeys 中指定的 Pod 的标签

(也就是说,不是通过 Deployment 进行更新),

kube-apiserver 也不会将这种标签的更新反映到合并后的 labelSelector 上。

一个示例用例是确保 Pod 进入指定的拓扑域(节点、区域等),在此拓扑域中只调度来自同一租户或团队的 Pod。

换句话说,你想要避免在同一拓扑域中同时运行来自两个不同租户的 Pod。

apiVersion : v1

kind : Pod

metadata :

labels :

# 假设所有相关的 Pod 都设置了 “tenant” 标签

tenant : tenant-a

...

spec :

affinity :

podAffinity :

requiredDuringSchedulingIgnoredDuringExecution :

# 确保与此租户关联的 Pod 落在正确的节点池上

- matchLabelKeys :

- tenant

labelSelector : {}

topologyKey : node-pool

podAntiAffinity :

requiredDuringSchedulingIgnoredDuringExecution :

# 确保与此租户关联的 Pod 不能调度到用于其他租户的节点上

- mismatchLabelKeys :

- tenant # 无论此 Pod 的 “tenant” 标签的值是什么,

# 如果节点池中有来自别的租户的任何 Pod 在运行,

# 都会阻碍此 Pod 被调度到这些节点池中的节点上

labelSelector :

# 我们必须有一个 labelSelector,只选择具有 “tenant” 标签的 Pod,

# 否则此 Pod 也会与来自 DaemonSet 的 Pod 产生反亲和性,

# 例如,这些 Pod 不应该具有 “tenant” 标签

matchExpressions :

- key : tenant

operator : Exists

topologyKey : node-pool

更实际的用例 Pod 间亲和性与反亲和性在与更高级别的集合(例如 ReplicaSet、StatefulSet、Deployment

等)一起使用时,它们可能更加有用。

这些规则使得你可以配置一组工作负载,使其位于所定义的同一拓扑中;

例如优先将两个相关的 Pod 置于相同的节点上。

以一个三节点的集群为例。你使用该集群运行一个带有内存缓存(例如 Redis)的 Web 应用程序。

在此例中,还假设 Web 应用程序和内存缓存之间的延迟应尽可能低。

你可以使用 Pod 间的亲和性和反亲和性来尽可能地将该 Web 服务器与缓存并置。

在下面的 Redis 缓存 Deployment 示例中,副本上设置了标签 app=store。

podAntiAffinity 规则告诉调度器避免将多个带有 app=store 标签的副本部署到同一节点上。

因此,每个独立节点上会创建一个缓存实例。

apiVersion : apps/v1

kind : Deployment

metadata :

name : redis-cache

spec :

selector :

matchLabels :

app : store

replicas : 3

template :

metadata :

labels :

app : store

spec :

affinity :

podAntiAffinity :

requiredDuringSchedulingIgnoredDuringExecution :

- labelSelector :

matchExpressions :

- key : app

operator : In

values :

- store

topologyKey : "kubernetes.io/hostname"

containers :

- name : redis-server

image : redis:3.2-alpine

下例的 Deployment 为 Web 服务器创建带有标签 app=web-store 的副本。

Pod 亲和性规则告诉调度器将每个副本放到存在标签为 app=store 的 Pod 的节点上。

Pod 反亲和性规则告诉调度器决不要在单个节点上放置多个 app=web-store 服务器。

apiVersion : apps/v1

kind : Deployment

metadata :

name : web-server

spec :

selector :

matchLabels :

app : web-store

replicas : 3

template :

metadata :

labels :

app : web-store

spec :

affinity :

podAntiAffinity :

requiredDuringSchedulingIgnoredDuringExecution :

- labelSelector :

matchExpressions :

- key : app

operator : In

values :

- web-store

topologyKey : "kubernetes.io/hostname"

podAffinity :

requiredDuringSchedulingIgnoredDuringExecution :

- labelSelector :

matchExpressions :

- key : app

operator : In

values :

- store

topologyKey : "kubernetes.io/hostname"

containers :

- name : web-app

image : nginx:1.16-alpine

创建前面两个 Deployment 会产生如下的集群布局,每个 Web 服务器与一个缓存实例并置,

并分别运行在三个独立的节点上。

node-1 node-2 node-3 webserver-1 webserver-2 webserver-3 cache-1 cache-2 cache-3

总体效果是每个缓存实例都非常可能被在同一个节点上运行的某个客户端访问,

这种方法旨在最大限度地减少偏差(负载不平衡)和延迟。

你可能还有使用 Pod 反亲和性的一些其他原因。

参阅 ZooKeeper 教程

了解一个 StatefulSet 的示例,该 StatefulSet 配置了反亲和性以实现高可用,

所使用的是与此例相同的技术。

nodeName nodeName 是比亲和性或者 nodeSelector 更为直接的形式。nodeName 是 Pod

规约中的一个字段。如果 nodeName 字段不为空,调度器会忽略该 Pod,

而指定节点上的 kubelet 会尝试将 Pod 放到该节点上。

使用 nodeName 规则的优先级会高于使用 nodeSelector 或亲和性与非亲和性的规则。

使用 nodeName 来选择节点的方式有一些局限性:

如果所指代的节点不存在,则 Pod 无法运行,而且在某些情况下可能会被自动删除。 如果所指代的节点无法提供用来运行 Pod 所需的资源,Pod 会失败,

而其失败原因中会给出是否因为内存或 CPU 不足而造成无法运行。 在云环境中的节点名称并不总是可预测的,也不总是稳定的。 警告: nodeName 旨在供自定义调度器或需要绕过任何已配置调度器的高级场景使用。

如果已分配的 Node 负载过重,绕过调度器可能会导致 Pod 失败。

你可以使用节点亲和性 或 nodeselector 字段

下面是一个使用 nodeName 字段的 Pod 规约示例:

apiVersion : v1

kind : Pod

metadata :

name : nginx

spec :

containers :

- name : nginx

image : nginx

nodeName : kube-01

上面的 Pod 只能运行在节点 kube-01 之上。

nominatedNodeName 特性状态:

Kubernetes v1.35 [beta](默认启用)

外部组件可以使用 nominatedNodeName 为待处理的 Pod 提名节点。

这种提名是尽力而为的:如果调度器确定 Pod 不能进入被提名的节点,

那么这个提名可能会被忽略。

此外,此字段可以由调度器(重新)写入:

如果调度器通过抢占找到一个可提名的节点。 如果调度器决定了 Pod 的去向,并将其移至绑定阶段。注意,在这种情况下,仅当 Pod 必须经过 WaitOnPermit 或

PreBind 扩展点时,才会设置 nominatedNodeName。 以下是使用 nominatedNodeName 字段的 Pod 状态示例:

apiVersion : v1

kind : Pod

metadata :

name : nginx

...

status :

nominatedNodeName : kube-01

Pod 拓扑分布约束 你可以使用 拓扑分布约束(Topology Spread Constraints) 来控制

Pod 在集群内故障域之间的分布,

故障域的示例有区域(Region)、可用区(Zone)、节点和其他用户自定义的拓扑域。

这样做有助于提升性能、实现高可用或提升资源利用率。

阅读 Pod 拓扑分布约束

以进一步了解这些约束的工作方式。

操作符 下面是你可以在上述 nodeAffinity 和 podAffinity 的 operator

字段中可以使用的所有逻辑运算符。

操作符 行为 In标签值存在于提供的字符串集中 NotIn标签值不包含在提供的字符串集中 Exists对象上存在具有此键的标签 DoesNotExist对象上不存在具有此键的标签

以下操作符只能与 nodeAffinity 一起使用。

操作符 行为 Gt字段值将被解析为整数,并且解析由该选择器指定的标签的值所得到的整数大于此整数 Lt字段值将被解析为整数,并且解析由该选择器指定的标签的值所得到的整数小于此整数

说明: Gt 和 Lt 操作符不能与非整数值一起使用。

如果给定的值未解析为整数,则该 Pod 将无法被调度。

另外,Gt 和 Lt 不适用于 podAffinity。

接下来 4 - Pod 开销 特性状态:

Kubernetes v1.24 [stable]

在节点上运行 Pod 时,Pod 本身占用大量系统资源。这些是运行 Pod 内容器所需资源之外的资源。

在 Kubernetes 中,POD 开销 是一种方法,用于计算 Pod 基础设施在容器请求和限制之上消耗的资源。

在 Kubernetes 中,Pod 的开销是根据与 Pod 的 RuntimeClass

相关联的开销在准入 时设置的。

在调度 Pod 时,除了考虑容器资源请求的总和外,还要考虑 Pod 开销。

类似地,kubelet 将在确定 Pod cgroups 的大小和执行 Pod 驱逐排序时也会考虑 Pod 开销。

配置 Pod 开销 你需要确保使用一个定义了 overhead 字段的 RuntimeClass。

使用示例 要使用 Pod 开销,你需要一个定义了 overhead 字段的 RuntimeClass。

例如,你可以使用以下 RuntimeClass 定义,其中使用了一个虚拟化容器运行时(在这个例子中,Kata Containers 与 Firecracker 虚拟机监视器结合使用),

每个 Pod 使用大约 120MiB 的虚拟机和寄宿操作系统:

# 你需要修改这个示例以匹配实际的运行时名称,

# 以及在你的集群中运行时在 Pod 层面增加的资源开销。

apiVersion : node.k8s.io/v1

kind : RuntimeClass

metadata :

name : kata-fc

handler : kata-fc

overhead :

podFixed :

memory : "120Mi"

cpu : "250m"

通过指定 kata-fc RuntimeClass 处理程序创建的工作负载会将内存和 CPU

开销计入资源配额计算、节点调度以及 Pod cgroup 尺寸确定。

假设我们运行下面给出的工作负载示例 test-pod:

apiVersion : v1

kind : Pod

metadata :

name : test-pod

spec :

runtimeClassName : kata-fc

containers :

- name : busybox-ctr

image : busybox:1.28

stdin : true

tty : true

resources :

limits :

cpu : 500m

memory : 100Mi

- name : nginx-ctr

image : nginx

resources :

limits :

cpu : 1500m

memory : 100Mi

说明: 如果在 Pod 定义中只设置了 limits,kubelet 将根据 limits 推断 requests,并将其设置与 limits 相同的值。

在准入阶段 RuntimeClass 准入控制器

更新工作负载的 PodSpec 以包含

RuntimeClass 中定义的 overhead。如果 PodSpec 中已定义该字段,该 Pod 将会被拒绝。

在这个例子中,由于只指定了 RuntimeClass 名称,所以准入控制器更新了 Pod,使之包含 overhead。

在 RuntimeClass 准入控制器进行修改后,你可以查看更新后的 Pod 开销值:

kubectl get pod test-pod -o jsonpath = '{.spec.overhead}'

输出:

map[cpu:250m memory:120Mi]

如果定义了 ResourceQuota ,

则容器请求的总量以及 overhead 字段都将计算在内。

当 kube-scheduler 决定在哪一个节点调度运行新的 Pod 时,调度器会兼顾该 Pod 的

overhead 以及该 Pod 的容器请求总量。在这个示例中,调度器将资源请求和开销相加,

然后寻找具备 2.25 CPU 和 320 MiB 内存可用的节点。

一旦 Pod 被调度到了某个节点, 该节点上的 kubelet 将为该 Pod 新建一个

cgroup 。 底层容器运行时将在这个

Pod 中创建容器。

如果该资源对每一个容器都定义了一个限制(定义了限制值的 Guaranteed QoS 或者

Burstable QoS),kubelet 会为与该资源(CPU 的 cpu.cfs_quota_us 以及内存的

memory.limit_in_bytes)

相关的 Pod cgroup 设定一个上限。该上限基于 PodSpec 中定义的容器限制总量与 overhead 之和。

对于 CPU,如果 Pod 的 QoS 是 Guaranteed 或者 Burstable,kubelet 会基于容器请求总量与

PodSpec 中定义的 overhead 之和设置 cpu.shares。

请看这个例子,验证工作负载的容器请求:

kubectl get pod test-pod -o jsonpath = '{.spec.containers[*].resources.limits}'

容器请求总计 2000m CPU 和 200MiB 内存:

map[cpu: 500m memory:100Mi] map[cpu:1500m memory:100Mi]

对照从节点观察到的情况来检查一下:

kubectl describe node | grep test-pod -B2

该输出显示请求了 2250m CPU 以及 320MiB 内存。请求包含了 Pod 开销在内:

Namespace Name CPU Requests CPU Limits Memory Requests Memory Limits AGE

--------- ---- ------------ ---------- --------------- ------------- ---

default test-pod 2250m (56%) 2250m (56%) 320Mi (1%) 320Mi (1%) 36m

验证 Pod cgroup 限制 在工作负载所运行的节点上检查 Pod 的内存 cgroups。在接下来的例子中,

将在该节点上使用具备 CRI 兼容的容器运行时命令行工具

crictl

# 在该 Pod 被调度到的节点上执行如下命令:

POD_ID = " $( sudo crictl pods --name test-pod -q) "

可以依此判断该 Pod 的 cgroup 路径:

# 在该 Pod 被调度到的节点上执行如下命令:

sudo crictl inspectp -o= json $POD_ID | grep cgroupsPath

执行结果的 cgroup 路径中包含了该 Pod 的 pause 容器。Pod 级别的 cgroup 在即上一层目录。

"cgroupsPath": "/kubepods/podd7f4b509-cf94-4951-9417-d1087c92a5b2/7ccf55aee35dd16aca4189c952d83487297f3cd760f1bbf09620e206e7d0c27a"

在这个例子中,该 Pod 的 cgroup 路径是 kubepods/podd7f4b509-cf94-4951-9417-d1087c92a5b2。

验证内存的 Pod 级别 cgroup 设置:

# 在该 Pod 被调度到的节点上执行这个命令。

# 另外,修改 cgroup 的名称以匹配为该 Pod 分配的 cgroup。

cat /sys/fs/cgroup/memory/kubepods/podd7f4b509-cf94-4951-9417-d1087c92a5b2/memory.limit_in_bytes

和预期的一样,这一数值为 320 MiB。

335544320

可观察性 在 kube-state-metrics 中可以通过

kube_pod_overhead_* 指标来协助确定何时使用 Pod 开销,

以及协助观察以一个既定开销运行的工作负载的稳定性。

该特性在 kube-state-metrics 的 1.9 发行版本中不可用,不过预计将在后续版本中发布。

在此之前,用户需要从源代码构建 kube-state-metrics。

接下来 5 - Pod 调度就绪态 特性状态:

Kubernetes v1.30 [stable]

Pod 一旦创建就被认为准备好进行调度。

Kubernetes 调度程序尽职尽责地寻找节点来放置所有待处理的 Pod。

然而,在实际环境中,会有一些 Pod 可能会长时间处于"缺少必要资源"状态。

这些 Pod 实际上以一种不必要的方式扰乱了调度器(以及 Cluster AutoScaler 这类下游的集成方)。

通过指定或删除 Pod 的 .spec.schedulingGates,可以控制 Pod 何时准备好被纳入考量进行调度。

配置 Pod schedulingGates schedulingGates 字段包含一个字符串列表,每个字符串文字都被视为 Pod 在被认为可调度之前应该满足的标准。

该字段只能在创建 Pod 时初始化(由客户端创建,或在准入期间更改)。

创建后,每个 schedulingGate 可以按任意顺序删除,但不允许添加新的调度门控。

图:Pod SchedulingGates

用法示例 要将 Pod 标记为未准备好进行调度,你可以在创建 Pod 时附带一个或多个调度门控,如下所示:

apiVersion : v1

kind : Pod

metadata :

name : test-pod

spec :

schedulingGates :

- name : example.com/foo

- name : example.com/bar

containers :

- name : pause

image : registry.k8s.io/pause:3.6

Pod 创建后,你可以使用以下方法检查其状态:

输出显示它处于 SchedulingGated 状态:

NAME READY STATUS RESTARTS AGE

test-pod 0/1 SchedulingGated 0 7s

你还可以通过运行以下命令检查其 schedulingGates 字段:

kubectl get pod test-pod -o jsonpath = '{.spec.schedulingGates}'

输出是:

[{"name":"example.com/foo"},{"name":"example.com/bar"}]

要通知调度程序此 Pod 已准备好进行调度,你可以通过重新应用修改后的清单来完全删除其 schedulingGates:

apiVersion : v1

kind : Pod

metadata :

name : test-pod

spec :

containers :

- name : pause

image : registry.k8s.io/pause:3.6

你可以通过运行以下命令检查 schedulingGates 是否已被清空:

kubectl get pod test-pod -o jsonpath = '{.spec.schedulingGates}'

预计输出为空,你可以通过运行下面的命令来检查它的最新状态:

kubectl get pod test-pod -o wide

鉴于 test-pod 不请求任何 CPU/内存资源,预计此 Pod 的状态会从之前的

SchedulingGated 转变为 Running:

NAME READY STATUS RESTARTS AGE IP NODE

test-pod 1/1 Running 0 15s 10.0.0.4 node-2

可观测性 指标 scheduler_pending_pods 带有一个新标签 "gated",

以区分 Pod 是否已尝试调度但被宣称不可调度,或明确标记为未准备好调度。

你可以使用 scheduler_pending_pods{queue="gated"} 来检查指标结果。

可变 Pod 调度指令 当 Pod 具有调度门控时,你可以在某些约束条件下改变 Pod 的调度指令。

在高层次上,你只能收紧 Pod 的调度指令。换句话说,更新后的指令将导致

Pod 只能被调度到它之前匹配的节点子集上。

更具体地说,更新 Pod 的调度指令的规则如下:

对于 .spec.nodeSelector,只允许增加。如果原来未设置,则允许设置此字段。

对于 spec.affinity.nodeAffinity,如果当前值为 nil,则允许设置为任意值。

如果 NodeSelectorTerms 之前为空,则允许设置该字段。

如果之前不为空,则仅允许增加 NodeSelectorRequirements 到 matchExpressions

或 fieldExpressions,且不允许更改当前的 matchExpressions 和 fieldExpressions。

这是因为 .requiredDuringSchedulingIgnoredDuringExecution.NodeSelectorTerms

中的条目被执行逻辑或运算,而 nodeSelectorTerms[].matchExpressions 和

nodeSelectorTerms[].fieldExpressions 中的表达式被执行逻辑与运算。 对于 .preferredDuringSchedulingIgnoredDuringExecution,所有更新都被允许。

这是因为首选条目不具有权威性,因此策略控制器不会验证这些条目。 接下来 6 - Pod 拓扑分布约束 你可以使用 拓扑分布约束(Topology Spread Constraints) 来控制

Pod 在集群内故障域之间的分布,

例如区域(Region)、可用区(Zone)、节点和其他用户自定义拓扑域。

这样做有助于实现高可用并提升资源利用率。

你可以将集群级约束 设为默认值,

或为个别工作负载配置拓扑分布约束。

动机 假设你有一个最多包含二十个节点的集群,你想要运行一个自动扩缩的

工作负载 ,请问要使用多少个副本?

答案可能是最少 2 个 Pod,最多 15 个 Pod。

当只有 2 个 Pod 时,你倾向于这 2 个 Pod 不要同时在同一个节点上运行:

你所遭遇的风险是如果放在同一个节点上且单节点出现故障,可能会让你的工作负载下线。

除了这个基本的用法之外,还有一些高级的使用案例,能够让你的工作负载受益于高可用性并提高集群利用率。

随着你的工作负载扩容,运行的 Pod 变多,将需要考虑另一个重要问题。

假设你有 3 个节点,每个节点运行 5 个 Pod。这些节点有足够的容量能够运行许多副本;

但与这个工作负载互动的客户端分散在三个不同的数据中心(或基础设施可用区)。

现在你可能不太关注单节点故障问题,但你会注意到延迟高于自己的预期,

在不同的可用区之间发送网络流量会产生一些网络成本。

你决定在正常运营时倾向于将类似数量的副本调度

到每个基础设施可用区,且你想要该集群在遇到问题时能够自愈。

Pod 拓扑分布约束使你能够以声明的方式进行配置。

topologySpreadConstraints 字段Pod API 包括一个 spec.topologySpreadConstraints 字段。这个字段的用法如下所示:

---

apiVersion : v1

kind : Pod

metadata :

name : example-pod

spec :

# 配置一个拓扑分布约束

topologySpreadConstraints :

- maxSkew : <integer>

minDomains : <integer> # 可选

topologyKey : <string>

whenUnsatisfiable : <string>

labelSelector : <object>

matchLabelKeys : <list> # 可选;从 v1.27 开始成为 Beta

nodeAffinityPolicy : [Honor|Ignore] # 可选;从 v1.26 开始成为 Beta

nodeTaintsPolicy : [Honor|Ignore] # 可选;从 v1.26 开始成为 Beta

### 其他 Pod 字段置于此处

说明: 对于特定的 topologyKey 和 whenUnsatisfiable 值,只能有一个 topologySpreadConstraint。

例如,如果你已经定义了一个 topologySpreadConstraint,其 topologyKey

为 "kubernetes.io/hostname",whenUnsatisfiable 值为 "DoNotSchedule",

那么你在添加另一个 topologyKey 为 "kubernetes.io/hostname" 的 topologySpreadConstraint

时,whenUnsatisfiable 需要使用不同的值。

你可以运行 kubectl explain Pod.spec.topologySpreadConstraints 或参阅 Pod API

参考的调度 一节,

了解有关此字段的更多信息。

分布约束定义 你可以定义一个或多个 topologySpreadConstraints 条目以指导 kube-scheduler

如何将每个新来的 Pod 与跨集群的现有 Pod 相关联。这些字段包括:

topologyKey 是节点标签 的键。如果节点使用此键标记并且具有相同的标签值,

则将这些节点视为处于同一拓扑域中。我们将拓扑域中(即键值对)的每个实例称为一个域。

调度器将尝试在每个拓扑域中放置数量均衡的 Pod。

另外,我们将符合条件的域定义为其节点满足 nodeAffinityPolicy 和 nodeTaintsPolicy 要求的域。matchLabelKeys 是一个 Pod 标签键的列表,用于选择计算分布偏差的 Pod 组。在创建 Pod 时,

kube-apiserver 使用这些键从传入的 Pod 标签中查找值,并将这些键值标签与现有的 labelSelector 合并。

相同的键不允许同时出现在 matchLabelKeys 和 labelSelector 中。

当 labelSelector 未设置时,不能设置 matchLabelKeys。

如果键在 Pod 标签中不存在,则会被忽略。

一个空或 null 的列表意味着仅与 labelSelector 匹配。注意: 不建议将 matchLabelKeys 与可能直接在 Pod 上更新的标签一起使用。

即使你直接 编辑了位于 matchLabelKeys 中指定的 Pod 标签,

(也就是说,你编辑的是 Pod 而不是 Deployment),

kube-apiserver 不会将标签更新反映到合并的 labelSelector 上。

借助 matchLabelKeys,你无需在变更 Pod 修订版本时更新 pod.spec。

控制器或 Operator 只需要将不同修订版的标签键设为不同的值。

例如,如果你正在配置一个 Deployment,则可以使用由 Deployment

控制器自动添加的、以

pod-template-hash

为键的标签来区分同一个 Deployment 的不同修订版。

topologySpreadConstraints :

- maxSkew : 1

topologyKey : kubernetes.io/hostname

whenUnsatisfiable : DoNotSchedule

labelSelector :

matchLabels :

app : foo

matchLabelKeys :

- pod-template-hash

说明: matchLabelKeys 字段是 1.27 中默认启用的一个 Beta 级别字段。

你可以通过禁用 MatchLabelKeysInPodTopologySpread

特性门控 来禁用此字段。

在 v1.34 之前,matchLabelKeys 是隐式处理的。

从 v1.34 开始,与 matchLabelKeys 对应的键值标签会被明确地合并到 labelSelector 中。

你可以通过禁用 kube-apiserver 的 MatchLabelKeysInPodTopologySpreadSelectorMerge

特性门控 来禁用此行为并恢复到之前的行为。

当 Pod 定义了不止一个 topologySpreadConstraint,这些约束之间是逻辑与的关系。

kube-scheduler 会为新的 Pod 寻找一个能够满足所有约束的节点。

节点标签 拓扑分布约束依赖于节点标签来标识每个节点 所在的拓扑域。

例如,某节点可能具有标签:

region : us-east-1

zone : us-east-1a

说明: 为了简便,此示例未使用众所周知 的标签键

topology.kubernetes.io/zone 和 topology.kubernetes.io/region。

但是,建议使用那些已注册的标签键,而不是此处使用的私有(不合格)标签键 region 和 zone。

你无法对不同上下文之间的私有标签键的含义做出可靠的假设。

假设你有一个 4 节点的集群且带有以下标签:

NAME STATUS ROLES AGE VERSION LABELS

node1 Ready <none> 4m26s v1.16.0 node=node1,zone=zoneA

node2 Ready <none> 3m58s v1.16.0 node=node2,zone=zoneA

node3 Ready <none> 3m17s v1.16.0 node=node3,zone=zoneB

node4 Ready <none> 2m43s v1.16.0 node=node4,zone=zoneB

那么,从逻辑上看集群如下:

graph TB

subgraph "zoneB"

n3(Node3)

n4(Node4)

end

subgraph "zoneA"

n1(Node1)

n2(Node2)

end

classDef plain fill:#ddd,stroke:#fff,stroke-width:4px,color:#000;

classDef k8s fill:#326ce5,stroke:#fff,stroke-width:4px,color:#fff;

classDef cluster fill:#fff,stroke:#bbb,stroke-width:2px,color:#326ce5;

class n1,n2,n3,n4 k8s;

class zoneA,zoneB cluster;

一致性 你应该为一个组中的所有 Pod 设置相同的 Pod 拓扑分布约束。

通常,如果你正使用一个工作负载控制器,例如 Deployment,则 Pod 模板会帮你解决这个问题。

如果你混合不同的分布约束,则 Kubernetes 会遵循该字段的 API 定义;

但是,该行为可能更令人困惑,并且故障排除也没那么简单。

你需要一种机制来确保拓扑域(例如云提供商区域)中的所有节点具有一致的标签。

为了避免你需要手动为节点打标签,大多数集群会自动填充知名的标签,

例如 kubernetes.io/hostname。检查你的集群是否支持此功能。

拓扑分布约束示例 示例:一个拓扑分布约束 假设你拥有一个 4 节点集群,其中标记为 foo: bar 的 3 个 Pod 分别位于 node1、node2 和 node3 中:

graph BT

subgraph "zoneB"

p3(Pod) --> n3(Node3)

n4(Node4)

end

subgraph "zoneA"

p1(Pod) --> n1(Node1)

p2(Pod) --> n2(Node2)

end

classDef plain fill:#ddd,stroke:#fff,stroke-width:4px,color:#000;

classDef k8s fill:#326ce5,stroke:#fff,stroke-width:4px,color:#fff;

classDef cluster fill:#fff,stroke:#bbb,stroke-width:2px,color:#326ce5;

class n1,n2,n3,n4,p1,p2,p3 k8s;

class zoneA,zoneB cluster;

如果你希望新来的 Pod 均匀分布在现有的可用区域,则可以按如下设置其清单:

kind : Pod

apiVersion : v1

metadata :

name : mypod

labels :

foo : bar

spec :

topologySpreadConstraints :

- maxSkew : 1

topologyKey : zone

whenUnsatisfiable : DoNotSchedule

labelSelector :

matchLabels :

foo : bar

containers :

- name : pause

image : registry.k8s.io/pause:3.1从此清单看,topologyKey: zone 意味着均匀分布将只应用于存在标签键值对为 zone: <any value> 的节点

(没有 zone 标签的节点将被跳过)。如果调度器找不到一种方式来满足此约束,

则 whenUnsatisfiable: DoNotSchedule 字段告诉该调度器将新来的 Pod 保持在 pending 状态。

如果该调度器将这个新来的 Pod 放到可用区 A,则 Pod 的分布将成为 [3, 1]。

这意味着实际偏差是 2(计算公式为 3 - 1),这违反了 maxSkew: 1 的约定。

为了满足这个示例的约束和上下文,新来的 Pod 只能放到可用区 B 中的一个节点上:

graph BT

subgraph "zoneB"

p3(Pod) --> n3(Node3)

p4(mypod) --> n4(Node4)

end

subgraph "zoneA"

p1(Pod) --> n1(Node1)

p2(Pod) --> n2(Node2)

end

classDef plain fill:#ddd,stroke:#fff,stroke-width:4px,color:#000;

classDef k8s fill:#326ce5,stroke:#fff,stroke-width:4px,color:#fff;

classDef cluster fill:#fff,stroke:#bbb,stroke-width:2px,color:#326ce5;

class n1,n2,n3,n4,p1,p2,p3 k8s;

class p4 plain;

class zoneA,zoneB cluster;

或者

graph BT

subgraph "zoneB"

p3(Pod) --> n3(Node3)

p4(mypod) --> n3

n4(Node4)

end

subgraph "zoneA"

p1(Pod) --> n1(Node1)

p2(Pod) --> n2(Node2)

end

classDef plain fill:#ddd,stroke:#fff,stroke-width:4px,color:#000;

classDef k8s fill:#326ce5,stroke:#fff,stroke-width:4px,color:#fff;

classDef cluster fill:#fff,stroke:#bbb,stroke-width:2px,color:#326ce5;

class n1,n2,n3,n4,p1,p2,p3 k8s;

class p4 plain;

class zoneA,zoneB cluster;

你可以调整 Pod 规约以满足各种要求:

将 maxSkew 更改为更大的值,例如 2,这样新来的 Pod 也可以放在可用区 A 中。 将 topologyKey 更改为 node,以便将 Pod 均匀分布在节点上而不是可用区中。

在上面的例子中,如果 maxSkew 保持为 1,则新来的 Pod 只能放到 node4 节点上。 将 whenUnsatisfiable: DoNotSchedule 更改为 whenUnsatisfiable: ScheduleAnyway,

以确保新来的 Pod 始终可以被调度(假设满足其他的调度 API)。但是,最好将其放置在匹配 Pod 数量较少的拓扑域中。

请注意,这一优先判定会与其他内部调度优先级(如资源使用率等)排序准则一起进行标准化。 示例:多个拓扑分布约束 下面的例子建立在前面例子的基础上。假设你拥有一个 4 节点集群,

其中 3 个标记为 foo: bar 的 Pod 分别位于 node1、node2 和 node3 上:

graph BT

subgraph "zoneB"

p3(Pod) --> n3(Node3)

n4(Node4)

end

subgraph "zoneA"

p1(Pod) --> n1(Node1)

p2(Pod) --> n2(Node2)

end

classDef plain fill:#ddd,stroke:#fff,stroke-width:4px,color:#000;

classDef k8s fill:#326ce5,stroke:#fff,stroke-width:4px,color:#fff;

classDef cluster fill:#fff,stroke:#bbb,stroke-width:2px,color:#326ce5;

class n1,n2,n3,n4,p1,p2,p3 k8s;

class p4 plain;

class zoneA,zoneB cluster;

可以组合使用 2 个拓扑分布约束来控制 Pod 在节点和可用区两个维度上的分布:

kind : Pod

apiVersion : v1

metadata :

name : mypod

labels :

foo : bar

spec :

topologySpreadConstraints :

- maxSkew : 1

topologyKey : zone

whenUnsatisfiable : DoNotSchedule

labelSelector :

matchLabels :

foo : bar

- maxSkew : 1

topologyKey : node

whenUnsatisfiable : DoNotSchedule

labelSelector :

matchLabels :

foo : bar

containers :

- name : pause

image : registry.k8s.io/pause:3.1在这种情况下,为了匹配第一个约束,新的 Pod 只能放置在可用区 B 中;

而在第二个约束中,新来的 Pod 只能调度到节点 node4 上。

该调度器仅考虑满足所有已定义约束的选项,因此唯一可行的选择是放置在节点 node4 上。

示例:有冲突的拓扑分布约束 多个约束可能导致冲突。假设有一个跨 2 个可用区的 3 节点集群:

graph BT

subgraph "zoneB"

p4(Pod) --> n3(Node3)

p5(Pod) --> n3

end

subgraph "zoneA"

p1(Pod) --> n1(Node1)

p2(Pod) --> n1

p3(Pod) --> n2(Node2)

end

classDef plain fill:#ddd,stroke:#fff,stroke-width:4px,color:#000;

classDef k8s fill:#326ce5,stroke:#fff,stroke-width:4px,color:#fff;

classDef cluster fill:#fff,stroke:#bbb,stroke-width:2px,color:#326ce5;

class n1,n2,n3,n4,p1,p2,p3,p4,p5 k8s;

class zoneA,zoneB cluster;

如果你将 two-constraints.yaml这个 集群,你将看到 Pod mypod 保持在 Pending 状态。

出现这种情况的原因为:为了满足第一个约束,Pod mypod 只能放置在可用区 B 中;

而在第二个约束中,Pod mypod 只能调度到节点 node2 上。

两个约束的交集将返回一个空集,且调度器无法放置该 Pod。

为了应对这种情形,你可以提高 maxSkew 的值或修改其中一个约束才能使用 whenUnsatisfiable: ScheduleAnyway。

根据实际情形,例如若你在故障排查时发现某个漏洞修复工作毫无进展,你还可能决定手动删除一个现有的 Pod。

与节点亲和性和节点选择算符的相互作用 如果 Pod 定义了 spec.nodeSelector 或 spec.affinity.nodeAffinity,

调度器将在偏差计算中跳过不匹配的节点。

示例:带节点亲和性的拓扑分布约束 假设你有一个跨可用区 A 到 C 的 5 节点集群:

graph BT

subgraph "zoneB"

p3(Pod) --> n3(Node3)

n4(Node4)

end

subgraph "zoneA"

p1(Pod) --> n1(Node1)

p2(Pod) --> n2(Node2)

end

classDef plain fill:#ddd,stroke:#fff,stroke-width:4px,color:#000;

classDef k8s fill:#326ce5,stroke:#fff,stroke-width:4px,color:#fff;

classDef cluster fill:#fff,stroke:#bbb,stroke-width:2px,color:#326ce5;

class n1,n2,n3,n4,p1,p2,p3 k8s;

class p4 plain;

class zoneA,zoneB cluster;

graph BT

subgraph "zoneC"

n5(Node5)

end

classDef plain fill:#ddd,stroke:#fff,stroke-width:4px,color:#000;

classDef k8s fill:#326ce5,stroke:#fff,stroke-width:4px,color:#fff;

classDef cluster fill:#fff,stroke:#bbb,stroke-width:2px,color:#326ce5;

class n5 k8s;

class zoneC cluster;

而且你知道可用区 C 必须被排除在外。在这种情况下,可以按如下方式编写清单,

以便将 Pod mypod 放置在可用区 B 上,而不是可用区 C 上。

同样,Kubernetes 也会一样处理 spec.nodeSelector。

kind : Pod

apiVersion : v1

metadata :

name : mypod

labels :

foo : bar

spec :

topologySpreadConstraints :

- maxSkew : 1

topologyKey : zone

whenUnsatisfiable : DoNotSchedule

labelSelector :

matchLabels :

foo : bar

affinity :

nodeAffinity :

requiredDuringSchedulingIgnoredDuringExecution :

nodeSelectorTerms :

- matchExpressions :

- key : zone

operator : NotIn

values :

- zoneC

containers :

- name : pause

image : registry.k8s.io/pause:3.1隐式约定 这里有一些值得注意的隐式约定:

注意,如果新 Pod 的 topologySpreadConstraints[*].labelSelector 与自身的标签不匹配,将会发生什么。

在上面的例子中,如果移除新 Pod 的标签,则 Pod 仍然可以放置到可用区 B 中的节点上,因为这些约束仍然满足。

然而,在放置之后,集群的不平衡程度保持不变。可用区 A 仍然有 2 个 Pod 带有标签 foo: bar,

而可用区 B 有 1 个 Pod 带有标签 foo: bar。如果这不是你所期望的,

更新工作负载的 topologySpreadConstraints[*].labelSelector 以匹配 Pod 模板中的标签。 集群级别的默认约束 为集群设置默认的拓扑分布约束也是可能的。默认拓扑分布约束在且仅在以下条件满足时才会被应用到 Pod 上:

Pod 没有在其 .spec.topologySpreadConstraints 中定义任何约束。 Pod 隶属于某个 Service、ReplicaSet、StatefulSet 或 ReplicationController。 默认约束可以设置为调度方案 中

PodTopologySpread 插件参数的一部分。约束的设置采用如前所述的 API ,

只是 labelSelector 必须为空。

选择算符是根据 Pod 所属的 Service、ReplicaSet、StatefulSet 或 ReplicationController 来设置的。

配置的示例可能看起来像下面这个样子:

apiVersion : kubescheduler.config.k8s.io/v1

kind : KubeSchedulerConfiguration

profiles :

- schedulerName : default-scheduler

pluginConfig :

- name : PodTopologySpread

args :

defaultConstraints :

- maxSkew : 1

topologyKey : topology.kubernetes.io/zone

whenUnsatisfiable : ScheduleAnyway

defaultingType : List

内置默认约束 特性状态:

Kubernetes v1.24 [stable]

如果你没有为 Pod 拓扑分布配置任何集群级别的默认约束,

kube-scheduler 的行为就像你指定了以下默认拓扑约束一样:

defaultConstraints :

- maxSkew : 3

topologyKey : "kubernetes.io/hostname"

whenUnsatisfiable : ScheduleAnyway

- maxSkew : 5

topologyKey : "topology.kubernetes.io/zone"

whenUnsatisfiable : ScheduleAnyway

此外,原来用于提供等同行为的 SelectorSpread 插件默认被禁用。

说明: 对于分布约束中所指定的拓扑键而言,PodTopologySpread 插件不会为不包含这些拓扑键的节点评分。

这可能导致在使用默认拓扑约束时,其行为与原来的 SelectorSpread 插件的默认行为不同。

如果你的节点不会同时 设置 kubernetes.io/hostname 和 topology.kubernetes.io/zone 标签,

你应该定义自己的约束而不是使用 Kubernetes 的默认约束。

如果你不想为集群使用默认的 Pod 分布约束,你可以通过设置 defaultingType 参数为 List,

并将 PodTopologySpread 插件配置中的 defaultConstraints 参数置空来禁用默认 Pod 分布约束:

apiVersion : kubescheduler.config.k8s.io/v1

kind : KubeSchedulerConfiguration

profiles :

- schedulerName : default-scheduler

pluginConfig :

- name : PodTopologySpread

args :

defaultConstraints : []

defaultingType : List

比较 podAffinity 和 podAntiAffinity 在 Kubernetes 中,

Pod 间亲和性和反亲和性 控制

Pod 彼此的调度方式(更密集或更分散)。

podAffinity吸引 Pod;你可以尝试将任意数量的 Pod 集中到符合条件的拓扑域中。 podAntiAffinity驱逐 Pod。如果将此设为 requiredDuringSchedulingIgnoredDuringExecution 模式,

则只有单个 Pod 可以调度到单个拓扑域;如果你选择 preferredDuringSchedulingIgnoredDuringExecution,

则你将丢失强制执行此约束的能力。 要实现更细粒度的控制,你可以设置拓扑分布约束来将 Pod 分布到不同的拓扑域下,从而实现高可用性或节省成本。

这也有助于工作负载的滚动更新和平稳地扩展副本规模。

有关详细信息,请参阅有关 Pod 拓扑分布约束的增强倡议的

动机 一节。

已知局限性 当 Pod 被移除时,无法保证约束仍被满足。例如,缩减某 Deployment 的规模时,Pod 的分布可能不再均衡。

你可以使用 Descheduler 来重新实现 Pod 分布的均衡。

具有污点的节点上匹配的 Pod 也会被统计。

参考 Issue 80921 。

接下来 7 - 污点和容忍度 节点亲和性

是 Pod 的一种属性,它使 Pod

被吸引到一类特定的节点

(这可能出于一种偏好,也可能是硬性要求)。

污点(Taint) 则相反——它使节点能够排斥一类特定的 Pod。

容忍度(Toleration) 是应用于 Pod 上的。容忍度允许调度器调度带有对应污点的 Pod。

容忍度允许调度但并不保证调度:作为其功能的一部分,

调度器也会评估其他参数 。

污点和容忍度(Toleration)相互配合,可以用来避免 Pod 被分配到不合适的节点上。

每个节点上都可以应用一个或多个污点,这表示对于那些不能容忍这些污点的 Pod,

是不会被该节点接受的。

概念 你可以使用命令 kubectl taint

给节点增加一个污点。比如:

kubectl taint nodes node1 key1 = value1:NoSchedule

给节点 node1 增加一个污点,它的键名是 key1,键值是 value1,效果是 NoSchedule。

这表示只有拥有和这个污点相匹配的容忍度的 Pod 才能够被分配到 node1 这个节点。

若要移除上述命令所添加的污点,你可以执行:

kubectl taint nodes node1 key1 = value1:NoSchedule-

你可以在 Pod 规约中为 Pod 设置容忍度。

下面两个容忍度均与上面例子中使用 kubectl taint 命令创建的污点相匹配,

因此如果一个 Pod 拥有其中的任何一个容忍度,都能够被调度到 node1:

tolerations :

key : "key1"

operator : "Equal"

value : "value1"

effect : "NoSchedule"

tolerations :

key : "key1"

operator : "Exists"

effect : "NoSchedule"

默认的 Kubernetes 调度器在选择一个节点来运行特定的 Pod 时会考虑污点和容忍度。

然而,如果你手动为一个 Pod 指定了 .spec.nodeName,那么选节点操作会绕过调度器;

这个 Pod 将会绑定到你指定的节点上,即使你选择的节点上有 NoSchedule 的污点。

如果这种情况发生,且节点上还设置了 NoExecute 的污点,kubelet 会将 Pod 驱逐出去,除非有适当的容忍度设置。

下面是一个定义了一些容忍度的 Pod 的例子:

apiVersion : v1

kind : Pod

metadata :

name : nginx

labels :

env : test

spec :

containers :

- name : nginx

image : nginx

imagePullPolicy : IfNotPresent

tolerations :

- key : "example-key"

operator : "Exists"

effect : "NoSchedule"

operator 的默认值是 Equal。

一个容忍度和一个污点相“匹配”是指它们有一样的键名和效果,并且:

如果 operator 是 Exists(此时容忍度不能指定 value),或者 如果 operator 是 Equal,则它们的值应该相等。 说明: 存在两种特殊情况:

如果 key 为空,那么 operator 必须是 Exists,匹配所有 key 和 value。

注意,同时 effect 仍然需要匹配。

如果 effect 为空,则可以与所有键名 key1 的效果相匹配。

上述例子中 effect 使用的值为 NoSchedule,你也可以使用另外一个值 PreferNoSchedule。

effect 字段的允许值包括:

NoExecute这会影响已在节点上运行的 Pod,具体影响如下:如果 Pod 不能容忍这类污点,会马上被驱逐。 如果 Pod 能够容忍这类污点,但是在容忍度定义中没有指定 tolerationSeconds,

则 Pod 还会一直在这个节点上运行。 如果 Pod 能够容忍这类污点,而且指定了 tolerationSeconds,

则 Pod 还能在这个节点上继续运行这个指定的时间长度。

这段时间过去后,节点生命周期控制器从节点驱除这些 Pod。 NoSchedule除非具有匹配的容忍度规约,否则新的 Pod 不会被调度到带有污点的节点上。

当前正在节点上运行的 Pod 不会 被驱逐。 PreferNoSchedulePreferNoSchedule 是“偏好”或“软性”的 NoSchedule。

控制平面将尝试 避免将不能容忍污点的 Pod 调度到的节点上,但不能保证完全避免。你可以给一个节点添加多个污点,也可以给一个 Pod 添加多个容忍度设置。

Kubernetes 处理多个污点和容忍度的过程就像一个过滤器:从一个节点的所有污点开始遍历,

过滤掉那些 Pod 中存在与之相匹配的容忍度的污点。余下未被过滤的污点的 effect 值决定了

Pod 是否会被分配到该节点。需要注意以下情况:

如果未被忽略的污点中存在至少一个 effect 值为 NoSchedule 的污点,

则 Kubernetes 不会将 Pod 调度到该节点。 如果未被忽略的污点中不存在 effect 值为 NoSchedule 的污点,

但是存在至少一个 effect 值为 PreferNoSchedule 的污点,

则 Kubernetes 会尝试 不将 Pod 调度到该节点。 如果未被忽略的污点中存在至少一个 effect 值为 NoExecute 的污点,

则 Kubernetes 不会将 Pod 调度到该节点(如果 Pod 还未在节点上运行),

并且会将 Pod 从该节点驱逐(如果 Pod 已经在节点上运行)。 例如,假设你给一个节点添加了如下污点:

kubectl taint nodes node1 key1 = value1:NoSchedule

kubectl taint nodes node1 key1 = value1:NoExecute

kubectl taint nodes node1 key2 = value2:NoSchedule

假定某个 Pod 有两个容忍度:

tolerations :

key : "key1"

operator : "Equal"

value : "value1"

effect : "NoSchedule"

key : "key1"

operator : "Equal"

value : "value1"

effect : "NoExecute"

在这种情况下,上述 Pod 不会被调度到上述节点,因为其没有容忍度和第三个污点相匹配。

但是如果在给节点添加上述污点之前,该 Pod 已经在上述节点运行,

那么它还可以继续运行在该节点上,因为第三个污点是三个污点中唯一不能被这个 Pod 容忍的。

通常情况下,如果给一个节点添加了一个 effect 值为 NoExecute 的污点,

则任何不能容忍这个污点的 Pod 都会马上被驱逐,任何可以容忍这个污点的 Pod 都不会被驱逐。

但是,如果 Pod 存在一个 effect 值为 NoExecute 的容忍度指定了可选属性

tolerationSeconds 的值,则表示在给节点添加了上述污点之后,

Pod 还能继续在节点上运行的时间。例如:

tolerations :

key : "key1"

operator : "Equal"

value : "value1"

effect : "NoExecute"

tolerationSeconds : 3600

这表示如果这个 Pod 正在运行,同时一个匹配的污点被添加到其所在的节点,

那么 Pod 还将继续在节点上运行 3600 秒,然后被驱逐。

如果在此之前上述污点被删除了,则 Pod 不会被驱逐。

数值比较运算符 特性状态:

Kubernetes v1.35 [alpha](默认禁用)

除了 Equal 和 Exists 之外,你还可以使用数值比较运算符(Gt 和 Lt)

来匹配具有整数值的污点。这对于基于阈值的调度非常有用,

例如根据可靠性等级或 SLA 等级来匹配节点。

Gt:当污点值大于容忍值时匹配。Lt:当污点值小于容忍值时匹配。对于数值运算符,容忍值和污点值都必须是有效的整数。

如果二者中任一个值无法被解析为整数,则此容忍度不匹配。

说明: 当你创建一个使用 Gt 或 Lt 容忍度运算符的 Pod 时,API

服务器会校验这些容忍度取值是否为有效整数。节点上的污点值在节点注册时不会被校验。

如果某个节点具有非数值的污点值(例如

servicelevel.organization.example/agreed-service-level=high:NoSchedule),

那么使用数值比较运算符的 Pod 将无法匹配该污点,因此也无法调度到该节点上。

例如,如果节点被打上表示服务级别协议(SLA)的污点:

kubectl taint nodes node1 servicelevel.organization.example/agreed-service-level= 950:NoSchedule

Pod 可以容忍 SLA 大于 900 的节点:

apiVersion : v1

kind : Pod

metadata :

name : nginx-numeric-toleration

labels :

env : test

spec :

containers :

- name : nginx

image : nginx

imagePullPolicy : IfNotPresent

tolerations :

- key : "servicelevel.organization.example/agreed-service-level"

operator : "Gt"

value : "900"

effect : "NoSchedule"

此容忍度匹配 node1 上的污点,因为 950 > 900(对于 Gt 运算符来说,污点值大于容忍度值)。

同样地,你也可以使用 Lt 运算符来匹配污点值小于容忍度值的情况:

tolerations :

key : "servicelevel.organization.example/agreed-service-level"

operator : "Lt"

value : "1000"

effect : "NoSchedule"

说明: 当使用数值比较运算符时:

容忍度值和污点值都必须是有效的、带符号的 64 位整数

(不允许带前导零的数字,例如 "0550")。 如果某个值无法被解析为整数,则此容忍度不匹配。 数值运算符适用于所有污点效果:NoSchedule、PreferNoSchedule 和 NoExecute。 对于使用数值运算符的 PreferNoSchedule:如果 Pod 的容忍度不满足数值比较条件

(例如在使用 Gt 时,污点值 < 容忍度值),调度器降低相应节点的优先级,

但在没有更优选择的情况下,仍可能将 Pod 调度到该节点。 警告: 在禁用 TaintTolerationComparisonOperators 特性门控之前:

你应定位所有使用 Gt 或 Lt 运算符的工作负载,以避免控制器出现热循环。 更新所有工作负载控制器模板,改为使用 Equal 或 Exists 运算符。 删除所有使用 Gt 或 Lt 运算符的 Pending Pod。 监控 apiserver_request_total 指标,关注校验错误是否突增。 使用例子 通过污点和容忍度,可以灵活地让 Pod 避开 某些节点或者将 Pod 从某些节点驱逐。

下面是几个使用例子:

专用节点 :如果想将某些节点专门分配给特定的一组用户使用,你可以给这些节点添加一个污点(即,

kubectl taint nodes nodename dedicated=groupName:NoSchedule),

然后给这组用户的 Pod 添加一个相对应的容忍度

(通过编写一个自定义的准入控制器 ,

很容易就能做到)。

拥有上述容忍度的 Pod 就能够被调度到上述专用节点,同时也能够被调度到集群中的其它节点。

如果你希望这些 Pod 只能被调度到上述专用节点,

那么你还需要给这些专用节点另外添加一个和上述污点类似的 label(例如:dedicated=groupName),

同时还要在上述准入控制器中给 Pod 增加节点亲和性要求,要求上述 Pod 只能被调度到添加了

dedicated=groupName 标签的节点上。配备了特殊硬件的节点 :在部分节点配备了特殊硬件(比如 GPU)的集群中,

我们希望不需要这类硬件的 Pod 不要被调度到这些特殊节点,以便为后继需要这类硬件的 Pod 保留资源。

要达到这个目的,可以先给配备了特殊硬件的节点添加污点

(例如 kubectl taint nodes nodename special=true:NoSchedule 或

kubectl taint nodes nodename special=true:PreferNoSchedule),

然后给使用了这类特殊硬件的 Pod 添加一个相匹配的容忍度。

和专用节点的例子类似,添加这个容忍度的最简单的方法是使用自定义

准入控制器 。

比如,我们推荐使用扩展资源

来表示特殊硬件,给配置了特殊硬件的节点添加污点时包含扩展资源名称,

然后运行一个 ExtendedResourceToleration

准入控制器。此时,因为节点已经被设置污点了,没有对应容忍度的 Pod 不会被调度到这些节点。

但当你创建一个使用了扩展资源的 Pod 时,ExtendedResourceToleration 准入控制器会自动给

Pod 加上正确的容忍度,这样 Pod 就会被自动调度到这些配置了特殊硬件的节点上。

这种方式能够确保配置了特殊硬件的节点专门用于运行需要这些硬件的 Pod,

并且你无需手动给这些 Pod 添加容忍度。基于污点的驱逐 :这是在每个 Pod 中配置的在节点出现问题时的驱逐行为,

接下来的章节会描述这个特性。基于污点的驱逐 特性状态:

Kubernetes v1.18 [stable]

当某种条件为真时,节点控制器会自动给节点添加一个污点。当前内置的污点包括:

node.kubernetes.io/not-ready:节点未准备好。这相当于节点状况 Ready 的值为 "False"。node.kubernetes.io/unreachable:节点控制器访问不到节点. 这相当于节点状况 Ready

的值为 "Unknown"。node.kubernetes.io/memory-pressure:节点存在内存压力。node.kubernetes.io/disk-pressure:节点存在磁盘压力。node.kubernetes.io/pid-pressure:节点的 PID 压力。node.kubernetes.io/network-unavailable:节点网络不可用。node.kubernetes.io/unschedulable:节点不可调度。node.cloudprovider.kubernetes.io/uninitialized:如果 kubelet 启动时指定了一个“外部”云平台驱动,

它将给当前节点添加一个污点将其标志为不可用。在 cloud-controller-manager

的一个控制器初始化这个节点后,kubelet 将删除这个污点。在节点被排空时,节点控制器或者 kubelet 会添加带有 NoExecute 效果的相关污点。

此效果被默认添加到 node.kubernetes.io/not-ready 和 node.kubernetes.io/unreachable 污点中。

如果异常状态恢复正常,kubelet 或节点控制器能够移除相关的污点。

在某些情况下,当节点不可达时,API 服务器无法与节点上的 kubelet 进行通信。

在与 API 服务器的通信被重新建立之前,删除 Pod 的决定无法传递到 kubelet。

同时,被调度进行删除的那些 Pod 可能会继续运行在分区后的节点上。

说明: 控制面会限制向节点添加新污点的速率。这一速率限制可以管理多个节点同时不可达时

(例如出现网络中断的情况),可能触发的驱逐的数量。

你可以为 Pod 设置 tolerationSeconds,以指定当节点失效或者不响应时,

Pod 维系与该节点间绑定关系的时长。

比如,你可能希望在出现网络分裂事件时,对于一个与节点本地状态有着深度绑定的应用而言,

仍然停留在当前节点上运行一段较长的时间,以等待网络恢复以避免被驱逐。

你为这种 Pod 所设置的容忍度看起来可能是这样:

tolerations :

key : "node.kubernetes.io/unreachable"

operator : "Exists"

effect : "NoExecute"

tolerationSeconds : 6000

说明: Kubernetes 会自动给 Pod 添加针对 node.kubernetes.io/not-ready 和

node.kubernetes.io/unreachable 的容忍度,且配置 tolerationSeconds=300,

除非用户自身或者某控制器显式设置此容忍度。

这些自动添加的容忍度意味着 Pod 可以在检测到对应的问题之一时,在 5

分钟内保持绑定在该节点上。

DaemonSet 中的 Pod 被创建时,

针对以下污点自动添加的 NoExecute 的容忍度将不会指定 tolerationSeconds:

node.kubernetes.io/unreachablenode.kubernetes.io/not-ready这保证了出现上述问题时 DaemonSet 中的 Pod 永远不会被驱逐。

说明: 在 1.29 之前,节点控制器负责为节点添加污点并驱逐 Pod。自 1.29 起,

基于污点的驱逐已从节点控制器中抽离,迁移为一个名为 taint-eviction-controller 的独立组件。

用户如需禁用基于污点的驱逐,可在 kube-controller-manager 中设置 --controllers=-taint-eviction-controller。

基于节点状态添加污点 控制平面使用节点控制器 自动创建

与节点状况

对应的、效果为 NoSchedule 的污点。

调度器在进行调度时检查污点,而不是检查节点状况。这确保节点状况不会直接影响调度。

例如,如果 DiskPressure 节点状况处于活跃状态,则控制平面添加

node.kubernetes.io/disk-pressure 污点并且不会调度新的 Pod 到受影响的节点。

如果 MemoryPressure 节点状况处于活跃状态,则控制平面添加

node.kubernetes.io/memory-pressure 污点。

对于新创建的 Pod,可以通过添加相应的 Pod 容忍度来忽略节点状况。

控制平面还在具有除 BestEffort 之外的

QoS 类 的 Pod 上添加

node.kubernetes.io/memory-pressure 容忍度。

这是因为 Kubernetes 将 Guaranteed 或 Burstable QoS 类中的 Pod(甚至没有设置内存请求的 Pod)

视为能够应对内存压力,而新创建的 BestEffort Pod 不会被调度到受影响的节点上。

DaemonSet 控制器自动为所有守护进程添加如下 NoSchedule 容忍度,以防 DaemonSet 崩溃:

node.kubernetes.io/memory-pressurenode.kubernetes.io/disk-pressurenode.kubernetes.io/pid-pressure(1.14 或更高版本)node.kubernetes.io/unschedulable(1.10 或更高版本)node.kubernetes.io/network-unavailable(只适合主机网络配置 )添加上述容忍度确保了向后兼容,你也可以选择自由向 DaemonSet 添加容忍度。

设备污点与容忍度 在使用动态资源分配 管理特殊硬件的集群中,

管理员可以选择为单个设备设置污点 ,

而不是为整个节点打污点。这样做的好处是,污点可以精确地作用于出现故障或需要维护的硬件。

同时也支持容忍度配置,并且可以在请求设备时指定。

与污点类似,容忍度会应用于共享同一分配设备的所有 Pod。

接下来 8 - 调度框架 特性状态:

Kubernetes v1.19 [stable]

调度框架 是面向 Kubernetes 调度器的一种插件架构,

它由一组直接编译到调度程序中的“插件” API 组成。

这些 API 允许大多数调度功能以插件的形式实现,同时使调度“核心”保持简单且可维护。

请参考调度框架的设计提案

获取框架设计的更多技术信息。

框架工作流程 调度框架定义了一些扩展点。调度器插件注册后在一个或多个扩展点处被调用。

这些插件中的一些可以改变调度决策,而另一些仅用于提供信息。

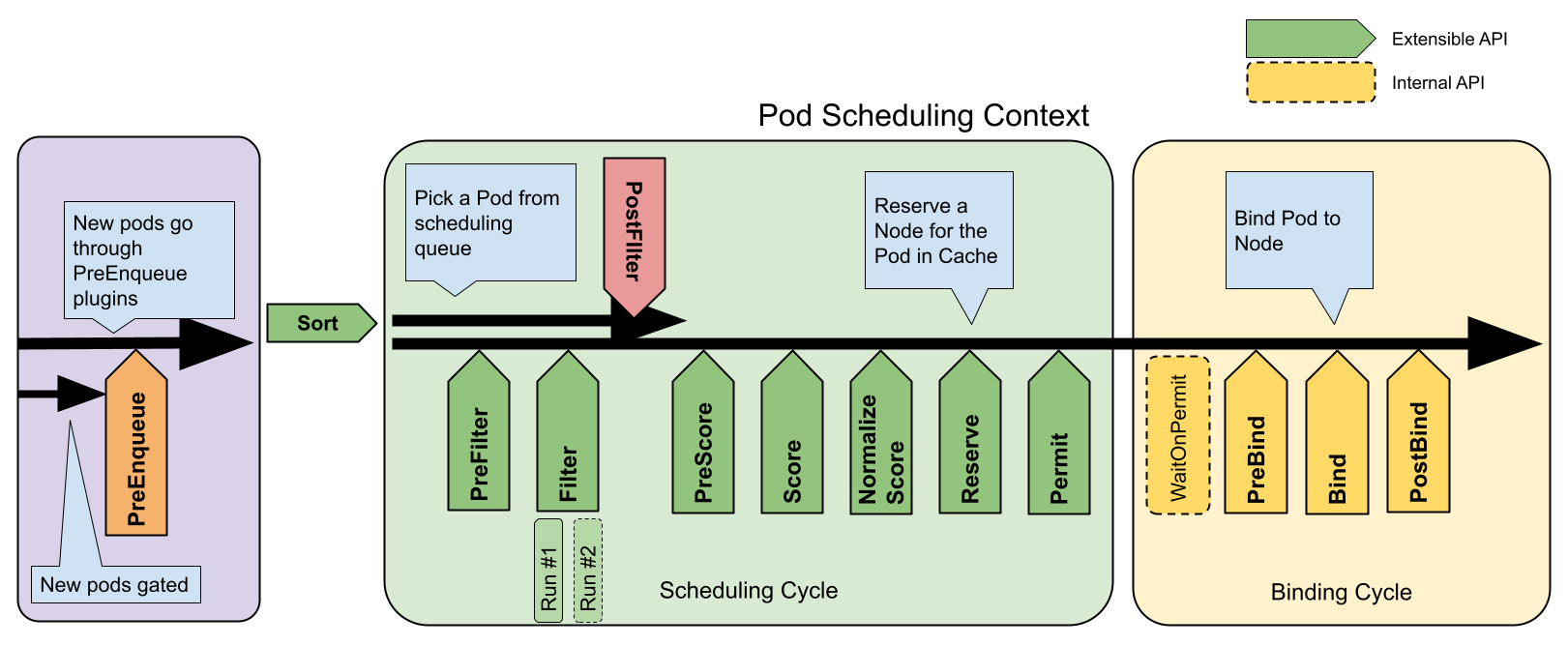

每次调度一个 Pod 的尝试都分为两个阶段,即调度周期 和绑定周期 。

调度周期和绑定周期 调度周期为 Pod 选择一个节点,绑定周期将该决策应用于集群。

调度周期和绑定周期一起被称为“调度上下文”。

调度周期是串行运行的,而绑定周期可能是同时运行的。

如果确定 Pod 不可调度或者存在内部错误,则可以终止调度周期或绑定周期。

Pod 将返回队列并重试。

接口 下图显示了一个 Pod 的调度上下文以及调度框架公开的接口。

一个插件可能实现多个接口,以执行更为复杂或有状态的任务。

某些接口与可以通过调度器配置 来设置的调度器扩展点匹配。

调度框架扩展点 PreEnqueue 这些插件在将 Pod 被添加到内部活动队列之前被调用,在此队列中 Pod 被标记为准备好进行调度。

只有当所有 PreEnqueue 插件返回 Success 时,Pod 才允许进入活动队列。

否则,它将被放置在内部无法调度的 Pod 列表中,并且不会获得 Unschedulable 状态。

要了解有关内部调度器队列如何工作的更多详细信息,请阅读

kube-scheduler 调度队列 。

EnqueueExtension EnqueueExtension 作为一个接口,插件可以在此接口之上根据集群中的变化来控制是否重新尝试调度被此插件拒绝的

Pod。实现 PreEnqueue、PreFilter、Filter、Reserve 或 Permit 的插件应实现此接口。

QueueingHint 特性状态:

Kubernetes v1.34 [stable](默认启用)

QueueingHint 作为一个回调函数,用于决定是否将 Pod 重新排队到活跃队列或回退队列。

每当集群中发生某种事件或变化时,此函数就会被执行。

当 QueueingHint 发现事件可能使 Pod 可调度时,Pod 将被放入活跃队列或回退队列,

以便调度器可以重新尝试调度 Pod。

队列排序 这些插件用于对调度队列中的 Pod 进行排序。

队列排序插件本质上提供 Less(Pod1, Pod2) 函数。

一次只能启动一个队列插件。

PreFilter 这些插件用于预处理 Pod 的相关信息,或者检查集群或 Pod 必须满足的某些条件。

如果 PreFilter 插件返回错误,则调度周期将终止。

Filter 这些插件用于过滤出不能运行该 Pod 的节点。对于每个节点,

调度器将按照其配置顺序调用这些过滤插件。如果任何过滤插件将节点标记为不可行,

则不会为该节点调用剩下的过滤插件。节点可以被同时进行评估。

PostFilter 这些插件在 Filter 阶段后调用,但仅在该 Pod 没有可行的节点时调用。

插件按其配置的顺序调用。如果任何 PostFilter 插件标记节点为 "Schedulable",

则其余的插件不会调用。典型的 PostFilter 实现是抢占,试图通过抢占其他 Pod

的资源使该 Pod 可以调度。

PreScore 这些插件用于执行“前置评分(pre-scoring)”工作,即生成一个可共享状态供 Score 插件使用。

如果 PreScore 插件返回错误,则调度周期将终止。

Score 这些插件用于对通过过滤阶段的节点进行排序。调度器将为每个节点调用每个评分插件。

将有一个定义明确的整数范围,代表最小和最大分数。

在标准化评分 阶段之后,

调度器将根据配置的插件权重合并所有插件的节点分数。

容量打分 特性状态:

Kubernetes v1.33 [alpha](默认禁用)

在 v1.32 中,特性门控 VolumeCapacityPriority 被用于支持静态制备的存储。

从 v1.33 开始,新的特性门控 StorageCapacityScoring 取代了旧的 VolumeCapacityPriority,

并新增了对动态制备存储的支持。

启用 StorageCapacityScoring 后,kube-scheduler 中的 VolumeBinding 插件功能将进行扩展,

根据每个节点上的存储容量对节点进行打分。

该特性适用于支持存储容量 的 CSI 卷,

包括由 CSI 驱动程序支持的本地存储。

NormalizeScore 这些插件用于在调度器计算 Node 排名之前修改分数。

在此扩展点注册的插件被调用时会使用同一插件的 Score

结果。每个插件在每个调度周期调用一次。

例如,假设一个 BlinkingLightScorer 插件基于具有的闪烁指示灯数量来对节点进行排名。

func ScoreNode (_ * v1.pod, n * v1.Node) (int , error ) {

return getBlinkingLightCount (n)

}

然而,最大的闪烁灯个数值可能比 NodeScoreMax 小。要解决这个问题,

BlinkingLightScorer 插件还应该注册该扩展点。

func NormalizeScores (scores map [string ]int ) {

highest := 0

for _, score := range scores {

highest = max (highest, score)

}

for node, score := range scores {

scores[node] = score* NodeScoreMax/ highest

}

}

如果任何 NormalizeScore 插件返回错误,则调度阶段将终止。

说明: 希望执行“预保留”工作的插件应该使用 NormalizeScore 扩展点。

Reserve 实现了 Reserve 接口的插件,拥有两个方法,即 Reserve 和 Unreserve,

他们分别支持两个名为 Reserve 和 Unreserve 的信息传递性质的调度阶段。

维护运行时状态的插件(又称"有状态插件")应该使用这两个阶段,

以便在节点上的资源被保留和解除保留给特定的 Pod 时,得到调度器的通知。

Reserve 阶段发生在调度器实际将一个 Pod 绑定到其指定节点之前。

它的存在是为了防止在调度器等待绑定成功时发生竞争情况。

每个 Reserve 插件的 Reserve 方法可能成功,也可能失败;

如果一个 Reserve 方法调用失败,后面的插件就不会被执行,Reserve 阶段被认为失败。

如果所有插件的 Reserve 方法都成功了,Reserve 阶段就被认为是成功的,

剩下的调度周期和绑定周期就会被执行。

如果 Reserve 阶段或后续阶段失败了,则触发 Unreserve 阶段。

发生这种情况时,所有 Reserve 插件的 Unreserve 方法将按照

Reserve 方法调用的相反顺序执行。

这个阶段的存在是为了清理与保留的 Pod 相关的状态。

注意: Reserve 插件中 Unreserve 方法的实现必须是幂等的,并且不能失败。

这个是调度周期的最后一步。

一旦 Pod 处于保留状态,它将在绑定周期结束时触发 Unreserve 插件(失败时)或

PostBind 插件(成功时)。

Permit Permit 插件在每个 Pod 调度周期的最后调用,用于防止或延迟 Pod 的绑定。

一个允许插件可以做以下三件事之一:

批准 拒绝 Reserve 插件 中的 Unreserve 阶段。等待 (带有超时)等待 变成拒绝 ,并且 Pod 将返回调度队列,从而触发

Reserve 插件 中的 Unreserve 阶段。说明: 尽管任何插件可以访问“等待中”状态的 Pod 列表并批准它们

(查看 FrameworkHandlePreBind 阶段。

PreBind 这些插件用于执行 Pod 绑定前所需的所有工作。

例如,一个 PreBind 插件可能需要制备网络卷并且在允许 Pod

运行在该节点之前将其挂载到目标节点上。

如果任何 PreBind 插件返回错误,则 Pod 将被拒绝 并且退回到调度队列中。

Bind Bind 插件用于将 Pod 绑定到节点上。直到所有的 PreBind 插件都完成,Bind 插件才会被调用。

各 Bind 插件按照配置顺序被调用。Bind 插件可以选择是否处理指定的 Pod。

如果某 Bind 插件选择处理某 Pod,剩余的 Bind 插件将被跳过 。

PostBind 这是个信息传递性质的接口。

PostBind 插件在 Pod 成功绑定后被调用。这是绑定周期的结尾,可用于清理相关的资源。

插件 API 插件 API 分为两个步骤。首先,插件必须完成注册并配置,然后才能使用扩展点接口。

扩展点接口具有以下形式。

type Plugin interface {

Name () string

}

type QueueSortPlugin interface {

Plugin

Less (* v1.pod, * v1.pod) bool

}

type PreFilterPlugin interface {

Plugin

PreFilter (context.Context, * framework.CycleState, * v1.pod) error

}

// ...

插件配置 你可以在调度器配置中启用或禁用插件。

如果你在使用 Kubernetes v1.18 或更高版本,

大部分调度插件 都在使用中且默认启用。

除了默认的插件,你还可以实现自己的调度插件并且将它们与默认插件一起配置。

你可以访问 scheduler-plugins

了解更多信息。

如果你正在使用 Kubernetes v1.18 或更高版本,你可以将一组插件设置为一个调度器配置文件,

然后定义不同的配置文件来满足各类工作负载。

了解更多关于多配置文件 。

9 - 动态资源分配 特性状态:

Kubernetes v1.35 [stable](默认启用)

本页描述 Kubernetes 中的 动态资源分配(DRA) 。

关于 DRA

DRA 是 kubernetes 提供的一项特性,允许你在多个 Pod 之间请求和共享资源。设备 ,例如硬件加速器。

借助 DRA,设备驱动和集群管理员可以定义设备的类别 ,这些类别可供工作负载中的 Pod 申领。

Kubernetes 会将匹配的设备分配给特定的申领,并将相应的 Pod 调度到能够访问这些已分配设备的节点上。

使用 DRA 来分配资源的体验与动态卷制备 类似,

你可以使用 PersistentVolumeClaim 基于存储类来申领存储容量,并在 Pod

中请求这些已申领的容量。

DRA 的好处 DRA 为集群中的设备提供了一种灵活的方式来进行分类、请求和使用。使用 DRA 具有以下好处:

灵活地过滤设备 :使用 Common Expression Language (CEL) 对特定设备属性进行细粒度过滤。设备共享 :通过引用相应的资源申领,可以让多个容器或 Pod 共享同一个资源。集中化的设备分类 :设备驱动和集群管理员可以使用设备类,

来为应用运维人员提供针对不同使用场景优化的硬件类别。

例如,你可以创建一个面向通用工作负载的成本优化型设备类,以及一个面向关键任务的高性能设备类。简化 Pod 的资源请求 :使用 DRA 后,应用运维人员无需在 Pod 的资源请求中明确指定设备的规格。

相反,Pod 只需引用一个资源申领,这个申领中的设备配置将会自动应用到该 Pod。这些好处相较于设备插件 ,

在设备分配的流程中带来了显著的改进。设备插件需要为每个容器单独请求设备,且不支持设备共享,

也无法基于表达式进行对设备进行过滤。

DRA 用户的类型 使用 DRA 进行设备分配的工作流程里通常涉及到以下几类用户:

DRA 术语 DRA 使用以下几种 Kubernetes API 类别来提供核心的资源分配功能。所有这些 API 类别均属于

resource.k8s.io/v1 API 组 。

DeviceClass 定义一类可被申领的设备,以及在申领中如何按设备属性来选择这些设备。

DeviceClass 中的参数可与 ResourceSlice 中的零个或多个设备匹配。

当申领某个 DeviceClass 的设备时,ResourceClaim 会按照特定的设备属性来过滤。 ResourceClaim 描述对集群中已挂接资源(如设备)的分配请求。

ResourceClaim 使 Pod 能够访问某个特定的资源。

ResourceClaim 既可以由工作负载运维人员创建,

也可以由 Kubernetes 根据 ResourceClaimTemplate 自动生成。 ResourceClaimTemplate 定义一个模板,Kubernetes 会根据它为工作负载中的每个 Pod 创建独立的 ResourceClaim。

ResourceClaimTemplate 使 Pod 能够访问相互独立但相似的资源。

Kubernetes 根据模板生成的每个 ResourceClaim 都会与某个特定的 Pod 绑定。

当 Pod 终止时,Kubernetes 将会自动删除对应的 ResourceClaim。 ResourceSlice 代表了挂接在节点上的一个或更多的资源,例如设备。驱动程序创建并管理集群中的 ResourceSlice。

当一个 ResourceClaim 被创建并被 Pod 使用的时候,Kubernetes 会使用 ResourceSlice

来找到够访问到被申领资源的节点。Kubernetes 将资源分配给 ResourceClaim 并将 Pod

调度到节点从而使得 Pod 能够访问到特定资源。 DeviceClass DeviceClass 允许集群管理员或设备驱动程序定义集群中的设备类别。

这些 DeviceClass 告诉运维人员他们可以使用什么设备以及他们能够如何请求这些设备。

你可以使用通用表达式语言(CEL) 来按照特定属性选择设备。

随后,引用 DeviceClass 的 ResourceClaim 就可以请求该类别的设备配置。

要创建 DeviceClass,请参阅在集群中安装 DRA .

ResourceClaim 和 ResourceClaimTemplate ResourceClaim 定义某个工作负载所需的资源。每个 ResourceClaim 都包含一个或多个引用了某个

DeviceClass 并从其中选择具体设备的 request 。

ResourceClaim 也可以使用 selectors 来筛选满足特定条件的设备,并通过 constraints

来限制可以满足请求的设备。ResourceClaim 可以被工作负载运维人员创建,也可以由 Kubernetes

根据 ResourceClaimTemplate 生成。ResourceClaimTemplate 定义了一个模板来让

Kubernetes 能根据它为 Pod 自动生成 ResourceClaim。

ResourceClaim 和 ResourceClaimTemplate 的使用场景 使用方式取决于你的需求,例如:

ResourceClaim :你希望多个 Pod 对某个特定设备进行共享访问。你可以创建 ResourceClaim

并对其生命周期进行手动管理。ResourceClaimTemplate :你希望 Pod 能够有对独立但有相似配置的设备进行独立访问。

Kubernetes 可以基于 ResourceClaimTemplate 中的定义生成 ResourceClaim,而每个生成的

ResourceClaim 的生命周期都与其所对应的 Pod 的生命周期是相绑定的。当你在定义一个工作负载时,你可以使用通用表达式语言(CEL)

来针对特定设备的属性和容量进行过滤。这些可用于过滤的参数则取决于具体的设备与其驱动程序。

如果你直接将一个特定的 ResourceClaim 关联到一个 Pod,则这个 ResourceClaim

必须已存在于与该 Pod 相同的命名空间中。如果这个 ResourceClaim 在该命名空间不存在,

该 Pod 将不会被调度。这个行为类似于 PersistentVolumeClaim:

被 Pod 引用的 PersistentVolumeClaim 必须存在于与该 Pod 相同的命名空间中。

你能够在 Pod 中引用一个自动生成的 ResourceClaim,但并不推荐这样做。因为自动生成的

ResourceClaim 是和触发它生成的 Pod 的生命周期相绑定的。

要了解如何使用这种方式申领资源,

请参阅使用 DRA 为工作负载分配设备 。

按优先级排序的列表 特性状态:

Kubernetes v1.36 [stable](默认启用)

你可以在 ResourceClaim 中为请求提供按优先级排序的子请求列表。调度器将选择第一个能够分配的子请求。

这使得用户能够在首选设备不可用时指定工作负载可以使用的替代设备。

在下面的示例中,ResourceClaimTemplate 请求了一个颜色为黑色且尺寸为大的设备。

如果具有这些属性的设备不可用,那么 Pod 将无法被调度。而使用按优先级排序的列表特性,

就可以指定第二个替代方案,即请求两个颜色为白色且尺寸为小的设备。

如果大型黑色设备可用就分配它,但如果它不可用但有两个小型白色设备可用,

Pod 仍然能够运行。

apiVersion : resource.k8s.io/v1

kind : ResourceClaimTemplate

metadata :

name : prioritized-list-claim-template

spec :

spec :

devices :

requests :

- name : req-0

firstAvailable :

- name : large-black

deviceClassName : resource.example.com

selectors :

- cel :

expression : |-

device.attributes["resource-driver.example.com"].color == "black" &&

device.attributes["resource-driver.example.com"].size == "large"

- name : small-white

deviceClassName : resource.example.com

selectors :

- cel :

expression : |-

device.attributes["resource-driver.example.com"].color == "white" &&

device.attributes["resource-driver.example.com"].size == "small"

count : 2

如果 Pod 符合集群中多个节点的部署条件,调度器会将已选子请求的优先级列表索引作为每个节点评分的输入之一。

因此,能够分配优先级更高的子请求中请求的设备的节点,比只能分配优先级更低子请求中请求的设备的节点更有可能被选中。

该决策是针对每个 Pod 独立做出的。因此如果该 Pod 是 ReplicaSet 或其他类似组中的一员的时候,

你不能假定该组中的所有成员都会选择相同的子请求。你的工作负载必须能够适应这种情况。

按优先级排序的列表是一个 Beta 特性 ,

在 kube-apiserver 和 kube-scheduler 中通过 DRAPrioritizedList

特性门控 默认启用。

ResourceSlice 每个 ResourceSlice 代表资源池中的一个或多个设备 。

该资源池由设备驱动程序管理,它负责创建并维护这些 ResourceSlice。

资源池中的资源可以由单个 ResourceSlice 表示,也可以分布在多个 ResourceSlice 中。

ResourceSlice 为设备使用者和调度器提供了有用的信息,是实现动态资源分配的关键组成部分。

每个 ResourceSlice 都必须包含以下信息:

资源池 :一组由驱动程序管理的一个或多个资源。

一个资源池可以跨越多个 ResourceSlice。当资源池中的资源发生变化时,

必须将这些变更同步到该资源池内的所有 ResourceSlice。

负责管理该资源池的设备驱动程序应确保这一同步过程的正确执行。设备 :那些在被管理的资源池内的设备。一个 ResourceSlice 可以列出资源池中的所有设备,

也可以仅列出其中的一部分。ResourceSlice 定义了设备的一系列信息,例如属性、版本以及容量等。

设备使用者可以在 ResourceClaim 或 DeviceClass 中通过筛选这些设备信息来选择要分配的设备。节点 :能够访问这些资源的节点。驱动程序可以自行决定哪些节点可访问这些资源,

可以是集群中的所有节点、某个特定名称的节点,或者是那些具有特定节点标签的节点。驱动程序使用 控制器 ,

将集群中的 ResourceSlice 与驱动程序需要发布的信息进行协调。

该控制器会覆盖任何手动的更改,例如集群用户对 ResourceSlice 的创建或更改。

以下是一个 ResourceSlice 的示例:

apiVersion : resource.k8s.io/v1

kind : ResourceSlice

metadata :

name : cat-slice

spec :

driver : "resource-driver.example.com"

pool :

generation : 1

name : "black-cat-pool"

resourceSliceCount : 1

# allNodes 字段定义了是否集群中的任意节点都能够访问该设备。

allNodes : true

devices :

- name : "large-black-cat"

attributes :

color :

string : "black"

size :

string : "large"

cat :

bool : true

这个 ResourceSlice 由 resource-driver.example.com 驱动程序在 black-cat-pool

资源池中进行管理。其中字段 allNodes: true 表示集群中的任意节点都可以访问这些设备。

该 ResourceSlice 中包含一个名为 large-black-cat 的设备,其具有以下属性:

color: blacksize: largecat: trueDeviceClass 可以通过这些属性来选择这个 ResourceSlice,

而 ResourceClaim 则可以在该 DeviceClass 中进一步筛选特定的设备。

DRA 资源分配的工作原理 接下来的一节将介绍在动态资源分配过程中,多种

DRA 用户的类型 以及 Kubernetes 系统各自的工作流程。

用户工作流程 创建驱动程序 :设备的所有者或第三方实体会创建那些能够在集群内创建并管理

ResourceSlice 的驱动程序。这些驱动程序还可以创建那些用于定义设备类别和请求方式的

DeviceClass。配置集群 :集群管理员创建集群,将设备挂接到节点上,并安装支持 DRA 的设备驱动程序。

集群管理员可以创建那些用于定义设备类别和请求方式的 DeviceClass。资源申领 :工作负载运维人员创建 ResourceClaimTemplate 或 ResourceClaim,

以请求指定 DeviceClass 所提供的特定设备配置。同时,应用运维人员通过修改其 Kubernetes

清单以在工作负载中引用这些 ResourceClaimTemplate 或 ResourceClaim。Kubernetes 工作流程 创建ResourceSlice :集群中的驱动程序负责创建 ResourceSlice,

用于表示在受管控的相似设备资源池中一个或多个设备。创建工作负载 :集群控制面检查那些引用了 ResourceClaimTemplate 或特定

ResourceClaim 的工作负载。

如果这个工作负载使用了一个 ResourceClaimTemplate,那么一个被叫做

resourceclaim-controller 的控制器会为这个工作负载中的每个

Pod 生成 ResourceClaim。 如果这个工作负载使用了一个特定的 ResourceClaim, 那么 Kubernetes 将会检查这个

ResourceClaim 在集群中是否存在。如果 ResourceClaim 不存在,则 Pod 将不会被部署。 过滤 ResourceSlice :对于任意一个 Pod,Kubernetes 会检查集群中的 ResourceSlice

以找到一个满足所有以下条件的设备:

能够访问该资源的节点必须符合运行该 Pod 的条件; 该 ResourceSlice 中存在尚未分配的资源,并且这些资源符合该 Pod 所引用的 ResourceClaim 的要求。 分配资源 :在为 Pod 的 ResourceClaim 找到符合条件的 ResourceSlice 之后,

Kubernetes 调度器会将分配的详细信息更新在 ResourceClaim 上。调度Pod :当资源完成分配后,调度器将 Pod 放在可以访问该资源的节点上。

节点上的设备驱动程序以及 kubelet 将对设备进行配置,从而使得 Pod 能够访问到该设备。动态资源的可观测性 你可以使用以下任意方式来检查动态分配资源的状态:

kubelet 设备指标 kubelet 的 PodResourcesLister gRPC 服务可以对在使用的设备进行监控。

DynamicResource 提供了与动态资源分配相关的特定信息,例如设备名称和申领名称。

更多细节请参阅监控设备插件资源 .

ResourceClaim 设备状态 特性状态:

Kubernetes v1.33 [beta](默认启用)

DRA 驱动程序可以在 ResourceClaim 的 status.devices

字段中为已分配的设备上报特定于驱动的设备状态 数据。

例如,驱动程序可以在其中列出分配给某个网络接口设备的 IP 地址。

上报到 ResourceClaim 的 status.devices 字段上的信息的准确性取决于驱动程序。

请对所用驱动进行评估,从而判断能否将此字段作为设备信息的唯一来源。

如果你禁用了DRAResourceClaimDeviceStatus

特性门控 ,

那么 status.devices 字段会在 ResourceClaim 被保存时被自动清理。

若想支持 ResourceClaim 的设备状态,需要 DRA 驱动程序能够对设置了 status.devices

字段的存量 ResourceClaim 对象进行更新。

更多status.devices字段的详细信息,请参阅

ResourceClaim

的 API 参考。

设备健康监控 特性状态:

Kubernetes v1.36 [beta](默认启用)

作为一种 Alpha 特性,Kubernetes 提供了一种机制用于监控和上报动态分配的基础设施资源的健康状况。

对于跑在专用硬件上的有状态的应用而言,了解设备何时发生故障或变得不健康是至关重要的。

同时,获知设备是否恢复也同样有助于维护应用的稳定性。

要开启这个功能,ResourceHealthStatus

特性门控 必须启用的同时,

设备驱动程序必须实现了 DRAResourceHealth gRPC 服务。

当一个 DRA 驱动程序发现某个已分配的设备变为不健康,他要将这个状态汇报回 kubelet。

这些健康状态的信息会直接暴露在 Pod 的状态中。kubelet 会在每个容器的状态中填充

allocatedResourcesStatus 字段,以详细描述分配给该容器的每个设备的健康状况。

这为用户和控制器提供了关键的可观测性,使其能够及时响应硬件故障。

对于处于失败状态的 Pod,可以通过检查该状态信息来判断故障是否与某个不健康的设备有关。

预调度的 Pod 当你(或别的 API 客户端)创建设置了 spec.nodeName 的 Pod 时,调度器将被绕过。

如果 Pod 所需的某个 ResourceClaim 尚不存在、未被分配或未为该 Pod 保留,那么 kubelet

将无法运行该 Pod,并会定期重新检查,因为这些要求可能在以后得到满足。

这种情况也可能发生在 Pod 被调度时调度器中未启用动态资源分配支持的时候(原因可能是版本偏差、配置、特性门控等)。

kube-controller-manager 能够检测到这一点,并尝试通过预留所需的一些 ResourceClaim 来使 Pod 可运行。

然而,这只有在这些 ResourceClaim 已经被调度器为其他 Pod 分配的情况下才有效。

绕过调度器并不是一个好的选择,因为分配给节点的 Pod 会锁住一些正常的资源(RAM、CPU),

而这些资源在 Pod 被卡住时无法用于其他 Pod。为了让一个 Pod 在特定节点上运行,

同时仍然通过正常的调度流程进行,请在创建 Pod 时使用与期望的节点精确匹配的节点选择算符:

apiVersion : v1

kind : Pod

metadata :

name : pod-with-cats

spec :

nodeSelector :

kubernetes.io/hostname : name-of-the-intended-node

...

限制 Kubernetes 调度器当前不支持对 DRA 资源进行抢占 。

这意味着,已经在某个节点上运行并使用了 DRA 资源的现有 Pod,

无法被另一个同样需要 DRA 资源的更高优先级 Pod 抢占。

该高优先级 Pod 将保持在 Pending 状态,

直到设备资源变为可用——通常发生在冲突的 Pod 终止或被手动删除之后。 你还可以在准入时变更传入的 Pod,取消设置 .spec.nodeName 字段,并改为使用节点选择算符。

限制 Kubernetes 调度器当前不支持对 DRA 资源进行抢占 。

这意味着,已经在某个节点上运行并使用了 DRA 资源的现有 Pod,

无法被另一个同样需要 DRA 资源的更高优先级 Pod 抢占。

该高优先级 Pod 将保持在 Pending 状态,

直到设备资源变为可用——通常发生在冲突的 Pod 终止或被手动删除之后。 DRA Beta 特性 以下各小节阐述了可以在 Beta

特性门控 中获取到的 DRA 特性。

欲了解更多信息,

请参阅在集群中安装 DRA 。

管理性质的访问 特性状态:

Kubernetes v1.36 [stable](默认启用)

你可以在 ResourceClaim 或 ResourceClaimTemplate

中标记一个请求为具有用于维护和故障排除任务的特权特性。

具有管理员访问权限的请求可以允许用户访问使用中的设备,

并且在将设备提供给容器时可能授权一些额外的访问权限:

apiVersion : resource.k8s.io/v1

kind : ResourceClaimTemplate

metadata :

name : large-black-cat-claim-template

spec :

spec :

devices :

requests :

- name : req-0

exactly :

deviceClassName : resource.example.com

allocationMode : All

adminAccess : true

如果此特性被禁用,创建此类 ResourceClaim 时将自动移除 adminAccess 字段。

管理性质访问是一种特权模式,在多租户集群中不应该对普通用户开放。

从 Kubernetes v1.33 开始,在标有 resource.k8s.io/admin-access: "true"(区分大小写)

的命名空间中只有被授权创建 ResourceClaim 或 ResourceClaimTemplate

对象的用户才能使用 adminAccess 字段。这确保了非管理员用户不能滥用此特性。

从 Kubernetes v1.34 开始,此标签已被更新为 resource.kubernetes.io/admin-access: "true"。

DRA Alpha 特性 以下各小节描述可供使用的 Alpha 阶段 DRA 特性。

它们依赖于启用特性门控,并且可能依赖于额外的

API 组 以在集群中安装 DRA。

更多信息请参阅在集群中安装 DRA 。

使用 DRA 分配扩展资源 特性状态:

Kubernetes v1.36 [beta](默认启用)

你可以为 DeviceClass 提供一个扩展资源名称。对于此扩展资源的请求,

此后调度器会从该类的设备中选择匹配的设备。这允许用户在 Pod

中继续使用扩展资源请求通过设备插件来申请扩展资源,或是 DRA 设备。

在集群的单个节点上,同一个扩展资源要么通过设备插件,要么通过 DRA 提供。

在同一个集群内,同一个扩展资源在某些节点上可以由设备插件提供,而在其他节点上由 DRA 提供。

在下面的例子中,该 DeviceClass 的 extendedResourceName 被赋值为 example.com/gpu。

那么如果一个 Pod 请求了 example.com/gpu: 2 的扩展资源,

它就会被调度到具有两个或更多个具有符合该 DeviceClass 设备的节点上。

apiVersion : resource.k8s.io/v1

kind : DeviceClass

metadata :

name : gpu.example.com

spec :

selectors :

- cel :

expression : device.driver == 'gpu.example.com' && device.attributes['gpu.example.com'].type

== 'gpu'

extendedResourceName : example.com/gpu

另外,用户可以使用一种特殊的扩展资源来分配设备,而不一定需要显式创建 ResourceClaim。

你可以使用扩展资源名称前缀 deviceclass.resource.kubernetes.io/ 并加上 DeviceClass 的名称。

这种方式适用于任意 DeviceClass,即使该类未显式指定扩展资源名称。

生成的 ResourceClaim 将包含一个请求,要求按照 ExactCount 模式,

从该 DeviceClass 中分配指定数量的设备。

通过 DRA 来分配扩展资源是一个 Alpha 特性 ,它只有当

kube-apiserver,kube-scheduler 和 kubelet 中启用了 DRAExtendedResource

特性门控 时,该特性才会被启用。

可切分设备 特性状态:

Kubernetes v1.36 [beta](默认启用)

DRA 中表示的设备不一定必须是连接到单个机器的单个单元,

也可以是由连接到多个机器的多个设备组成的逻辑设备。

这些设备可能会消耗底层物理设备的重叠资源,这意味着当一个逻辑设备被分配时,

其他设备将不再可用。

在 ResourceSlice API 中,这类设备表示为命名 CounterSet 列表,每个 CounterSet 包含一组命名计数器。

计数器表示物理设备上可供通过 DRA 发布的逻辑设备使用的资源。

逻辑设备可以指定 ConsumesCounter 列表。每个条目包含对某个 CounterSet 的引用和一组命名计数器及其消耗量。

因此,要使设备可被分配,所引用的 CounterSet 必须具有设备引用的计数器所需的足够数量。

CounterSet 必须在与设备不同的 ResourceSlice 中指定。

设备可以使用与自身位于同一资源池中的任意 CounterSet 中的计数器。

以下是两个设备的示例,每个设备从具有 8Gi 内存的共享计数器中消耗 6Gi 内存。

因此,在任何时间点只能分配其中一个设备。调度器处理这种情况,

对使用者来说是透明的,因为 ResourceClaim API 不受影响。

apiVersion : resource.k8s.io/v1

kind : ResourceSlice

metadata :

name : resourceslice-with-countersets

spec :

nodeName : worker-1

pool :

name : pool

generation : 1

resourceSliceCount : 2

driver : dra.example.com

sharedCounters :

- name : gpu-1-counters

counters :

memory :

value : 8Gi

---

apiVersion : resource.k8s.io/v1

kind : ResourceSlice

metadata :

name : resourceslice-with-devices

spec :

nodeName : worker-1

pool :

name : pool

generation : 1

resourceSliceCount : 2

driver : dra.example.com

devices :

- name : device-1

consumesCounters :

- counterSet : gpu-1-counters

counters :

memory :

value : 6Gi

- name : device-2

consumesCounters :

- counterSet : gpu-1-counters

counters :

memory :

value : 6Gi

可切分设备是一个 Alpha 特性 ,它只有当

kube-apiserver 和 kube-scheduler 中启用了 DRAPartitionableDevices

特性门控 时,该特性才会被启用。

可消耗容量 特性状态:

Kubernetes v1.36 [beta](默认启用)

可消耗容量特性允许同一台设备被多个独立的 ResourceClaim 同时使用,

由 Kubernetes 调度器负责管理每个申领消耗了多少设备容量。

这一机制类似于多个 Pod 可以共享同一节点上的资源,

多个 ResourceClaim 也可以共享同一设备上的资源。

设备驱动程序可以在 ResourceSlice 的 .spec.devices 中设置

allowMultipleAllocations 字段,以允许将该设备分配给多个独立的 ResourceClaim,

或分配给同一 ResourceClaim 中的多个请求。

用户可以在 ResourceClaim 的 spec.devices.requests 中新增的 capacity 字段进行设置,

以指定每次分配所需的设备资源容量。

对于允许多次分配的设备,请求的容量将从设备的总容量中提取或消耗,

这一机制被称为可消耗容量(Consumable Capacity) 。

随后,调度器会确保所有申领合计消耗的容量总和不会超过设备的整体容量。

此外,驱动程序的作者还可以通过在单个设备的容量上使用 requestPolicy

约束来控制这些容量的消耗方式。

例如,驱动作者可以规定某个资源的容量只能以 1Gi 为单位进行消耗。

下面是一个支持多次分配、并具有可消耗带宽容量的网络设备的示例。

kind : ResourceSlice

apiVersion : resource.k8s.io/v1

metadata :

name : resourceslice

spec :

nodeName : worker-1

pool :

name : pool

generation : 1

resourceSliceCount : 1

driver : dra.example.com

devices :

- name : eth1

allowMultipleAllocations : true

attributes :

name :

string : "eth1"

capacity :

bandwidth :

requestPolicy :

default : "1M"

validRange :

min : "1M"

step : "8"

value : "10G"

可消耗容量能被请求,如下例所示。

apiVersion : resource.k8s.io/v1

kind : ResourceClaimTemplate

metadata :

name : bandwidth-claim-template

spec :

spec :

devices :

requests :

- name : req-0

exactly :

deviceClassName : resource.example.com

capacity :

requests :

bandwidth : 1G

分配的结果将包含已消耗的容量和份额的标识符。

apiVersion : resource.k8s.io/v1

kind : ResourceClaim

...

status :

allocation :

devices :

results :

- consumedCapacity :

bandwidth : 1G

device : eth1

shareID : "a671734a-e8e5-11e4-8fde-42010af09327"

在这个例子里,选中的是一个可多次分配的设备。

但是实际上,任何不小于所请求的 1G 带宽的 resource.example.com 类型的设备都可以满足该需求。

如果选中的是一个不可多次分配的设备,那么此次分配将导致整个设备被占用。

若要强制仅使用可多次分配的设备,你可以使用 CEL 表达式

device.allowMultipleAllocations == true。

设备污点和容忍度 特性状态:

Kubernetes v1.36 [beta](默认启用)

设备污点类似于节点污点:污点具有字符串形式的键、字符串形式的值和效果。

效果应用于使用带污点设备的 ResourceClaim 以及引用该 ResourceClaim 的所有 Pod。

"NoSchedule" 效果会阻止调度这些 Pod。

在尝试分配 ResourceClaim 时会忽略带污点的设备,

因为使用它们会阻止 Pod 的调度。

"NoExecute" 效果隐含 "NoSchedule" 效果,此外还会导致已调度的所有 Pod 被驱逐。

这种驱逐是通过 kube-controller-manager 中的设备污点驱逐控制器删除受影响的 Pod 来实现的。

"None" 效果会被调度器和驱逐控制器忽略。

DRA 驱动程序可以使用它向管理员或其他控制器传达异常信息,例如设备健康状况下降。

管理员也可以使用它在 DeviceTaintRules 中执行 Pod 驱逐的预演(详见下文)。

ResourceClaim 可以容忍污点。如果污点被容忍,其效果将不会生效。

空容忍度匹配所有污点。容忍度可以限制为特定效果和/或匹配特定键/值对。

容忍度可以检查某个键是否存在,无论其值是什么,也可以检查某个键是否具有特定值。

有关此匹配机制的更多信息,请参阅节点污点概念 。

通过容忍污点一段时间可以延迟驱逐。该延迟从污点添加到设备时开始,

并被记录在污点的字段中。

如上所述,污点也适用于在节点上分配"所有"设备的 ResourceClaim。

所有设备必须不带污点,或者必须容忍其所有污点。

分配具有管理员访问权限的设备(上文 所述)也不例外。

使用该模式的管理员必须明确容忍所有污点才能访问带污点的设备。

设备污点和容忍度是一个 Alpha 特性 ,它只有当

kube-apiserver、kube-controller-manager 和 kube-scheduler 中启用了 DRADeviceTaints

特性门控 时,该特性才会被启用。

要使用 DeviceTaintRules,必须启用 resource.k8s.io/v1alpha3 API 版本。

你可以通过以下方式使用 DeviceTaintRule API 类型向设备添加污点。

由驱动程序设置的污点 DRA 驱动程序可以为其在 ResourceSlice 中发布的设备信息添加污点。

请查阅 DRA 驱动程序的文档,了解驱动程序是否使用污点以及它们的键和值是什么。

由管理员设置的污点 特性状态:

Kubernetes v1.36 [beta](默认禁用)

管理员或控制平面组件可以在不告诉 DRA 驱动程序在其 ResourceSlice

中的设备信息中包含污点的情况下为设备添加污点。他们通过创建 DeviceTaintRule 来实现这一点。

每个 DeviceTaintRule 为匹配设备选择算符的设备添加一个污点。

如果没有指定这样的选择算符,则不会为任何设备添加污点。这使得在错误地遗漏选择算符时,

意外驱逐所有使用 ResourceClaim 的 Pod 变得更加困难。

可以通过提供 DeviceClass、驱动程序(driver)、资源池(pool)和/或设备的名称来选择设备。

DeviceClass 选择该 DeviceClass 中的选择算符所选择的所有设备。

通过仅使用驱动程序名称,管理员可以为该驱动程序管理的所有设备添加污点,

例如在对整个集群中的该驱动程序进行某种维护时。

如果驱动程序管理节点本地设备,添加池名称可以将污点限制为单个节点。

最后,添加设备名称可以选择一个特定设备。如果需要,设备名称和池名称也可以单独使用。

例如,鼓励负责制备节点本地设备的驱动程序使用节点名称作为其池名称。

然后使用该池名称添加污点会自动为节点上的所有设备添加污点。

驱动程序可能使用像 "gpu-0" 这样的稳定名称,

这些名称隐藏了当前分配给该名称的特定设备。

为了支持为特定硬件实例添加污点,

可以在 DeviceTaintRule 中使用 CEL 选择算符来匹配特定于供应商的唯一 ID 属性,

前提是驱动程序支持硬件对应的这类属性。

只要 DeviceTaintRule 存在,污点就会生效。它可以随时被修改和删除。

以下是一个虚构的 DRA 驱动程序的 DeviceTaintRule 示例:

apiVersion : resource.k8s.io/v1alpha3

kind : DeviceTaintRule

metadata :

name : example

spec :

# 这个特定驱动程序的整个硬件安装已损坏。

# 驱逐所有 Pod 并且不调度新的 Pod。

deviceSelector :

driver : dra.example.com

taint :

key : dra.example.com/unhealthy

value : Broken

effect : NoExecute

API 服务器会自动跟踪此污点何时创建,驱逐控制器会添加一个包含一些信息的状况条目:

kubectl describe devicetaintrules

Name: example

...

Spec:

Device Selector:

Driver: dra.example.com

Taint:

Effect: NoExecute

Key: dra.example.com/unhealthy

Time Added: 2025-11-05T18:15:37Z

Value: Broken

Status:

Conditions:

Last Transition Time: 2025-11-05T18:15:37Z

Message: 1 pod evicted since starting the controller.

Observed Generation: 1

Reason: Completed

Status: False

Type: EvictionInProgress

Events: <none>

Pod 会被删除以进行驱逐。通常情况下,这个过程很快,除非对污点的容忍度导致驱逐延迟一段时间,

或者需要驱逐的 Pod 数量非常多。如果耗时较长,消息会提供有关当前状态的信息:

2 pods need to be evicted in 2 different namespaces. 1 pod evicted since starting the controller.

该状况可用于检查当前是否存在进行中的驱逐行为:

kubectl wait --for= condition = EvictionInProgress = false DeviceTaintRule/example

注意调度器和控制器可能在不同时间观察到新的污点,这会导致在控制器认为没有需要驱逐的

Pod 时,Pod 仍然会被调度,从而将此状况设置为 False。

实际上,通过故意延迟几秒钟后才更新状态,可以大大降低这种竞争发生的可能性。

对于 effect: None,消息会提供有关受影响设备数量、已分配设备数量以及如果效果为

NoExecute 将驱逐多少个 Pod 的信息。这可用于在实际触发驱逐之前进行预演:

创建一个包含所需选择器和 effect: None 的 DeviceTaintRule。

查看消息:

3 published devices selected. 1 allocated device selected.

1 pod would be evicted in 1 namespace if the effect was NoExecute.

This information will not be updated again. Recreate the DeviceTaintRule to trigger an update.